情報サマリー

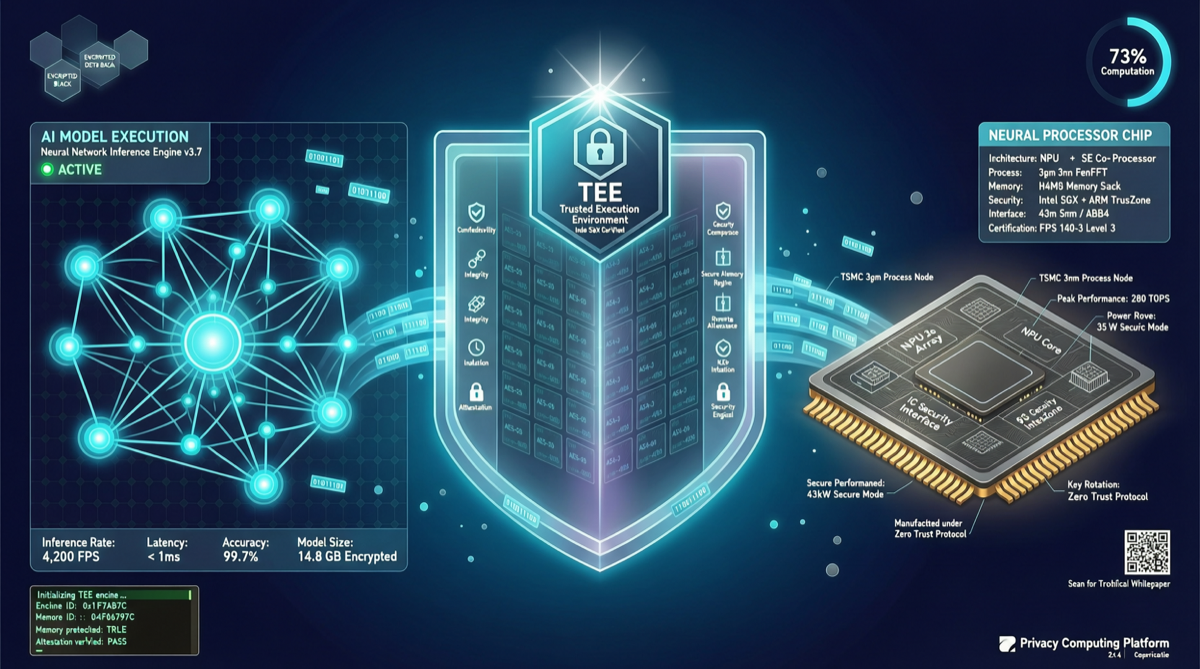

智譜AIのGLM-5.1モデルが0G Private Computerプラットフォームに正式上线した。この754BパラメータのMoEアーキテクチャモデルはMITオープンソースライセンスで提供され、TEE(信頼実行環境)内でFP8形式で動作する。

これは単なるモデルデプロイメントではない——オープンソース大規模モデルとプライバシー計算インフラの初の深度融合を标志着している。

GLM-5.1 + Private Computerの技術的意味

この出来事の分量を理解するには、3つの層に分解する必要がある:

モデル層:754B MoEのフラッグシップ仕様。GLM-5.1は現在、パラメータ数最大のオープンソースモデルの一つである。MoE(Mixture of Experts)アーキテクチャにより、推論時には一部のパラメータのみがアクティブ化されるが、754Bの総パラメータ規模は依然として極めて高いデプロイメント閾値を意味する。

ライセンス層:MITオープンソースライセンス。MITライセンスはオープンソースライセンスの中で最も寛容なものであり、商業利用、修正、配布をほぼ制限なしに許可する。これはLlamaシリーズの「制限付き商業ライセンス」や一部モデルの「研究専用」と鮮明な対比をなす。754BのフラッグシップモデルがMITライセンスを採用することは、オープンソースAIの歴史において極めて稀である。

デプロイメント層:TEE信頼実行環境。これが最も注目すべき部分だ。従来のクラウドAPIはデータプライバシー保護においてプロバイダの約束に依存していた——クラウドベンダーがデータを覗き見しないと信じるしかなかった。TEEは信頼モデルを変えた:ハードウェアレベルの暗号化保証により、推論プロセスはクラウドオペレーターを含むすべての人から不可視になる。

なぜこの組み合わせが画期的なのか?

かつて、オープンソースモデルとプライバシー計算は2本の平行線だった:

- オープンソースモデルのジレンマ:モデルウェイトは公開されているが、デプロイメントには高額なGPUクラスターが必要。一般開発者や中小企業は第三者APIに頼るしかなく、APIはデータ流出を意味する。

- プライバシー計算のジレンマ:TEEはハードウェアレベルのプライバシー保護を提供するが、その上で動作するのは主にクローズドソースモデルであり、ユーザーはモデル行為を監査することも自由に修正することもできない。

GLM-5.1 on Private Computerは同時に2つの問題を解決した:

- MITライセンス + オープンソースウェイト → 誰でもモデルを監査、修正、配布できる

- TEEデプロイメント → 推論プロセスはクラウドオペレーターから不可視、データプライバシーにハードウェアレベルの保障

つまり:完全に透明でかつ完全にプライベートなAI推論環境を手に入れたことになる。

競合との比較

| 次元 | GLM-5.1 + 0G PC | 従来のクラウドAPI | ローカルオープンソースデプロイ |

|---|---|---|---|

| モデル透明性 | MITオープンソース、完全監査可能 | クローズドソース、ブラックボックス | MITオープンソース、完全監査可能 |

| データプライバシー | TEEハードウェア暗号化保護 | プロバイダの約束に依存 | 完全ローカル、最高レベル |

| デプロイメント閾値 | 中(クラウドTEE) | 低 | 極めて高い(H100/B200クラスターが必要) |

| コスト | 推論量課金 | トークン課金 | ハードウェアコスト + 運用 |

| モデル制御性 | フォーク/修正可能 | 制御不可 | 完全に制御可能 |

このポジショニングは非常に正確だ——最も安いソリューションではなく、最もプライベートなソリューションでもないが、モデル透明性とデータプライバシーを同時に提供する唯一のソリューションなのである。

シグナル解读

このデプロイメントの背後には3つの構造的トレンドが反映されている:

オープンソースモデルの「商用化」パスが収束しつつある。Llamaの制限付きライセンスからQwenのApache 2.0、そしてGLM-5.1のMITライセンスへ——オープンソースモデルのライセンス条項はますます寛容になっている。これはベンダーの善意ではない——競争圧力である。DeepSeekが極めて低価格でフラッグシップに近い性能を提供するとき、クローズドソースベンダーはよりオープンなライセンスで開発者争奪戦を繰り広げなければならない。

TEEが「セキュリティ専用」から「AI汎用」へ移行。過去、TEEは主に暗号鍵管理、支払い処理などのセキュリティ機密シナリオに使用されていた。754BのAIモデルをTEEに詰めて実行することは、TEEの計算能力がフロンティアAI推論を支えるのに十分であることを証明している。

0G Labsのポジショニング:AIプライバシー計算のインフラ層。0G Labsはモデル企業でもアプリケーション企業でもない。Private Computerは開発者向けインフラだ——「暗号化環境内で任意のオープンソースモデルを実行する」能力を提供するのである。GLM-5.1は最初の入居フラッグシップモデルにすぎない。

アクション提言

- 金融・医療業界:TEEデプロイメントモデルに注目しよう。モデル監査可能性とデータ秘匿性の両方を満たす必要があるシナリオにおいて、これは現時点での最適解である。

- オープンソースコミュニティ:GLM-5.1のMITライセンスにより、フォークと二次開発の理想的な基盤となった。Private ComputerのAPIと組み合わせることで、カスタマイズされたアプリケーションを迅速に構築できる。

- エージェントフレームワーク開発者:TEE環境下でのモデル呼び出しの遅延と安定性を再評価する必要がある。Hermes Agent、OpenClawなどのフレームワークは、Private Computerをオプションのモデルバックエンドとして検討すべきだ。

相互検証

智譜は此前にGLM-5.1の複数バリアント(オープンウェイト版やCoding Planサブスクリプションを含む)を発売しており、0G Labsとの今回の提携はその「オープンソース+商用化」二輪戦略の継続である。同時に、世界的にAIデータプライバシー規制が強化されており(EU AI法は2026年8月に施行)、TEEデプロイメントモデルのコンプライアンス優位性は一層顕著になる。

754Bのオープンソースフラッグシップモデルが信頼実行環境内で動作するとき、AI推論の信頼モデルが書き換えられようとしている。これは技術的な詳細の最適化ではない——新パラダイムの始まりなのである。