主要な結論

Metaは4月末に Llama 4 Scout を発表 — 17B活性化パラメータ / 109B総パラメータのMoE(混合エキスパート)モデル。

- 1000万Tokenコンテキストウィンドウ:300ページのドキュメントをチャンク分割なしで直接処理

- $0.08/M Token入力価格:アグリゲータ経由でOpenAI互換APIを使用

- オープンウェイト:Muse Sparkがクローズド化する前の、最後のオープンMetaモデル層

アーキテクチャ解读

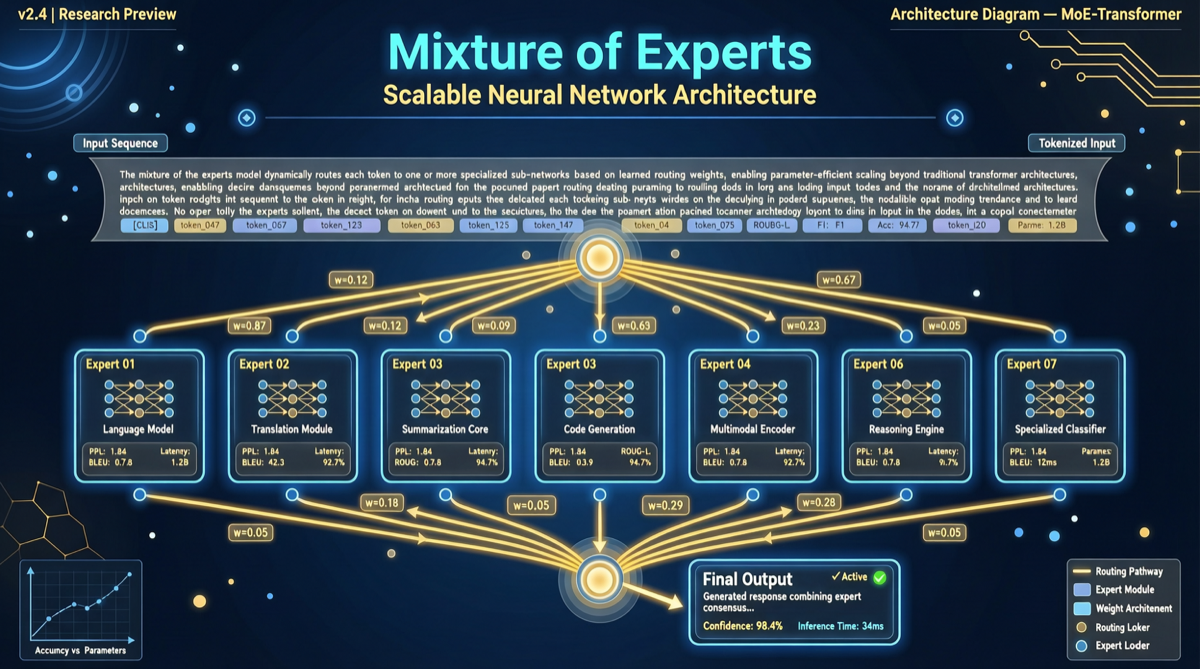

MoE設計

| パラメータ | 値 | 意味 |

|---|---|---|

| 総パラメータ | 109B | モデル知識の「総容量」 |

| 活性化パラメータ | 17B | 推論時に実際に使用される量 |

| エキスパート数 | 16 | ルーティング可能なサブネットワーク数 |

MoEアーキテクチャの核心:109Bパラメータの知識量を持ちながら、推論コストは17Bモデル並み。

価格比較

| モデル | 入力価格 ($/M Token) | コンテキスト | 公開 |

|---|---|---|---|

| Llama 4 Scout | $0.08 | 10M | ✅ |

| GPT-5.5 | $2.50 | 1M | ❌ |

| Claude Opus 4.7 | $15.00 | 200K | ❌ |

| DeepSeek-V4-Flash | $0.14 | 1M | ✅ |

まとめ

Llama 4 Scoutは最強のモデルではないが、最も実用的なモデル — 超低コストで長文書処理の真の課題(チャンク分割の必要性)を解決する。

Metaのオープンソース戦略は「全面公開」から「階層公開」へ移行中。Llama 4 Scoutは最後のチャンスかもしれない。