核心結論

面壁智能(ModelBest)の MiMo V2.5 Pro は、1T MoE アーキテクチャと最大 100 万 token コンテキストウィンドウにより、Intelligence Index で 54点 を獲得。月之暗面の Kimi K2.6 と並び、中国オープンソースモデルのトップポジションに位置する。グローバル比較では、GPT-5.5 が 60 点、Gemini と Claude シリーズが 57 点。

これは「パラメータが多いほど良い」という物語ではなく、中国モデルが MoE アーキテクチャ効率と超長コンテキストの両軸で同時に前進しているシグナルである。

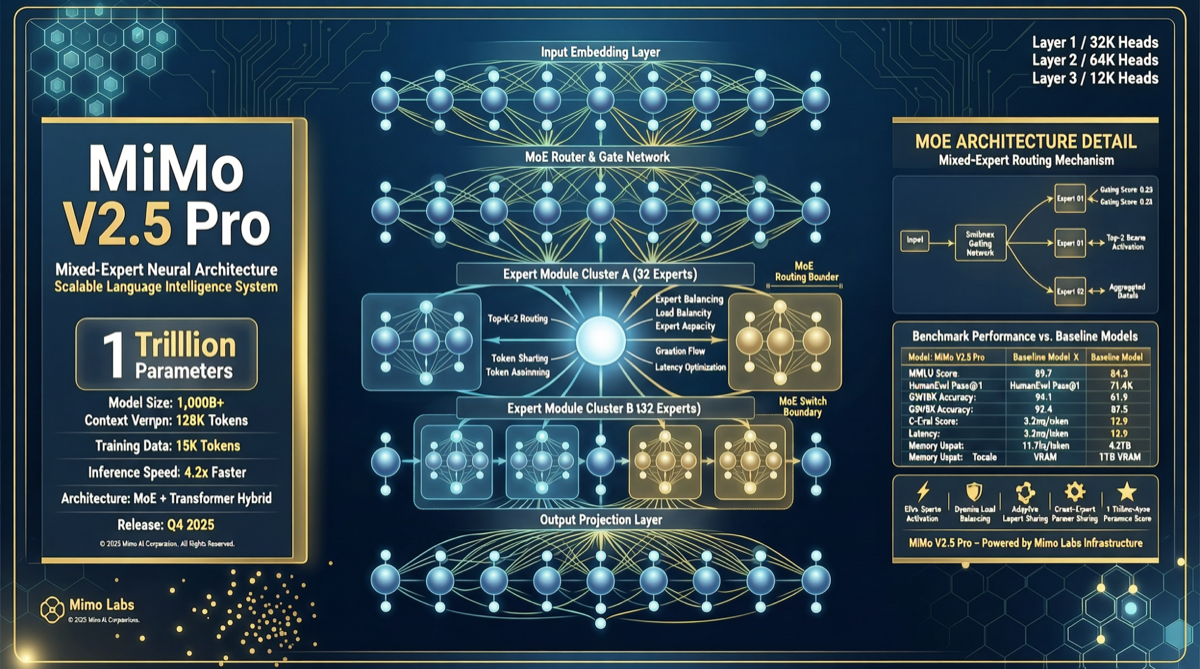

MiMo V2.5 Pro 主要データ

| 項目 | MiMo V2.5 Pro | Kimi K2.6 | DeepSeek V4 Pro | GPT-5.5 |

|---|---|---|---|---|

| Intelligence Index | 54 | 54 | 52 | 60 |

| 総パラメータ | 1T (MoE) | 1T (MoE) | 1.6T (MoE) | 不明(クローズド) |

| アクティブパラメータ | 約 54B | 不明 | 49B | 不明 |

| 最大コンテキスト | 1M tokens | 1M tokens | 1M tokens | 不明 |

| オープン状況 | Open Weights | Open Weights | Open Weights | クローズド |

| ベンダー | 面壁智能 | 月之暗面 | 深度求索 | OpenAI |

面壁智能の戦略パス

面壁智能は、百度、阿里、字节とは異なる道を歩んでいる:

- 絶対パラメータ規模で競争しない:1.6T ではなく 1T MoE、より少ない総パラメータで同等以上のスコアを達成

- コンテキストウィンドウに注力:1M token コンテキストで Kimi K2.6 と DeepSeek V4 Pro に直接対抗

- Open Weights 戦略:クローズドソースの GPT-5.5(60点)との差はわずか 6 点、オープンウェイトによりコミュニティがコンシューマハードウェアでデプロイ・ファインチューニング可能

アクション推奨

- 長文書分析:MiMo V2.5 Pro の 1M コンテキストは百ページ級の法律/金融文書処理に適する

- コンシューマ GPU デプロイ:54B アクティブパラメータは Q4 量子化で 48GB VRAM(RTX 4090 デュアルまたは A6000)で実行可能

- DeepSeek V4 Pro との選択:API コスト重視なら DeepSeek V4 Pro の限定 2.5 割引が最优、オープンソースエコシステム重視なら MiMo V2.5 Pro をテスト