核心結論

「90日でAIエージェント構築を学ぶ」GitHubトレンドリストにおいて、Pipecat は最初の推奨プロジェクトとしてリストされています——「実際に使用した本番級音声エージェントのほとんどを支えるフレームワーク」。

核心的なセールスポイント:

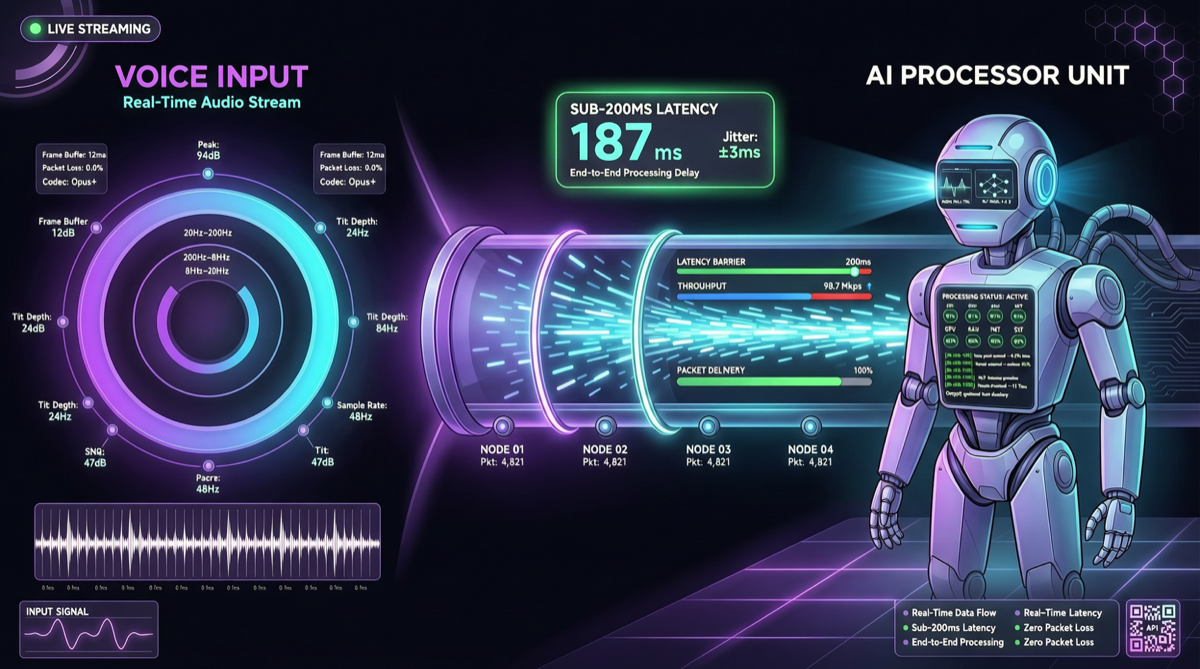

- <200ms エンドツーエンド遅延:ユーザーの発言からAIの返信までの完全な連鎖を200ms以内に制御

- 本番グレード:デモではなく、実際の配備のために設計されたフレームワーク

- Python ネイティブ:Python 開発者に優しい

- マルチモーダルパイプライン:音声、テキスト、画像のストリーミング処理パイプラインをサポート

Pipecat とは

Pipecat はリアルタイム音声 AI フレームワークで、低遅延の音声会話エージェントの構築に焦点を当てています。そのコアアーキテクチャは「パイプライン」システムであり、音声入力 → 音声認識 → LLM 推論 → 音声合成 → 音声出力を1つのストリーミング処理チェーンに連結します。

アーキテクチャ概要

ユーザー音声 → VAD(音声活動検出) → STT(音声→テキスト) → LLM → TTS(テキスト→音声) → ユーザーが聞く

↑ ↓

└────────────────── ストリーミング処理 ───────────────────────────────────────┘重要な設計判断:

- フルチェーンストリーミング:各ステージがリアルタイムで処理され、前のステージが完全に終了するのを待つ必要なし

- VAD 駆動:ユーザーの発話を検出したときのみ下流処理をアクティブ化し、計算リソースを節約

- モデル不可知:STT、LLM、TTS の3つのステージは独立して異なるプロバイダーを選択可能

核心コンポーネント

| コンポーネント | 機能 | サポートされるプロバイダー |

|---|---|---|

| VAD | ユーザーが発話しているタイミングを検出 | Silero、WebRTC |

| STT | 音声→テキスト | Whisper、Deepgram、Google STT |

| LLM | 会話推論 | OpenAI、Anthropic、Groq、ローカルモデル |

| TTS | テキスト→音声 | ElevenLabs、Cartesia、OpenAI TTS、Coqui |

| Transport | 転送プロトコル | WebSocket、Daily.co、LiveKit |

競合比較

| フレームワーク | 言語 | 遅延 | リアルタイム音声 | 本番対応 | 学習曲線 |

|---|---|---|---|---|---|

| Pipecat | Python | <200ms | ✅ コア焦点 | ✅ | 中程度 |

| LiveKit Agents | Python/JS | <300ms | ✅ | ✅ | 低い |

| Vocode | Python | <400ms | ✅ | ✅ | 低い |

| Twilio Autopilot | - | >500ms | 限定的 | ✅ | 低い |

| LangChain Voice | Python | >500ms | ✅(プラグイン) | 実験的 | 高い |

Pipecat の優位性は遅延制御とパイプラインの柔軟性にあります。<200ms の遅延は、会話体験が真人間の通話に近づきます(人間会話の平均応答遅延は約200〜300ms)。

クイックスタート

インストール

pip install pipecat-ai最小限の例

from pipecat.pipeline.pipeline import Pipeline

from pipecat.pipeline.runner import PipelineRunner

from pipecat.services.openai import OpenAILLMService

from pipecat.transports.services.daily import DailyTransport

# 転送層の設定(Daily.co を使用)

transport = DailyTransport(

room_url="https://your-room.daily.co",

token="your-token",

bot_name="Pipecat Bot"

)

# LLM の設定

llm = OpenAILLMService(model="gpt-5.4", api_key="your-key")

# パイプラインの構築

pipeline = Pipeline([

transport.input(), # 音声を受信

llm, # LLM 推論

transport.output() # 音声返信を送信

])

# 実行

runner = PipelineRunner()

await runner.run(pipeline)カスタム STT + TTS

from pipecat.services.deepgram import DeepgramSTTService

from pipecat.services.elevenlabs import ElevenLabsTTSService

stt = DeepgramSTTService(api_key="dg-key")

tts = ElevenLabsTTSService(api_key="11labs-key", voice_id="Rachel")

pipeline = Pipeline([

transport.input(),

stt, # 音声→テキスト

llm, # 会話推論

tts, # テキスト→音声

transport.output()

])典型的なユースケース

| シナリオ | 構成の提案 | 推定遅延 |

|---|---|---|

| カスタマーサービスボット | GPT-5.4 + ElevenLabs | 約150ms |

| 言語学習パートナー | ローカルモデル + Coqui TTS | 約180ms |

| 音声アシスタント | Groq + Cartesia TTS | 約120ms |

| 会議要約 | Deepgram STT + Claude | N/A(非リアルタイム) |

コスト見積もり

1日1,000通話、1通話平均5分の音声エージェントの場合:

| コンポーネント | プロバイダー | 月間コスト(推定) |

|---|---|---|

| STT | Deepgram | 約$150 |

| LLM | GPT-5.4 | 約$500 |

| TTS | ElevenLabs | 約$200 |

| 転送 | Daily.co | 約$100 |

| 合計 | 約$950/月 |

GPT-5.4 の代わりに DeepSeek V4 Pro(割引価格)を使用する場合、LLM コストは約90%削減でき、総コストは約$500/月になります。

アクション推奨事項

- 音声エージェント開発者:リアルタイム音声対話アプリケーションを構築している場合、Pipecat は現在 Python エコシステムで最も成熟したオプションです。

- 既存の LangChain ユーザー:Pipecat のパイプライン概念は LangChain と異なります——ストリーミングリアルタイムシナリオ向けに設計されています。低遅延音声対話が必要なアプリケーションの場合、移行を検討してください。

- コスト管理:STT と TTS のコストは過小評価されがちです。プロジェクトの早い段階で使用量の見積もりを立ててください。Deepgram と Cartesia のコストパフォーマンスは注目する価値があります。

- ローカル配備:Whisper.cpp(STT)と Coqui TTS(音声合成)と組み合わせることで、Pipecat は完全にローカルで実行可能であり、データプライバシー要件が高いシナリオに適しています。