核心的な判断

Qwen(通義千問)チームはソーシャルメディアで確認しました:27Bパラメータ規模の閾値を突破し、次のターゲットは8Bエッジモデル。

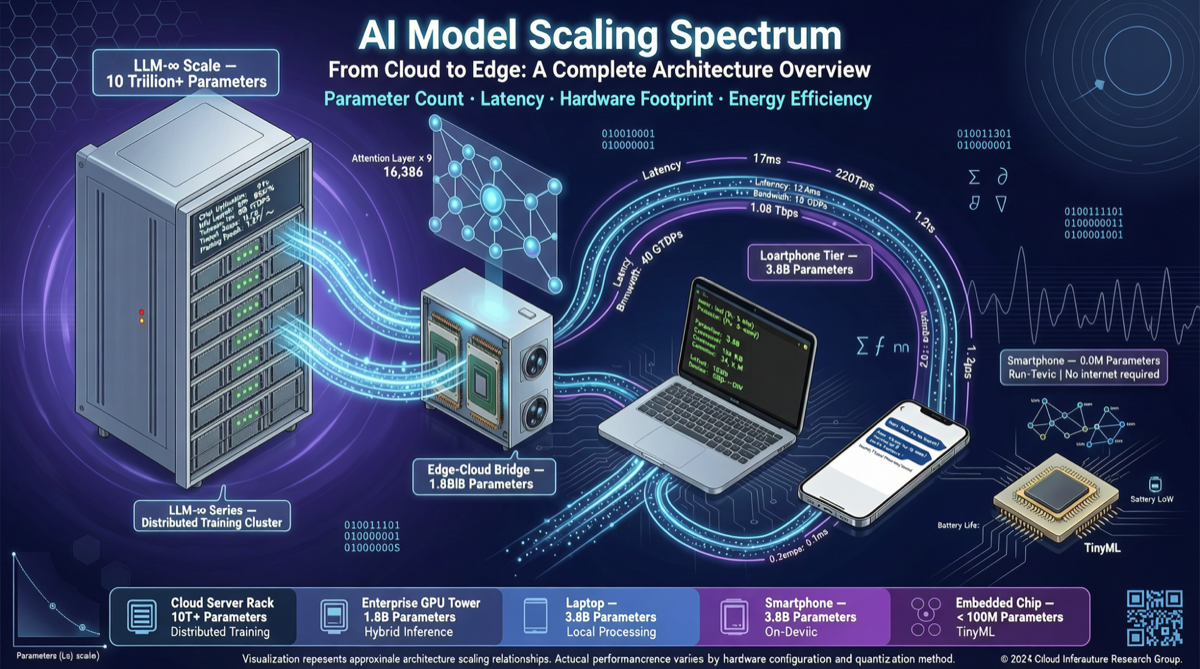

これは単なる数字の変化ではありません。すでに公開されているQwen 3.6シリーズ — 35B MoE、3.6B小型モデル、Max Preview超大規模モデル — と合わせ、アリババはクラウドの超大規模モデルからコンシューマーグレードのエッジモデルまでを網羅するフルスケールオープンソースモデルマトリックスを構築しています。

スケールロードマップ:Qwen 3.6 の4層アーキテクチャ

| モデル仕様 | パラメータ数 | ポジショニング | ターゲットシナリオ |

|---|---|---|---|

| Qwen 3.6 Max Preview | 超大規模(未公開) | フラッグシップAPIモデル | 複雑な推論、エンタープライズタスク |

| Qwen 3.6 35B MoE | 35B合計 / 3.6Bアクティブ | 効率的MoEアーキテクチャ | 中規模コンピューティングデプロイ、コスト重視 |

| Qwen 3.6 27B | 27B密結合 | パフォーマンス/効率バランス | シングル4090/5090 GPUデプロイ |

| Qwen 3.6 8B(ターゲット) | 8B密結合 | エッジ軽量モデル | ノートPC/モバイルオンデバイス推論 |

| Qwen 3.6 3.6B | 3.6B | 超軽量 | エッジデバイス、IoT |

このロジックは明確です:まず27Bでパフォーマンスベンチマークを確立し、その後8Bで規模を下沉させる。

なぜ8Bが次の重要ノードなのか?

8Bパラメータは2026年において特別な意味を持っています:

- コンシューマーGPUのフルカバー:RTX 4060/4070(8-12GB VRAM)でINT4量子化8Bモデルをフルロード可能

- Apple Siliconネイティブ実行:M4 MacBook(16GBユニファイドメモリ)で8Bモデル推論をスムーズに実行

- モバイルデプロイ実現可能:8B INT4量子化後約4-5GB、ハイエンドスマホメモリに収まる

- 知識蒸留の最適受信側:27B→8Bの蒸留パイプラインが成熟、パフォーマンス損失を10%以内に制御可能

競合分析:Qwen vs Llama オープンソース戦略

| 次元 | Qwen 3.6 | Llama 4 (Meta) |

|---|---|---|

| 最大オープンモデル | 35B MoE | 405B 密結合 |

| エッジターゲット | 8B | 3B / 8B |

| MoEサポート | 35B/3.6B | あり |

| 中国語最適化 | ネイティブ | ファインチューニング必要 |

| 商用ライセンス | 寛容 | 寛容 |

| エコシステムツールチェーン | ModelScope + vLLM | Ollama + LM Studio |

Qwenの戦略はLlamaよりも実用的です — 最大パラメータ数を追うのではなく、最も広範なデプロイシナリオをカバーすることを追求しています。これは中国開発者の実際のニーズにより合致しています:H100を持っている人は多くありませんが、4090あるいはそれ以下のGPUを持っている人は多いです。

アクションガイド

- Qwen 3.6を評価している場合:8Bバージョンのリリースタイムラインに注目。これがコンシューマーグレードデプロイの重要ノードになります

- エッジAI製品を構築している場合:INT4量子化版Qwen 3.6 8Bは最もコスト効率の高い選択肢の一つになります

- Llamaをエッジで使用している場合:中国語シナリオにおけるQwen 3.6 8Bのパフォーマンス優位性をA/Bテストに組み込む価値があります

Qwenの「27Bから8Bへ」は縮小ではなく、次元 strikeです — より小さなパラメータ規模、より低いデプロイの敷居で、より広範なユースケースをカバーします。