結論

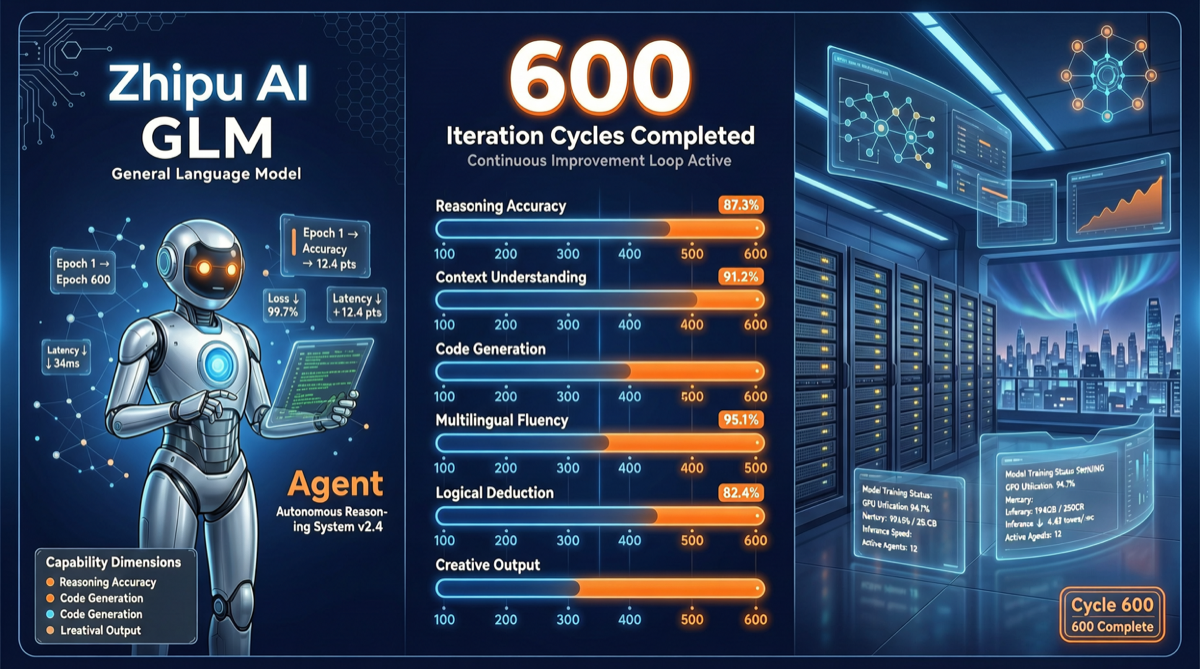

智譜は4月初めにGLM-5.1をリリースし、AI Agent向け次世代フラッグシップモデルとして位置づけられました。核心的な売りは静的ベンチマークでの絶対スコアではなく、長时序タスクにおける継続的最適化能力——モデルは600回のイテレーションにおいて長程推論の継続的改善を示しています。これはGLM-5の「無週限度額」プラン調整と鮮明な対比を形成しています:GLM-5は商業化に収斂し、GLM-5.1はAgent新シナリオを開拓しています。

GLM-5.1の技術ハイライト

長时序タスク能力

GLM-5.1の核心イノベーションは複数イテレーションにおける継続的学習能力にあります。従来のモデルはマルチラウンドAgentループにおいて「能力劣化」が発生しやす——会話ラウンドが増えるにつれて出力品質が低下します。GLM-5.1はアーキテクチャ最適化により、600回のイテレーションにおいて継続的改善の趨勢を維持しました。

| 能力次元 | GLM-5 | GLM-5.1 | 改善方向 |

|---|---|---|---|

| 長程推論 | 基準 | 顕著に強化 | 多段タスク分解とバックトラッキング |

| イテレーション最適化 | 限定的 | 600回の継続的改善 | Agent自己修正ループ |

| SWE-Bench Pro | 業界领先 | さらに领先 | コード修復タスク |

| Agentツール呼び出し | サポート | 強化 | ツール選択精度 |

SWE-Bench Proでの领先

SWE-Bench Pro(ソフトウェアエンジニアリングベンチマークの専門版)において、GLM-5.1の表現は業界第一梯队に位置しています。このベンチマークは実際のコード修復シナリオをシミュレートします——GitHubイシューとコードベースが与えられ、モデルは問題を理解し、コードを位置特定し、修復案を提示する必要があります。

Agentシナリオにとって、SWE-Bench Proは従来の问答ベンチマークよりも意味のある指標です。なぜならそれは以下を測定するからです:

- 複雑なコードベースの理解能力

- 多段推論(位置特定→分析→修復→検証)

- ツール使用(検索、読取、編集、テスト)

なぜ重要なのか

Agent赛道での国産モデルの差別化

国産大模型競争において、各社は差別化定位を探しています:

| 厂商 | 核心定位 | 優勢シナリオ |

|---|---|---|

| DeepSeek | 極限コストパフォーマンス | 大規模API呼び出し、長文 |

| Kimi/月之暗面 | 長コンテキスト + 検索強化 | 情報検索、知識整理 |

| MiniMax | マルチモーダル + 安全 | コンテンツ創作、安全敏感シナリオ |

| 智譜GLM | Agent + コード | プログラミング辅助、自動化ワークフロー |

GLM-5.1のリリースは智譜のAgent + コード赛道における定位をさらに強化しました。長时序タスクの継続的最適化能力はAgentシナリオの核心需求です——数百ラウンド継続して作業しても劣化しないモデルは、単輪会話で優れた表現をするモデルよりも実用的価値があります。

GLM-5商業化 vs GLM-5.1技術突破

注目すべきは、智譜が同時に2つのことを行っていることです:

- GLM-5商業化収斂:「無週限度額」旧プランを停止、より精细化された価格戦略へ移行

- GLM-5.1技術突破:Agent長时序能力で技術壁垒を構築

この「旧製品を收紧しながら新製品を推出する」戦略は国産模型厂商の中で越来越一般的になっています——価格戦争の中で製品イテレーションを通じて利益率を維持。

競合との比較

長时序Agent能力

| モデル | イテレーション安定性 | 600+ラウンド劣化程度 | Agentシナリオ適配 |

|---|---|---|---|

| GLM-5.1 | 継続的改善 | 最小 | 高 |

| Claude Sonnet 4.6 | 安定 | 低 | 高 |

| GPT-5.5 | 中等 | 中等 | 中等 |

| Qwen 3.5 | 良好 | 低 | 中高 |

| Kimi K2.5 | 良好 | 低 | 中高 |

価格参考

智譜の価格戦略は「無週限度額」からより構造化されたプランへ移行しました:

| プラン | 月額 | 適用シナリオ |

|---|---|---|

| 新プラン(旧無週限度額ユーザー) | 従量課金 | 高頻度Agent使用 |

| 標準プラン | 月額サブスクリプション | 日常開発辅助 |

| 無料試用 | 限定枠 | 評価とテスト |

注意:智譜は4月30日にGLM Coding Plan無週限度額旧プランの自動更新を停止、影響を受けたユーザーは2ヶ月の新プラン權益を獲得。

アクション推奨

GLM-5.1に適したシナリオ

- Agent駆動のコード修復:大規模コードベースで継続的に作業、多段推論を必要とするシナリオ

- 長时序自動化ワークフロー:モデルが多数のラウンドのインタラクションで一貫性と改善趨勢を維持する必要があるタスク

- SWE-Bench類評価タスク:高精度なコード理解と修復能力を必要とするシナリオ

テスト戦略

- まず600ラウンドストレステストを実施:GLM-5.1の核心売りは長时序安定性、この能力は大量イテレーションで検証すべき

- SWE-Bench Pro表現を比較:チームがコード品質を重視する場合、実際のコード修復タスクでGLM-5.1と他モデルを比較

- ツール呼び出し精度を評価:Agentシナリオではツール呼び出しの精度がタスク完成率に直接影響

移行推奨

- GLM-5ユーザー:以前無週限度額プランを使用していた場合、4月30日以降自動更新が停止されたことに注意。2ヶ月の新プラン權益已获得。この時間を使ってGLM-5.1をテストすべき

- 新開発者:GLM-5.1は智譜現在のAgent赛道の技術前沿、国産Agentモデルの备选方案の一つとして価値あり

- 予算敏感ユーザー:智譜の価格調整に注目、新プランは古い無週限度額より高くなる可能性、ROIを評価する必要あり