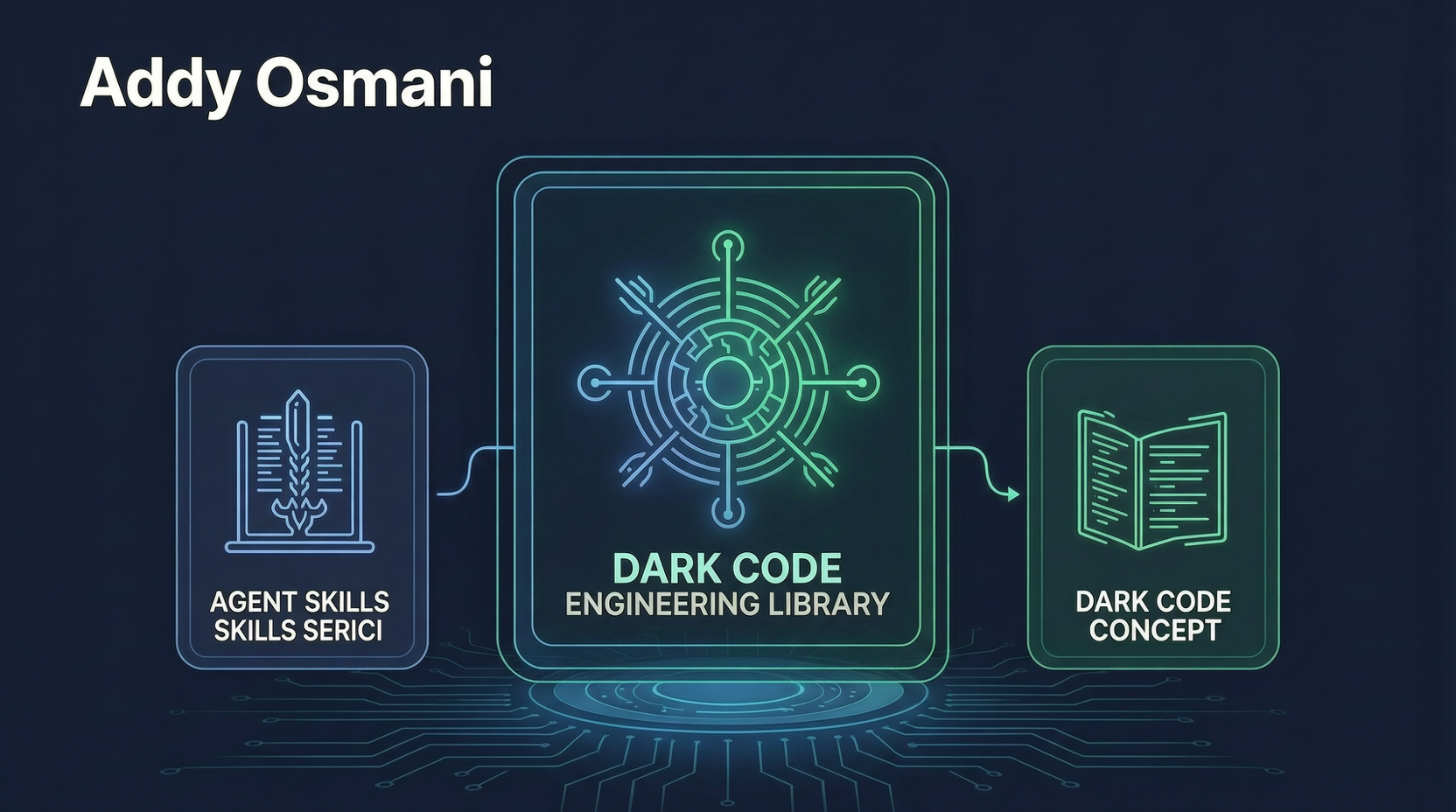

38.9K star、1 週間で 10,738 増加。Google Chrome チームのエンジニア Addy Osmani が agent-skills というプロジェクトを作った。

コアアイデアはシンプル:上級エンジニアがコードを書くときの暗黙的なワークフローを、AI エージェントが自動実行できるスキルとしてエンコードする。

アイデアから本番までをカバーする 7 つのスラッシュコマンド

無駄がない。7 つのコマンド、開発プロセスの 7 つのステージ:

/spec— 何を作るか定義。コードの前に spec。/plan— どう作るか計画。小さなアトミックタスク。/build— 段階的に構築。一度に一つのスライス。/test— 動作を証明。テストが証明。/review— マージ前にレビュー。コードの健康度を向上。/code-simplify— コードを簡素化。明瞭さは賢さより優先。/ship— 本番にデプロイ。速い方が安全。

各コマンドは対応するスキルを自動アクティブ化する。API 設計は api-and-interface-design をトリガー、UI 構築は frontend-ui-engineering をトリガー。

なぜこれが重要か

技術的に画期的だからではない — 本質的に SKILL.md ファイルのコレクションに過ぎない — が、スマートな入り口を選んだからだ。

既存の AI コーディングツールの大半は「Agent がどうコードを書くか」を解決している。agent-skills は別の問題を解決する:Agent がどのような順序と基準でコードを書くべきか。

この 2 つは大きく違う。1 つは能力の問題、もう 1 つは方法論の問題。Addy Osmani は後者に取り組む — Google レベルのエンジニアリング規律を AI エージェントが理解・実行できるルールとしてエンコードする。

例。多くの人の Claude Code ワークフロー:要件を記述 → Agent が書き始める → コードが出る → 手動テスト → バグ発見 → 修正。agent-skills はこれを強制パイプラインに分割:/spec → /plan → /build → /test → /review → /ship。各ステップに quality gate がある。

教条的に聞こえる。だがチーム開発にとって、教条は良いことかもしれない — 異なるスキルレベルのエンジニアが一貫した品質のコードを产出できるようにする。

Claude 以外もサポート

このプロジェクトは Claude Code、Cursor、Gemini CLI、Windsurf、OpenCode、GitHub Copilot をサポート。それぞれにセットアップガイドがある。

Addy Osmani は特定のツール向けプラグインを書いているのではなく、クロスエージェントのエンジニアリングスキル標準を定義している。広く採用されれば、異なる AI コーディングツールの产出コードの品質差は縮まる — 基盤となるワークフロー規律が同じだから。

所感

これは本質的に「ベストプラクティス」のコレクションだ。ただしベストプラクティスには問題がある:上級者には常識、初心者には抽象的すぎる可能性がある。

api-and-interface-design を例に取ろう。ガイドラインは何か?具体的なチェックリストはあるか?「RESTful API 設計時に X、Y、Z に注意」というレベルのアドバイスなら、AI エージェントへの価値は限定的 — おそらく Agent は既にそれを知っている。

真に価値のあるスキルは、見落とされやすいが影響が大きい詳細であるべきだ:「API を変更するたびに OpenAPI spec を更新する」とか「依存を追加する際にライセンス互換性を確認する」など。これこそが上級者と初心者の差。

skills ディレクトリを覗いたが、確かにこういう詳細レベルのスキルがいくつかある。品質は逐一検証していない。

結論

agent-skills は技術的ブレイクスルーではない — エンジニアリング規律のプロダクト化だ。チームが AI コーディングツールを使っているなら、30 分かけて見る価値がある — 特に /spec と /review は投資対効果が最も高い 2 つ。

主要ソース:

- addyosmani/agent-skills — 公式リポジトリ

- GitHub Trending weekly — 今週のトレンディングランキング