AIはもう人間のフリができなくなる。少なくとも中国市場では、7月15日からこのレッドラインが正式に施行される。

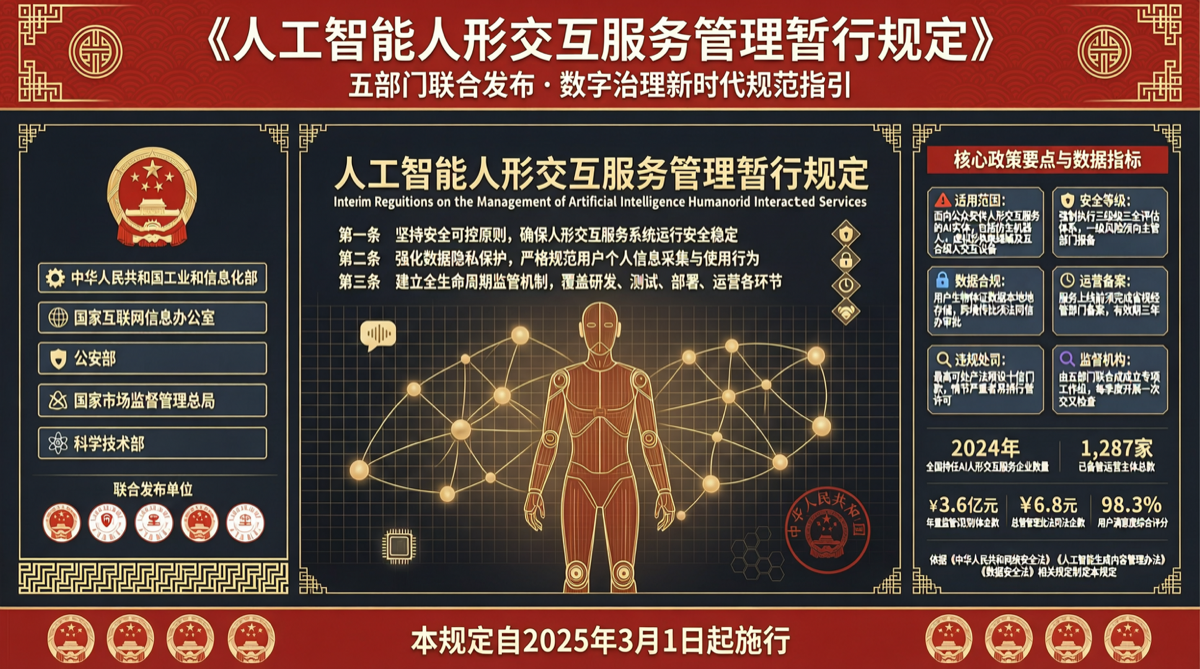

4月10日、国家インターネット情報弁公室、国家発展改革委員会、工業情報化部、公安部、市場監督管理総局の五部門が「人工智能擬人化インタラクションサービス管理暂行办法」を共同発表した。これは世界的に見ても、AIの擬人化行為に特化した数少ない専門法規の一つだ。

核心規定

辦法の核心要件は3つにまとめられる:

第一、身元表示。 AIサービスを提供するプラットフォームは、ユーザーがAIとインタラクションしていることを顕著な方法で告知しなければならず、AIの身元を隠蔽または曖昧にしてはならない。

第二、行動の境界線。 AIサービスは擬人化の方法で詐欺、誤認、その他のユーザー権利を侵害する行為を行ってはならない。「人間のように話す」ことは構わないが、「人間を装って騙す」ことはダメだ。

第三、責任追及。 サービス提供者はAIの擬人化インタラクション行為に対して管理責任を負う。問題が起きても、「AIが勝手に言った」という言い訳は通用しない。

なぜ今なのか

このタイミングは驚きではない。2026年上半期、AIチャットボット、仮想伴侶、AIデジタルヒューマンなどのサービスが中国国内で急速に普及した。一部の製品は「ツール」と「伴侶」の境界を曖昧にしている——ユーザーが相手真人間かAIか区別できないケースは決して少なくない。

規制の観点から見れば、擬人化AIがもたらすリスクは技術的なものだけでなく、社会的かつ心理的なものでもある。

主な情報源:

- 国家インターネット情報弁公室等五部門連合公告

- 搜狐科技解説