コーディングAgentを訓練する上で最も難しいのはモデル自体ではなく——環境が動かないことだ。

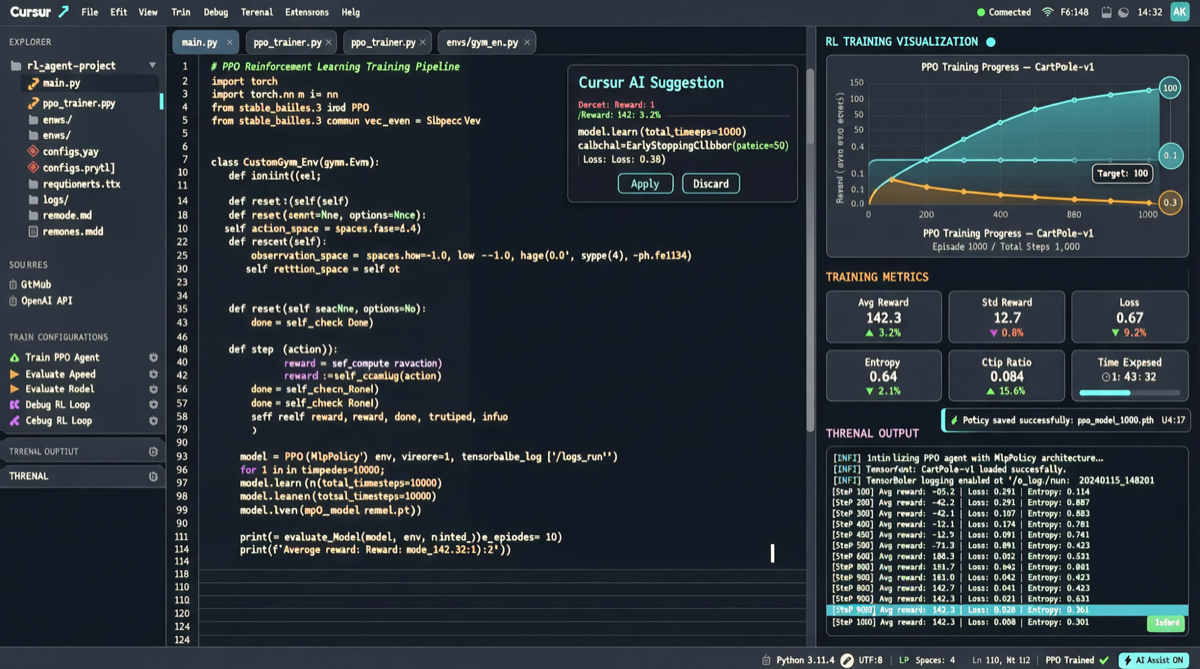

RL訓練には動作するコード環境が必要だ。環境が正しく設定されないと、モデルはデバッグと依存関係のインストールにtokenを全部浪費してしまい、コードの書き方を学ぶ機会が全くない。Cursorがこの問題の解決策を公開した。名前をautoinstallと言う。

アプローチは単純すぎて粗暴にさえ見える:前世代のComposerモデルを使って、次世代の訓練環境を構築するのだ。

どうやるか

Composer 2を訓練するとき、CursorはComposer 1.5に環境初期化を任せた。具体的には:

- Composer 1.5がターゲットプロジェクトの依存関係と設定を読み取る

- プロジェクトが動くまで自動インストール、修正、デバッグを行う

- この「クリーン」な環境をComposer 2にRL訓練用に渡す

- Composer 2は環境設定にtokenを1つも浪費しない

これが自己反復ループを作る:各世代が環境設定をより上手に行い、次世代の訓練環境はさらにきれいになる。

なぜこれが重要なのか

CursorはRL訓練を行う最初の会社ではないが、「環境設定」という泥仕事をモデル自身に任せたことを公にした最初の会社だ。

ほとんどの会社は手動で作成したDocker環境か、エンジニアによる設定デバッグに依存している。Cursorはこのステップを完全に自動化した。しかも自社のモデルを使って。

利点は明確だ:

- 訓練コストの削減:プロジェクトごとに環境を手動設定するエンジニアが不要

- データの多様性向上:より多くの種類のプロジェクトでRL訓練を自動実行可能

- 高速な反復:次世代モデルの訓練をより早く開始できる

ただしリスクもある:前世代モデルが設定した環境にバグや欠落した依存関係がある場合、それらのエラーが次世代の訓練に伝播し、累積エラーを生む可能性がある。

開発者への示唆

このテクニックを普通の開発者がそのまま再現するのは難しい——Composer 1.5を持っている人はほぼいない。だがアイデアは参考になる:

Claude CodeやCodexで自動化タスクを行う場合、まず安い高速モデル(HaikuやGPT-4o miniなど)で環境初期化と依存関係チェックを行い、確認が取れてから強モデルに実際の作業を任せる。節約されたtokenはそのまま節約された金額だ。

CursorのコーディングAgent訓練方法論は常にプラグマティックだ。「破壊的」とは吹かず、実際の問題を解決するだけ。今回のautoinstall公開もそのパターンを続けている。

主要ソース:

- X/Twitter コミュニティディスカッションスレッド