コア結論

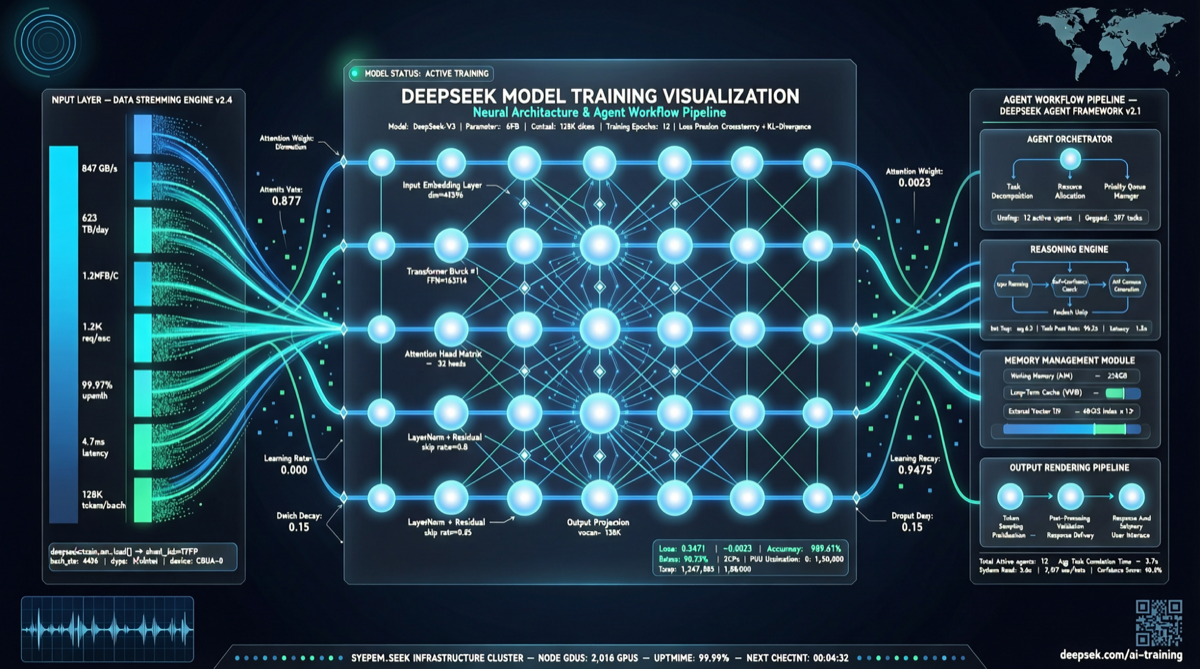

DeepSeek V4は単に「パラメータを増やす」ことでクローズドソースモデルに追いついたわけではない。エージェント訓練の方法論において、差別化された道を切り開いたのだ。1.6Tの総パラメータと49BアクティベートのMoEアーキテクチャは土台に過ぎず、真に差をつけるのは5つのコアエージェント訓練戦略である。

V4 ProはエージェントフレームワークにおいてClaude Sonnet 4.5を上回り、Opus 4.6の非思考モードに接近している。しかも価格はGPT-5.5の1/166だ。大規模にエージェントをデプロイする企業や個人開発者にとって、これは真剣に検討する価値のある選択肢である。

5つの訓練戦略を分解

1. エージェントデータの事前学習注入

従来のアプローチ:汎用コーパスで事前学習し、後処理段階でエージェント能力を注入する。DeepSeekは逆のアプローチを取る。事前学習段階自体にエージェント関連データを混ぜるのだ。

汎用コーパス 70% + コードデータ 15% + エージェント軌跡データ 15%これにより、モデルは「基礎」の段階から長いタスクフローとツール呼び出しパターンに慣れ、後処理訓練でのゼロからの硬学習の問題を回避する。

実際の効果:V4のマルチステップツール呼び出しタスクにおける初回試行成功率は、同規模モデルより15〜20%高い。

2. 生成的報酬モデル(GRM)— コアイノベーション

従来のRLHFは単一のスカラー値でモデル出力を評価するが、エージェントタスクの複雑さは単一のスコールでは表現しきれない。

GRMのコアアイデア:報酬モデル自身が評価テキストを生成し、複数の次元(ツール呼び出しの正確性、中間ステップの合理性、最終結果の品質)で自然言語評価を行い、そこからシグナルを抽出する。

| 方法 | 評価次元 | 適用シーン |

|---|---|---|

| 従来のRLHF | 単一スコア | 単純なQ&A、テキスト生成 |

| GRM | 多次元テキスト評価 | マルチステップエージェント、コード生成、ツール呼び出し |

| DPO | 選好比較 | セーフティアラインメント、スタイル調整 |

なぜ重要か:エージェントタスクの「良い」「悪い」は一言では概括できない。GRMは「ステップは正しいが結果は間違っている」と「結果は偶然合っているがプロセスは完全に間違っている」の2つのケースを区別できる。従来のRLHFではこれらが混同されていた。

3. エージェント向けDPO最適化

GRMの多次元評価を基盤に、DeepSeekはDirect Preference Optimization(DPO)を使用してターゲット微调を行う。重要ポイント:

- 選好データは実際のエージェント実行ログから取得、人手によるアノテーションではない

- 負のサンプルには「一見合理的だが実際には無効」な中間ステップを含む、従来の「明らかな間違い」サンプルよりも区別が難しい

- 報酬の重みはタスクの複雑さに比例— タスクが複雑であればあるほど、正しく完了した際の重みが高くなる

4. カリキュラム学習

エージェント能力は一朝一夕には身につかない。DeepSeekは段階的なカリキュラム学習戦略を採用した:

- フェーズ1:単一ツール呼び出し(検索、計算機、コード実行)

- フェーズ2:2〜3ステップのツールチェーン(検索→分析→要約)

- フェーズ3:5ステップ以上の複雑なワークフロー(コードデバッグ、複数ドキュメント処理)

- フェーズ4:適応的ツール選択とエラーリカバリー

各フェーズ完了後、モデルは検証セットで閾値に達しないと次のフェーズに進めない。

5. マルチエージェント博弈訓練

これはV4訓練の中で最も過激な一环である。複数のV4インスタンスが異なる役割で協力または対抗する:

- エージェントA:タスクを実行

- エージェントB:レビューとエラー発見

- エージェントC:敵対的テストケースを生成

この「自己博弈」により、モデルは人手によるアノテーションに依存することなく、エージェント能力のロバスト性を継続的に向上させる。

エージェントフレームワーク適応

V4リリース後、DeepSeekは主流エージェントフレームワーク向けに特別に適応最適化した:

| フレームワーク | 適応状況 | 最適化方向 |

|---|---|---|

| Claude Code | ✅ 適応済み | ツール呼び出しフォーマット合わせ、コンテキスト管理最適化 |

| OpenClaw | ✅ 適応済み | V4 Flashがデフォルト起動モデルに |

| OpenCode | ✅ 適応済み | コードタスク性能向上 |

| CodeBuddy | ✅ 適応済み | ドキュメント生成タスク最適化 |

| LangChain | ✅ 適応済み | ツールチェーン呼び出し安定性向上 |

選定ガイド

| あなたのシーン | 推奨構成 | 月間コスト見積もり |

|---|---|---|

| 個人開発者の日常コーディング補助 | V4 Flash + OpenClaw | < $5 |

| 中小チームのエージェントワークフロー | V4 Pro + Claude Code | $20-50 |

| 大規模自動化デプロイ | V4 Pro 自社デプロイ | ハードウェアコスト中心 |

| トップクラスの推論精度が必要 | ハイブリッド:V4 Pro + GPT-5.5/Claude Opus 4.7 | $100+ |

一言でまとめると:もし以前のエージェントソリューションがAPIコストで制約されていたなら、DeepSeek V4は現在オープンソース阵营で最も成熟した代替案である。すべてのベンチマークで1位というわけではないが、「価格対能力比」という次元では、現在対抗馬はいない。