結論

2026 年 5 月、オープンソース AI モデルと閉源 API の間の性能差が消えつつある。OpenRouter 最新ランキングでは、Kimi K2.6 がすでに総合能力でオープンソース阵营をリードし、GLM 5.1 がそれに続き、DeepSeek V4 Preview が追いかけている。開発者にとって、これは明確なシグナルを送っている:バッチ処理、非同期推論、コスト重視のタスクを行っているなら、オープンソースモデルはすでにほとんどの閉源 API 呼び出しを代替できる。

性能ベンチマーク

OpenRouter ランキング現状

| モデル | タイプ | 総合ランク | 得意分野 | 弱点 |

|---|---|---|---|---|

| GPT-5.5 | 閉源 | #1 | 指示追従、複雑な推論 | API 価格が高い |

| Claude 4 Opus | 閉源 | #2 | 長文脈、コード | API 価格が高い |

| Kimi K2.6 | オープンソース | #3-4 | 中国語理解、マルチターン対話 | 推論速度 |

| GLM 5.1 | オープンソース | #4-5 | ツール呼び出し、Agent | 推論速度 |

| DeepSeek V4 Preview | オープンソース | #5-6 | 数学、コード | 訓練中 |

| Gemini 2.5 Pro | 閉源 | #2-3 | マルチモーダル | 中国語シーンで一般的 |

重要なシグナル:Kimi K2.6 と GLM 5.1 は「閉源 AI の性能に非常に近い」——これは複数の開発者の共通認識である。

速度:オープンソースモデルの唯一のシステミックな弱点

| モデル | 平均初トークン遅延 | スループット (tokens/s) | 適したシナリオ |

|---|---|---|---|

| GPT-5.5 | ~500ms | 120-150 | リアルタイム対話 |

| Claude 4 | ~600ms | 100-130 | リアルタイム対話 |

| Kimi K2.6 (API) | ~800ms | 80-100 | 準リアルタイム |

| GLM 5.1 (API) | ~900ms | 70-90 | 準リアルタイム |

| ローカルデプロイ (A100) | ~300ms | 50-80 | バッチ処理 |

速度差は縮小している:Kimi/GLM のクラウド API バージョンの遅延は 800-900ms 範囲、A100 上のローカルデプロイは 300ms まで圧縮可能。非同期タスク(バッチ処理、データラベリング、コンテンツ生成)にとって、速度は全く問題ではない。

コスト比較:これが本当の駆動力だ

月 100 万 tokens 処理を基準に:

| ソリューション | 月コスト | 100万 tokens あたりコスト | 備考 |

|---|---|---|---|

| GPT-5.5 API | $15-25 | $15-25 | 入力+出力混合 |

| Claude 4 API | $20-30 | $20-30 | システムプロンプトのオーバーヘッド含む |

| Kimi K2.6 API | $2-5 | $2-5 | 国産 API の価格優位性 |

| GLM 5.1 API | $2-4 | $2-4 | コストパフォーマンス极高 |

| ローカルデプロイ(電気代) | $0.5-1 | ~$0.5 | ハードウェアコスト別 |

閉源 API のコストはオープンソースソリューションの 5〜15 倍である。性能差が 10% 以内に縮小したとき、コストが決定的要因となる。

どのシナリオが移行可能か?

| シナリオ | 移行可能性 | 推奨ソリューション | 注意事項 |

|---|---|---|---|

| バッチデータラベリング | ✅ 完全に可能 | Kimi K2.6 ローカルデプロイ | 速度に敏感でない |

| コンテンツ生成 | ✅ 完全に可能 | GLM 5.1 API | 中国語シーンで良好 |

| カスタマーサービス対話 | ⚠️ 部分的に可能 | Kimi K2.6 API | 遅延の評価が必要 |

| リアルタイム翻訳 | ⚠️ 部分的に可能 | 専用小モデル | 汎用モデルは遅延偏高 |

| コード生成 | ✅ 可能 | Kimi K2.6 + DeepSeek | オープンソースはコードシーンで良好 |

| 複雑な推論チェーン | ❌ 当面推奨しない | GPT-5.5 / Claude 4 | 閉源にまだ優位性 |

移行戦略

漸進的移行(推奨)

フェーズ1:重要でないタスクの移行

→ データクリーニング、バッチ要約、コンテンツドラフト

→ オープンソースモデルを使用、閉源モデルで品質スポットチェックを維持

フェーズ2:コアタスクのグレーリリース

→ カスタマーサービス、翻訳、コード生成

→ オープンソース vs 閉源の出力品質を A/B テスト

フェーズ3:必要に応じてフォールバック

→ 閉源 API をフォールバックとして維持

→ オープンソースモデルが品質要件を满足しない場合に自動切替ハイブリッドアーキテクチャの例

def smart_route(prompt, task_type):

if task_type in ["batch_label", "content_draft"]:

return kimi_client.generate(prompt) # 低コスト

elif task_type in ["complex_reasoning", "safety_critical"]:

return gpt_client.generate(prompt) # 高品質

else:

return glm_client.generate(prompt) # バランス型業界の判断

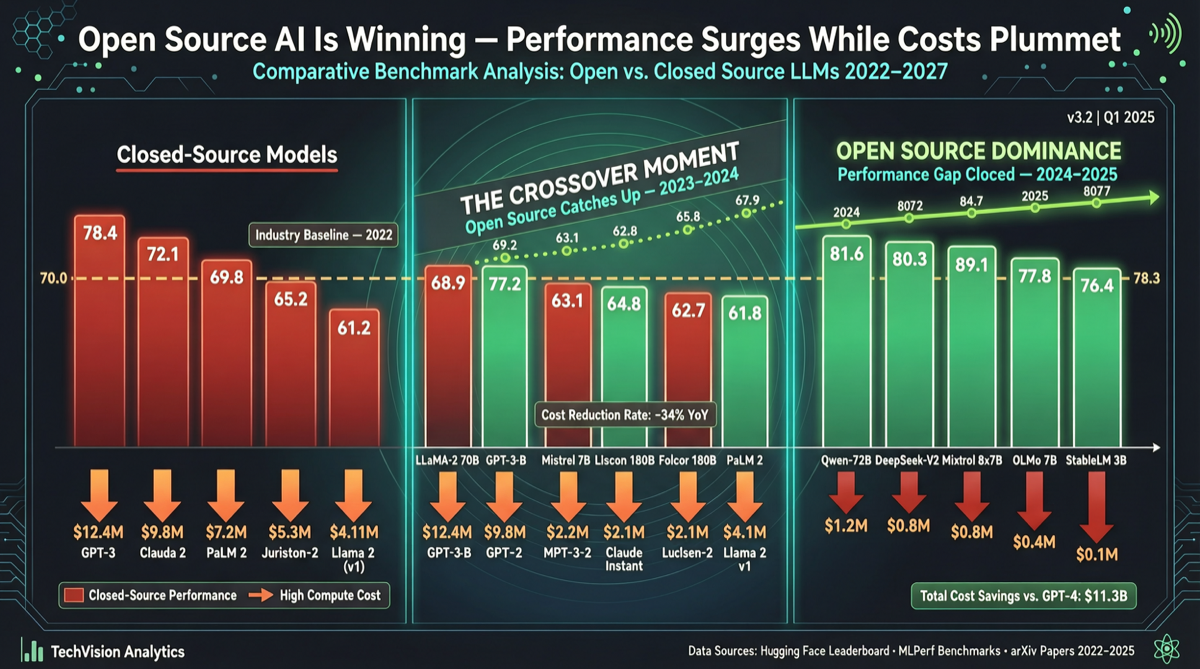

AI 業界は「クラウドコンピューティング時代」の再演を経験している:

- 初期:閉源 API が唯一の選択肢、価格は高いが性能が最高

- 現在:オープンソースモデルが性能で追いつき、価格差が顕著

- 未来:閉源 API が「最高端シーン」(リアルタイム対話、複雑な推論、マルチモーダル)に撤退、オープンソースモデルが「大批量シーン」を支配

これはゼロサムゲームではない。API ベンダーは値下げし、オープンソースモデルは速度を上げ、最終的にユーザーが恩恵を受ける。

アクションアイテム

- 今日:API 請求書を確認し、コストの 80% を占める使用シナリオを特定

- 今週:重要でない呼び出しの 20% を Kimi K2.6 または GLM 5.1 API に置き換え

- 今月:GPU リソースがある場合、ローカル推論サービスをデプロイしてコストをさらに削減

- 継続的:OpenRouter ランキングをフォローし、オープンソースモデルの性能変化を追跡

オープンソースモデルの性能差が「感知できない」レベルに縮小し、コスト差が「肉眼で見える」ままのとき、移行はもはや技術的な問題ではなく、ビジネス上の判断である。