核心的な結論

2026年のAI業界は静かだが深遠なアーキテクチャ変革を経験しています:「最高のモデルを1つ選ぶ」から「各タスクに最適なモデルを選ぶ」へ。

推進要因は単純です——モデルコストの暴落。GPT-5.5、Claude Sonnet 4.6、Qwen 3.6、DeepSeek V4、Gemini 3 Flashなどの主力モデルのAPI呼び出しコストは、2025年同期比で**40〜80%**低下しました。

コスト低下データ

| モデル | 2025 入力価格 ($/M tokens) | 2026 入力価格 ($/M tokens) | 低下率 |

|---|---|---|---|

| GPT-5.5 | $15.00 | $7.50 | 50% |

| Claude Sonnet 4.6 | $8.00 | $3.00 | 62.5% |

| Qwen 3.6 Max | $5.00 | $1.50 | 70% |

| DeepSeek V4 Pro | $3.00 | $0.60 | 80% |

| Gemini 3 Flash | $2.50 | $0.35 | 86% |

コストはもはやモデル選択の唯一の制約ではありません。つまり、複数のモデルを同時に呼び出しても、請求書をコントロール不能にすることはありません。

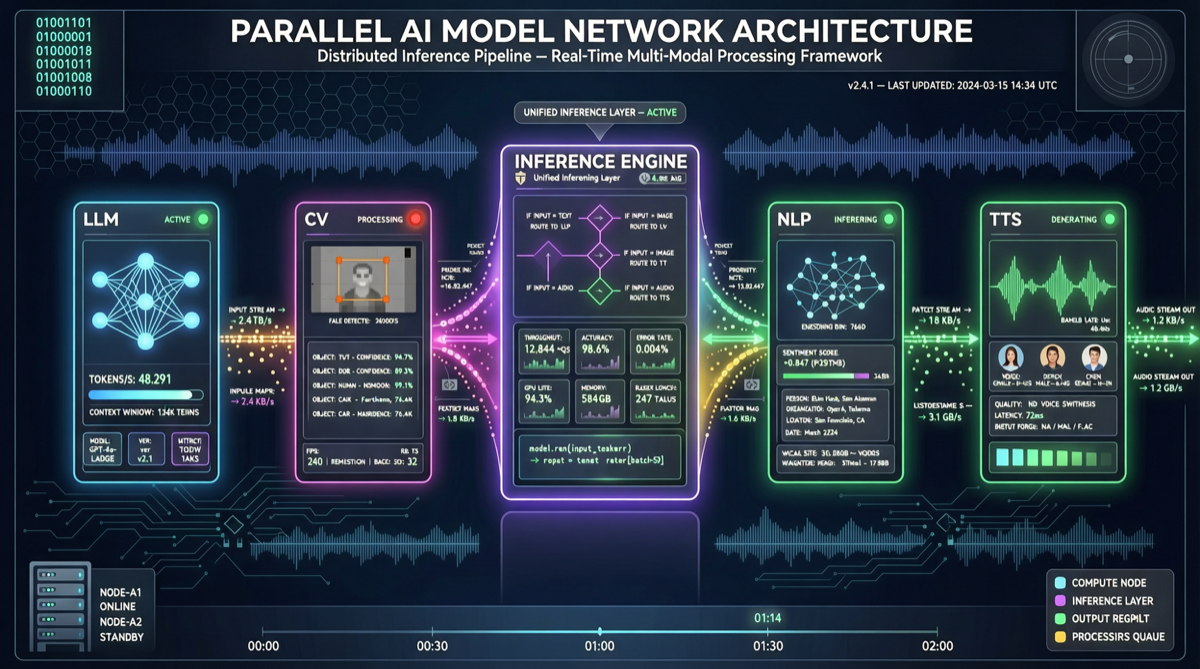

多モデル並列アーキテクチャ:2026年の標準プラクティス

ユーザーリクエスト

│

▼

┌─────────────┐

│ タスク │ ← 軽量モデル (Gemini Flash / Qwen 3.6B)

│ 分類器 │ コスト: $0.0003/回

│ (ルーター) │

└──────┬──────┘

│

┌────┼────┬──────────┐

▼ ▼ ▼ ▼

コーディング クリエイティブ データ分析 日常会話

│ │ │ │

▼ ▼ ▼ ▼

GPT-5.5 Claude Opus Qwen 3.6 Gemini

5.5 4.7 35B MoE Flash

$7.50 $15.00 $1.50 $0.35

/M /M /M /M重要な洞察:ルーター自体は超軽量モデルだけで済み(コストは無視可能)、タスクタイプを判断して、リクエストを最もコスト効率の高いモデルにルーティングします。

コスト比較:単一モデル vs 多モデルルーティング

1日10,000回の呼び出しを想定:

| アプローチ | モデル構成 | 日次コスト | 月次コスト |

|---|---|---|---|

| 純 Opus | すべて Opus 4.7 | $150 | $4,500 |

| 純 Sonnet | すべて Sonnet 4.6 | $30 | $900 |

| 多モデルルーティング | 80% Flash + 15% Sonnet + 5% Opus | $12 | $360 |

多モデルルーティングアプローチは純 Opus と比較して**92%**を節約し、複雑なタスクは依然として Opus によって処理されるため、全体的な品質の低下は5%未満に抑えられます。

ツールスタック

| ツール | 用途 | コスト |

|---|---|---|

| LiteLLM Proxy | 統一APIインターフェース + ルーティング | オープンソース、無料 |

| LangGraph | マルチエージェントオーケストレーション | オープンソース、無料 |

| MCP Server | ツール呼び出しの標準化 | オープンソース、無料 |

| PromptLayer | 呼び出し追跡 + コスト分析 | 無料ティア利用可能 |

スタート手順

- LiteLLM Proxy に接続:複数のモデルAPIを1つのエンドポイントに統一

- ルーティングルールを定義:タスクタイプ(コーディング/クリエイティブ/分析/会話)ごとにモデルを割り当て

- フォールバックを設定:メインモデルが失敗したときにバックアップモデルに自動切り替え

- コスト分布を監視:PromptLayer を使用して各モデルの呼び出し比率と費用を追跡

ビジネス判断:もしあなたのチームがまだ「すべてを1つのモデルで」使っているなら、今すぐ多モデルアーキテクチャへの移行を開始してください。2026年第2四半期以降、単一モデルアーキテクチャはコスト面で競争力を失います。