Ключевой вывод

Индустрия ИИ в 2026 году переживает тихую, но глубокую архитектурную трансформацию: от «выбрать лучшую модель» к «выбрать правильную модель для каждой задачи».

Движущий фактор прост — стоимость моделей резко упала. Стоимость вызовов API для таких основных моделей, как GPT-5.5, Claude Sonnet 4.6, Qwen 3.6, DeepSeek V4 и Gemini 3 Flash, снизилась на 40-80% по сравнению с тем же периодом 2025 года.

Данные о снижении стоимости

| Модель | Цена ввода 2025 ($/M токенов) | Цена ввода 2026 ($/M токенов) | Снижение |

|---|---|---|---|

| GPT-5.5 | $15,00 | $7,50 | 50% |

| Claude Sonnet 4.6 | $8,00 | $3,00 | 62,5% |

| Qwen 3.6 Max | $5,00 | $1,50 | 70% |

| DeepSeek V4 Pro | $3,00 | $0,60 | 80% |

| Gemini 3 Flash | $2,50 | $0,35 | 86% |

Стоимость больше не является единственным ограничением при выборе модели. Это означает, что вы можете вызывать несколько моделей одновременно, не выходя из-под контроля бюджета.

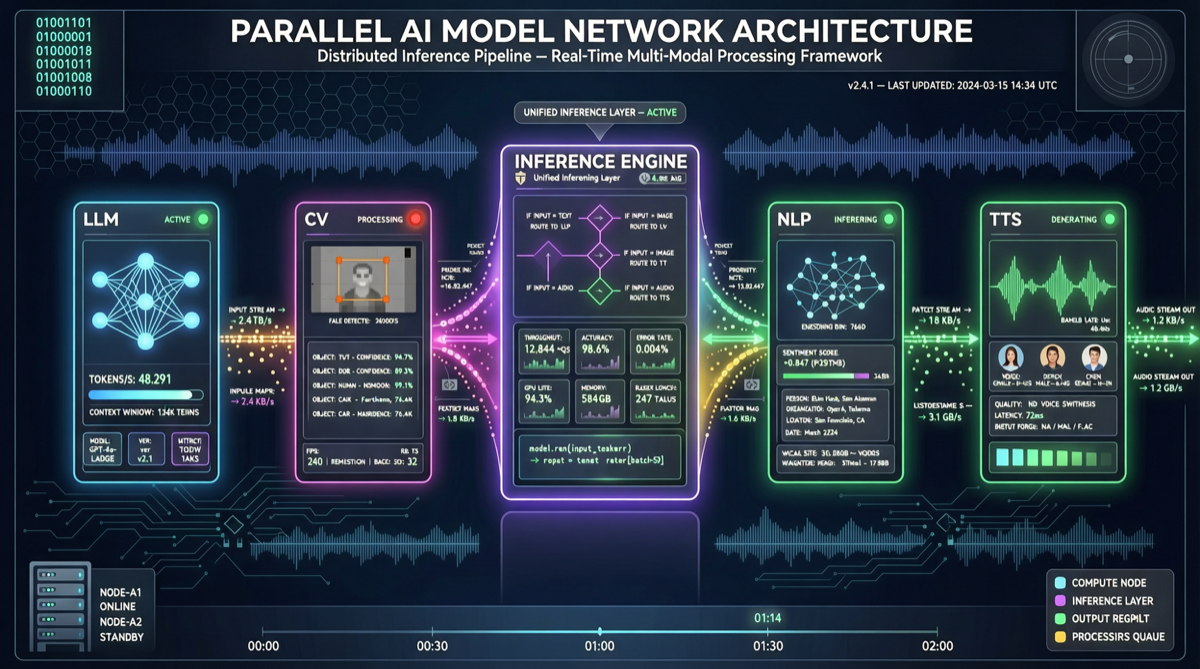

Мульти-модельная параллельная архитектура: стандартная практика 2026 года

Запрос пользователя

│

▼

┌─────────────┐

│ Классифи- │ ← Лёгкая модель (Gemini Flash / Qwen 3.6B)

│ катор задач│ Стоимость: $0,0003/вызов

│ (Маршрути- │

│ затор) │

└──────┬──────┘

│

┌────┼────┬──────────┐

▼ ▼ ▼ ▼

Код Творч. Анализ Повседн.

данных общение

│ │ │ │

▼ ▼ ▼ ▼

GPT-5.5 Claude Qwen 3.6 Gemini

5.5 Opus 35B MoE Flash

4.7 $15,00 $1,50 $0,35

$7,50 /M /M /M

/MКлючевое понимание: самому маршрутизатору нужна лишь сверхлёгкая модель (затраты ничтожны) — он определяет тип задачи и направляет запрос на наиболее экономически эффективную модель.

Сравнение затрат: одна модель vs мульти-модельная маршрутизация

На основе 10 000 вызовов в день:

| Подход | Конфигурация моделей | Стоимость в день | Стоимость в месяц |

|---|---|---|---|

| Чистый Opus | Всё на Opus 4.7 | $150 | $4 500 |

| Чистый Sonnet | Всё на Sonnet 4.6 | $30 | $900 |

| Мульти-модельная маршрутизация | 80% Flash + 15% Sonnet + 5% Opus | $12 | $360 |

Подход с мульти-модельной маршрутизацией экономит 92% по сравнению с чистым Opus, при этом общее качество снижается менее чем на 5%, поскольку сложные задачи по-прежнему обрабатываются Opus.

Набор инструментов

| Инструмент | Назначение | Стоимость |

|---|---|---|

| LiteLLM Proxy | Единый интерфейс API + маршрутизация | Открытый исходный код, бесплатно |

| LangGraph | Оркестрация мульти-агентов | Открытый исходный код, бесплатно |

| MCP Server | Стандартизация вызовов инструментов | Открытый исходный код, бесплатно |

| PromptLayer | Отслеживание вызовов + анализ затрат | Бесплатный уровень доступен |

Шаги для начала работы

- Подключите LiteLLM Proxy: объедините API нескольких моделей в одну конечную точку

- Определите правила маршрутизации: назначьте модели по типу задачи (кодирование/творчество/анализ/общение)

- Настройте резервирование: автоматически переключайтесь на резервные модели при отказе основной

- Мониторьте распределение затрат: используйте PromptLayer для отслеживания соотношения вызовов и расходов по каждой модели

Бизнес-оценка: если ваша команда всё ещё «использует одну модель для всего», начните миграцию на мульти-модельную архитектуру сейчас. После второго квартала 2026 года архитектура с одной моделью больше не будет конкурентоспособной по стоимости.