核心的結論

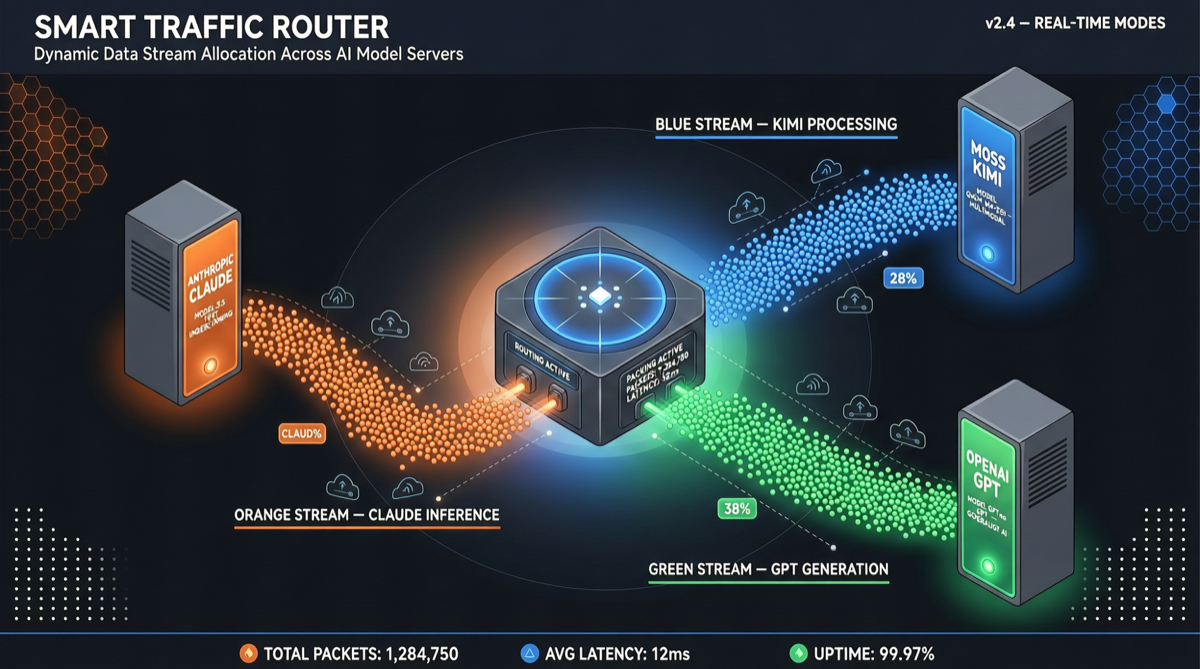

複数モデルルーティングはもはや理論ではない——すでに開発者が実際の生産環境でその実現可能性を検証している。異なるタスクを最も適したモデルにスマートにルーティングすることで、出力品質を維持しつつ月間APIコストが$500以上から$100未満に低下した。

これは「安いモデルで妥協する」ことではなく、**「タスクごとに正しいモデルを使う」**ことである:コードは Claude、長文書は Kimi、多段階推論は GPT——各タスクがコストパフォーマンス最优のモデルを見つける。

なぜルーターを作るのか?

単一モデルの罠

大多数の開発者のアプローチは「最強のモデルを1つ選んで、すべてのタスクに使う」である。これには3つの問題がある:

| 問題 | 表現 | 結果 |

|---|---|---|

| 過剰消費 | 簡単なテキスト分類に Opus 4.7 を使用 | 1倍の仕事に10倍のお金をかける |

| 能力のミスマッチ | コード生成に GPT-5.5 を使用 | 品質が Claude に劣る |

| 単一依存 | 1つのモデルのAPIのみ接続 | 障害発生で全线麻痺 |

ルーティングのコアロジック

タスク受信 → タイプ識別 → 能力ニーズ評価 → モデル選択 → 出力 → 品質チェック

↓(品質不达の場合)

強力なモデルにアップグレードして再試行実際のルーティング戦略

この開発者のルーティングルール

| タスクタイプ | 首选モデル | 代替モデル | 選択理由 |

|---|---|---|---|

| コード生成/デバッグ | Claude Opus 4.7 | GPT-5.5 | Claude のコード能力が現在领先 |

| 長文書分析 | Kimi K2.6 | DeepSeek V4-Pro | Kimi の長文脈理解能力が強い |

| 多段階推論/Agent | GPT-5.5 | Claude Opus 4.7 | GPT のツール呼び出しと計画能力が強い |

| 単純会話/翻訳 | Kimi K2.6(無料) | Qwen3.6-Plus | コスト最低の選択 |

| クリエイティブライティング | Claude Opus 4.7 | GPT-5.5 | Claude の文風がより自然 |

| データ分析 | DeepSeek V4-Pro | GPT-5.5 | 長文脈分析で最もコストパフォーマンスが良い |

コスト比較

月間 10,000 タスクを処理する場合:

| アプローチ | 月間コスト | 平均品質 |

|---|---|---|

| すべて Claude Opus 4.7 | ~$500 | 95/100 |

| すべて GPT-5.5 | ~$400 | 92/100 |

| 複数モデルルーティング | ~$85 | 94/100 |

重要な数字:ルーティングアプローチのコストは単一 Claude アプローチの 17% だが、品質はほぼ同等。節約の内訳:

- 40% のタスク(単純会話/翻訳)が無料/低価格モデルにルーティング

- 30% のタスク(長文書)がコストパフォーマンスの高い Kimi にルーティング

- 高価値タスクの 30% のみが Opus 4.7 を使用

自分のルーターの作り方

最小実行可能バージョン

class ModelRouter:

ROUTING_RULES = {

"code": {"primary": "claude-opus-4-7", "fallback": "gpt-5.5"},

"long_context": {"primary": "kimi-k2.6", "fallback": "deepseek-v4-pro"},

"reasoning": {"primary": "gpt-5.5", "fallback": "claude-opus-4-7"},

"simple": {"primary": "kimi-k2.6", "fallback": "qwen3.6-plus"},

}

def route(self, task_type: str, prompt: str, budget: str = "normal"):

rule = self.ROUTING_RULES.get(task_type, self.ROUTING_RULES["simple"])

model = rule["primary"] if budget == "normal" else rule["fallback"]

return self.call_model(model, prompt)上級:自動品質検出

def execute_with_fallback(self, task_type, prompt):

# まず首选モデルを試す

result = self.route(task_type, prompt)

# 品質チェック(単純な長さチェックまたは LLM 評価)

if not self.quality_check(result):

# 強力なモデルにフォールバック

fallback = self.ROUTING_RULES[task_type]["fallback"]

result = self.call_model(fallback, prompt)

return resultタスクタイプの自動識別

理想的なルーターは手動でタスクタイプを指定する必要がない——自動的に判断すべき:

import re

def detect_task_type(prompt: str) -> str:

code_patterns = [r'```', r'def ', r'function ', r'class ', r'import ']

if any(re.search(p, prompt) for p in code_patterns):

return "code"

if len(prompt) > 5000:

return "long_context"

reasoning_patterns = [r'分析', r'推理', r'比較', r'評価', r'なぜ']

if any(re.search(p, prompt) for p in reasoning_patterns):

return "reasoning"

return "simple"選択の提案

ルーティングを使うべき場面

- ✅ API 使用量が多い:月$200以上消費するチーム

- ✅ タスクタイプが多様:コード、コピー、分析が混合

- ✅ 品質に許容範囲がある:すべてのタスクが最优品質を必要としない

- ✅ エンジニアリング能力がある:ルーティングロジックとフォールバックメカニズムをメンテナンスできる

ルーティングを使うべきでない場面

- ❌ API 使用量が少ない:月$50以下、節約額が微々たるもの

- ❌ 品質要求が極端:医療、金融など品質変動を許容しないシナリオ

- ❌ コンプライアンス要求が厳しい:一部の業界ではデータが複数プロバイダーを流れることを許可しない

2026年のトレンド判断

複数モデルルーティングは「個人開発者の節約テクニック」から「企業の標準アーキテクチャ」へ進化している。モデル能力の格差が縮まるにつれ(Kimi K2.6 が GPT-5.5 に近づき、DeepSeek V4 が frontier モデルに迫る)、モデル選択のロジックは「誰が最強か」から「どのタスクに誰が最适合か」へ完全にシフトする。

次の進化方向:

- 自動化ルーティング:手動ルール不要——AI が自分でどのモデルを使うか判断

- 動的価格感知:ルーターが各モデルの API 価格変動をリアルタイムで読み取る

- 品質クローズドループ:各呼び出し後に品質を自動評価、ルーティング戦略を継続的に最適化