核心结论

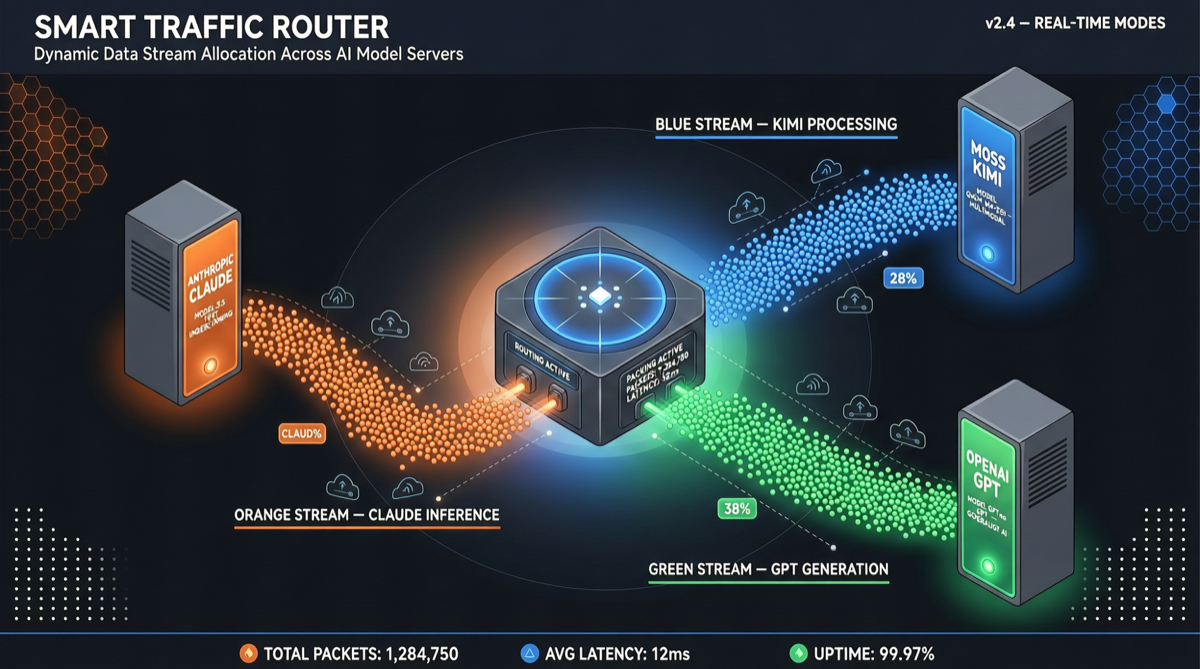

多模型路由不再是理论概念——已经有开发者在真实生产环境中验证了其可行性。通过智能路由策略,将不同任务分配给最适合的模型,在保持输出质量的同时,月度 API 成本从 $500+ 降至不到 $100。

这不是”用便宜模型凑合”,而是用对模型:写代码交给 Claude,长文档交给 Kimi,多步推理交给 GPT——每个任务都找到性价比最优的模型。

为什么要做路由?

单一模型的陷阱

大多数开发者的做法是”选一个最强的模型,所有任务都用它”。这有三个问题:

| 问题 | 表现 | 后果 |

|---|---|---|

| 过度消费 | 用 Opus 4.7 做简单的文本分类 | 花10倍的钱做1倍的事 |

| 能力错配 | 用 GPT-5.5 做代码生成 | 质量不如 Claude |

| 单一依赖 | 只接一个模型的 API | 宕机即全线瘫痪 |

路由的核心逻辑

任务进来 → 类型识别 → 能力需求评估 → 模型选择 → 输出 → 质量校验

↓(如果质量不达标)

升级到更强模型重试实际路由策略

这位开发者的路由规则

| 任务类型 | 首选模型 | 备选模型 | 选择理由 |

|---|---|---|---|

| 代码生成/Debug | Claude Opus 4.7 | GPT-5.5 | Claude 的代码能力目前领先 |

| 长文档分析 | Kimi K2.6 | DeepSeek V4-Pro | Kimi 的长上下文理解能力强 |

| 多步推理/Agent | GPT-5.5 | Claude Opus 4.7 | GPT 的工具调用和规划能力强 |

| 简单对话/翻译 | Kimi K2.6 (免费) | Qwen3.6-Plus | 成本最低的选择 |

| 创意写作 | Claude Opus 4.7 | GPT-5.5 | Claude 的文风更自然 |

| 数据分析 | DeepSeek V4-Pro | GPT-5.5 | 性价比最高的长上下文分析 |

成本对比

假设月度处理 10,000 个任务:

| 方案 | 月度成本 | 平均质量 |

|---|---|---|

| 全部用 Claude Opus 4.7 | ~$500 | 95/100 |

| 全部用 GPT-5.5 | ~$400 | 92/100 |

| 多模型路由方案 | ~$85 | 94/100 |

关键数字:路由方案的成本只有单一 Claude 方案的 17%,但质量几乎相同。节省下来的钱来自:

- 40% 的任务(简单对话/翻译)路由到了免费/低价模型

- 30% 的任务(长文档)路由到了性价比更高的 Kimi

- 只有 30% 的高价值任务使用了 Opus 4.7

如何搭建自己的路由器

最小可用版本

class ModelRouter:

ROUTING_RULES = {

"code": {"primary": "claude-opus-4-7", "fallback": "gpt-5.5"},

"long_context": {"primary": "kimi-k2.6", "fallback": "deepseek-v4-pro"},

"reasoning": {"primary": "gpt-5.5", "fallback": "claude-opus-4-7"},

"simple": {"primary": "kimi-k2.6", "fallback": "qwen3.6-plus"},

}

def route(self, task_type: str, prompt: str, budget: str = "normal"):

rule = self.ROUTING_RULES.get(task_type, self.ROUTING_RULES["simple"])

model = rule["primary"] if budget == "normal" else rule["fallback"]

return self.call_model(model, prompt)进阶:自动质量检测

def execute_with_fallback(self, task_type, prompt):

# 先尝试首选模型

result = self.route(task_type, prompt)

# 质量检测(可以是简单的长度检查,也可以是 LLM 评估)

if not self.quality_check(result):

# 回退到更强的模型

fallback = self.ROUTING_RULES[task_type]["fallback"]

result = self.call_model(fallback, prompt)

return result任务类型自动识别

最理想的路由器不需要手动指定任务类型——它应该自动判断:

import re

def detect_task_type(prompt: str) -> str:

code_patterns = [r'```', r'def ', r'function ', r'class ', r'import ']

if any(re.search(p, prompt) for p in code_patterns):

return "code"

if len(prompt) > 5000:

return "long_context"

reasoning_patterns = [r'分析', r'推理', r'比较', r'评估', r'为什么']

if any(re.search(p, prompt) for p in reasoning_patterns):

return "reasoning"

return "simple"选择建议

适合用路由的场景

- ✅ API 用量大:月消耗超过 $200 的团队

- ✅ 任务类型多样:代码、文案、分析混合使用

- ✅ 质量有波动容忍度:不是所有任务都需要最优质量

- ✅ 有工程能力:能维护路由逻辑和回退机制

不适合用路由的场景

- ❌ API 用量小:月消耗低于 $50,省不了多少钱

- ❌ 质量要求极端:医疗、金融等场景不允许任何质量波动

- ❌ 合规要求严格:某些行业不允许数据流经多个服务商

2026年趋势判断

多模型路由正在从”个人开发者的省钱技巧”变成”企业的标准架构”。随着模型能力差距缩小(Kimi K2.6 接近 GPT-5.5,DeepSeek V4 逼近前沿模型),选择模型的逻辑将从”谁最强”彻底转向”谁最适合这个任务”。

下一个阶段的演进方向:

- 自动化路由:不再手动写规则,让 AI 自己判断该用哪个模型

- 动态定价感知:路由器实时读取各模型的 API 价格变化

- 质量闭环:每次调用后自动评估质量,持续优化路由策略