コア結論

NVIDIAのNemotron 3 Nano Omniは別の「何でもできる」モデルではありません。エージェント知覚層のために特別に設計された軽量マルチモーダルモデルです。

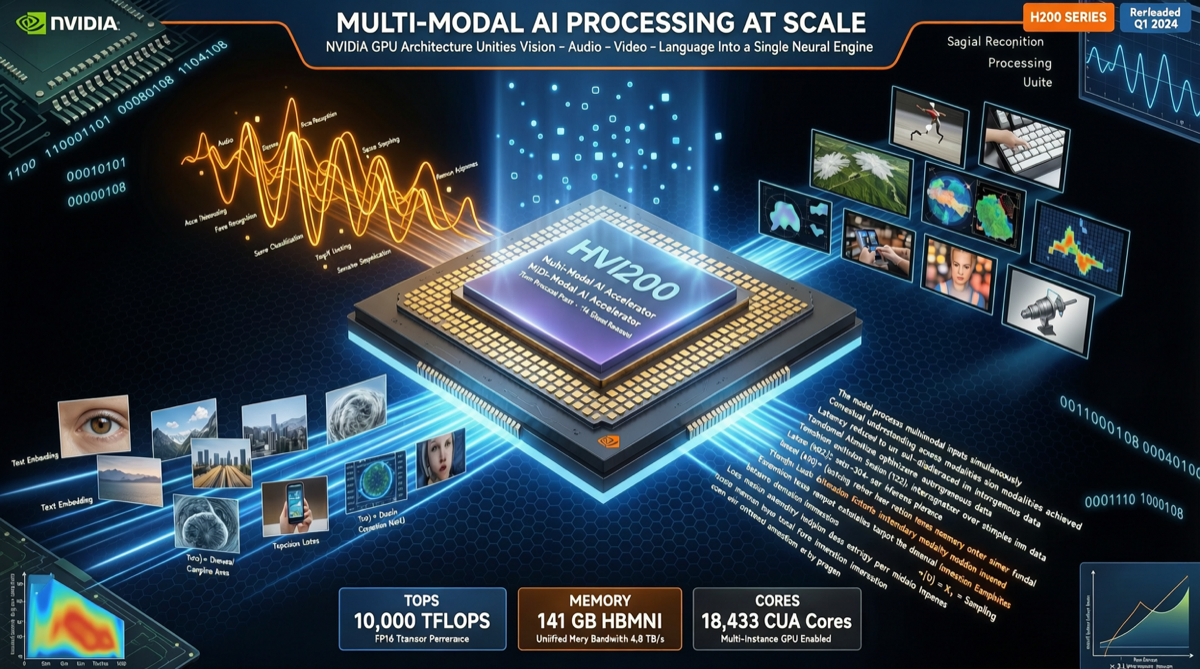

主要仕様:

- 30Bパラメータ、ハイブリッドMoEアーキテクチャ

- 画像 + 音声 + 動画 + テキスト 統一推論

- SGLang サポート済み、Canonical Ubuntu snap ワンコマンドデプロイ

- ポジショニング:エージェントの「目と耳」、汎用対話モデルではない

なぜ専用の知覚モデルが必要なのか

現在のエージェントシステムはアーキテクチャ的な問題に直面しています:

従来アプローチ: Nemotronアプローチ:

┌──────────┐ ┌──────────────────┐

│ 視覚モデル │──→ コンテキスト │ Nemotron Omni │

│ │ 断片化 │ 統一推論ループ │

├──────────┤ │ 画像+音声+動画 │

│ 音声モデル │──→ 高遅延 │ +テキスト │

├──────────┤ └──────────────────┘

│ テキスト │──→ コンテキスト ↓

│ モデル │ 切替オーバーヘッド 統一コンテキスト → エージェント

└──────────┘Nemotron 3 Nano Omniは1つのモデルでこれらの問題をすべて解決します。

使用方法

方法1:Ubuntu Snap(推奨)

# ワンコマンドデプロイ

sudo snap install nemotron-omni

# 推論サービス開始

nemotron-omni.startインストールから実行まで、複雑な依存関係管理、CUDA設定、Dockerオーケストレーションは不要です。

ユースケース

シナリオ1:マルチモーダルエージェント知覚 ユーザーが製品画像をアップロード → Nemotronが製品を識別 → エージェントが在庫を検索 → 見積もりを返す

シナリオ2:ビデオ会議分析 会議動画ストリーム → Nemotronが音声と映像をリアルタイム分析 → 議事録とアクションアイテムを生成

行動推奨事項

- エージェント開発者:エージェントがマルチモーダル入力を処理する場合、Nemotron 3 Nano Omniの評価を推奨

- 運用チーム:Ubuntu snapデプロイはマルチモーダルモデルの運用ハードルを大幅に低減

- コスト重視シナリオ:30B MoEはパフォーマンスとコストの間で良好なバランスを実現