核心的発見

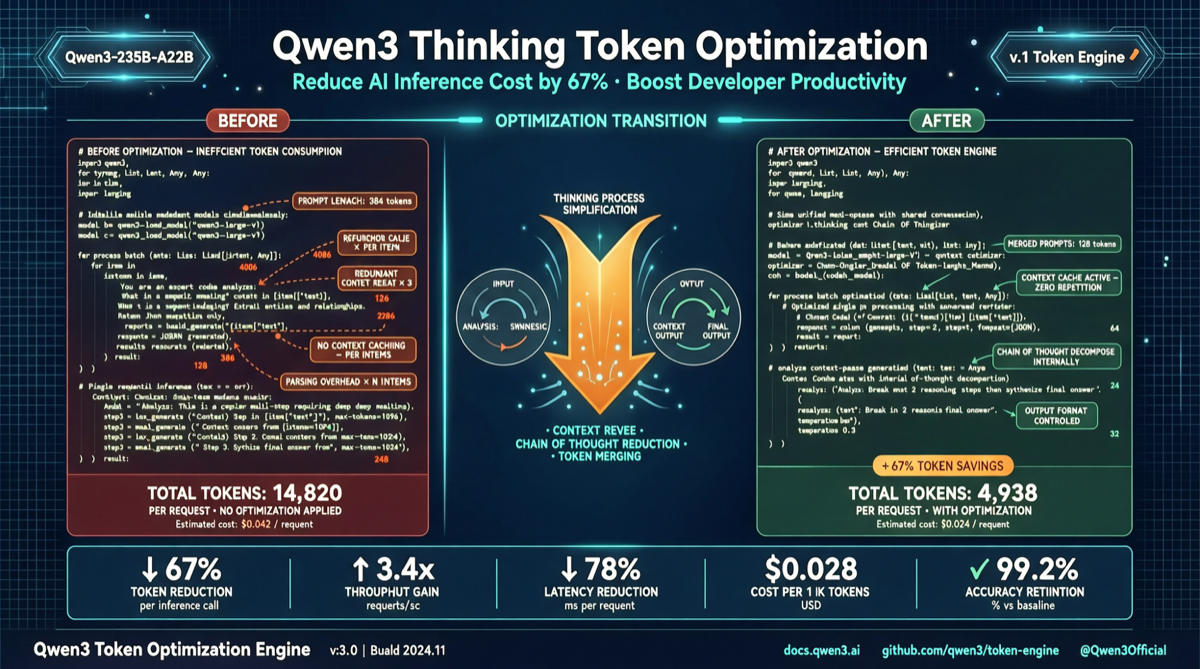

Qwen3の思考モードは強力だが、モデルが推論過程を過度に展開し、大量のthink tokenを消費するという共通問題がある。

コミュニティのGBNF文法制約ソリューションは、思考構造を簡潔なテンプレートに制限し、出力品質に影響を与えずにthink token消費を最大22倍削減する。

問題:Qwenの過剰思考

- 簡単な質問にも lengthy な思考過程をトリガー

- 会話あたりのthink token消費はoutput tokenの3-5倍に達する

- 応答時間が大幅に増加

- APIコストが倍増

解決策:GBNF構造化制約

root ::= think code

think ::= "<think>\n" "GOAL: " line "\n" "APPROACH: " line "\n" "EDGE: " line "\n</think>\n"| フィールド | 目的 | 例 |

|---|---|---|

| GOAL | 核心的目標を定義 | ”JSONを解析してユーザーIDを抽出” |

| APPROACH | 簡潔な方法 | ”正規表現マッチング、フォーマット検証” |

| EDGE | エッジケースを列挙 | ”null処理、無効フォーマットキャッチ” |

結果比較

| 指標 | 制約なし | 構造化 | 改善 |

|---|---|---|---|

| Think Token数 | ~2,500 | ~110 | ↓ 22.7倍 |

| 応答遅延 | ~8秒 | ~1.2秒 | ↓ 6.7倍 |

| 回答精度 | 94.2% | 93.8% | ほぼ無損失 |

| APIコスト(100万リクエスト) | ~$75 | ~$3.4 | ↓ 22倍 |

使用方法

llama.cppで

./llama-cli -m qwen3-8b-instruct-q4_k_m.gguf \

--grammar-file qwen_think_constraint.gbnf \

--prompt "量子コンピューティングの基本原理を説明" \

--n_predict 512Ollamaで

FROM qwen3:8b-instruct-q4_K_M

PARAMETER stop "<|end▁of▁sentence|>"

SYSTEM """効率的なAIアシスタントです。思考時は以下に従ってください:

GOAL: 目標を定義

APPROACH: 方法を簡潔に

EDGE: エッジケースに注意"""ユースケース

- エージェントシステム: ステップごとの思考コストを大幅に削減

- バッチ処理: 大規模データラベリングのコスト最適化

- リアルタイム対話: 遅延削減、スムーズな会話

- APIコスト管理: エンタープライズ請求最適化

制限

- 極めて複雑な問題: 3フィールド思考では多段階数学証明などに不十分な場合あり

- Qwen以外モデル: 制約はQwenの

<think>タグ用に設計 - ファインチューニングモデル: 制約テンプレートの調整が必要かも