Сводка

Модель GLM-5.1 от Zhipu AI официально вышла на платформу 0G Private Computer. Эта модель с архитектурой MoE на 754 миллиардов параметров лицензирована по соглашению MIT и работает в формате FP8 внутри TEE (Trusted Execution Environment — защищённая среда выполнения).

Это не просто ещё одно развёртывание модели — это первая глубокая интеграция между LLM с открытым кодом и инфраструктурой вычислений с сохранением конфиденциальности.

Техническое значение GLM-5.1 + Private Computer

Чтобы понять значимость этого события, нужно разобрать его на три уровня:

Уровень модели: флагманская спецификация 754B MoE. GLM-5.1 — одна из крупнейших моделей с открытым кодом по количеству параметров на сегодняшний день. Её архитектура MoE (Mixture of Experts — смесь экспертов) активирует лишь подмножество параметров во время вывода, но общий масштаб в 754B параметров всё равно означает чрезвычайно высокий барьер для развёртывания.

Уровень лицензии: открытая лицензия MIT. Лицензия MIT является наиболее разрешительной среди лицензий открытого кода, позволяя коммерческое использование, модификацию и распространение практически без ограничений. Это резко контрастирует с «ограниченной коммерческой лицензией» серии Llama или «только для исследований» у некоторых моделей. Флагманская модель на 754B параметров, использующая лицензию MIT, — чрезвычайно редкое явление в истории ИИ с открытым кодом.

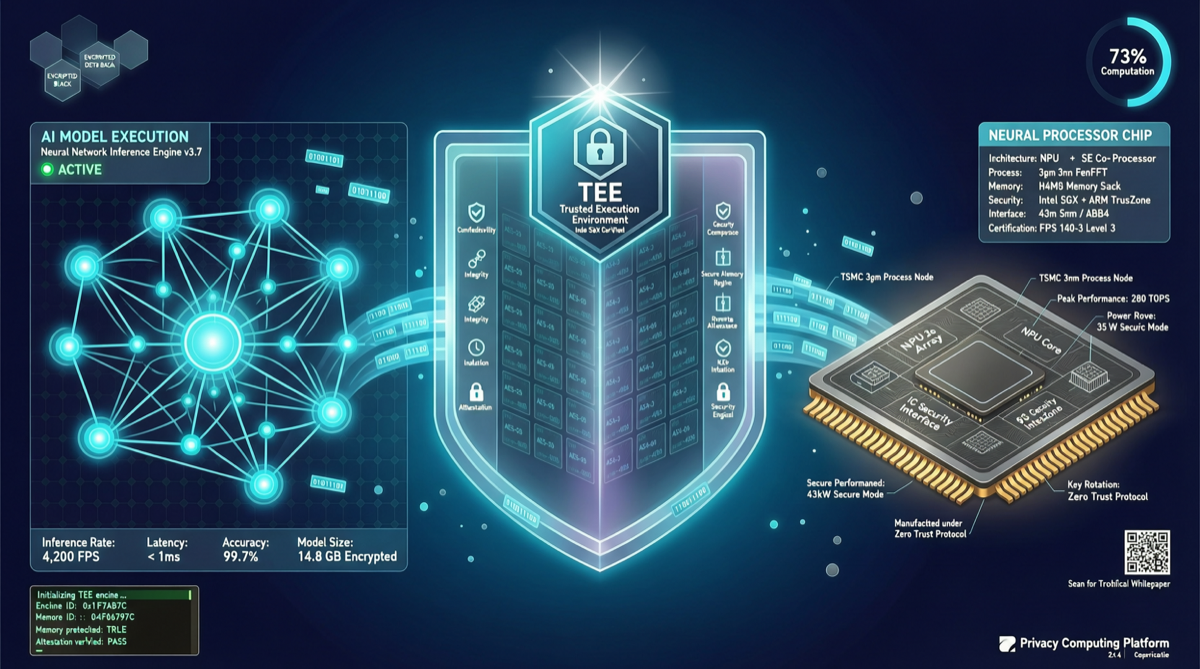

Уровень развёртывания: защищённая среда выполнения TEE. Это наиболее примечательный аспект. Традиционные облачные API полагаются на обещания провайдеров для защиты конфиденциальности данных — вы доверяете облачному провайдеру, что он не заглянет в ваши данные. TEE меняет модель доверия: гарантии шифрования на уровне оборудования обеспечивают невидимость процесса вывода для всех, включая операторов облака.

Почему эта комбинация является прорывом

Раньше модели с открытым кодом и вычисления с сохранением конфиденциальности шли параллельными путями:

- Дилемма моделей с открытым кодом: веса модели общедоступны, но развёртывание требует дорогих GPU-кластеров. Обычные разработчики и малый бизнес могут полагаться только на сторонние API, а API означает выход данных из-под вашего контроля.

- Дилемма вычислений с сохранением конфиденциальности: TEE обеспечивает защиту конфиденциальности на уровне оборудования, но работающие внутри модели преимущественно закрытые — пользователи не могут ни аудировать поведение модели, ни свободно её модифицировать.

GLM-5.1 на Private Computer одновременно решает обе проблемы:

- Лицензия MIT + веса с открытым кодом → каждый может аудировать, модифицировать и распространять модель

- Развёртывание в TEE → процесс вывода невидим для облачных операторов, с гарантиями конфиденциальности данных на уровне оборудования

Это означает: у вас есть среда вывода ИИ, которая одновременно полностью прозрачна и полностью приватна.

Сравнение с альтернативами

| Параметр | GLM-5.1 + 0G PC | Традиционный облачный API | Локальное развёртывание с открытым кодом |

|---|---|---|---|

| Прозрачность модели | MIT открытый код, полная аудируемость | Закрытый код, чёрный ящик | MIT открытый код, полная аудируемость |

| Конфиденциальность данных | Шифрование TEE на уровне оборудования | Зависит от обещаний провайдера | Полностью локально, высший уровень |

| Порог развёртывания | Средний (облачный TEE) | Низкий | Чрезвычайно высокий (требуется кластер H100/B200) |

| Стоимость | Оплата за вывод | Оплата за токены | Стоимость оборудования + эксплуатация |

| Управляемость модели | Можно форкнуть/модифицировать | Неконтролируема | Полностью контролируема |

Эта позиция очень точна — это не самое дешёвое решение и не самое приватное решение, но это единственное решение, обеспечивающее одновременно прозрачность модели и конфиденциальность данных.

Интерпретация сигналов

Это развёртывание отражает три структурные тенденции:

Путь «коммерциализации» моделей с открытым кодом сходится. От ограниченной лицензии Llama до Apache 2.0 у Qwen и теперь MIT-лицензии GLM-5.1 — условия лицензирования моделей с открытым кодом становятся всё более разрешительными. Это не благожелательность вендоров — это конкурентное давление. Когда DeepSeek предлагает почти флагманскую производительность по крайне низким ценам, закрытые вендоры должны конкурировать более открытыми лицензиями, чтобы завоевать разработчиков.

TEE переходит от «специализированной безопасности» к «универсальному ИИ». Ранее TEE использовался преимущественно для управления ключами шифрования, обработки платежей и других сценариев, чувствительных к безопасности. Запуск 754B AI-модели внутри TEE доказывает, что вычислительная мощность TEE теперь достаточна для поддержки передового ИИ-вывода.

Позиционирование 0G Labs: инфраструктурный уровень для вычислений с сохранением конфиденциальности ИИ. 0G Labs — это не компания-разработчик моделей и не компания-разработчик приложений. Private Computer — это инфраструктура для разработчиков — она предоставляет возможность «запускать любую модель с открытым кодом в зашифрованной среде». GLM-5.1 — просто первая флагманская модель, которая начала работу на платформе.

Рекомендации к действию

- Финансовая и медицинская отрасли: обратите внимание на модель развёртывания TEE. Для сценариев, требующих одновременно аудируемости модели и конфиденциальности данных, это на данный момент оптимальное решение.

- Сообщество открытого кода: лицензия MIT GLM-5.1 делает её идеальной базой для форков и вторичной разработки. В сочетании с API Private Computer можно быстро создавать кастомизированные приложения.

- Разработчики фреймворков агентов: необходимо переоценить задержку и стабильность вызовов моделей в средах TEE. Фреймворки вроде Hermes Agent и OpenClaw должны рассмотреть интеграцию Private Computer в качестве опционального бэкенда моделей.

Перекрёстная верификация

Zhipu ранее выпустила несколько вариантов GLM-5.1 (включая версии с открытыми весами и подписку Coding Plan), и данное сотрудничество с 0G Labs является продолжением её двухколесной стратегии «открытый код + коммерциализация». Тем временем глобальное регулирование конфиденциальности данных ИИ ужесточается (Закон ЕС об ИИ вступает в силу в августе 2026 года), что ещё больше усиливает преимущества соответствия модели развёртывания TEE.

Когда флагманская модель с открытым кодом на 754B параметров работает внутри защищённой среды выполнения, модель доверия ИИ-вывода переписывается. Это не оптимизация технической детали — это начало новой парадигмы.