Ключевые выводы

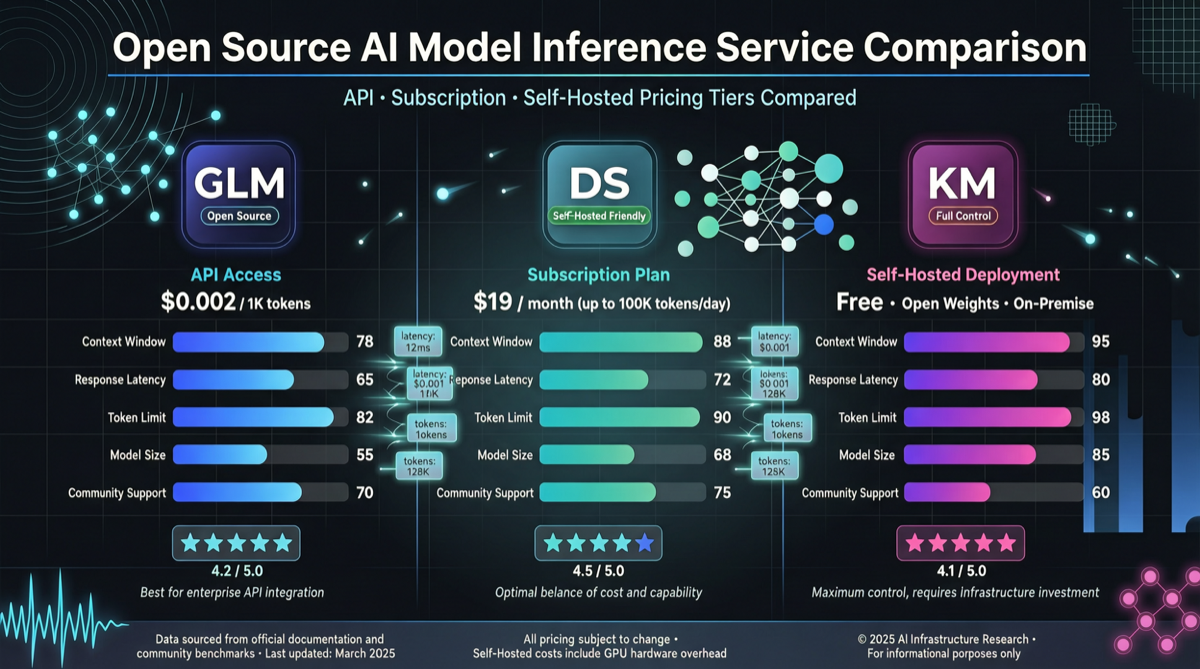

Когда GLM-5.1, DeepSeek V4 Pro и Kimi K2.6 могут удовлетворить базовые потребности Agent, выбор сервиса инференса становится ключевой переменной, определяющей стоимость и опыт.

Разработчик протестировал все три модели на официальном API, подписках вендоров и Ollama Cloud, и получил неожиданные результаты: для тяжёлых пользователей Agent Coding Plan Max от Zhipu ($80/мес) выдерживает 800 миллионов токенов в месяц, а DeepSeek V4 Pro с оплатой по факту обходится всего в ~$28 за тот же объём.

Два типичных сценария

| Сценарий | Месячный объём токенов | Типичный пользователь |

|---|---|---|

| Лёгкое использование | 100-200M токенов | Индивидуальные разработчики, ежедневная помощь в кодинге |

| Тяжёлый Agent | 500M-1B токенов | Корпоративные кластеры Agent, интеграция CI/CD |

GLM-5.1: Король стоимости подписки

Ценовая стратегия Zhipu агрессивна — Coding Plan Max за $80/мес с безлимитными вызовами. Для тяжёлых пользователей Agent это означает стоимость за миллион токенов ниже $0.01, что значительно дешевле конкурентов с оплатой по факту.

- Официальный API (pay-as-you-go): ~$1-2/миллион токенов, подходит для нестабильного использования

- Coding Plan Max: Фиксированные $80/мес, выдерживает 800M токенов тяжёлых Agent-нагрузок

- Самостоятельный хостинг (Ollama): Требует 2×A100 80GB, высокий порог по железу, но нулевые расходы на API

В плане приватности и подписки, и API требуют отправки данных на серверы Zhipu; самостоятельный хостинг полностью сохраняет данные внутри вашей сети.

DeepSeek V4 Pro: Абсолютно самая низкая цена pay-as-you-go

Ценовая стратегия DeepSeek V4 Pro проста и прямолинейна — никаких подписок, просто самая низкая цена за единицу.

- Официальный API: ~$3.50/миллион токенов, ~$28 за 800M токенов

- Нет подписки: В настоящее время нет месячного безлимитного плана

- Самостоятельный хостинг: Огромный размер модели (триллионный MoE), требует 8×H100 для полной производительности

Преимущество DeepSeek — абсолютно самая низкая цена за единицу. Минус — нет защиты бюджета для тяжёлых пользователей: удвоение использования означает удвоение расходов. А самостоятельный хостинг имеет крайне высокий порог по железу, что фактически исключает возможность self-hosting для малых и средних команд.

Kimi K2.6: Незаменим для сценариев с длинным контекстом

Ключевая конкурентоспособность Kimi K2.6 — не цена, а ультра-длинный контекст. Официальная поддержка окон контекста в миллион токенов делает его практически незаменимым для анализа юридических документов, полного понимания кодовой базы и подобных сценариев.

- Официальный API: Цена находится между GLM и DeepSeek

- Специализация на длинном тексте: Дополнительная оптимизация для определённых сценариев

- Пока не open-source: Невозможно self-host; только официальный API

Сравнение скорости

В тестах разница в задержке первого токена (TTFT) между тремя моделями незначительна:

| Модель | TTFT (медиана) | Скорость генерации |

|---|---|---|

| GLM-5.1 | 200-400мс | 80-120 tok/s |

| DeepSeek V4 Pro | 300-500мс | 60-100 tok/s |

| Kimi K2.6 | 250-450мс | 70-110 tok/s |

В реальных Agent-сценариях bottleneck обычно находится в цепочке вызова инструментов, а не в самом инференсе модели.

Матрица решений

| Ваша ситуация | Рекомендация |

|---|---|

| Тяжёлый пользователь Agent, нужны предсказуемые расходы | GLM-5.1 Coding Plan Max |

| Нестабильное использование, нужна минимальная цена | DeepSeek V4 Pro pay-as-you-go |

| Нужна обработка ультра-длинного контекста | Kimi K2.6 |

| Данные должны оставаться локальными | GLM-5.1 self-hosted (требует GPU) |

| Ограниченный бюджет, не хотите управлять инфраструктурой | DeepSeek V4 Pro API |

Тренд

Рынок инференса моделей в 2026 году разделяется: ценовая война pay-as-you-go на базовом уровне (DeepSeek опускает дно) и подписочная упаковка на уровне приложений (Zhipu блокирует тяжёлых пользователей за $80/мес) происходят одновременно.

Для разработчиков хорошая новость — выбор больше, чем когда-либо; плохая — выбор становится сложнее. Вы больше не просто выбираете модель, вы выбираете бизнес-модель сервиса инференса.