Open Source больше не просто «дешёвый» — он начинает побеждать

Долгое время ярлык «модели с открытым исходным кодом» всегда связывался с «экономичностью» и «альтернативой». Но в первую неделю мая 2026 года этот нарратив полностью переворачивается.

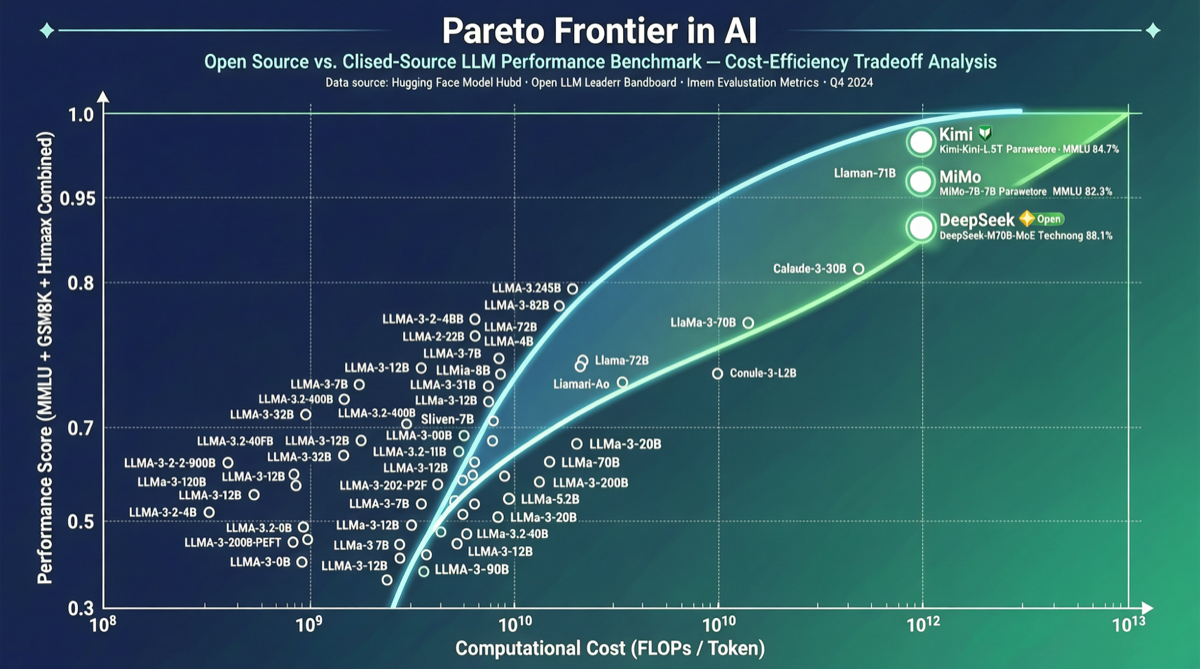

Последние данные от Artificial Analysis показывают: на границе Парето Intelligence vs Price 9 из 13 позиций заняты моделями с открытыми весами. Более того, эта граница Парето не доминируется одной компанией — она коллективно удерживается китайским open-source сообществом.

Текущая панорама границы Парето

| Модель | Организация | Индекс интеллекта | Тип | GDPval-AA |

|---|---|---|---|---|

| GPT-5.5 | OpenAI | 60 | Закрытая | - |

| Gemini / Claude | Google/Anthropic | 57 | Закрытая | - |

| Kimi K2.6 | Moonshot | 54 | Открытые веса | 1484 |

| MiMo V2.5 Pro | Xiaomi | 54 | Открытые веса | 1578 |

| DeepSeek V4 Pro | DeepSeek | 52 | Открытые веса | 1554 |

| GLM-5.1 | Zhipu | ~50 | Открытые веса | 1535 |

| MiniMax M2.7 | MiniMax | ~49 | Открытые веса | 1514 |

Ключевые наблюдения:

- Kimi K2.6 и MiMo V2.5 Pro делят 54 балла — потолок для моделей с открытыми весами

- Обе превышают некоторые закрытые модели по GDPval-AA (реальные Agent-задачи)

- DeepSeek V4 Pro следует вплотную с 52 баллами, при этом API-цены — доля от GPT-5.5

Взрывной скачок за одну неделю

Этот твит резюмирует изменение ландшафта за прошлую неделю:

Open Weights Capabilities have Exploded in the Last Week!

Kimi K2.6 & MiMo V2.5 Pro: 54 (1T MoE, up to 1M ctx) DeepSeek V4 Pro: 52 (1.6T/49B) GPT-5.5: 60 Gemini/Claude: 57

Всего за одну неделю три китайские open-source модели одновременно ворвались в топ-10 Индекса интеллекта — немыслимое год назад.

Что это значит

1. Открытые веса пересекли порог «достаточно хороши»

Когда open модели достигают 90%+ от закрытых моделей по Индексу интеллекта (54 против 60), стоя при этом в 10 раз дешевле, «премия за закрытый исходный код» становится всё труднее обосновать.

2. Китайские модели сформировали open-source матрицу

Не точечный прорыв, а матричное окружение:

| Измерение | Лидер | Преимущество |

|---|---|---|

| Общий интеллект | Kimi K2.6 / MiMo V2.5 Pro | Делят #54 |

| Agent-способности | MiMo V2.5 Pro | GDPval-AA 1578 |

| Длина контекста | DeepSeek V4 Pro | 1M+ context |

| Способность к кодингу | GLM-5.1 | SWE-Bench 94-95% уровня Opus |

| Цена | DeepSeek V4 Pro | Активна скидка 75% |

Рекомендации к действию

Для технических руководителей, выбирающих модели:

- Если бюджет ограничен: DeepSeek V4 Pro (скидка 75% до 31 мая) — самый экономичный выбор прямо сейчас

- Если нужны Agent-способности: MiMo V2.5 Pro лидирует по GDPval-AA, лицензия MIT для unrestricted коммерческого использования

- Если нужен длинный контекст: Kimi K2.6 и MiMo V2.5 Pro поддерживают до 1M context

- Если нужны самые передовые capabilities: закрытые модели (GPT-5.5, Claude 5) всё ещё имеют преимущество в 5-6 баллов по интеллекту

Модели с открытыми весами больше не «приемлемый вариант» — на границе Парето они становятся «первым выбором».