Основной вывод

В трендовом списке GitHub «Научитесь создавать AI-агентов за 90 дней» Pipecat указан как первый рекомендуемый проект — «обеспечивает работу большинства производственных голосовых агентов, которые вы действительно использовали».

Ключевые преимущества:

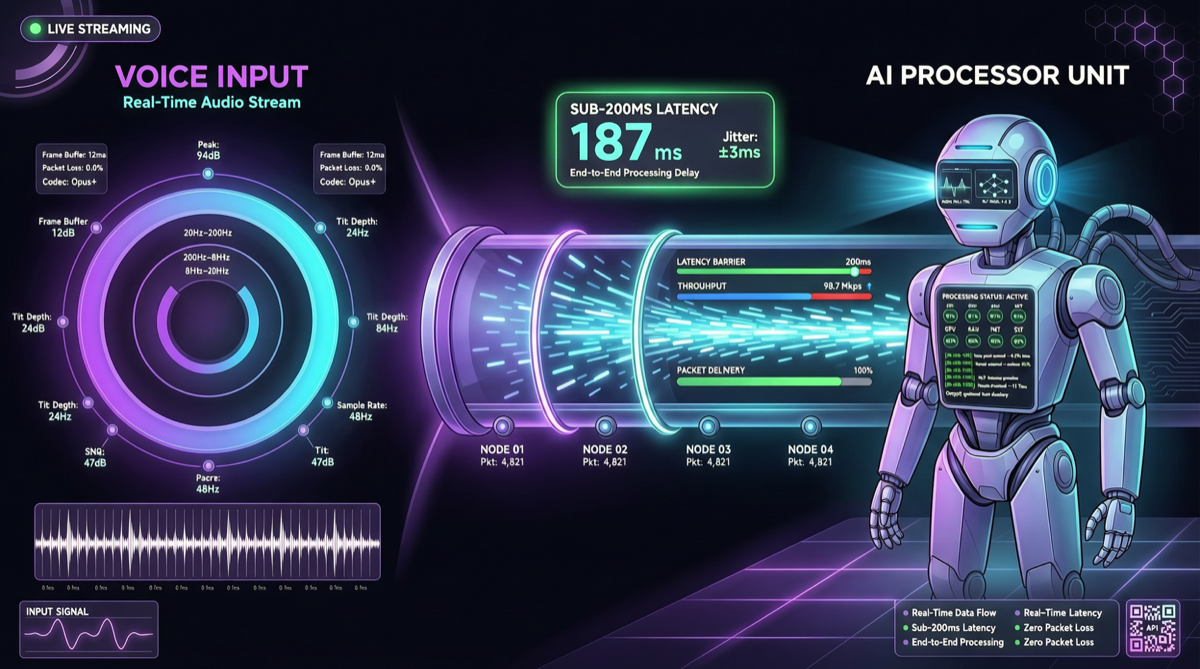

- Задержка менее 200 мс от конца до конца: Полная цепочка от речи пользователя до ответа AI укладывается в 200 мс

- Производственный уровень: Не демо, а фреймворк, разработанный для реального развёртывания

- Нативный Python: Удобство для Python-разработчиков

- Мультимодальный конвейер: Поддержка потоковых конвейеров обработки для голоса, текста и изображений

Что такое Pipecat

Pipecat — это фреймворк голосового AI реального времени, ориентированный на создание голосовых агентов с низкой задержкой. Его основная архитектура — это система «конвейера» (pipeline), которая соединяет ввод речи → распознавание речи → вывод LLM → синтез речи → вывод речи в единую потоковую цепочку обработки.

Обзор архитектуры

Речь пользователя → VAD (обнаружение голосовой активности) → STT (речь в текст) → LLM → TTS (текст в речь) → Пользователь слышит

↑ ↓

└──────────────────────── Потоковая обработка ─────────────────────────────────────────────┘Ключевые проектные решения:

- Потоковая обработка всей цепочки: Каждый этап обрабатывается в реальном времени, не нужно ждать полного завершения предыдущего этапа

- Управление через VAD: Активирует последующую обработку только при обнаружении речи пользователя, экономя вычислительные ресурсы

- Агностичность к моделям: Этапы STT, LLM и TTS могут независимо выбирать разных провайдеров

Основные компоненты

| Компонент | Функция | Поддерживаемые провайдеры |

|---|---|---|

| VAD | Определяет, когда пользователь говорит | Silero, WebRTC |

| STT | Речь в текст | Whisper, Deepgram, Google STT |

| LLM | Рассуждения в диалоге | OpenAI, Anthropic, Groq, локальные модели |

| TTS | Текст в речь | ElevenLabs, Cartesia, OpenAI TTS, Coqui |

| Transport | Транспортный протокол | WebSocket, Daily.co, LiveKit |

Сравнение с конкурентами

| Фреймворк | Язык | Задержка | Голос реального времени | Производственная готовность | Кривая обучения |

|---|---|---|---|---|---|

| Pipecat | Python | <200 мс | ✅ Основная специализация | ✅ | Средняя |

| LiveKit Agents | Python/JS | <300 мс | ✅ | ✅ | Низкая |

| Vocode | Python | <400 мс | ✅ | ✅ | Низкая |

| Twilio Autopilot | - | >500 мс | Ограниченно | ✅ | Низкая |

| LangChain Voice | Python | >500 мс | ✅ (плагин) | Экспериментальный | Высокая |

Преимущество Pipecat заключается в контроле задержки и гибкости конвейера. Задержка <200 мс означает, что опыт разговора приближается к реальному человеческому общению (средняя задержка ответа в человеческой беседе составляет около 200-300 мс).

Быстрый запуск

Установка

pip install pipecat-aiМинимальный пример

from pipecat.pipeline.pipeline import Pipeline

from pipecat.pipeline.runner import PipelineRunner

from pipecat.services.openai import OpenAILLMService

from pipecat.transports.services.daily import DailyTransport

# Настройка транспортного уровня (используем Daily.co)

transport = DailyTransport(

room_url="https://your-room.daily.co",

token="your-token",

bot_name="Pipecat Bot"

)

# Настройка LLM

llm = OpenAILLMService(model="gpt-5.4", api_key="your-key")

# Построение конвейера

pipeline = Pipeline([

transport.input(), # Получение аудио

llm, # Вывод LLM

transport.output() # Отправка аудио-ответа

])

# Запуск

runner = PipelineRunner()

await runner.run(pipeline)Пользовательский STT + TTS

from pipecat.services.deepgram import DeepgramSTTService

from pipecat.services.elevenlabs import ElevenLabsTTSService

stt = DeepgramSTTService(api_key="dg-key")

tts = ElevenLabsTTSService(api_key="11labs-key", voice_id="Rachel")

pipeline = Pipeline([

transport.input(),

stt, # Речь в текст

llm, # Рассуждения в диалоге

tts, # Текст в речь

transport.output()

])Типичные сценарии использования

| Сценарий | Рекомендация по конфигурации | Оценочная задержка |

|---|---|---|

| Бот обслуживания клиентов | GPT-5.4 + ElevenLabs | ~150 мс |

| Языковой компаньон | Локальная модель + Coqui TTS | ~180 мс |

| Голосовой помощник | Groq + Cartesia TTS | ~120 мс |

| Резюме совещания | Deepgram STT + Claude | Н/Д (не реальное время) |

Оценка стоимости

Для голосового агента с 1 000 звонков в день, средним 5 минут каждый:

| Компонент | Провайдер | Месячная стоимость (оценка) |

|---|---|---|

| STT | Deepgram | ~$150 |

| LLM | GPT-5.4 | ~$500 |

| TTS | ElevenLabs | ~$200 |

| Transport | Daily.co | ~$100 |

| Итого | ~$950/месяц |

При использовании DeepSeek V4 Pro (цена со скидкой) вместо GPT-5.4 затраты на LLM можно снизить примерно на 90%, что доведёт общую стоимость до ~$500/месяц.

Рекомендации к действию

- Разработчики голосовых агентов: Если вы создаёте приложения для голосовых диалогов в реальном времени, Pipecat в настоящее время является наиболее зрелым вариантом в экосистеме Python.

- Существующие пользователи LangChain: Концепция конвейера Pipecat отличается от LangChain — он разработан для потоковых сценариев реального времени. Если вашему приложению требуется голосовое взаимодействие с низкой задержкой, рассмотрите возможность миграции.

- Контроль затрат: Затраты на STT и TTS часто недооцениваются. Составьте оценки использования на ранних этапах проекта. Deepgram и Cartesia предлагают хорошее соотношение цены и качества, заслуживающее внимания.

- Локальное развёртывание: В сочетании с Whisper.cpp (STT) и Coqui TTS (синтез речи) Pipecat может работать полностью локально, что подходит для сценариев с высокими требованиями к конфиденциальности данных.