Ключевой вывод

Команда Qwen подтвердила в социальных сетях: порог в 27 миллиардов параметров преодолён, следующая цель — модель 8B для периферийных устройств.

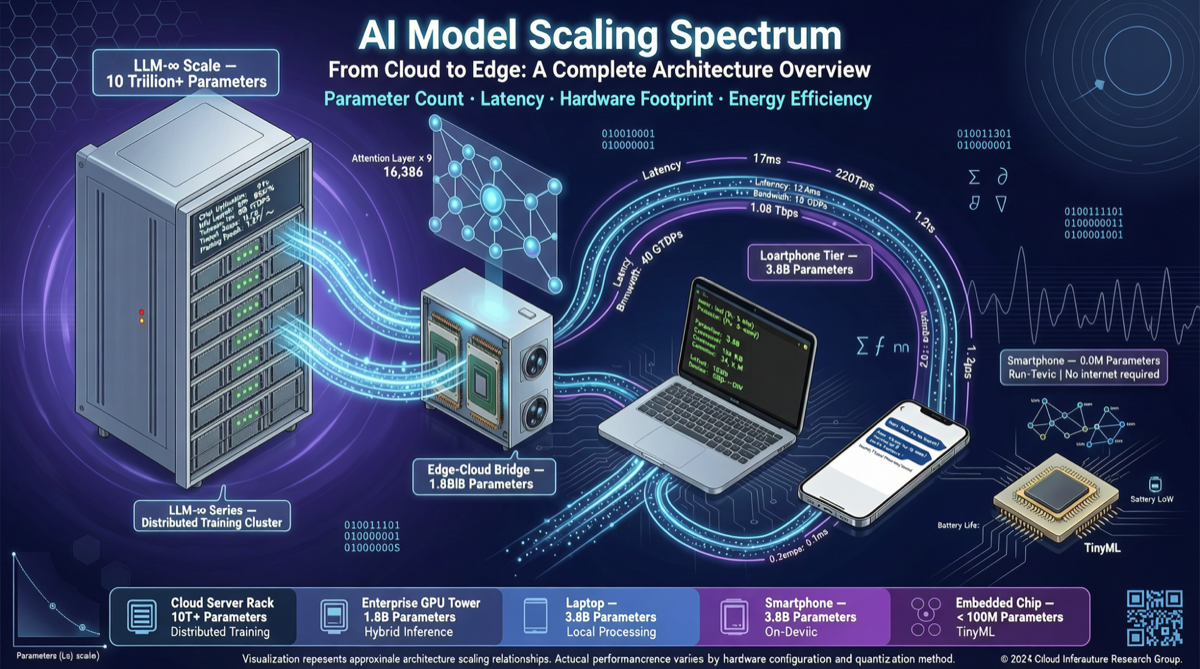

Это не просто изменение числа. В сочетании с уже опубликованной линейкой Qwen 3.6 — 35B MoE, 3.6B малая модель и Max Preview сверхбольшая модель — Alibaba создаёт полномасштабную матрицу моделей с открытым исходным кодом от облачных мегамоделей до периферийных моделей потребительского уровня.

Дорожная карта масштабирования: четырёхуровневая архитектура Qwen 3.6

| Спецификация модели | Параметры | Позиционирование | Целевой сценарий |

|---|---|---|---|

| Qwen 3.6 Max Preview | Сверхбольшая (не раскрыта) | Флагманская API-модель | Сложное рассуждение, корпоративные задачи |

| Qwen 3.6 35B MoE | 35B всего / 3.6B активных | Эффективная архитектура MoE | Развёртывание среднего уровня, чувствительные к стоимости сценарии |

| Qwen 3.6 27B | 27B плотная | Баланс производительности и эффективности | Развёртывание на одной GPU 4090/5090 |

| Qwen 3.6 8B (цель) | 8B плотная | Лёгкая периферийная модель | Локальный вывод на ноутбуках/мобильных устройствах |

| Qwen 3.6 3.6B | 3.6B | Ультралёгкая | Периферийные устройства, IoT |

Логика ясна: использовать 27B для установления эталона производительности, затем использовать 8B для масштабирования вниз.

Почему 8B — следующий ключевой узел?

Размер 8B параметров имеет особое значение в 2026 году:

- Полное покрытие потребительских GPU: RTX 4060/4070 (8-12 ГБ видеопамяти) могут полностью загружать квантованные INT4 модели 8B

- Нативное выполнение на Apple Silicon: M4 MacBook (16 ГБ унифицированной памяти) может плавно выполнять вывод модели 8B

- Мобильное развёртывание возможно: 8B INT4 квантование занимает около 4-5 ГБ, помещается в память флагманских смартфонов

- Оптимальный получатель дистилляции знаний: конвейер дистилляции 27B → 8B зрелый, потеря производительности контролируется в пределах 10%

Сравнительный анализ: стратегия открытого исходного кода Qwen vs Llama

| Параметр | Qwen 3.6 | Llama 4 (Meta) |

|---|---|---|

| Наибольшая открытая модель | 35B MoE | 405B плотная |

| Периферийная цель | 8B | 3B / 8B |

| Поддержка MoE | 35B/3.6B | Да |

| Оптимизация китайского языка | Нативная | Требуется дообучение |

| Коммерческая лицензия | Разрешительная | Разрешительная |

| Цепочка инструментов экосистемы | ModelScope + vLLM | Ollama + LM Studio |

Стратегия Qwen более прагматична, чем у Llama — не погоня за наибольшим количеством параметров, а стремление к наиболее широкому покрытию сценариев развёртывания. Это лучше соответствует реальным потребностям китайских разработчиков: не у всех есть H100, но у многих есть 4090 или даже более слабые GPU.

Рекомендации к действию

- Если вы оцениваете Qwen 3.6: следите за графиком выпуска версии 8B — это будет ключевой узел для развёртывания потребительского уровня

- Если вы создаёте продукты для периферийного ИИ: квантованная INT4 версия Qwen 3.6 8B будет одним из наиболее экономически эффективных вариантов

- Если вы используете Llama для периферии: преимущество производительности Qwen 3.6 8B в китайскоязычных сценариях стоит включить в A/B-тестирование

«От 27B к 8B» от Qwen — это не уменьшение, а измерительный удар: использование меньшего масштаба параметров и более низкого порога развёртывания для охвата более широкого спектра случаев использования.