情报摘要

智谱 AI 的 GLM-5.1 模型已正式上线 0G Private Computer 平台。这款 754B 参数的 MoE 架构模型以 MIT 开源协议授权,在 TEE(可信执行环境)中以 FP8 格式运行。

这不仅仅是一次模型部署——它标志着开源大模型与隐私计算基础设施的首次深度融合。

GLM-5.1 + Private Computer 的技术含义

要理解这件事的分量,需要拆解三个层面:

模型层面:754B MoE 的旗舰规格。GLM-5.1 是目前参数量最大的开源模型之一。MoE(Mixture of Experts)架构使其在推理时仅激活部分参数,但 754B 的总参数规模仍然意味着极高的部署门槛。

协议层面:MIT 开源授权。MIT 协议是开源协议中最宽松的一种,允许商业使用、修改和分发,几乎没有任何限制。这与 Llama 系列的”有限商业许可”或某些模型的”研究专用”形成鲜明对比。一个 754B 的旗舰模型采用 MIT 协议,这在开源 AI 史上极为罕见。

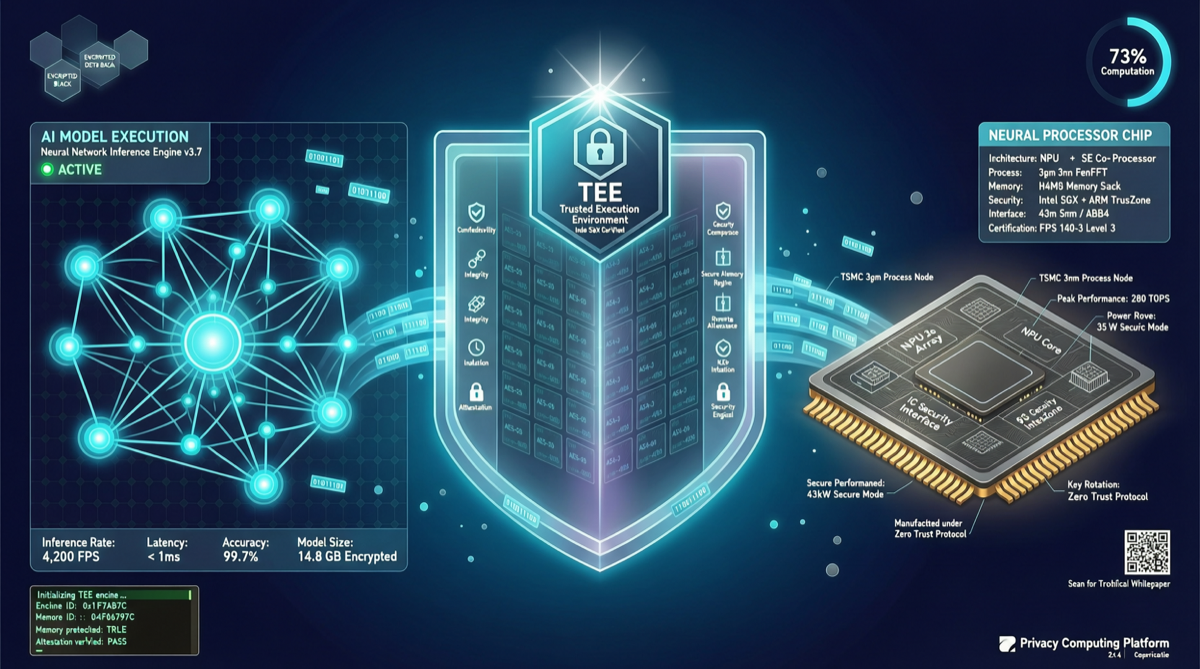

部署层面:TEE 可信执行环境。这是最值得关注的部分。Traditional cloud API 依赖服务商的承诺来保护数据隐私——你相信云厂商不会偷看你的数据。TEE 改变了信任模型:硬件级别的加密保证了推理过程对包括云运营商在内的所有人不可见。

为什么这个组合是破局的?

过去,开源模型和隐私计算是两条平行线:

- 开源模型的困境:模型权重公开,但部署需要昂贵的 GPU 集群。普通开发者和中小企业只能依赖第三方 API,而 API 意味着数据出境。

- 隐私计算的困境:TEE 提供了硬件级隐私保护,但上面跑的多是闭源模型,用户既不能审计模型行为,也无法自由修改。

GLM-5.1 on Private Computer 同时解决了两个问题:

- MIT 协议 + 开源权重 → 任何人都可以审计、修改、分发模型

- TEE 部署 → 推理过程对云运营商不可见,数据隐私有硬件级保障

这意味着:你拥有了一个既完全透明又完全私有的 AI 推理环境。

与竞品的对比

| 维度 | GLM-5.1 + 0G PC | 传统云 API | 本地部署开源模型 |

|---|---|---|---|

| 模型透明度 | MIT 开源,完全可审计 | 闭源,黑箱 | MIT 开源,完全可审计 |

| 数据隐私 | TEE 硬件加密保护 | 依赖服务商承诺 | 完全本地,最高级别 |

| 部署门槛 | 中等(云端 TEE) | 低 | 极高(需 H100/B200 集群) |

| 成本 | 按推理量计费 | 按 token 计费 | 硬件成本 + 运维 |

| 模型可控性 | 可 fork/修改 | 不可控 | 完全可控 |

这个定位非常精准——它不是最便宜的方案,也不是最私有的方案,但它是唯一同时提供模型透明度和数据隐私的方案。

信号解读

这一部署背后反映了三个结构性趋势:

开源模型的”商用化”路径正在收敛。从 Llama 的有限许可到 Qwen 的 Apache 2.0,再到 GLM-5.1 的 MIT 协议,开源模型的授权条款正在变得越来越宽松。这不是厂商的善意,而是竞争压力——当 DeepSeek 以极低价格提供接近旗舰的性能时,闭源厂商必须通过更开放的授权来争夺开发者。

TEE 正在从”安全专用”走向”AI 通用”。过去 TEE 主要用于加密密钥管理、支付处理等安全敏感场景。将 754B 的 AI 模型塞进 TEE 运行,证明 TEE 的计算能力已经足以支撑前沿 AI 推理。

0G Labs 的定位:AI 隐私计算的基础设施层。0G Labs 不是一个模型公司,也不是一个应用公司。Private Computer 是面向开发者的基础设施——它提供的是”在加密环境中运行任意开源模型”的能力。GLM-5.1 只是第一个入住的旗舰模型。

行动建议

- 金融/医疗行业:重点关注 TEE 部署模式。对于需要同时满足模型可审计性和数据保密性的场景,这是目前最优解。

- 开源社区:GLM-5.1 的 MIT 协议使其成为 fork 和二次开发的理想基座。结合 Private Computer 的 API,可以快速构建定制化应用。

- Agent 框架开发者:TEE 环境下的模型调用延迟和稳定性需要重新评估。Hermes Agent、OpenClaw 等框架可以考虑将 Private Computer 作为可选的模型后端。

交叉验证

智谱此前已推出 GLM-5.1 的多个变体(包括开源权重版本和 Coding Plan 订阅服务),此次与 0G Labs 的合作是其”开源+商业化”双轨战略的延续。同时,全球范围内对 AI 数据隐私的监管正在收紧(欧盟 AI Act 将于 2026 年 8 月生效),TEE 部署模式的合规优势将进一步凸显。

当 754B 的开源旗舰模型跑进可信执行环境,AI 推理的信任模型正在被重写。这不是一个技术细节的优化——这是一个新范式的开端。