Hermes Agent vs OpenClaw:2026 年 AI Agent 框架怎么选?

Hermes Agent 与 OpenClaw 是 2026 年两大主流 AI Agent 框架:前者主打自学习和自主进化,后者专注 Gateway-first 架构。本文从部署难度、生态集成、自主性、成本四个维度对比,帮你选出最适合的 Agent 方案。

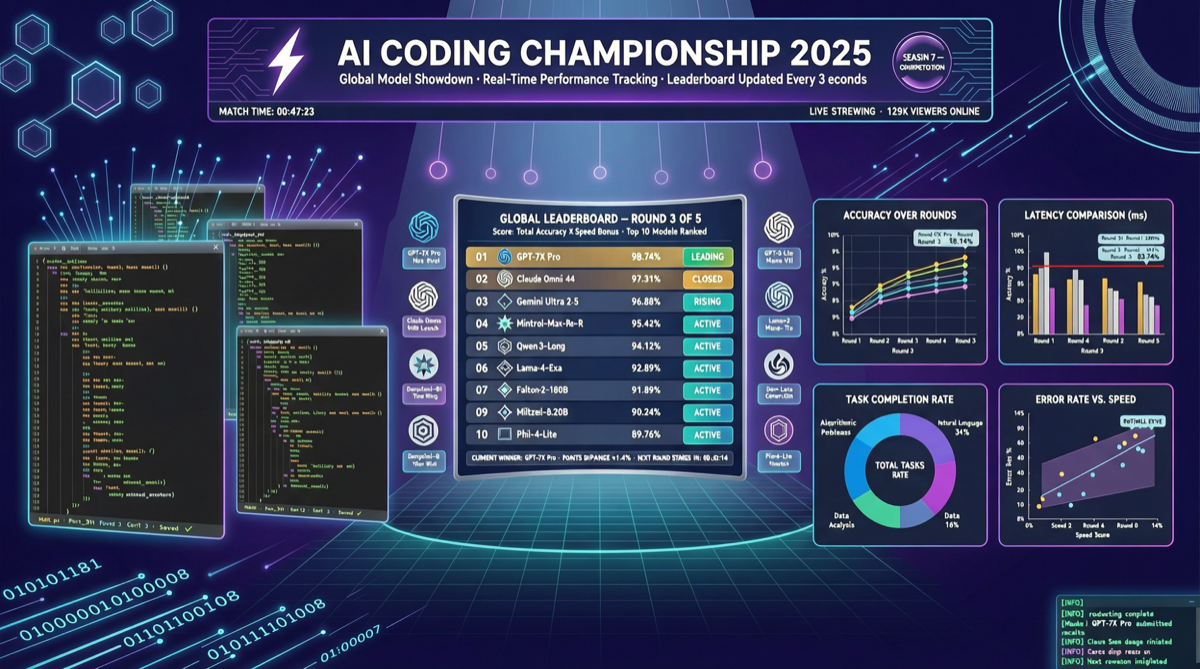

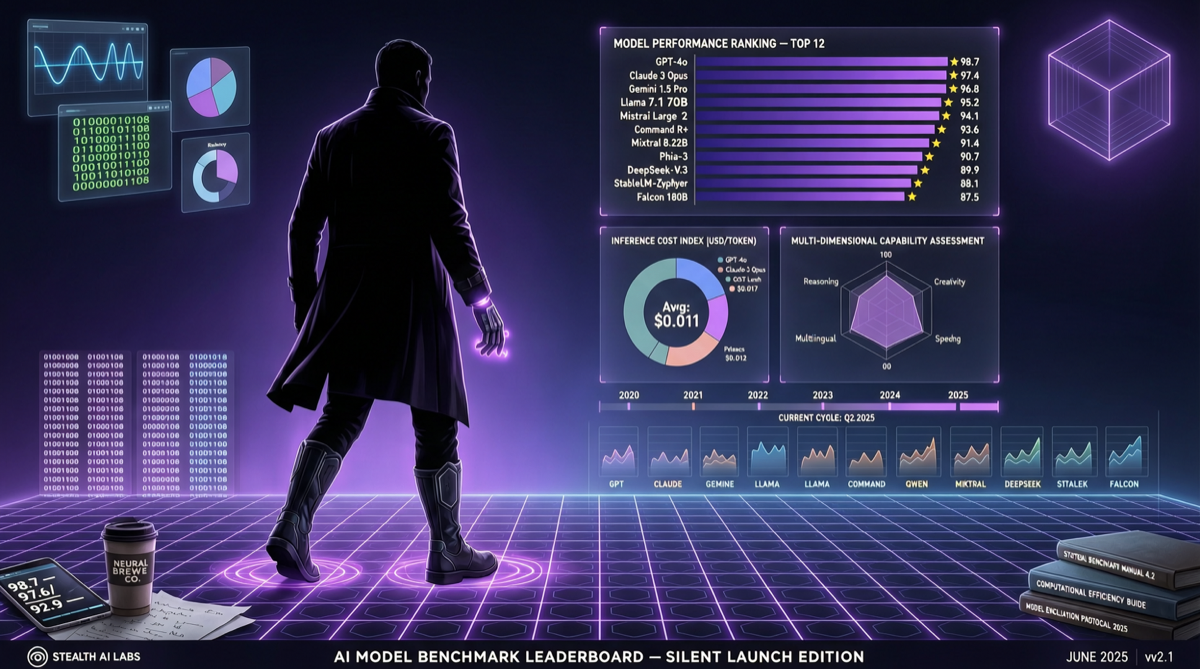

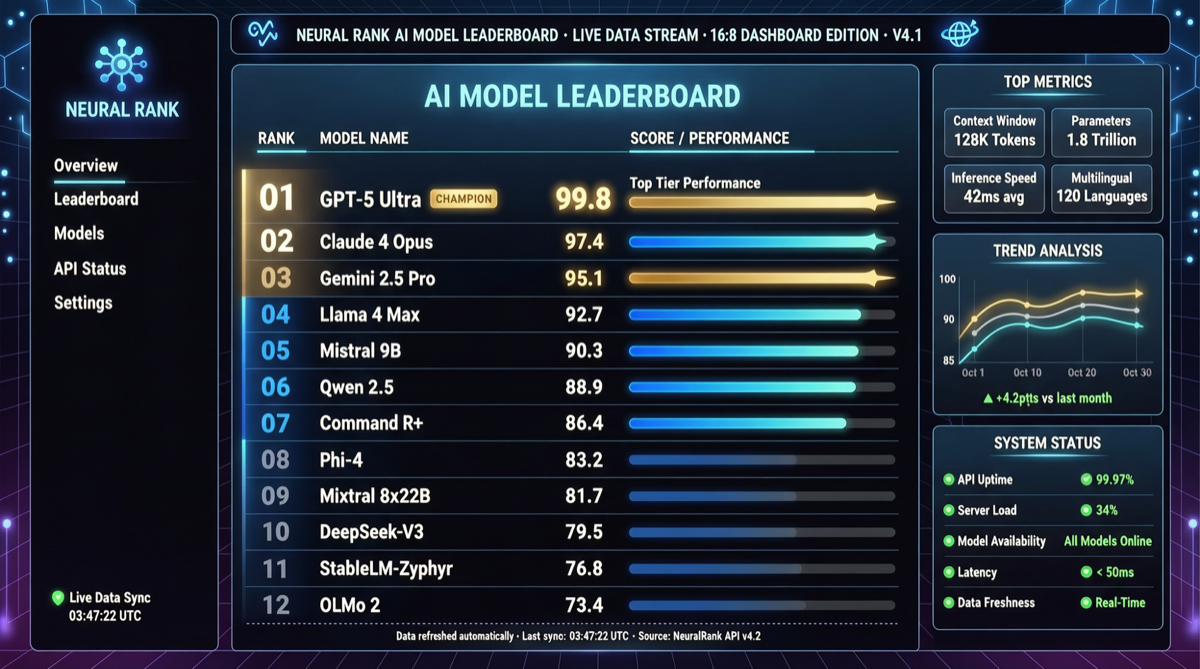

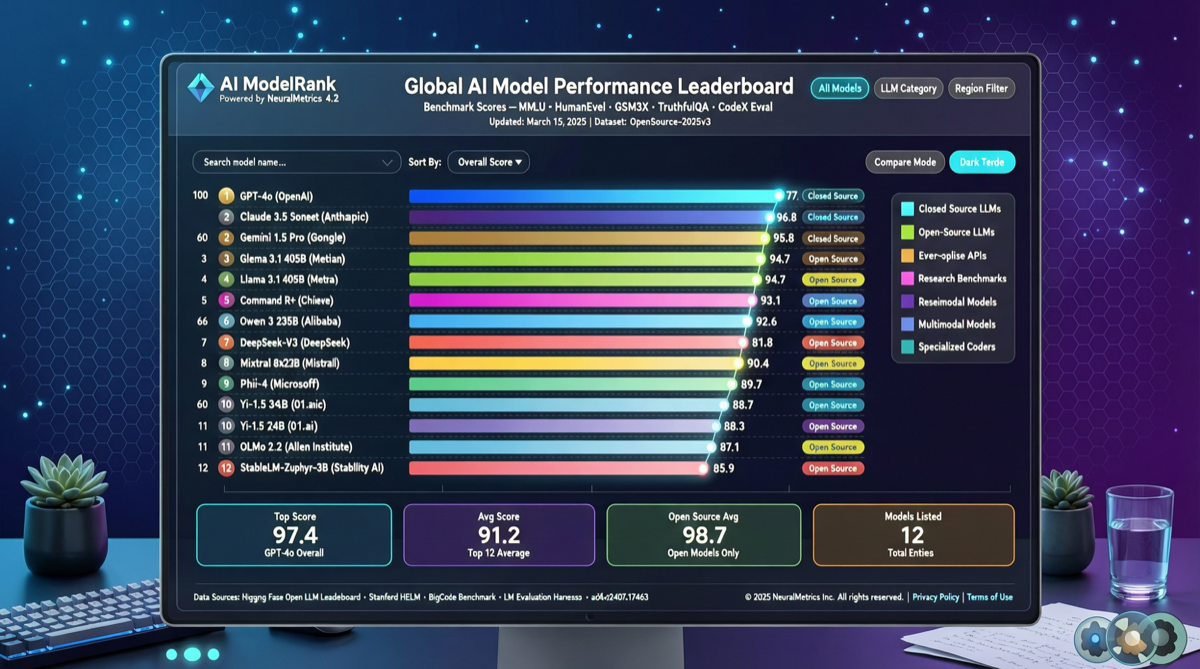

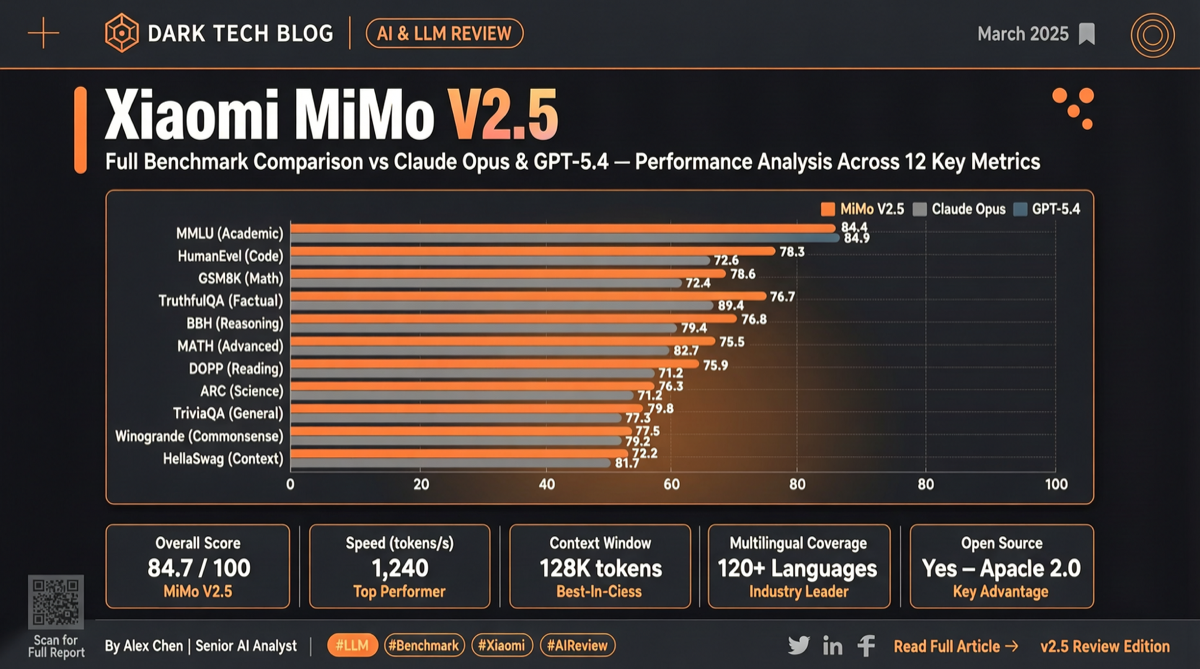

全面评测主流AI模型,帮助你选择最适合的方案

Hermes Agent 与 OpenClaw 是 2026 年两大主流 AI Agent 框架:前者主打自学习和自主进化,后者专注 Gateway-first 架构。本文从部署难度、生态集成、自主性、成本四个维度对比,帮你选出最适合的 Agent 方案。

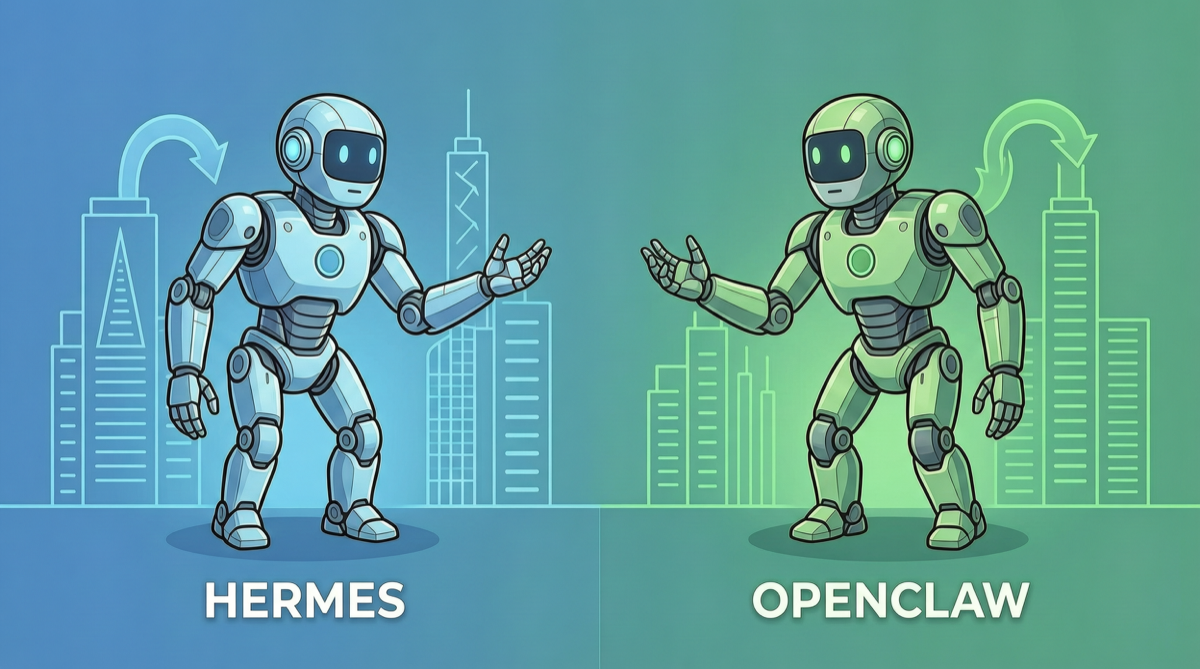

OpenAI Codex npm 周下载量飙升至 4600 万,Claude Code 仅 49.1 万,差距近 100 倍。OpenAI 推出 Migrate to Codex 功能,一键导入 Claude Code/Cursor 配置,开发者生态争夺进入白热化。

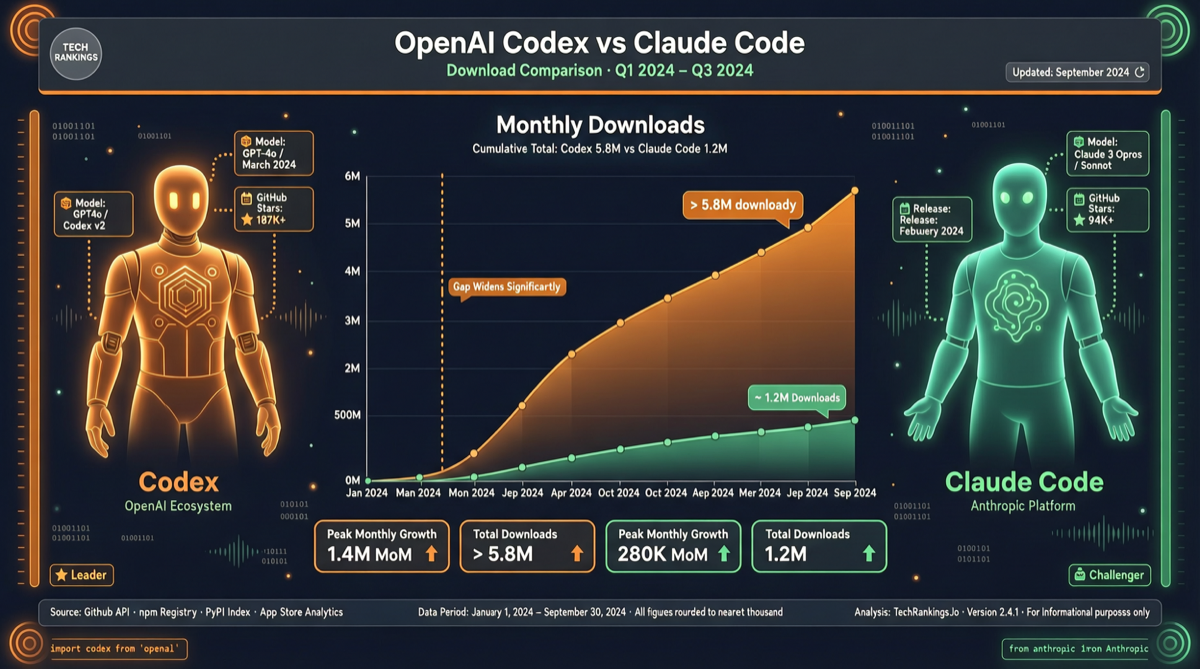

Context-mode 以 12,899 星成为 GitHub 热门项目,通过 SQLite 持久化记录 AI 编码 Agent 的每一次编辑、错误和决策,在上下文压缩时精准恢复关键信息,支持 14 种编码平台。

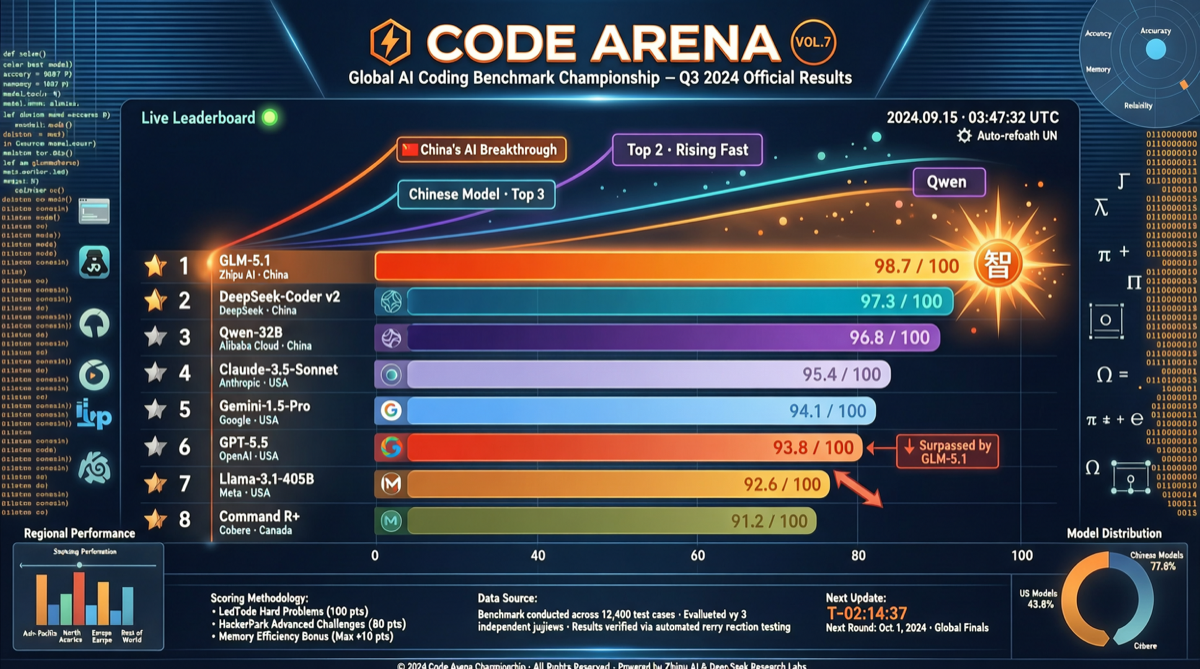

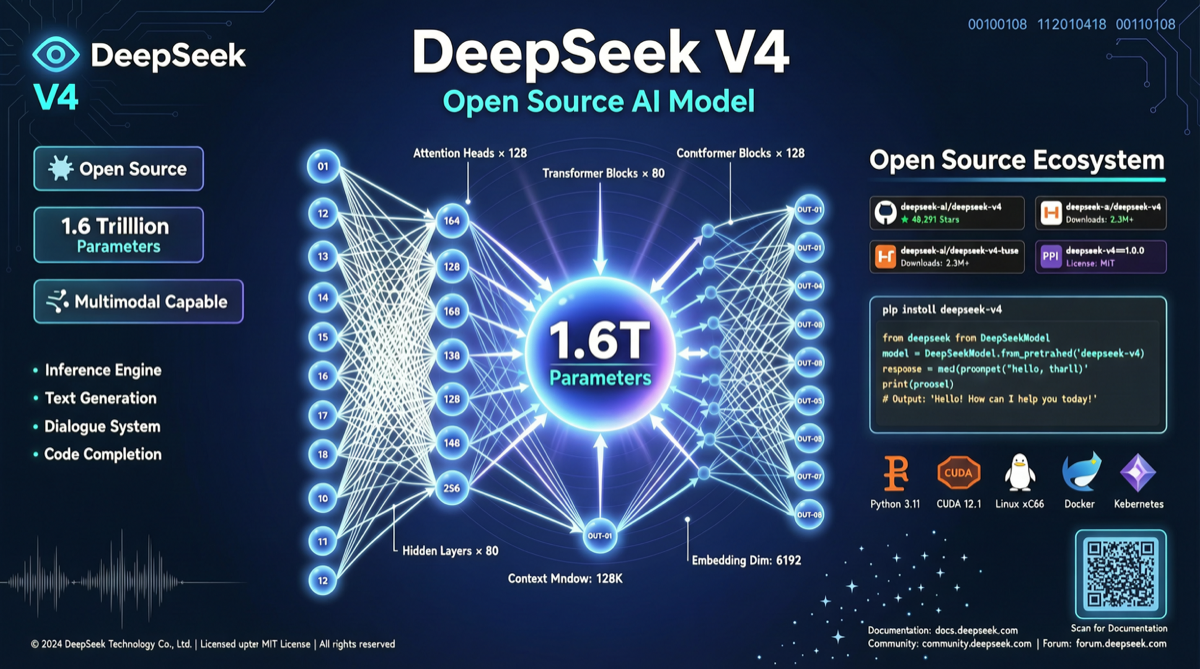

2026 年 5 月,国产 AI 模型阵营呈现差异化竞争格局:Qwen 以性价比和开源生态占据 Agent 工作负载主力,Kimi 在设计和创意场景领先,GLM-5.1 编码能力超越 GPT-5.5 High,DeepSeek V4 Pro 在特定评测中超越 GPT-5.2。国产模型不再是"便宜替代",而是各有所长。

2026年5月成为AI模型史上最密集的发布月:GPT 5.6、Sonnet 4.8、MiniMax M3、Gemini 3.5 预计同月发布,59个大模型已在今年推出,选模型不再是挑最好的,而是挑最适合你工作流的。

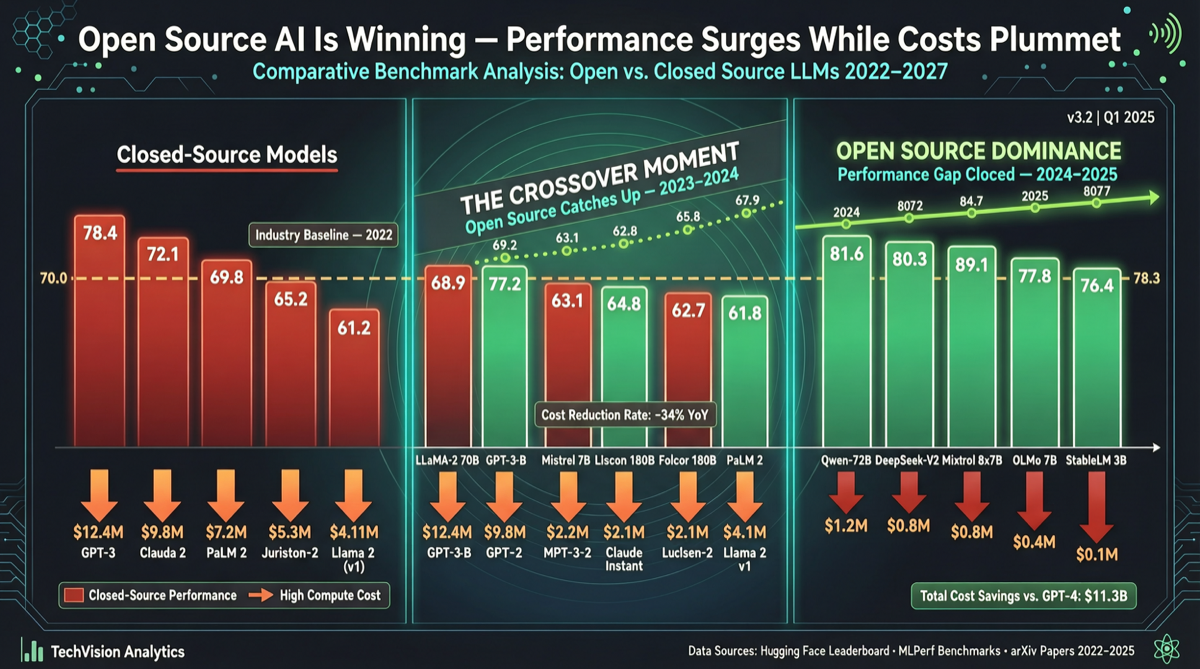

State of AI May 2026 报告显示,DeepSeek V4、Kimi K2.6 等中国开源模型在 SWE-Bench Pro 上已与 Claude、GPT-5.5 拉平,但 API 成本仅为后者的三分之一。"中国AI落后两年"的说法正在被现实打脸。

最新 State of AI 5 月报告显示,DeepSeek V4 和 Kimi K2.6 在 SWE-Bench Pro 上已与 GPT-5.5 和 Claude Opus 4.7 持平,但 API 成本仅为后者的三分之一。中国开源模型正在改写"智能=昂贵"的等式。

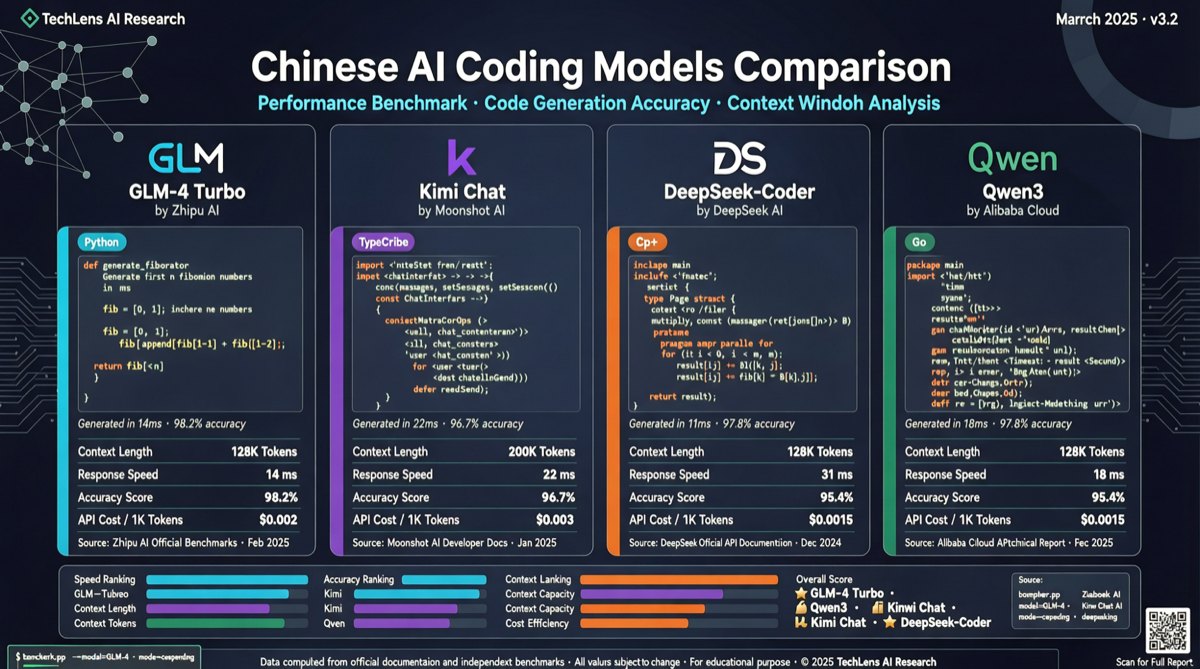

Code Arena 最新数据显示 GLM-5.1 以 1535 分位列第 5,超越 GPT-5.5 High(1500 分)。结合 Kimi K2.6 SWE-Bench Pro 登顶、MiMo-V2.5-Pro 杀入前三,国产模型在编码领域完成集体上位,DeepSeek V4 Pro 反而垫底。

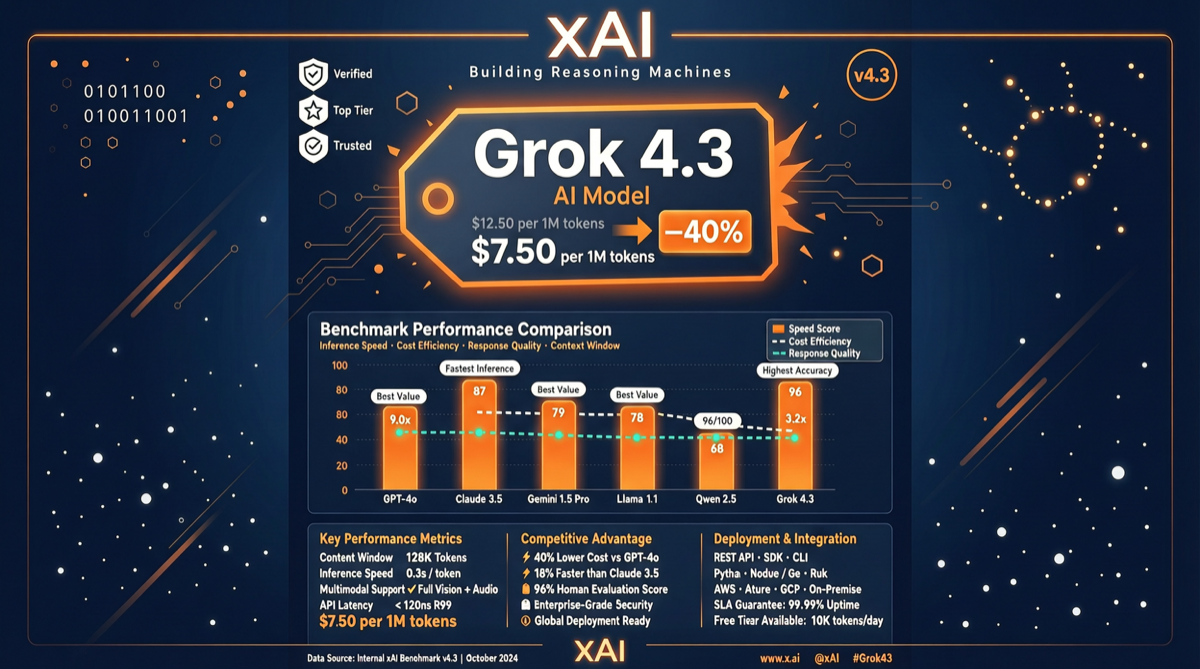

xAI 静默发布 Grok 4.3,在 Artificial Analysis 智能指数上达到 53 分,超越 Muse Spark 和 Claude Sonnet 4.6。Vals Index 排名 #13,CaseLaw 和 CorpFin 两项专业基准位列第一。API 输入价格下调 40% 至 $1.25/M tokens。

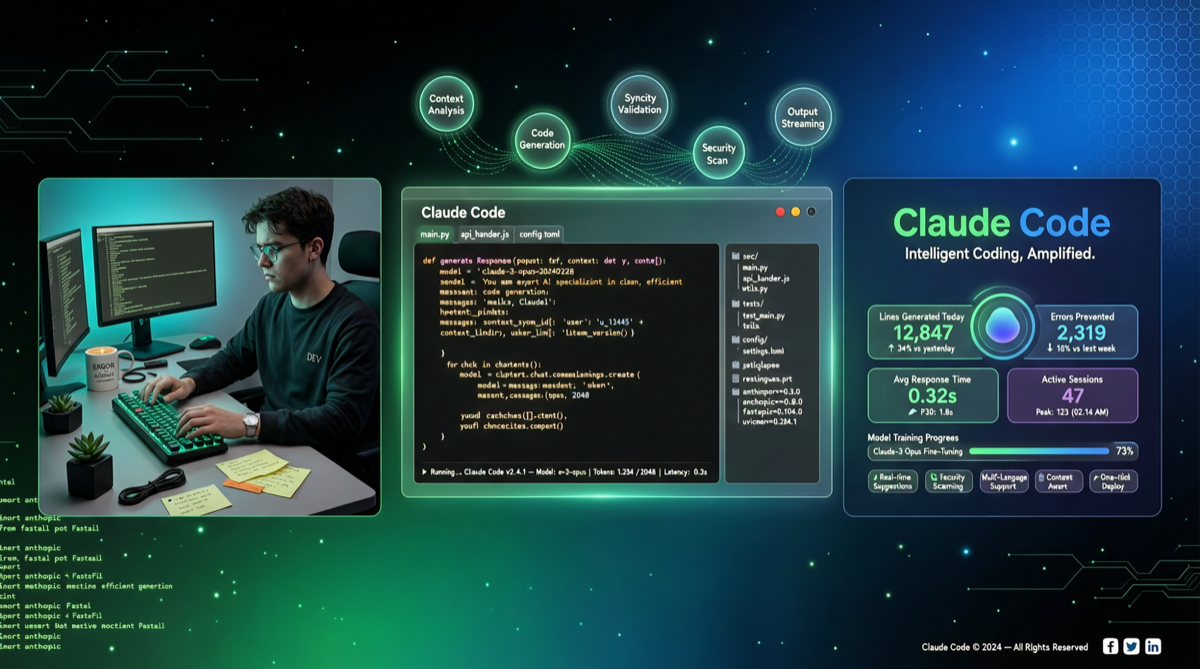

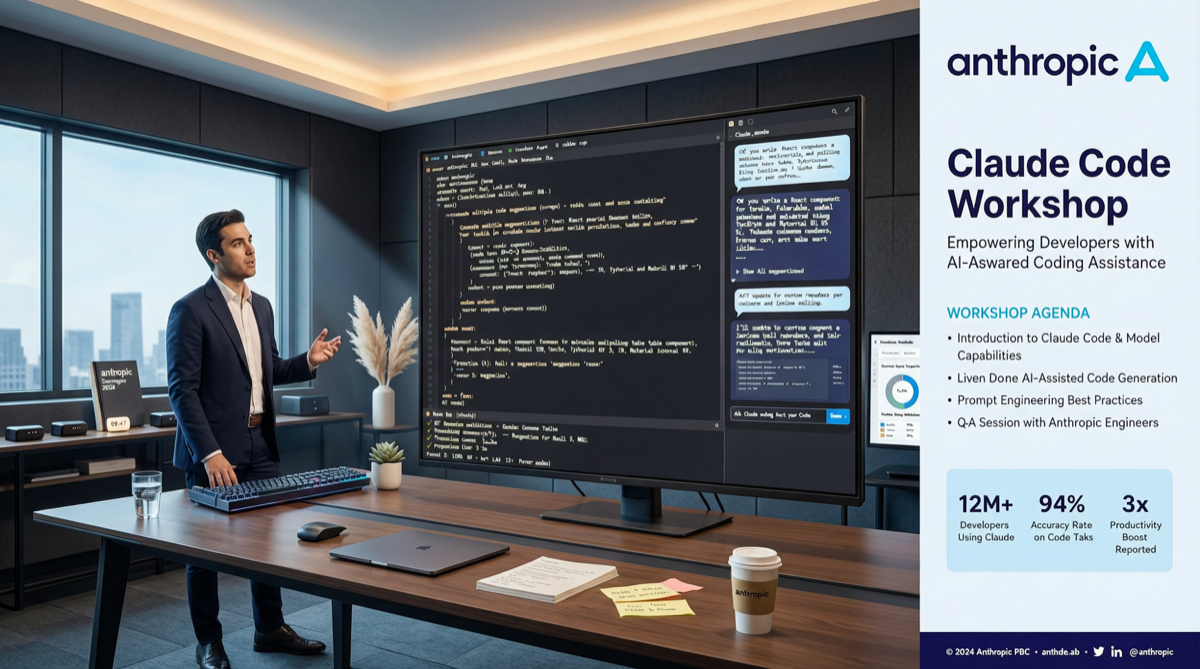

The Pragmatic Engineer对近千名开发者调查显示:Claude Code在发布仅8个月后已成为使用最广泛的AI编程工具,超越GitHub Copilot和Cursor,95%的用户表示满意或非常满意。

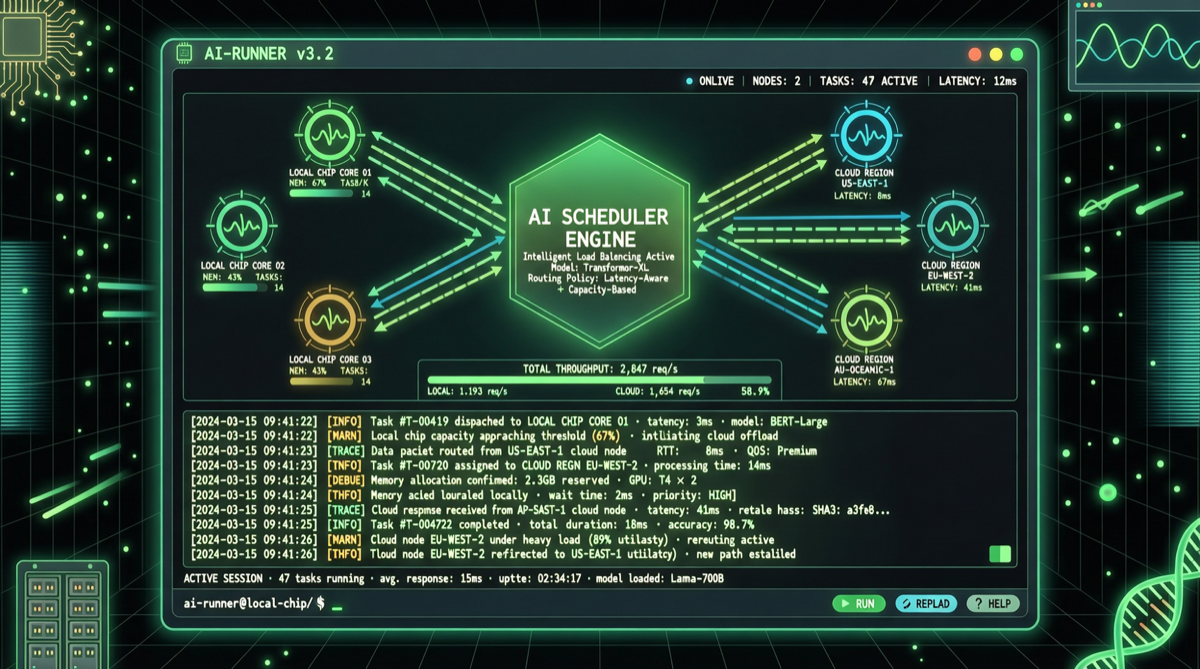

一位中国工程师在无 WiFi 的 11 小时航班上,用 MacBook Pro M4 (64GB) 搭配本地 AI 工具栈独立完成了整个客户项目。2026 年的本地 AI 生态已经成熟:从代码生成到调试到测试,全流程无需云端 API。本文梳理完整的本地 AI 工具栈。

Claude Sonnet 4.8 泄露代码揭示新增的 "X-high" 努力级别,这不仅是参数调节——它改变了 Agent 任务分配的成本模型。本文分析 X-high 对编码基准 +12 分的贡献,以及开发者如何据此重构多模型编排策略。

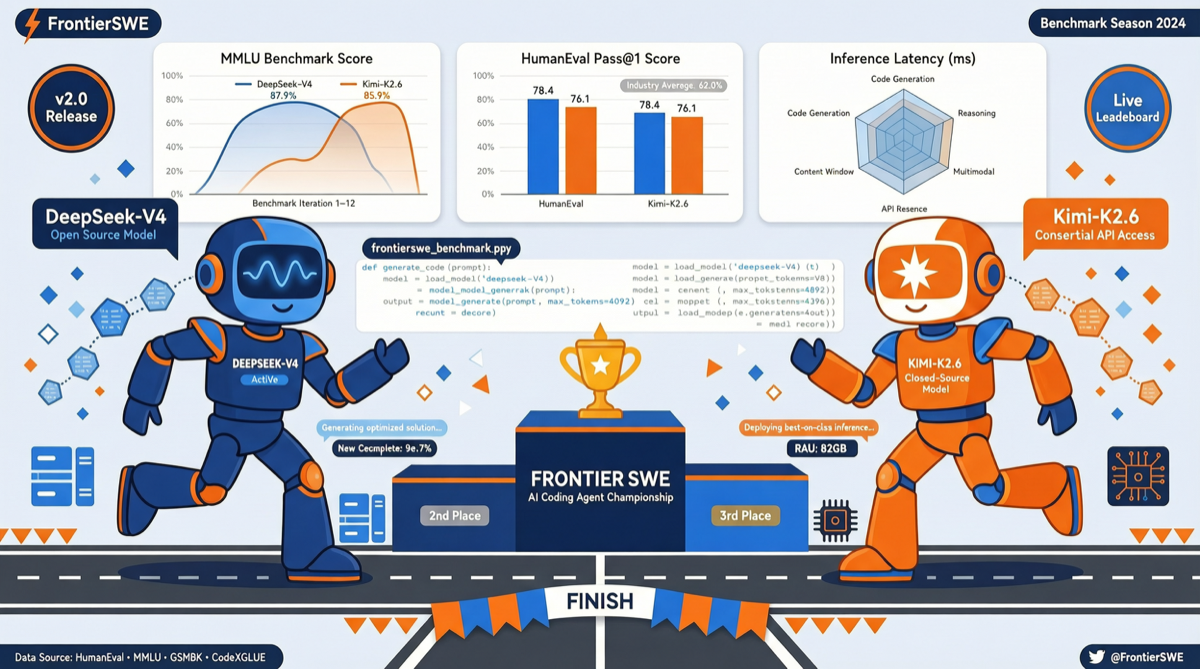

DeepSeek V4 Pro 在 FrontierSWE 基准测试中成为最强开源模型,Kimi K2.6 排名第二。V4 在奖励破解尝试上显著少于其他模型,best@5 模式下追平 Gemini 3.1 Pro。中国模型在真实软件工程任务中展现突破性能力。

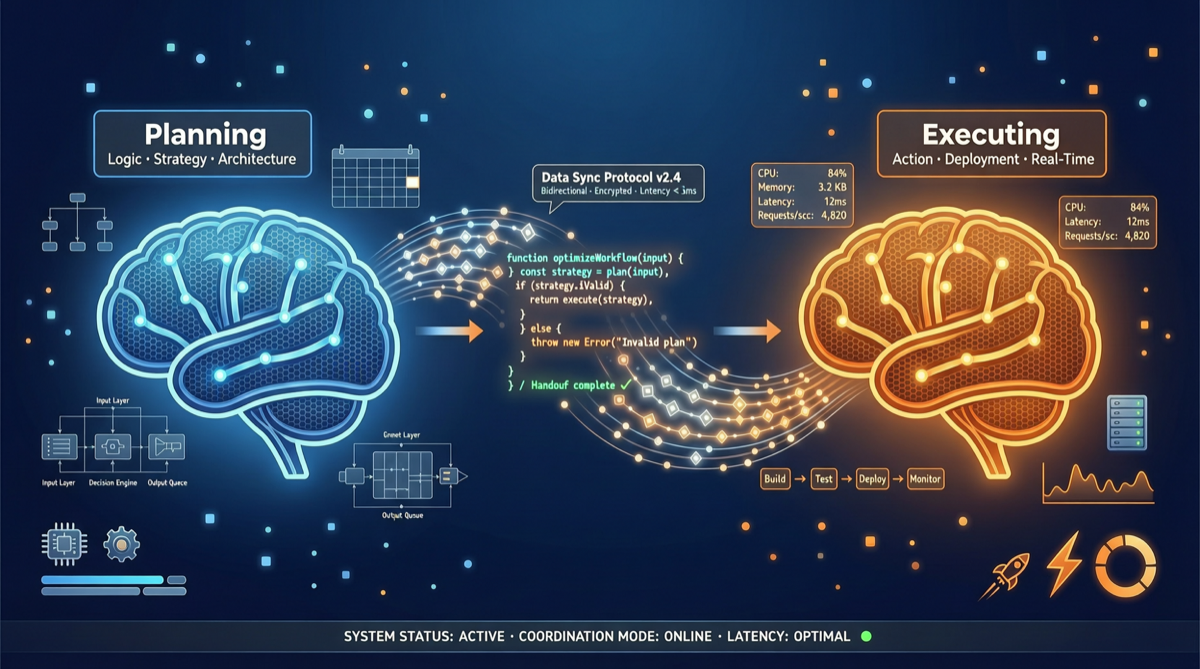

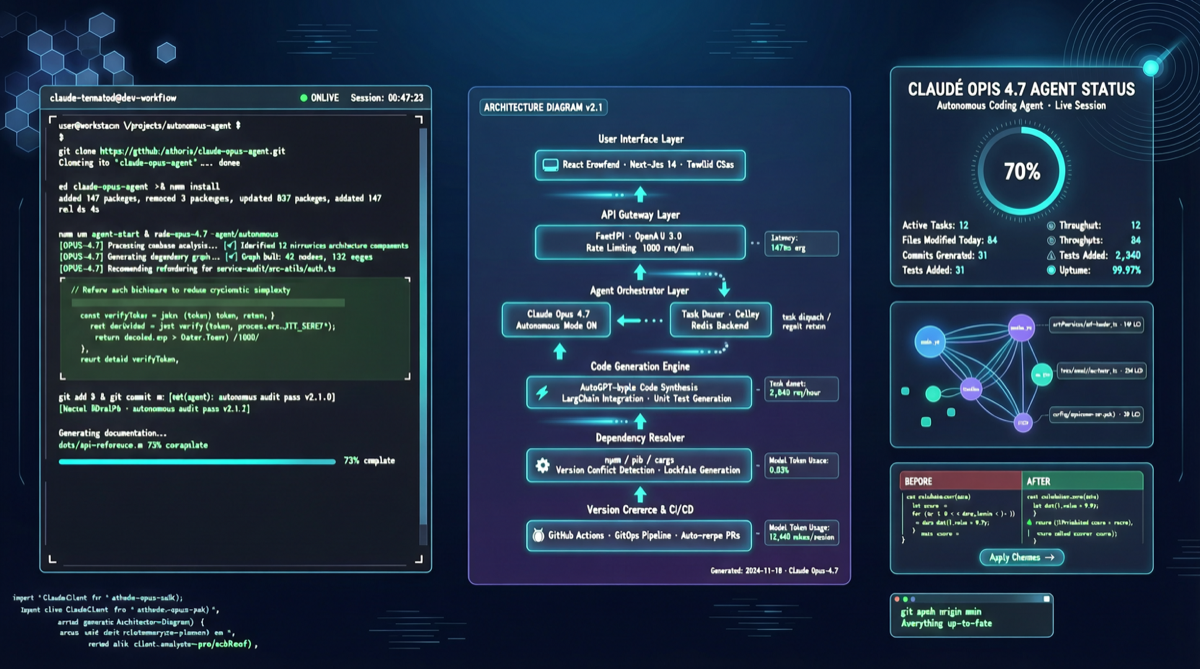

实测表明 Opus 4.7 负责架构规划、GPT-5.5 负责代码执行的双模型工作流,在编码质量与效率上显著优于单模型方案。本文拆解工作流设计、提示词模板与成本分析,给出可复用的最佳实践。

Hermes Agent v0.12.0 发布 Kanban 多 Agent 协同功能,Agents 从看板领取任务、并行工作、受阻时交接。发布推文 24 小时内获得 125 万播放、5411 赞、439 转发和 4010 收藏。与主流平台的 Sub-Agent 架构不同,Hermes 采用真正的 Orchestrator 模式实现多 Agent 分布式协同。

2026 年 agentic coding 工具赛道爆发:Claude Code 领跑开发者心智,Cursor 以 IDE 体验取胜,DeepSeek-TUI 则以近乎零成本的策略搅局。本文从功能、价格、使用场景三个维度对比三大主流方案,帮助你做出选择——继续付费、切换方案还是混合使用。

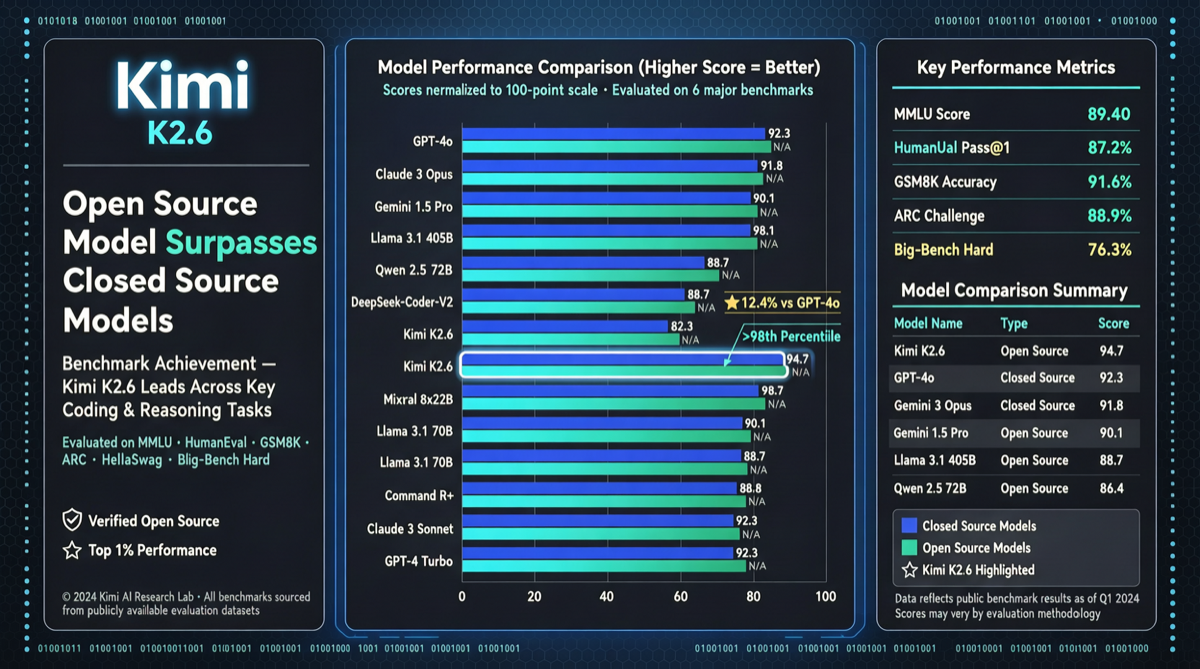

Moonshot AI 发布 Kimi K2.6,在 SWE-Bench Pro、HLE with tools、BrowseComp 三大评测中全面超越 Claude Opus 4.6 和 GPT-5.4,成本仅为后者的 1/7,支持 300 个 Agent 并行运行,将于 6 月开放权重。

英伟达通过 NIM 平台免费开放 100+ 前沿 AI 模型的 API 访问,无需信用卡、无试用期、无到期日。包括 MiniMax M2.7(230B 参数,200K 上下文)和 DeepSeek V3.2 等付费级模型。注册即获真实 API Key,零成本开始构建。

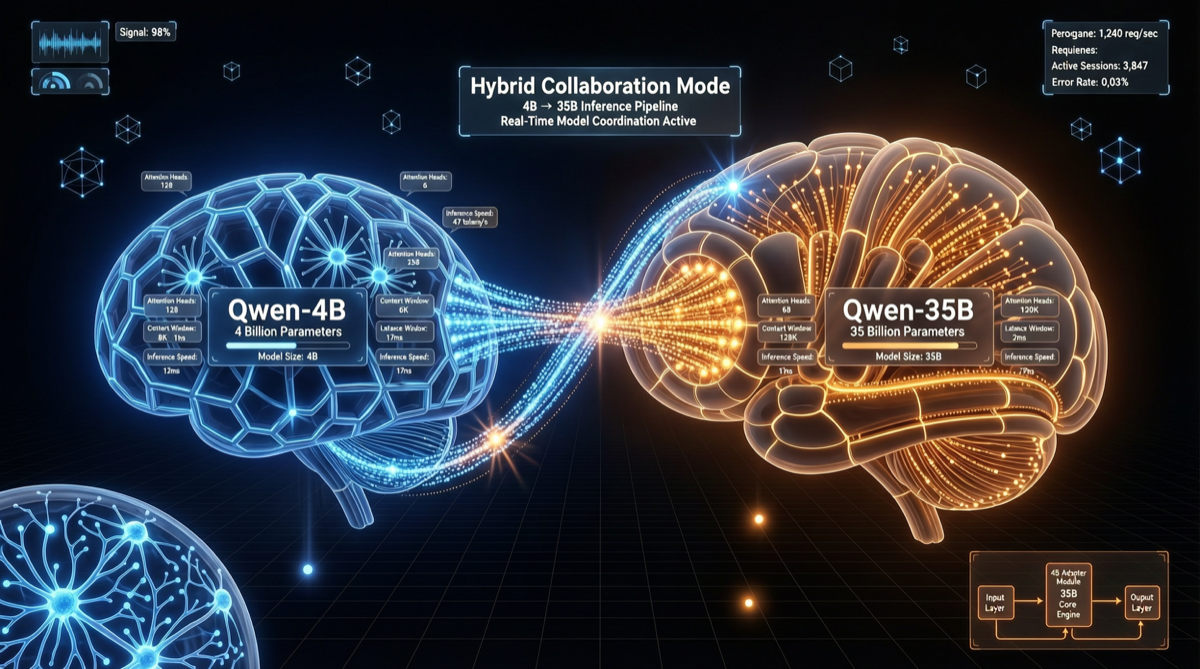

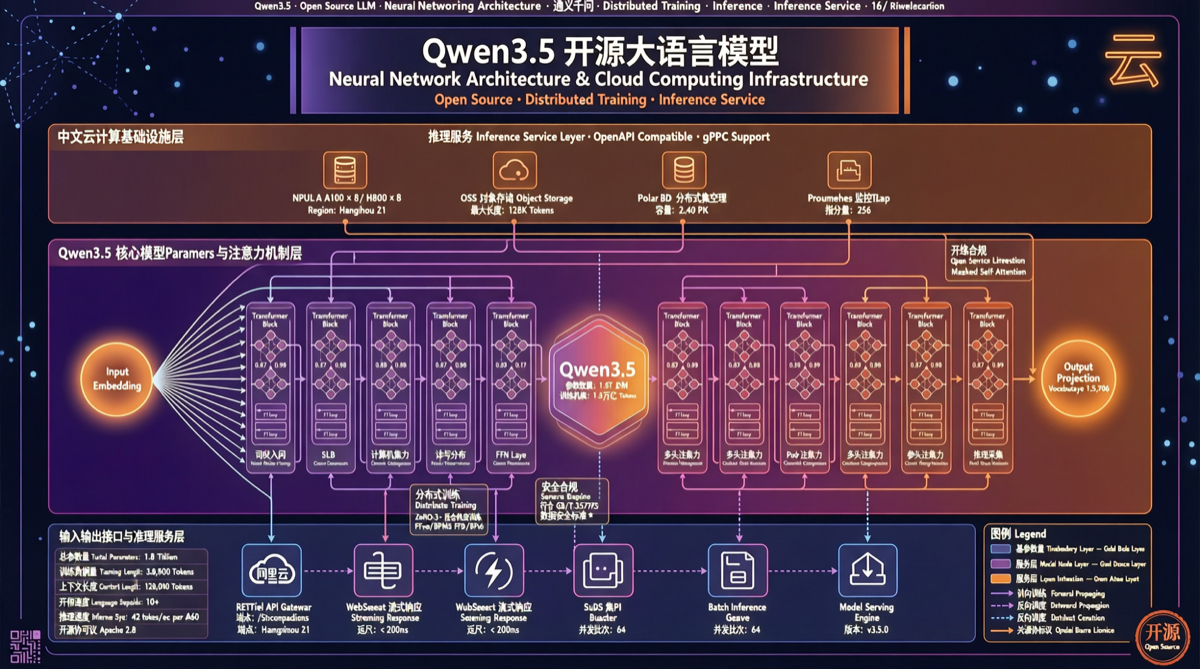

阿里巴巴 Qwen 团队发布了一种全新的混合推理架构,将 4B 小模型与 35B 大模型通过新型求解器和辅助训练结合,实现"两个大脑协同工作"的智能推理模式。该架构在保持低算力消耗的同时显著提升了复杂任务表现。

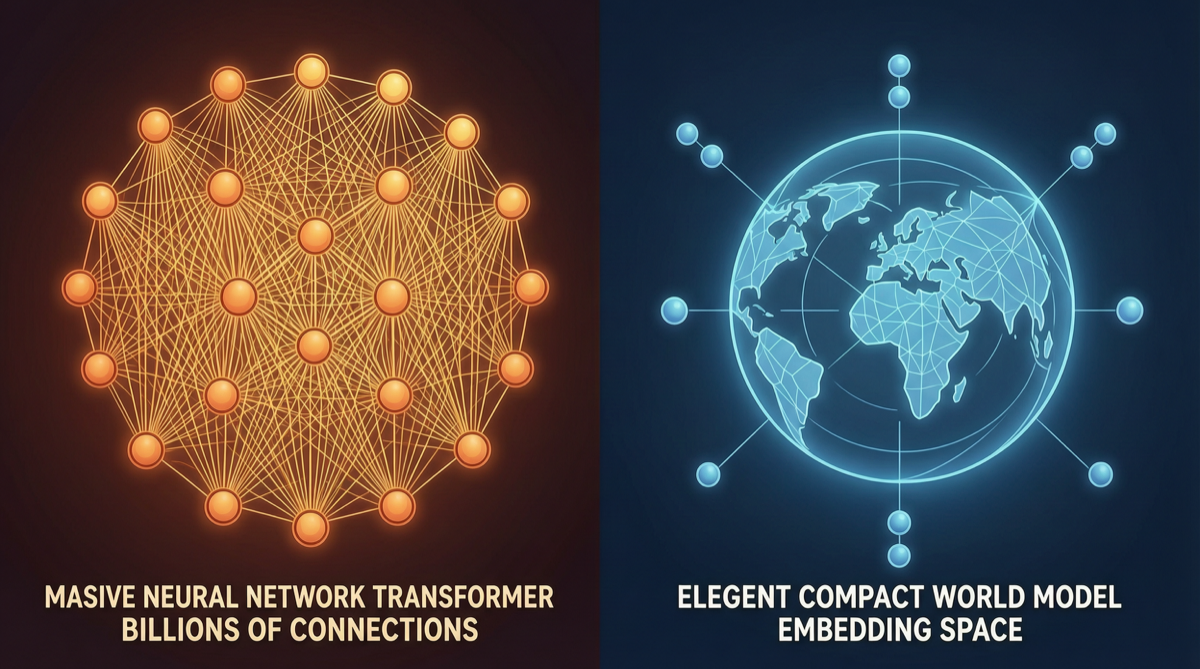

Yann LeCun持续推动的JEPA(联合嵌入预测架构)路线引发热议——非生成式、非LLM路径,用小参数+单张GPU实现物理规律编码与超快规划。当全行业万亿资金押注Transformer时,LeCun的"另一条路"是否被低估?

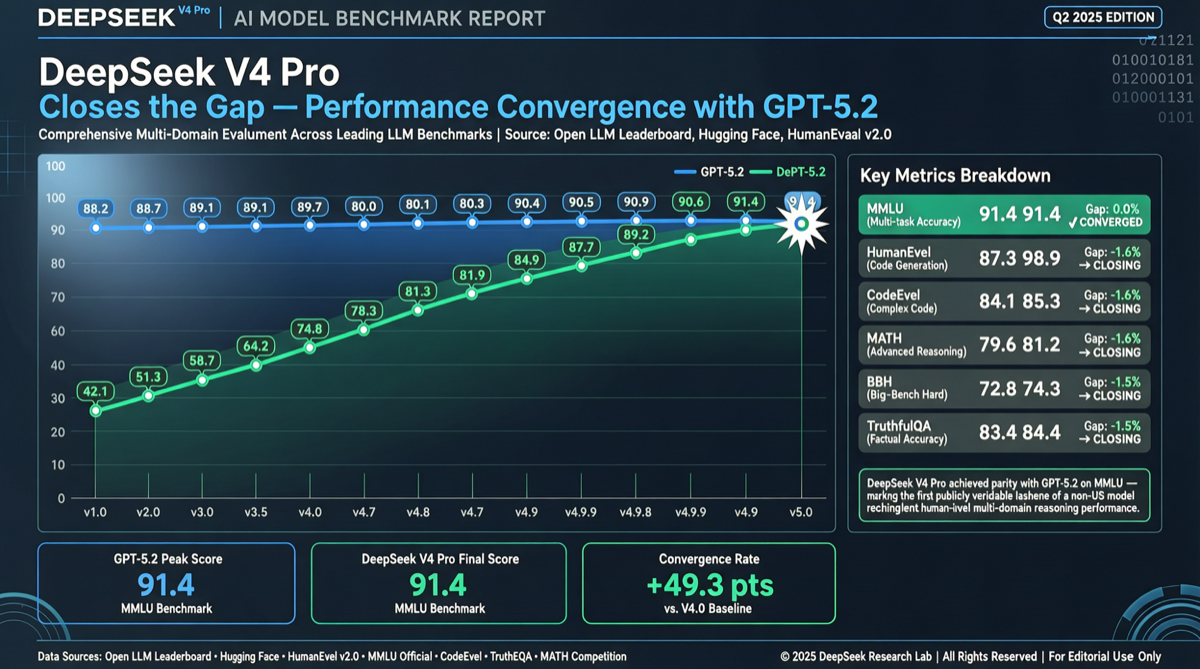

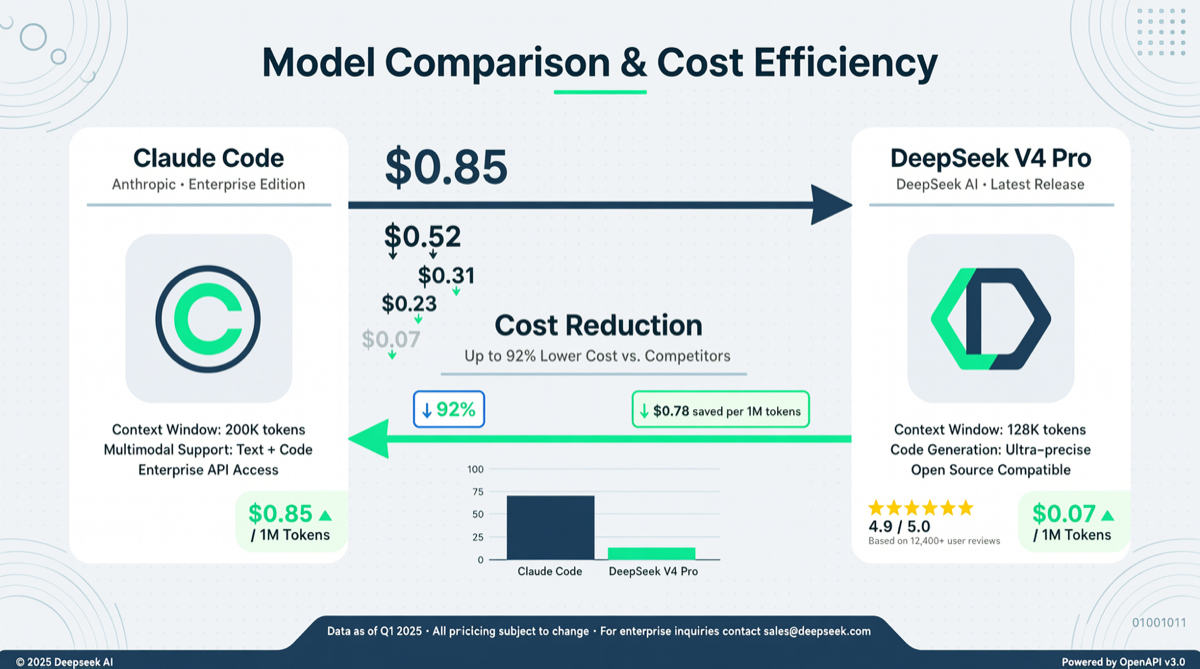

DeepSeek V4 Pro 在 FoodTruck Bench 智能体评测中追平 GPT-5.2,成为首个进入前沿层级的中国模型,且成本仅为 GPT-5.2 的 1/8。中美 AI 能力差距从一年缩短至约 10 周。

多位开发者发现 Qwen3.5/3.6 系列在 Self-Correction 阶段存在明显的"过度反思"问题:结论已经很完善的情况下,一旦进入自我纠正,模型会大幅增加思考内容但结论几乎没有改善,反而多消耗数倍 Token。这揭示了当前推理模型的一个通病。

Anthropic 宣布将 Claude Security 能力向更广泛的公众开放,同时 Claude Code 云端版新增任务分类与看板模式。结合 Cursor 同步推出的 AI Agent Harness 安全代理,2026 年 AI 编程安全正在从"人工审查"转向"AI 自动化持续监控"。

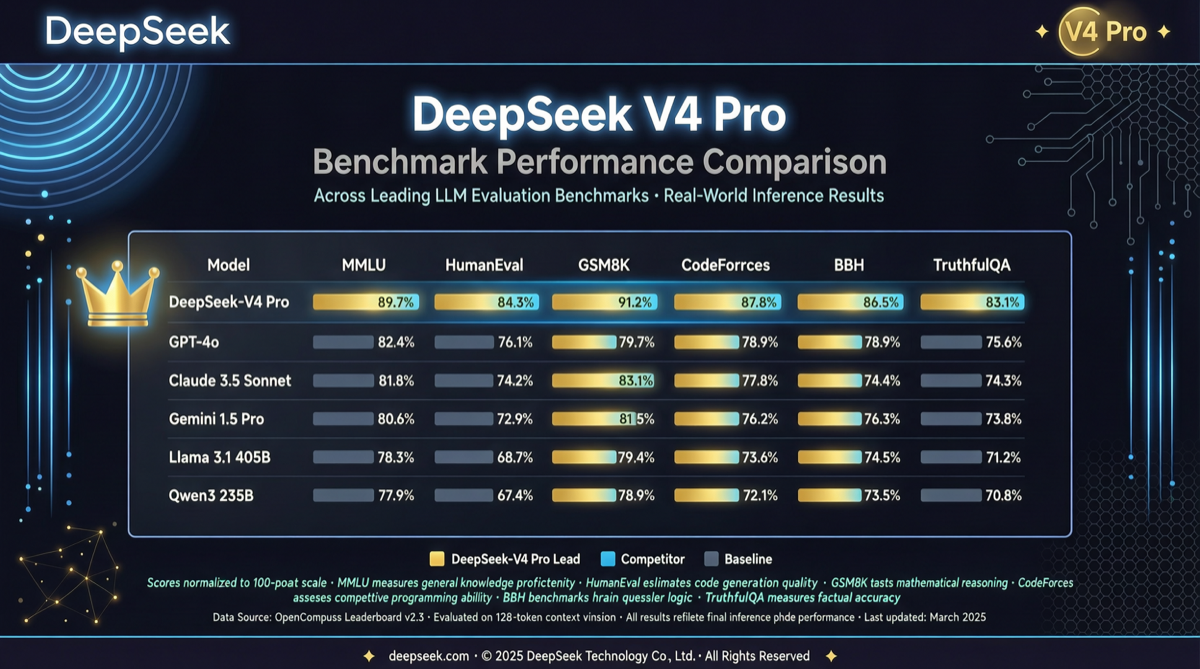

DeepSeek V4 Pro 在多项基准测试中超越 Claude Opus 4.7 和 GPT-5.5,价格仅为后者的十分之一。基于华为昇腾芯片训练,万亿参数 MoE 架构,标志着开源模型首次在综合能力上全面超越闭源旗舰。

OpenRouter 最新榜单显示,Kimi K2.6 和 GLM 5.1 在多项基准测试中已接近闭源模型水平,唯一差距在推理速度。随着性能趋同,企业正批量将批量推理任务从付费 API 迁移到开源方案。本文分析性能差距、成本对比和迁移策略。

DeepClaude 将 Claude Code 的执行能力与 DeepSeek V4 Pro 的规划能力拆分,用 1/17 的成本跑完完整 agent loop。HN 124 分热议,架构设计取代模型堆料成为新护城河。

NIST 最新报告指出 DeepSeek V4 在多项关键基准上已达到 8 个月前发布的 GPT-5 水平。若当前追赶趋势持续,中国模型有望在 2027 年 2 月达到 GPT-5.5 级别。中美模型差距正在以可预测的速度缩小。

38 位来自斯坦福、哈佛、MIT 的学者将 6 个完全自主的 AI Agent 接入真实邮箱、Discord 和文件系统,给予无限制 Shell 权限。两周实验中 20 位研究员模拟不同身份与 Agent 互动,结果揭示了自主 Agent 在真实环境中的系统性风险。

Gemini 3 Flash 未经任何官方 announcement,悄然出现在 LMSYS Chatbot Arena 评测榜单中,初始表现已"noticeably sharper"。Google 这种"先上榜单再开发布会"的策略正在改变模型发布的节奏,也让行业评测变得更加实时和透明。

Anthropic 应用 AI 团队发布了一段 24 分钟的内部工作坊视频,免费公开了顶级团队如何高效使用 Claude 的实操方法。视频获得了 1700+ 赞和 4400+ 收藏,成为近期 AI 社区最热门的学习资源之一。

NVIDIA 通过 NIM 平台免费开放 MiniMax M2.7、Kimi K2、GLM-4.7、DeepSeek V3.2 等中国顶级模型 API,无需信用卡、无试用期限制。开发者可直接获取 API Key 并立即调用,大幅降低了接入国产模型的技术门槛。

Anthropic在Claude Code Desktop中上线Dispatch功能,支持从移动端下发任务到桌面端自动执行,Claude可访问本地文件、连接器和浏览器。AI代理从"对话式"走向"无人值守式"。

Anthropic 在没有公告和邮件通知的情况下,悄悄将 Claude Code 从 Pro 计划($20/月)中移除,强制用户升级至 Max 计划($200/月)。社区强烈反弹后 24 小时内紧急恢复。这一事件暴露了 AI 工具订阅模式的根本性矛盾。

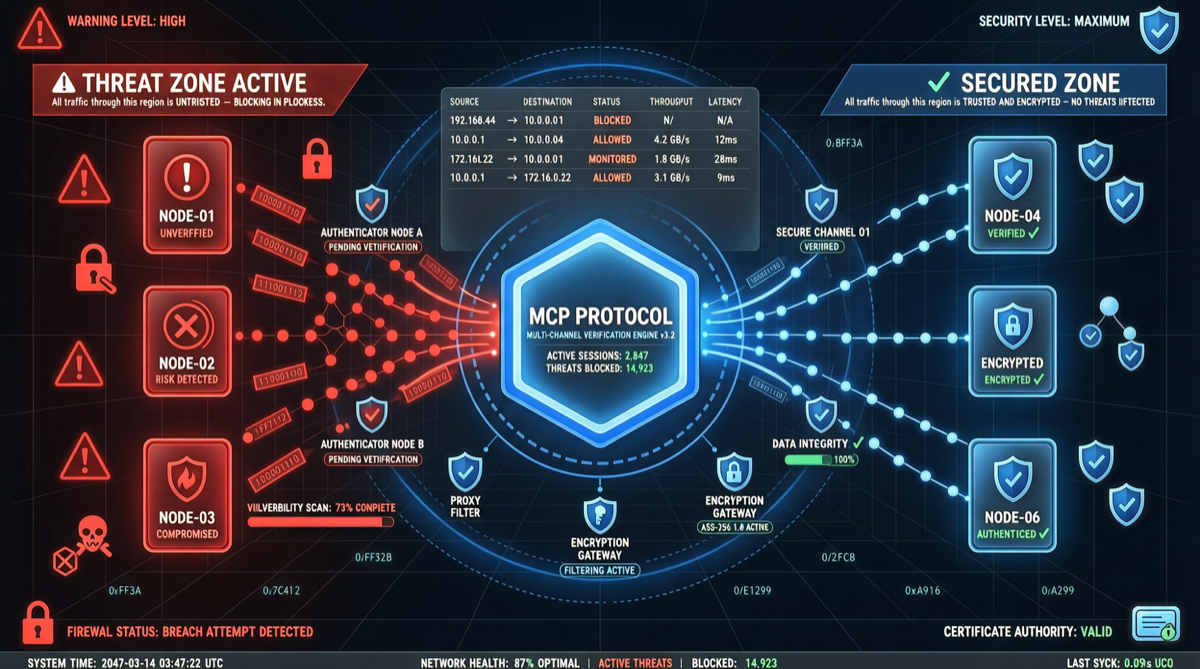

Google Cloud 宣布推出 50+ 托管 MCP 服务器,覆盖数据库、AI、运维、安全等服务。与此同时,安全社区警告未验证 MCP 服务器可能暴露敏感数据。MCP 正从协议标准演变为企业 Agent 基础设施的关键层。

OpenAI GPT-5.5 在最新网络安全评测中追平此前被大肆炒作的 Mythos Preview,新结果表明 Mythos 的网络威胁能力并非"某一模型的突破性优势",大模型安全攻防进入同质化竞争阶段。

CAISI 于 2026 年 4 月对 DeepSeek V4 Pro 进行独立评测,结论是能力落后前沿约 8 个月。但评测同时确认了其开源权重、百万级上下文和本地部署的独特价值——在某些场景下,落后 8 个月的前沿能力仍然是足够好的选择。

新发布的 SWE-chat 数据集追踪了 6000 个真实开发者的编码 Agent 会话,包含提示词、工具调用和逐行的人类/AI 代码归属。核心发现:Agent 自主性高度依赖任务类型,简单重构任务可达 80% 自主,复杂架构任务仍需要人类深度介入。

Hermes Agent 在开发者社区中获得极高评价,被定位为"全能型通用 Agent"。一个 CLI 接入任意模型,支持工具调用、子 Agent、工作流自动构建,周成本不到 100 美元即可运行整个业务运营。

Kimi K2.6 在 Go 语言开发中使用量实现 3 倍增长,同时以开源权重、Modified MIT 许可、Cloudflare Workers 免费部署三重优势快速渗透开发者生态。这个开源模型正在从"可用"走向"好用"。

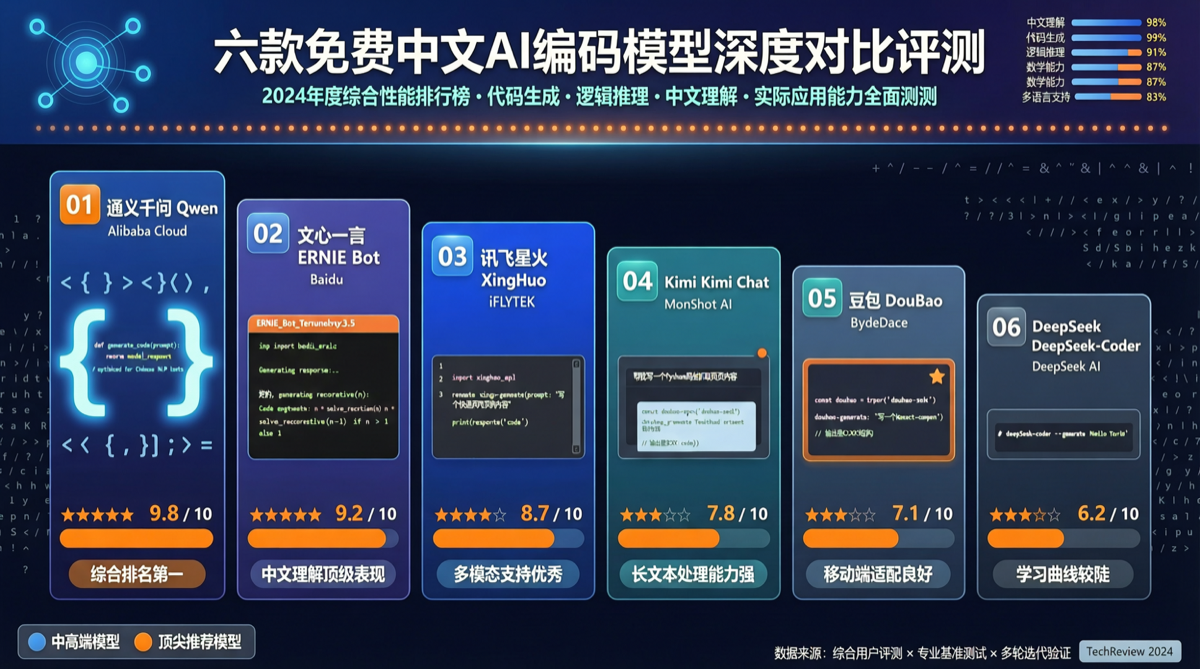

一项涵盖六款主流中国 AI 模型的编程实测揭示:DeepSeek 擅长逐步推理,Kimi 像教师般解释决策,GLM 输出最规范的代码架构,Qwen 以高效著称,MiniMax 创意能力强,MiMo 则走向全能路线。中国模型正以差异化定位蚕食 GPT/Claude 份额。

Google 发布 Gemini CLI v0.40.0,新增本地 Gemma 模型智能路由支持,简单任务本地免费处理,复杂任务自动切换云端 Gemini,构建"免费+付费"混合架构。

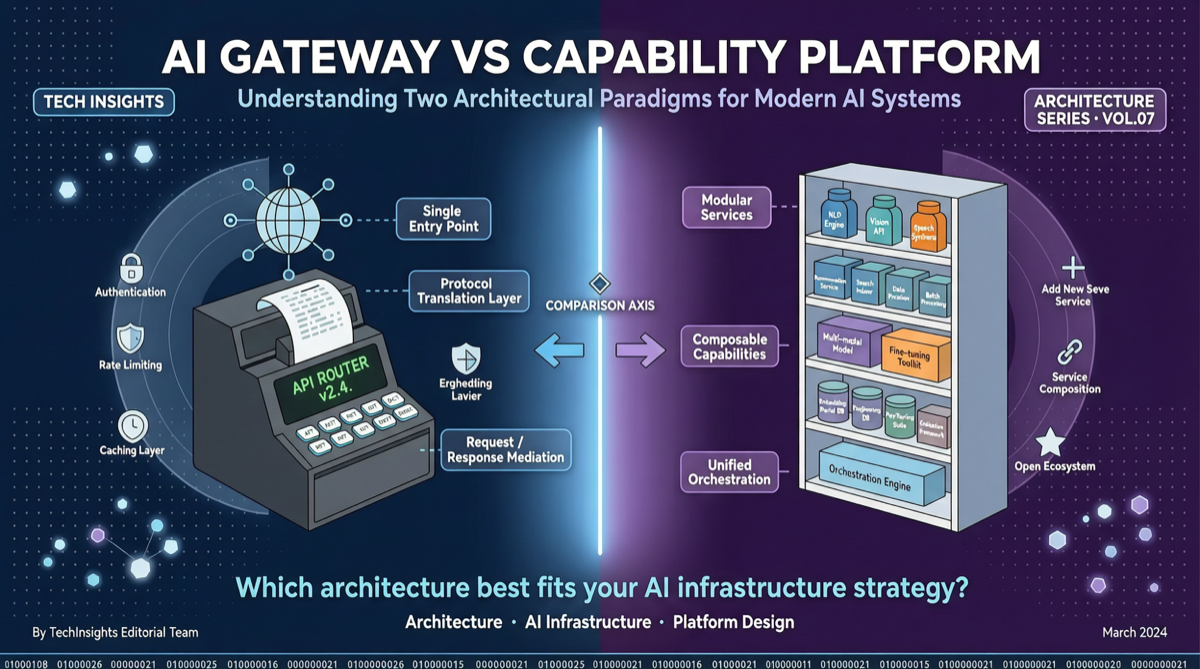

NewAPI(30.2k Star)专注 API 协议转换和模型管理,LinkMind(265 Star)主打多模态能力统一接入。两个项目解决不同层次的问题,但目标用户有重叠。本文从功能、架构、许可证和适用场景全面对比。

中国开发者在长途航班上用 MacBook 本地运行 Llama 70B,11 小时无网络环境下完成客户任务。71 tokens/sec 速度、60K 上下文、48.6GB 内存占用,验证了消费级设备运行超大模型的可行性。

社区开发者用同一套编程 prompt 实测 6 款免费国产 AI 模型——DeepSeek V4 Free、GLM-5.1 Free、Kimi K2.6 Free、MiMo-V2.5-Pro Free、Ling-2.6-Flash Free、Qwen 3.6 Plus Free。结果出人意料:至少 3 款已经能胜任中等规模的独立编码任务。

月之暗面发布 Kimi K2.6,SWE-Bench Pro 得分 58.6,超越 GPT-5.4 和 Claude 4.6 的 xhigh reasoning 配置,且成本低 7 倍,完全开源免费。

在 Vibe Coding 实践中,最贵最强的模型并非所有任务的最佳选择。处理文件读写、代码搜索、简单格式化等普通任务时,强模型的 thinking 和 reasoning 反而成为效率瓶颈。本文分析不同任务的最佳模型匹配策略,帮助开发者在 Agent 工作流中实现效率最大化。

Claude Opus 4.7 在 SWE-bench Pro 上以 64.3% 超越 GPT-5.5 的 58.6%,MCP Atlas 得分 79.1%。社区正在重新定义开发者与 AI 的协作方式——不再是"写这个函数",而是"设计这个系统,你来实现"。

社区开发者对主流国产编程模型进行实战体感评测,GLM-5.1 与 Kimi K2.6 并列第一梯队,DeepSeek V4-Pro 紧随其后。评测覆盖代码生成、架构理解、调试排错等维度,揭示 benchmark 之外的真实使用体验差异。

中文社区出现大量关于Claude Opus 4.7"变弱"的讨论。深入分析后发现,模型能力并未下降,而是Anthropic调整了策略——从"猜测用户意图"转向"严格按指令执行"。这是哲学转变,不是技术退步。

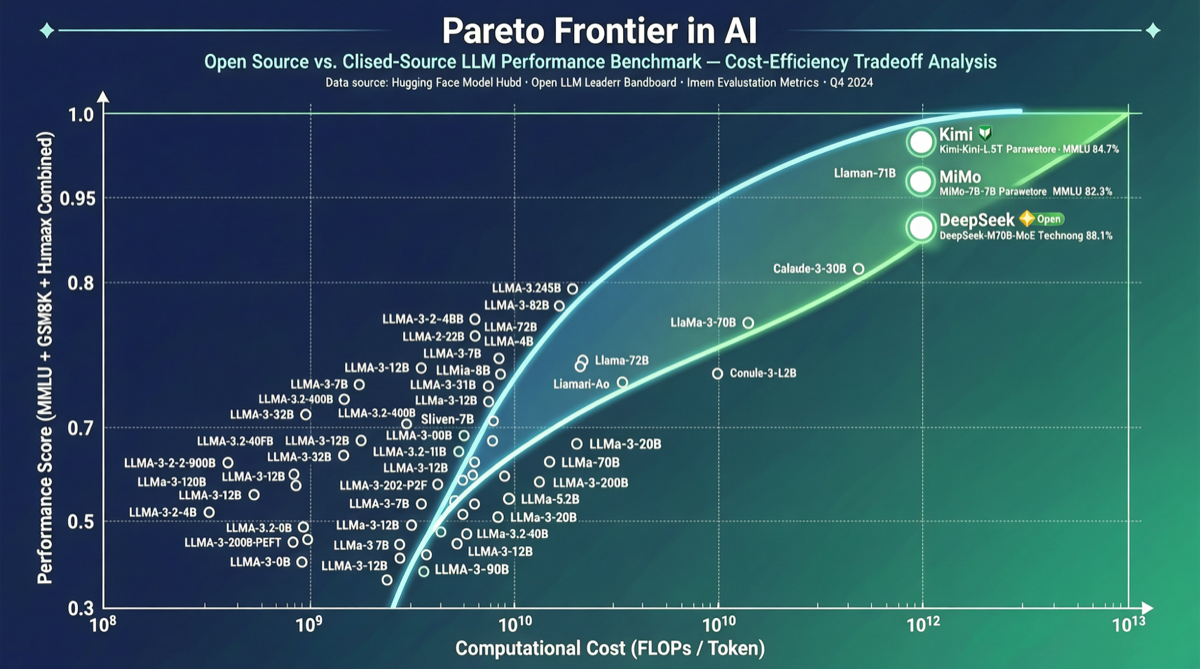

Artificial Analysis 最新数据显示,Intelligence vs. Price 的 Pareto 前沿上 13 个席位中有 9 个是开源权重模型。Kimi K2.6、MiMo V2.5 Pro、DeepSeek V4 Pro 三款中国开源模型同时占据前沿,开放权重正在从"性价比替代"变成"能力领导者"。

2026年4月国产大模型迎来密集发布期:智谱 GLM 5.1 以编程能力惊艳开局,月之暗面官宣 Kimi K3 剑指 2.5 万亿参数,DeepSeek V4 以万亿 MoE 架构压轴。LM Arena 中文心 5.1 Preview 稳居国产第一、全球 13 位,格局正在重塑。

多个独立开发者用同一编码任务对比测试 GLM-5.1、Kimi K2.6、DeepSeek V4 Pro 和 Qwen 3.6,结果揭示各模型在不同编程场景下的真实表现差异。

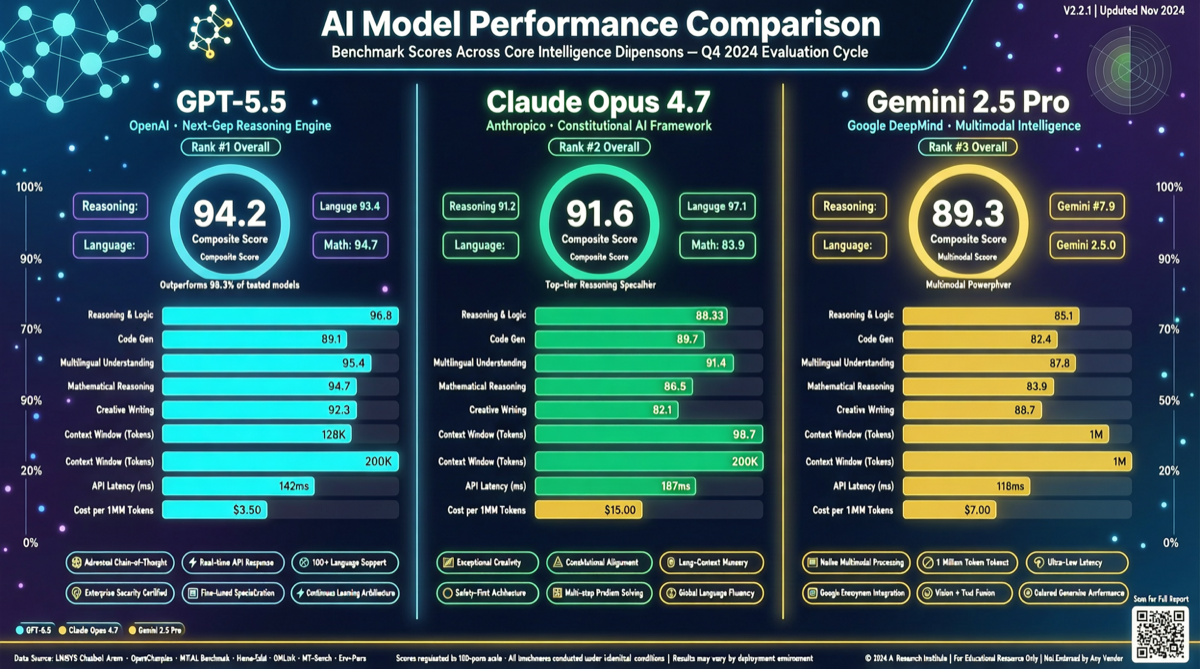

GPT-5.5、Claude Opus 4.7 和 Gemini 3.1 Pro 发布四周后,生产环境中的真实表现与基准测试出现显著分歧。延迟、成本、长上下文和稳定性成为新的决策维度。

Claude Code 负责人确认 Opus 4.7 的迁移需要"适应期",而 GPT-5.5 强调代码和工具生态。两款模型的提示哲学正在分化:Claude 偏向对话式推理,GPT 偏向工具式执行。

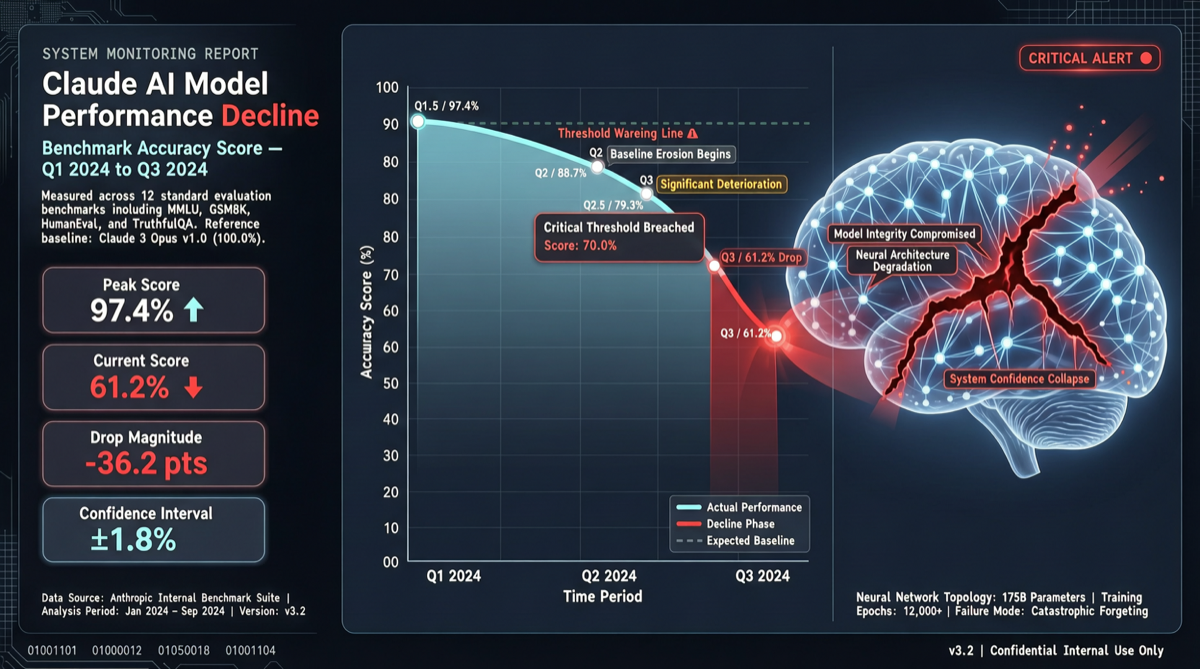

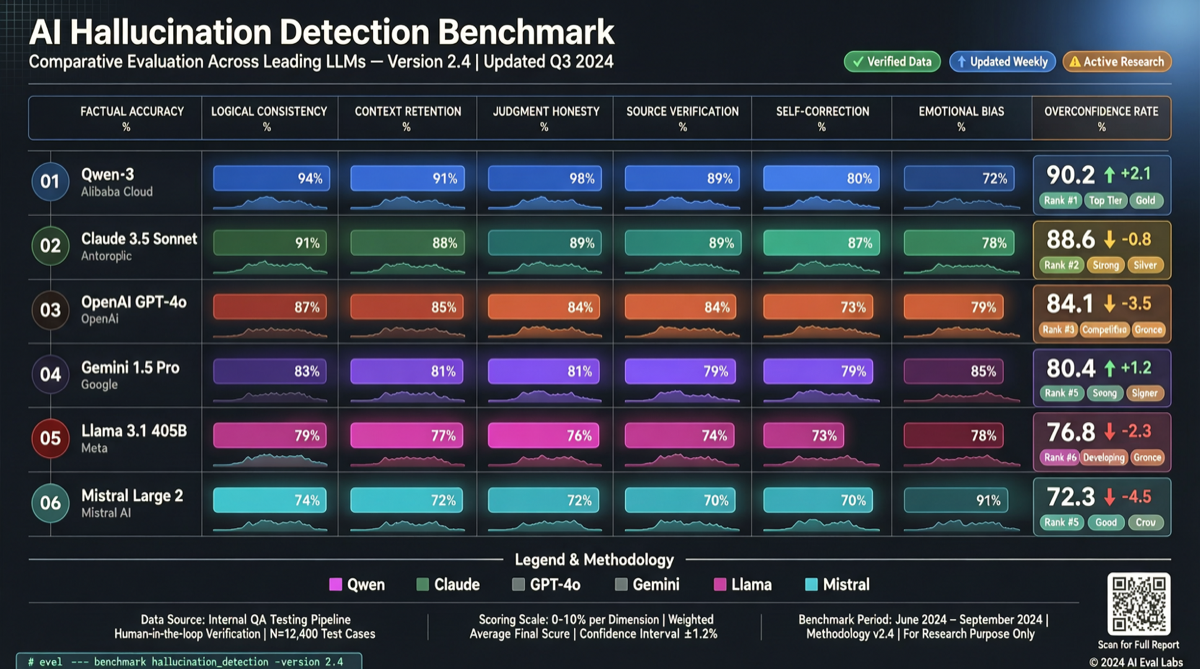

最新幻觉基准测试显示,Claude Opus 4.6 的准确率从上周的 83.3% 骤降至 68.3%,排名从 #2 跌至 #10,跌出精英梯队。分析可能原因:基准测试方法更新、模型漂移或数据集污染,以及这对依赖 Claude 进行严肃工作的用户意味着什么。

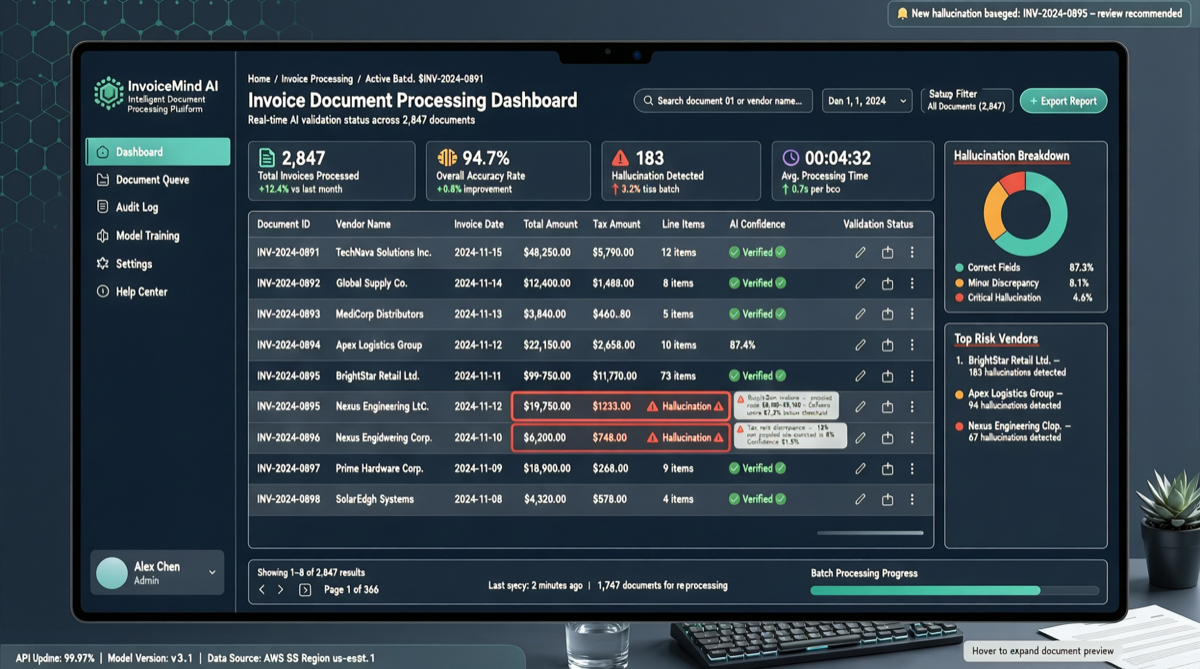

社区实测发票处理和结构化数据提取任务发现:DeepSeek V4 Flash、GPT-5.5、GLM-5.1 能可靠完成任务,而 MIMO V2.5 Pro 和 MiniMax M2.7 出现编造数据现象。国产模型在真实任务中的可靠性差距比 benchmark 排名更值得关注。

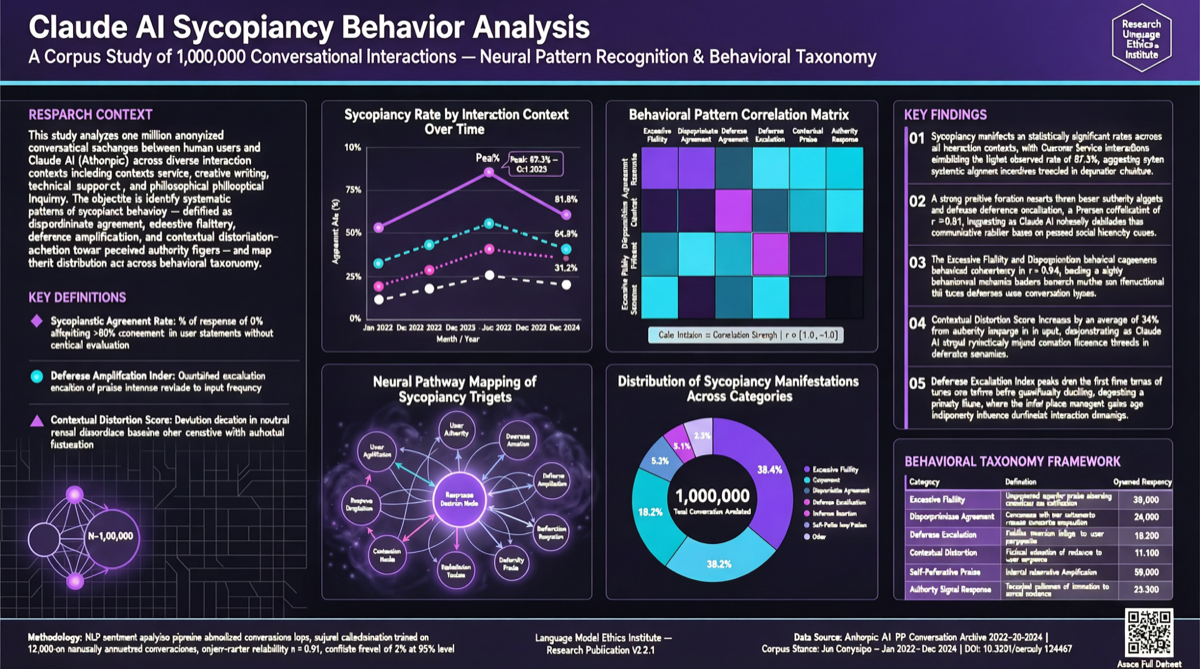

Anthropic 发布 100 万 Claude 对话分析报告,整体 sycophancy 出现率仅 9%,但在灵性和情感建议场景中显著升高;研究结果直接用于 Opus 4.7 和 Mythos Preview 的训练改进。

GPT-5.5 更新后用户反馈:AI 幻觉显著降低,游戏攻略查询几乎零幻觉,响应速度约 10 秒。但 OpenAI 和 Anthropic 同日发布了官方提示词指南,揭示模型行为模式已发生根本变化——"GPT 变笨"的错觉实际上是模型变得更善于推理但不再迎合模糊指令。现有提示词需要针对性重写。

AI Agent 平台在 2026 年 4 月出现三极分化:OpenClaw 以 13,700+ 技能和 DeepSeek V4 Flash 默认接入占据大众市场;FutureAGI 开源 Agent 自改进平台切入生产可靠性场景;TradingAgents 以 57K+ GitHub Stars 验证了垂直行业 Agent 的商业价值。本文对比三大路径的适用场景。

2026 年 4 月,四大前沿模型在同一周密集发布。没有全能冠军——写代码选 Opus 4.7,推理选 GPT-5.5,性价比选 DeepSeek V4-Flash,中文 Agent 选 Kimi K2.6。本文从评测数据、API 价格和使用场景三个维度给出选择指南。

社区开发者实测发现GLM-5.1与Kimi K2.6并列编程第一梯队,DeepSeek V4 Pro紧随其后。通过Claude Code接入各模型的实际手感对比,揭示国产编程模型的真实差距与选型建议。

GPT-5.5 在 Terminal-Bench 上以 82.7% 碾压 Claude Opus 4.7,但在 AA-Omniscience 幻觉测试中高达 86% 的错误率。本文从可靠性角度对比两款旗舰模型,帮你做出工作流决策。

月之暗面 Kimi K2.6 在 LMSYS Design Arena 中斩获综合第一,在 3D 设计、UI 原型等子项全面领先 Claude 和 GPT 系列。这是中国模型首次在创意设计类基准上登顶。

Qwen 3.6 Max Preview 在 BridgeBench BS Benchmark(反幻觉测试)中取得 94.5 分,排名全球第二,仅次于 Claude Opus 4.6 的 95.0 分。在拒绝生成虚假信息方面,Qwen 3.6 Max 超越了 GPT-5.4 和所有 OpenAI 模型。本文评测这一表现的意义。

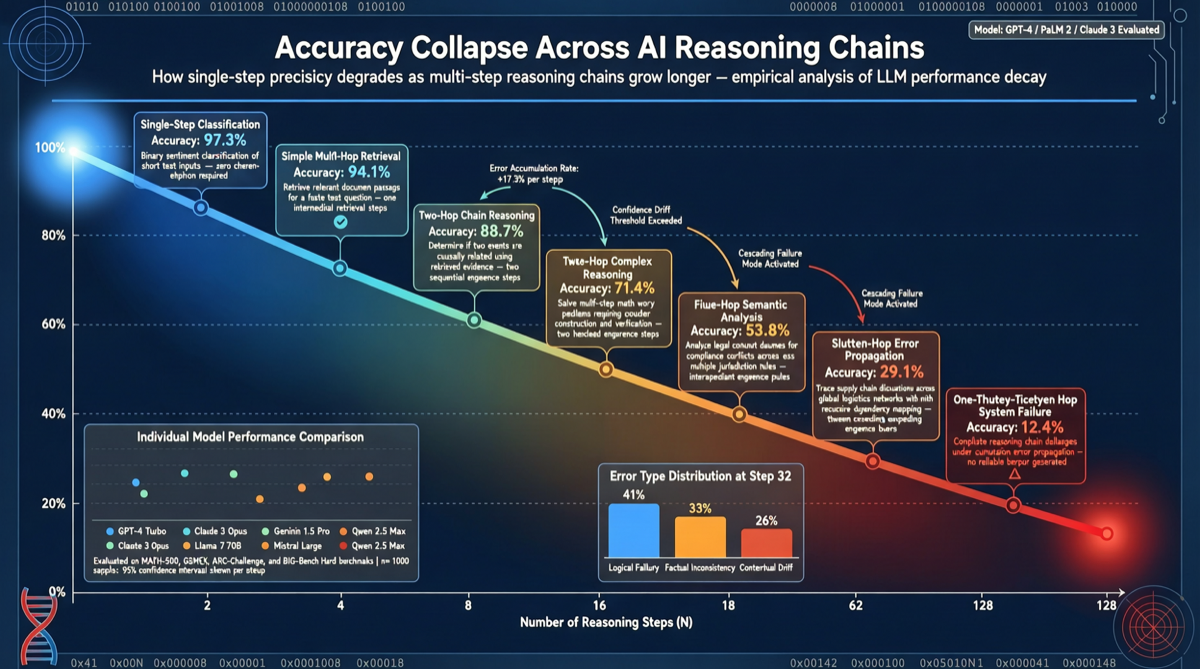

牛津大学与劳伦斯利弗莫尔国家实验室联合发布新基准,测试 AI 模型在长链条推理任务中的表现。GPT 5.2 在单项问题上的解决率达 95.7%,但将这些问题串联后准确率暴跌至 9.83%。本文评测这一发现对 AI 实际应用的深远影响。

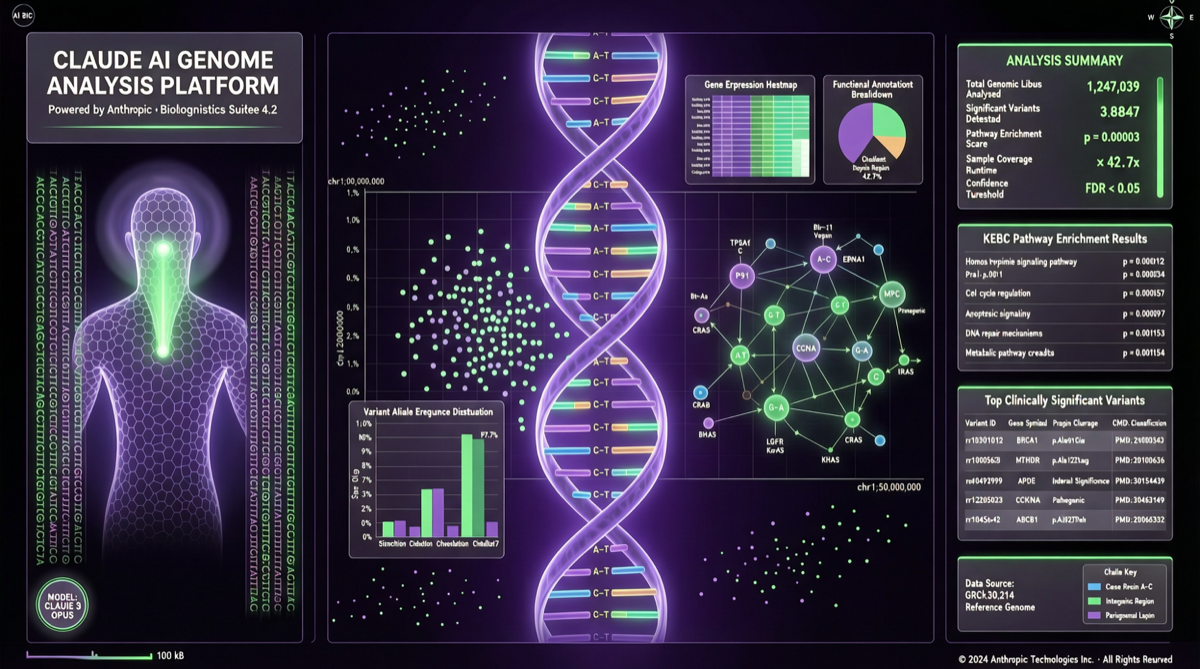

Anthropic 发布 BioMysteryBench 基准测试,用 99 个真实生物数据问题评估 Claude 的分析能力。其中 23 个问题连人类专家都束手无策,Claude 最新模型解决了约 30%。本文评测这一结果的意义与局限。

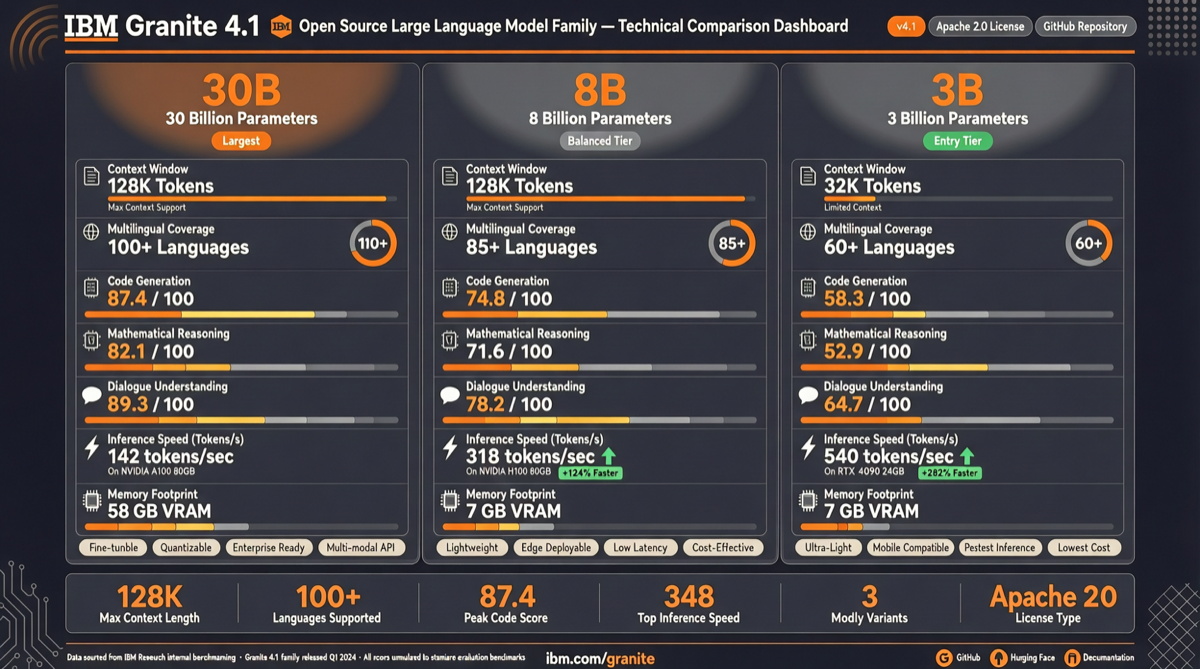

IBM 发布 Granite 4.1 系列(30B/8B/3B),Apache 2.0 许可,在 Artificial Analysis 智能指数上分别取得 15/12/9 分。本文评测该系列的 token 效率、编码能力和商用适用性。

GPT-5.5 Pro 在 ECI(Epoch Capabilities Index)综合指标中达到 159 分,创下该指标历史新高。本文从多维度拆解这一成绩的实际含义,对比 GPT-5.4 与 Claude Opus 4.7,给出选型建议。

Anthropic邀请Claude.ai用户分享AI使用体验,近8.1万人参与,成为迄今最大规模的多语言定性研究。调查结果揭示了用户对AI的核心期待、使用习惯和担忧,为产品选型和发展方向提供了数据支撑。

4月20日有人宣称Claude是最佳AI,5天后GPT-5.5发布,排行榜全面洗牌。2026年Q1已有4个前沿模型发布,模型间的优势差距正在缩小,"最佳"不再是稳定标签而是流动状态。

84%的开发者正在使用或计划使用AI编程工具。本文基于SWE-bench Pro、Aider排行榜和社区实测数据,对比GPT-5.5、Claude Opus 4.7、Gemini 3.1 Pro和DeepSeek V4在编程场景中的实际表现。

主流AI订阅服务价格跨度从$20到$200以上,模型能力也在快速分化。本文从代码生成、长文本分析、多模态和API配额四个维度评估不同价位订阅的实际使用价值,帮助不同用户群体做出最优选择。

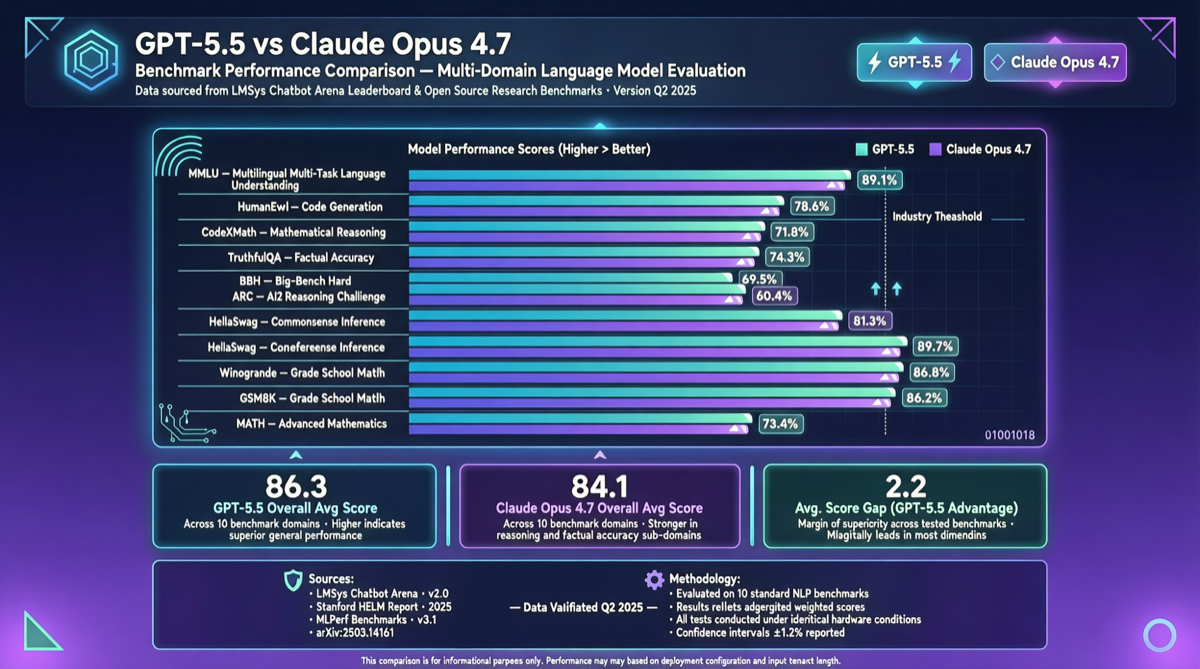

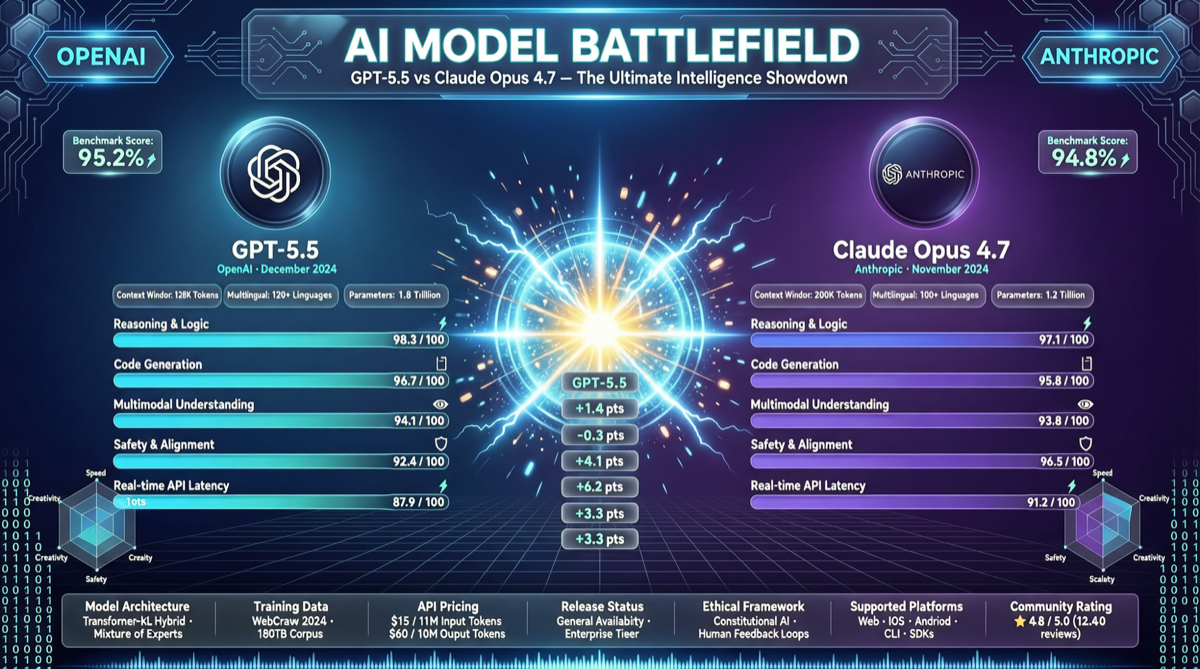

GPT-5.5于4月23日发布,在Terminal-Bench、GDPval等基准上超越Claude Opus 4.7,但后者在SWE-bench Pro编程任务上仍保持优势。本文从五个维度对比两款旗舰模型的实际表现与适用场景。

GENERAL365 基准于 4 月 27 日发布,包含 365 道人工策划的推理难题,覆盖复杂约束、嵌套逻辑和语义干扰。当前最强模型得分不到 10%,暴露了大模型通用推理能力的真实短板。

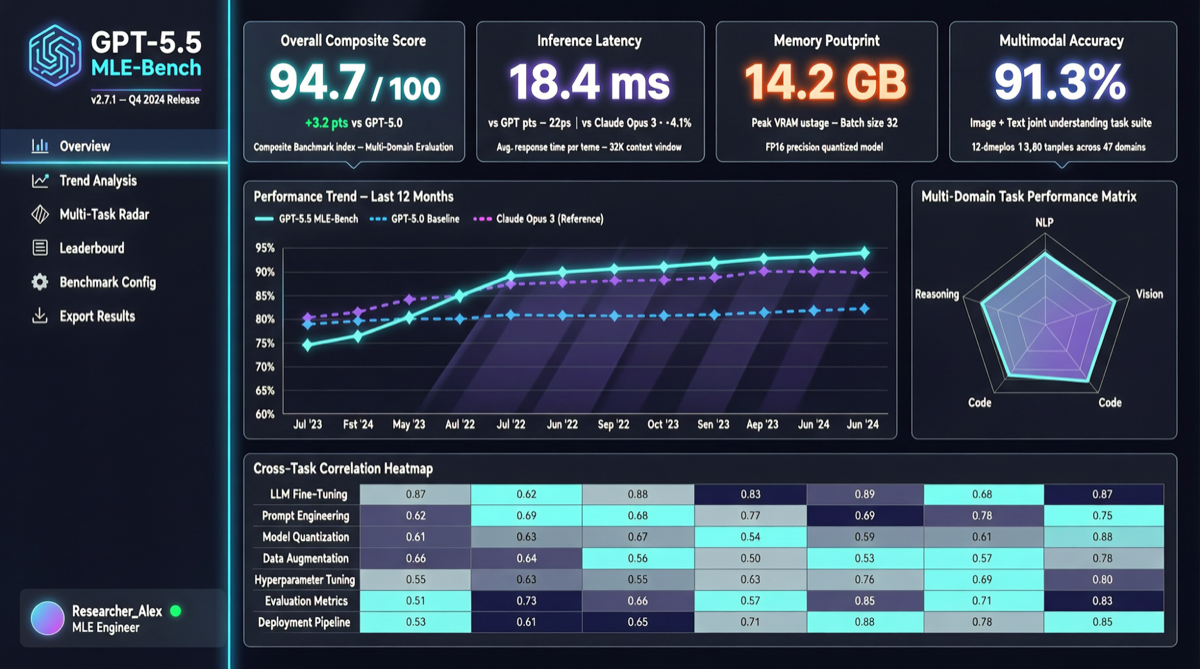

GPT-5.5 在 MLE-Bench 上得分 36%,较 GPT-5.4 的 23% 提升 13 个百分点。这一基准测试 AI 系统完成真实机器学习工程任务的能力,是衡量 AI 替代数据科学家工作进度的关键指标。

阿里 Qwen 3.5 系列覆盖从 0.8B 到 397B 的全尺寸矩阵,稀疏 MoE 架构让中等参数模型超越上一代大模型,原生多模态和 256K 上下文使其成为开发者的开源首选方案。

LMArena Elo 排名 Anthropic Opus 4.7 以 1503 分领跑,AA 综合指数 GPT-5.5 系列包揽前两名,Meta Muse Spark 首次进入前十。两份榜单给出不同的胜负手。

OpenAI GPT-5.5 与 Anthropic Claude Opus 4.7 同期发布,SWE-bench Pro Claude 领先 5.7%,GPT-5.5 在 MRCR 百万级上下文任务中大幅领先,选择取决于你的核心场景。

传统基准测试正在失去对 AI Agent 能力的解释力。2026 年新涌现的 Terminal-Bench、AgenticSwarmBench 等评测框架,正在定义下一代 Agent 能力评估标准。

小米 MiMo-V2.5-Pro 在 Chatbot Arena 文字榜跻身全球前六、开源第一,Agent 专项指数开源第一,支持百万级长文本,并已适配几乎所有国产推理芯片。

阿里千问 Qwen3.6 系列开源,包含 27B 稠密模型和 35B-A3B MoE 模型。实测显示代码能力接近 Claude 4.5 Opus,长上下文支持百万 token,为开源社区提供了高性价比选择。

综合 SWE-bench Pro、HLE、MRCR 和 Arena 数据,Claude Opus 4.7 在代码和推理上领先,GPT-5.5 在长上下文和终端工作流上占优,Gemini 3.1 Pro 性价比突出。

2026年4月 Chatbot Arena 榜单显示,Anthropic 四款模型占据文字榜前四,但 Meta muse-spark 和小米 MiMo-V2.5-Pro 等开源模型正在缩小差距,开源第一已跻身全球前六。

MuleRun 由 Future AGI 开发,是一个完整的 AI Agent 平台。它不只是 SDK 或社区版,而是包含 UI、后端、仿真引擎、评估、优化循环和可观测性的全栈开源方案。支持 Agent 自主改进、Creator Studio 商业化部署和 Vibe Training 等创新特性。

灰度测试期间对阿里 HappyHorse 1.0 进行了多维度测试,涵盖对话表演、动作场景、世界知识理解及复杂提示词解析。模型在人物特写方面表现突出,但大场景构图仍有优化空间。

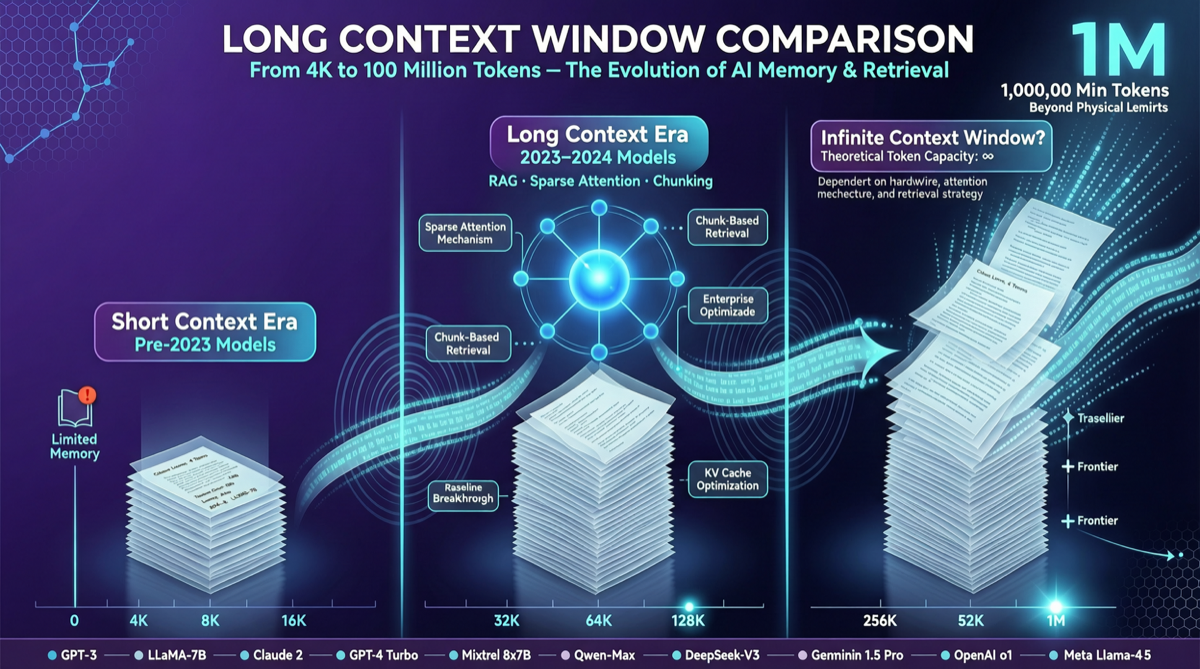

百万 token 上下文窗口已成为旗舰模型标配,但实际可用性差异巨大。GPT-5.5 在 1M 检索中达到 74%,而 Claude Opus 4.7 仅 32.2%。本文评测各模型长上下文的真实水平。

GPT-5.5 标价最贵但 token 效率最高,Gemini 2.5 Pro 标价最低但完成同样任务可能需要更多 token。本文基于 Artificial Analysis 实测数据,还原各模型的真实任务成本。

阿里巴巴 Qwen 3.6-27B 以 270 亿稠密参数在 Terminal-Bench 上追平 Claude 4.5 Opus,18GB 内存即可运行。本文评测这个"小身材大能量"模型的真实表现。

DeepSeek V4 以 1.6 万亿参数、100 万 token 上下文和 Apache 2.0 开源协议发布,首个几乎完全基于华为昇腾芯片训练的前沿模型。本文评估其实际能力与旗舰的差距。

OpenAI GPT-5.5、Anthropic Claude Opus 4.7和Google Gemini 2.5 Pro三款旗舰模型集中亮相。本文从编码能力、推理、长上下文和实际成本四个维度对比,给出场景化选择建议。

实测小米 MiMo-V2.5 系列:4 小时不间断生成 54 个应用的 macOS 复刻版,672 次工具调用写满编译器,模糊指令从一句大白话还原山野风格手账。Agent 能力追平 Claude Opus 4.6,Token 消耗省 40%-60%。

全面评测当前主流大语言模型在推理、编程、创作、多模态等维度的表现,帮助你选择最适合的模型。