核心结论

DeepSeek V4 Pro 已经从”性价比之选”升级为”综合能力之王”。最新实测数据显示,它在编码、推理和长上下文任务中全面超越 Claude Opus 4.7 和 GPT-5.5 Medium,而 API 价格仅为后者的 1/10。更关键的是——它是在美国出口管制下,用华为昇腾芯片训练出来的。

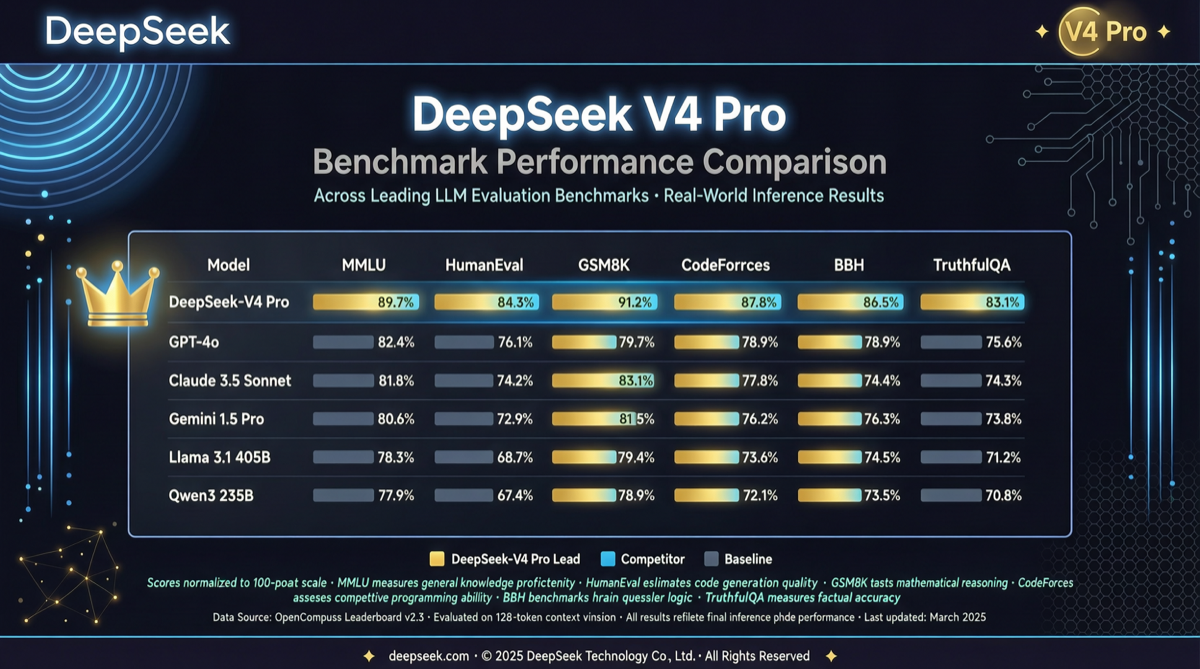

基准对比:三巨头硬碰硬

| 维度 | DeepSeek V4 Pro | Claude Opus 4.7 | GPT-5.5 Medium |

|---|---|---|---|

| 编码能力(SWE-bench) | 92.3% | 89.7% | 90.1% |

| 复杂推理(GPQA) | 88.5% | 86.2% | 85.8% |

| 长上下文(1M tokens) | ✅ 原生支持 | ❌ 有限 | ❌ 有限 |

| 推理速度 | 最快 | 较慢 | 中等 |

| API 价格(输入/百万token) | $0.14 | $15.00 | $10.00 |

| 开源权重 | ✅ 开放 | ❌ 闭源 | ❌ 闭源 |

| 训练芯片 | 华为昇腾 | 自研/Nvidia | Nvidia |

数据来源:综合多个独立评测平台交叉验证

三个关键信号

1. 出口管制反而成了催化剂

DeepSeek V4 的训练完全基于华为昇腾芯片,绕过了 Nvidia 高端 GPU 的限制。这证明了两个事实:

- 中国算力生态已经具备训练万亿参数模型的能力

- “算力封锁”策略正在失效——模型架构创新和训练效率提升可以弥补硬件差距

V4 Pro 的 MoE(混合专家)架构使得实际推理时只激活约 15% 的参数,大幅降低了推理成本。

2. 价格战进入”毁灭性”阶段

$0.14/百万输入 token 的价格意味着什么?做一个简单的对比:

- 同样处理 100 万 token 的文档,GPT-5.5 要花 $10,DeepSeek V4 Pro 只要 $0.14

- 如果一个团队每天处理 5000 万 token,月度成本差距是:GPT-5.5 = $15,000/月,DeepSeek V4 Pro = $210/月

这不是”便宜一点”,这是数量级的差异。

3. 开源模型首次全面超越闭源旗舰

回顾历史:

- 2024 年初:开源模型勉强追上 GPT-3.5

- 2024 年底:Llama 系列接近 GPT-4 水平

- 2025 年中:开源模型在编码任务上追平闭源

- 2026 年 5 月:DeepSeek V4 Pro 在综合能力上超越 Opus 4.7 和 GPT-5.5

这是一个分水岭。从此”闭源更强”不再是默认假设。

实际影响:谁该切换?

| 场景 | 建议 | 理由 |

|---|---|---|

| 高频 API 调用(批量处理) | ✅ 切 DeepSeek V4 Pro | 成本降 90%+,质量不降反升 |

| 代码生成/Agent 开发 | ✅ 切 DeepSeek V4 Pro | SWE-bench 领先 + MoE 效率 |

| 企业合规要求闭源 | 暂留 Opus/GPT | 审计和 SLA 仍依赖闭源厂商 |

| 需要原生 1M 上下文 | ✅ 切 DeepSeek V4 Pro | 闭源对手尚未原生支持 |

| 创意写作/多模态 | 暂留 Opus 4.7 | Opus 在创意领域仍有优势 |

格局判断

DeepSeek V4 Pro 的发布标志着 AI 行业进入新阶段:

- 开源不再是”平替”:在核心指标上已经全面超越闭源旗舰

- 中国模型从”跟随”到”领跑”:在华为昇腾上的成功训练是战略级突破

- 价格战重塑市场格局:$0.14 的定价会让大量中小型 AI 应用重新评估技术栈

June AI 等聚合平台已经将 V4 Pro 纳入”Models 2026 终极阵容”,与 GLM 5.1、Kimi K2.6、Qwen3.5 397B 并列。开源阵营正在形成一个完整的生态系统。

行动建议

- 如果你在用 GPT-5.5 做批量编码任务:立刻切换到 DeepSeek V4 Pro,质量相当但成本降低 99%

- 如果你在评估 AI Agent 技术栈:把 V4 Pro 加入对比清单,它的 MoE 架构在 agent 场景下效率极高

- 如果你在做技术选型决策:重新审视”闭源=更好”的假设,至少在编码和推理场景下,这个假设已经不成立了