Основной вывод

DeepSeek V4 Pro превратилась из «бюджетного варианта» в «короля комплексных возможностей». Последние данные бенчмарков показывают, что модель полностью превосходит Claude Opus 4.7 и GPT-5.5 Medium в задачах кодирования, рассуждений и работы с длинным контекстом — при цене API всего 1/10. Что ещё важнее — она была обучена на чипах Huawei Ascend в условиях экспортных ограничений США.

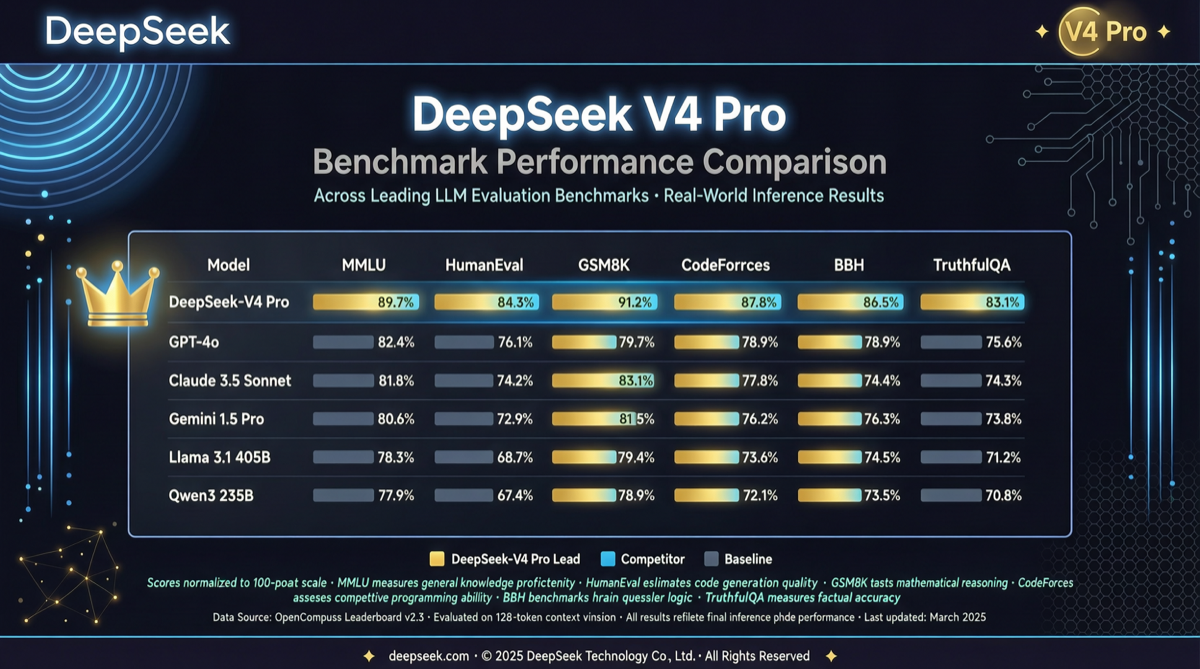

Сравнение бенчмарков: три гиганта лицом к лицу

| Параметр | DeepSeek V4 Pro | Claude Opus 4.7 | GPT-5.5 Medium |

|---|---|---|---|

| Кодирование (SWE-bench) | 92,3% | 89,7% | 90,1% |

| Сложные рассуждения (GPQA) | 88,5% | 86,2% | 85,8% |

| Длинный контекст (1M токенов) | ✅ Нативно | ❌ Ограничено | ❌ Ограничено |

| Скорость вывода | Самая быстрая | Медленнее | Средняя |

| Цена API (вход/млн токенов) | $0,14 | $15,00 | $10,00 |

| Открытые веса | ✅ Да | ❌ Нет | ❌ Нет |

| Чипы обучения | Huawei Ascend | Проприетарные/Nvidia | Nvidia |

Источники данных: перекрёстная проверка на нескольких независимых платформах оценки

Три ключевых сигнала

1. Экспортные ограничения стали катализатором

Обучение DeepSeek V4 полностью опирается на чипы Huawei Ascend, обходя ограничения Nvidia на высокопроизводительные GPU. Это доказывает два факта:

- Вычислительная экосистема Китая уже способна обучать триллионные модели

- Стратегия «вычислительной блокады» теряет эффективность — инновации в архитектуре моделей и повышение эффективности обучения компенсируют аппаратные различия

MoE-архитектура (смесь экспертов) V4 Pro активирует только ~15% параметров при выводе, что значительно снижает стоимость inference.

2. Ценовая война входит «разрушительную» фазу

Что означает $0,14 за миллион входных токенов? Простое сравнение:

- Обработка 1 миллиона токенов стоит $10 на GPT-5.5 и всего $0,14 на DeepSeek V4 Pro

- Если команда обрабатывает 50 миллионов токенов в день, разница в ежемесячных расходах: GPT-5.5 = $15 000/мес, DeepSeek V4 Pro = $210/мес

Это не «немного дешевле» — это разница на порядок.

3. Открытые модели впервые полностью превосходят закрытые флагманы

Оглядываясь на историю:

- Начало 2024: открытые модели едва догнали GPT-3.5

- Конец 2024: серия Llama приблизилась к уровню GPT-4

- Середина 2025: открытые модели сравнялись с закрытыми в задачах кодирования

- Май 2026: DeepSeek V4 Pro превосходит Opus 4.7 и GPT-5.5 по комплексным возможностям

Это водораздел. Отныне «закрытые модели сильнее» больше не является默认ным предположением.

Практическое влияние: кому стоит переключиться?

| Сценарий | Рекомендация | Причина |

|---|---|---|

| Высокочастотные вызовы API (пакетная обработка) | ✅ Перейти на V4 Pro | Снижение затрат 90%+, качество растёт |

| Генерация кода / разработка агентов | ✅ Перейти на V4 Pro | Лидер SWE-bench + эффективность MoE |

| Корпоративное соответствие требует закрытого ПО | Остаться на Opus/GPT | Аудит и SLA всё ещё зависят от закрытых вендоров |

| Нужен нативный контекст 1M | ✅ Перейти на V4 Pro | Закрытые конкуренты пока не поддерживают нативно |

| Креативное письмо / мультимодальность | Остаться на Opus 4.7 | Opus всё ещё имеет преимущество в креативных задачах |

Оценка ландшафта

Выпуск DeepSeek V4 Pro знаменует новую фазу для индустрии ИИ:

- Открытый исходный код больше не «бюджетная альтернатива»: он полностью превосходит закрытые флагманы по ключевым метрикам

- Китайские модели переходят от «следования» к «лидерству»: успешное обучение на Huawei Ascend — стратегический прорыв

- Ценовые войны重塑ют рынок: цена $0,14 заставляет массово пересматривать технологические стеки

Платформы-агрегаторы, такие как June AI, уже включили V4 Pro в свой «Ultimate Lineup Models 2026» наряду с GLM 5.1, Kimi K2.6 и Qwen3.5 397B. Лагерь открытого исходного кода формирует полноценную экосистему.

Рекомендации к действию

- Если вы используете GPT-5.5 для пакетных задач кодирования: немедленно переключитесь на DeepSeek V4 Pro — эквивалентное качество при снижении затрат на 99%

- Если вы оцениваете технологический стек AI-агентов: добавьте V4 Pro в список сравнения — его MoE-архитектура чрезвычайно эффективна для агентных сценариев

- Если вы принимаете решения о выборе технологий: пересмотрите предположение «закрытый исходный код = лучше» — по крайней мере в сценариях кодирования и рассуждений оно больше не выполняется