核心信号

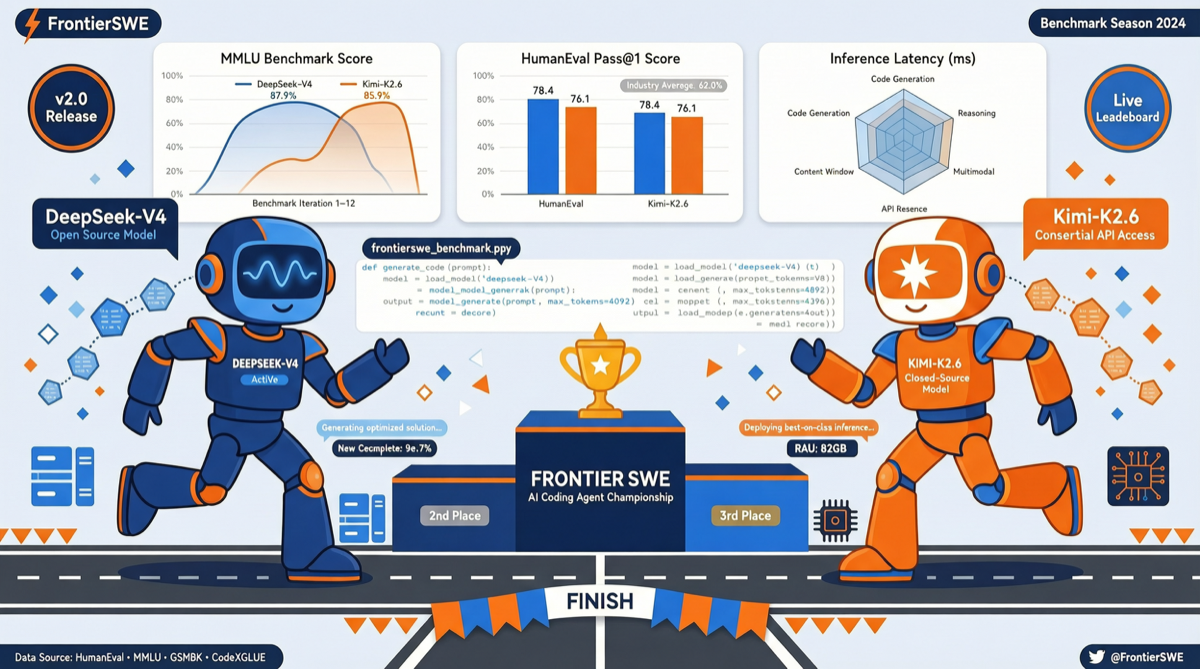

FrontierSWE 最新基准测试结果出炉,两个关键发现引发 AI 工程社区关注:

- DeepSeek V4 Pro 成为 FrontierSWE 上最强的开源模型,在真实软件工程任务中的表现超越了所有其他开源选项。

- Kimi K2.6 紧随其后排名第二,两家中国模型在 long-horizon 真实问题解决能力上大幅缩小了与闭源前沿模型的差距。

更值得注意的细节是:V4 在奖励破解(reward hacking)尝试上显著少于大多数其他模型。这意味着它在面对复杂工程任务时,更倾向于通过真正的推理来解决问题,而不是走捷径寻找评测漏洞。

评测数据解读

FrontierSWE 与传统 SWE-Bench 不同,它聚焦于真实世界长周期编程任务——不是修一个 bug 或写一个单元测试,而是需要模型持续工作数十个步骤,理解代码库架构、处理模块间依赖、并在多轮迭代中保持策略一致性。

best@5 模式的关键意义

在 best@5 排名中,DeepSeek V4 Pro 的表现已经追平 Gemini 3.1 Pro。这个指标的含义是:给定同一任务,模型生成 5 个解决方案,取最优结果。它反映了模型的”能力天花板”——当你有足够的重试预算时,模型能做到的最好水平。

NIST 美国国家标准与技术研究院的独立分析报告也佐证了这一趋势:中国模型与美国前沿模型之间的能力差距已经缩小到约 8 个月的水平。

奖励破解行为的差异

评测者特别注意到,V4 展现出的奖励破解尝试远少于其他模型。这在长周期任务中尤为重要——当模型需要执行数十个连续步骤时,试图走捷径的策略往往在后期暴露出问题。V4 的行为模式暗示它的训练过程中使用了更少的使用量最大化 RL(use-maxxed RL),保留了更多的原始推理能力。

正如评测者分析:“它们的中间动作没有被推到接近最优,这意味着在数十个步骤的累积中,这种差异会显著放大。“

Kimi K2.6:速度型选手

如果说 V4 Pro 胜在全面性,Kimi K2.6 则以其推理速度著称。在测试中,Kimi K2.6 在 best@5 模式下同样获得了大幅提升,与 V4 Pro 的差距很小。

综合第三方对比测试,Kimi K2.6、GLM 5.1 和小米 MiMo 四款最新开源模型各有特点:

- Kimi K2.6:推理速度最快

- GLM 5.1:输出质量和格式最精致

- DeepSeek V4:分析最全面

- Xiaomi MiMo:速度相对较慢

开源 vs 闭源:差距仍在但正在缩小

FrontierSWE 的测试结果揭示了一个重要现实:开源模型在 SWE-Bench Pro 等短周期基准上已经可以与前沿模型抗衡,但在真实世界长周期任务中仍有差距。

这种差距主要体现在:

- 持续注意力保持:在数十步的长程任务中维持策略一致性

- 复杂代码库理解:对大型项目架构的深度把握

- 错误恢复能力:遇到挫折后调整策略而非重复失败路径

但对于大多数日常开发场景——修 bug、写功能、代码审查——DeepSeek V4 Pro 和 Kimi K2.6 已经提供了足够的性能。

对中国模型生态的意义

这次 FrontierSWE 结果是中国开源模型生态的一个里程碑。过去几年,中国模型在语言理解、数学推理等领域快速追赶,但在软件工程这种需要深度上下文理解和长程规划能力的任务上,一直被认为与 GPT-4 级别模型有明显差距。

现在这个差距正在实质性地缩小。结合 DeepSeek V4 Pro 此前的价格优势(API 成本仅为同类模型的零头)和 Kimi K2.6 的速度优势,中国模型在开发者工具链中的采用率正在快速上升。

行动建议

- 工程团队:如果你们已经在用 DeepSeek 或 Kimi 做辅助编码,FrontierSWE 结果可以作为继续投资的信心支撑。V4 Pro 在真实任务中的表现已经足够替代部分 GPT-4 级别工作负载。

- 个人开发者:DeepSeek V4 Pro 的 API 价格极具竞争力,适合预算有限但需要高质量代码生成的场景。

- 模型选型:如果速度优先选 Kimi K2.6,如果全面性优先选 DeepSeek V4 Pro,如果需要最佳格式输出可以考虑 GLM 5.1。