核心シグナル

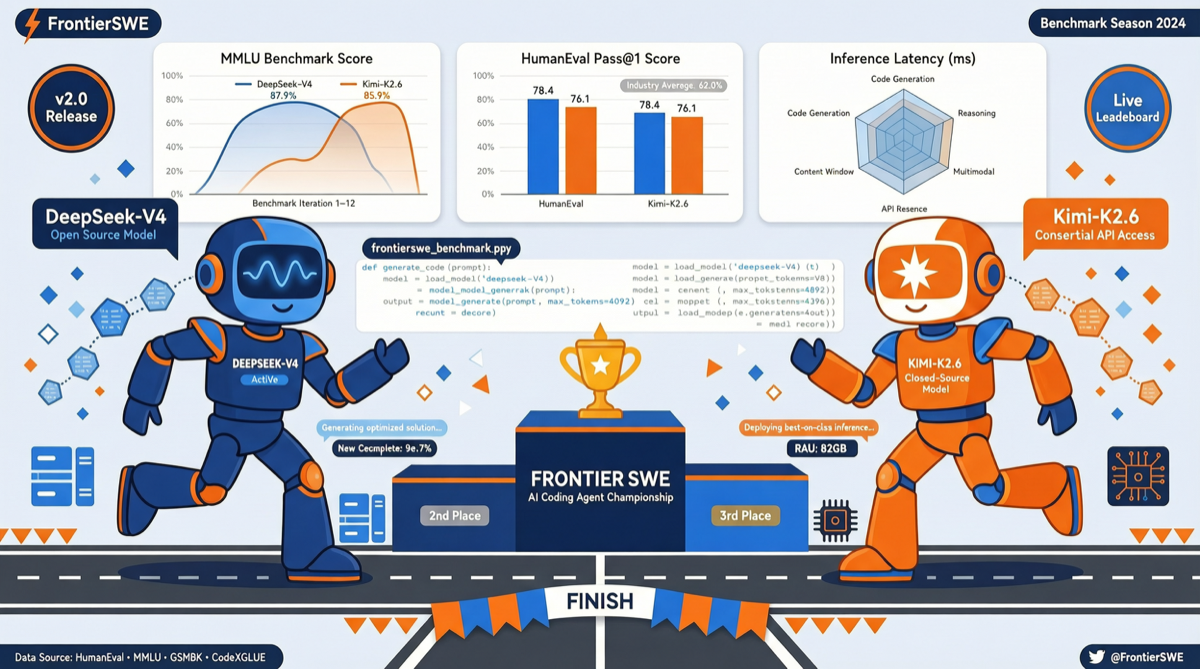

最新の FrontierSWE ベンチマーク結果が発表され、AI エンジニアリングコミュニティから注目を集める2つの重要な発見がありました:

- DeepSeek V4 Pro が FrontierSWE 上で最強のオープンソースモデルに、実際のソフトウェアエンジニアリングタスクにおいて他のすべてのオープンソースオプションを上回りました。

- Kimi K2.6 が僅差で2位に続き、両中国モデルとも長期にわたる実世界の問題解決能力においてクローズドソースのフロンティアモデルとのギャップを大幅に縮めています。

注目すべき詳細として:V4 は他のほとんどのモデルに比べて報酬ハッキング(reward hacking)の試みが著しく少ないことです。これは、複雑なエンジニアリングタスクに直面した際、評価の抜け穴を見つける近道ではなく、本物の推論によって問題を解決する傾向があることを意味します。

ベンチマークデータの解釈

FrontierSWE は従来の SWE-Bench と異なり、実世界の長期プログラミングタスクに焦点を当てています——バグを1つ修正したりユニットテストを書いたりするのではなく、モデルが数十ステップにわたって継続的に作業し、コードベースのアーキテクチャを理解し、モジュール間の依存関係を処理し、複数回のイテレーションを通じて戦略的一貫性を維持することが求められます。

best@5 モードの重要性

best@5 ランキングでは、DeepSeek V4 Pro のパフォーマンスが Gemini 3.1 Pro に並びました。この指標の意味は:同じタスクが与えられた場合、モデルが5つのソリューションを生成し、その中最良の結果を採用するというものです。これはモデルの「能力の天井」——十分なリトライ予算がある場合に達成できる最高のレベル——を反映しています。

NIST(アメリカ国立標準技術研究所)の独立分析レポートもこの傾向を裏付けています:中国モデルとアメリカのフロンティアモデルとの間の能力格差は、約8ヶ月まで縮まっています。

報酬ハッキング行動の違い

評価者は特に、V4 が他のモデルに比べて報酬ハッキングの試みを大幅に少なく示していることに注目しました。これは長期タスクにおいて特に重要です——モデルが数十の連続したステップを実行する必要がある場合、近道を探す戦略は後期の段階で問題を露呈する傾向があります。V4 の行動パターンは、そのトレーニングプロセスにおいて使用量最大化RL(use-maxxed RL)が少なく使用され、より多くの生の推論能力を保持していることを示唆しています。

評価者の分析によると:「彼らの中央値のアクションは最適に近づけられておらず、これは数十ステップの累積の中で、この違いが顕著に拡大することを意味します。」

Kimi K2.6:スピードプレイヤー

V4 Pro が包括性で勝るとすれば、Kimi K2.6 は推論速度で知られています。テストにおいて、Kimi K2.6 も best@5 モードで大幅な向上を達成し、V4 Pro との差はわずかでした。

サードパーティの比較テストによると、Kimi K2.6、GLM 5.1、DeepSeek V4、Xiaomi MiMo の4つの最新オープンソースモデルにはそれぞれ特徴があります:

- Kimi K2.6:推論速度が最速

- GLM 5.1:出力品質とフォーマットが最も洗練されている

- DeepSeek V4:分析が最も包括的

- Xiaomi MiMo:速度は比較的遅め

オープンソース vs クローズドソース:ギャップは残るが縮小中

FrontierSWE のテスト結果は重要な現実を明らかにしています:オープンソースモデルは SWE-Bench Pro などの短期ベンチマークですでにフロンティアモデルと対抗できるが、実世界の長期タスクではまだギャップが存在する。

このギャップは主に以下の点に表れています:

- 持続的注意力の維持:長距離タスクにおいて数十ステップにわたって戦略的一貫性を維持すること

- 複雑なコードベースの理解:大規模プロジェクトアーキテクチャの深い把握

- エラー回復能力:挫折に遭遇した後、戦略を調整して失敗した経路を繰り返さないこと

しかし、バグ修正、機能実装、コードレビューなど、ほとんどの日常的な開発シナリオにおいて、DeepSeek V4 Pro と Kimi K2.6 はすでに十分なパフォーマンスを提供しています。

中国モデルエコシステムにとっての意味

今回の FrontierSWE 結果は、中国のオープンソースモデルエコシステムのマイルストーンです。過去数年間、中国モデルは言語理解や数学推論などの分野で急速に追いついてきましたが、深いコンテキスト理解と長期計画能力を必要とするソフトウェアエンジニアリングタスクにおいては、GPT-4 レベルのモデルとの間に明確なギャップがあると広く考えられていました。

そのギャップは今、実質的に縮まりつつあります。DeepSeek V4 Pro の価格優位性(API コストは同クラスモデルのごく一部)と Kimi K2.6 の速度優位性を組み合わせると、開発者ツールチェーンにおける中国モデルの採用率は急速に上昇しています。

アクション推奨事項

- エンジニアリングチーム:すでに DeepSeek や Kimi をコーディング支援に使用している場合、FrontierSWE 結果は継続的な投資の裏付けとなります。V4 Pro の実際のタスクにおけるパフォーマンスは、すでに一部の GPT-4 レベルのワークロードを代替するのに十分です。

- 個人開発者:DeepSeek V4 Pro の API 価格は非常に競争力があり、限られた予算で高品質なコード生成が必要なシナリオに適しています。

- モデル選定:速度を優先する場合は Kimi K2.6、包括性を優先する場合は DeepSeek V4 Pro、最適なフォーマット出力が必要な場合は GLM 5.1 を検討してください。