发生了什么

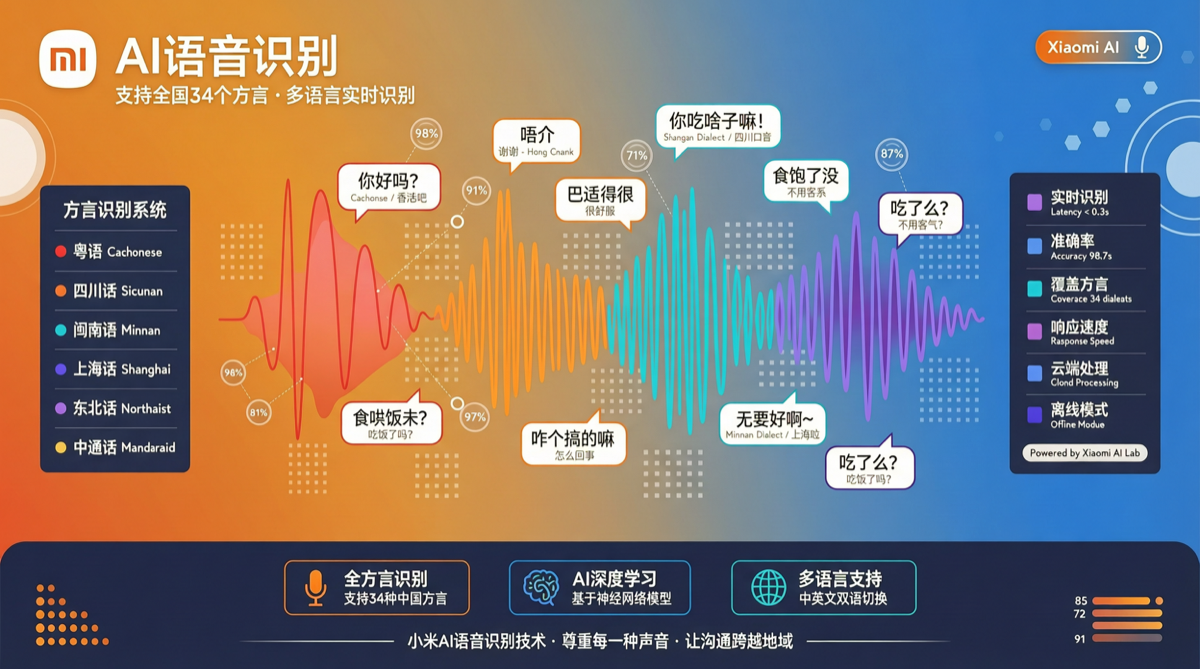

小米于 4 月 30 日开源了 MiMo-V2.5-ASR——一个面向语音识别(ASR)的开源模型。与之前的 MiMo-V2.5 系列不同,这次发布聚焦于一个具体的能力:高质量的语音转文字,并且原生支持多种中文方言。

| 能力 | 说明 |

|---|---|

| 普通话识别 | 标准中文语音转文字 |

| 英语识别 | 标准英文语音转文字 |

| 吴语 | 上海话、苏州话等吴方言 |

| 粤语 | 广东话 |

| 闽南语 | 福建、台湾闽南语 |

| 四川话 | 西南官话 |

| 歌曲识别 | 带音乐的语音内容 |

| 噪声环境 | 嘈杂场景下的鲁棒识别 |

| 多说话人 | 同时识别多个说话人 |

为什么方言识别是个难题

中文方言之间的差异,有时比不同欧洲语言之间的差异还大:

- 粤语有 6-9 个声调(普通话 4 个),声调系统完全不同

- 吴语保留了大量中古汉语的入声和浊音

- 闽南语的音系与普通话差异极大,很多词汇没有对应的普通话写法

现有的 ASR 模型(包括 Whisper 等知名开源方案)在方言场景下的表现通常大幅下降。原因很简单:训练数据中普通话占绝对主导,方言数据的稀缺性和标注成本使得大多数团队选择放弃。

小米的优势在于:MIUI/澎湃 OS 覆盖数亿中国用户,拥有天然的方言语音数据来源。

技术亮点

1. 统一架构,多语言/方言共享

MiMo-V2.5-ASR 采用统一的多语言/方言模型架构,而非为每种方言训练独立模型。这意味着:

- 一个模型处理所有方言,无需切换

- 方言之间的知识可以迁移共享(比如粤语和闽南语的某些音系特征)

- 部署成本大幅降低

2. 噪声与音乐场景

支持”歌曲识别”是一个值得注意的特性。音乐背景下的语音识别是 ASR 领域的经典难题——模型的声学编码器需要从混合信号中分离出人声并识别歌词。MiMo-V2.5-ASR 能处理这个场景,说明其声学特征提取能力达到了较高水平。

3. 多说话人识别

传统的 ASR 模型通常假设单一说话人。多说话人场景需要模型具备:

- 说话人分离能力(diarization)

- 说话人切换检测

- 独立标记每个说话人的内容

MiMo-V2.5-ASR 原生支持这一能力,无需额外集成第三方工具。

对比现有开源 ASR 方案

| 方案 | 方言支持 | 多说话人 | 噪声鲁棒性 | 歌曲识别 | 开源协议 |

|---|---|---|---|---|---|

| Whisper | 有限 | 不支持 | 中等 | 不支持 | MIT |

| FunASR | 部分方言 | 支持 | 良好 | 不支持 | Apache 2.0 |

| MiMo-V2.5-ASR | 6+ 方言 | 支持 | 良好 | 支持 | 待定 |

MiMo-V2.5-ASR 的核心差异化优势在于方言覆盖的广度——这在开源 ASR 领域是第一次。

应用场景

1. 智能客服方言适配

中国的智能客服系统长期面临一个问题:方言用户的服务质量差。MiMo-V2.5-ASR 可以让客服系统直接理解方言输入,无需用户切换到普通话。

2. 会议记录与字幕生成

多说话人 + 多语言 + 噪声鲁棒的组合,使它非常适合:

- 会议自动记录

- 视频字幕生成(特别是方言内容)

- 播客/访谈转写

3. 方言内容数字化

大量方言内容(地方戏曲、口述历史、民间故事)因缺乏高质量的 ASR 工具而无法数字化。MiMo-V2.5-ASR 的开源降低了这一门槛。

格局判断

小米在大模型领域的策略是**“深耕场景,而非追逐榜单”**。MiMo-V2.5 系列在 LMArena 上已经跻身全球前六,现在推出方言 ASR,说明小米的 AI 策略有两个特点:

- 场景驱动:不追求通用全能,而是在特定场景(方言识别)做到极致

- 开源优先:通过开源建立生态影响力,而非闭源竞争

这与 DeepSeek 的路线相似——用场景化的开源模型,在特定领域形成差异化优势。

行动建议

如果你是开发者:

- 关注 GitHub 仓库的开源协议(将决定商用可行性)

- 测试你的方言数据在模型上的表现,特别是小众方言

- 评估是否可以集成到现有的语音处理流水线中

如果你是产品经理:

- 方言 ASR 在中国市场有明确的用户需求(数亿方言使用者)

- 考虑在客服、内容审核、字幕生成等场景中引入方言支持

- 开源方案可以大幅降低初期试错成本

本文基于小米 MiMo-V2.5-ASR 发布信息和开源社区讨论。模型具体性能指标和开源协议以官方仓库为准。