多くの人が見逃した重要な詳細

最近、Kimi K3に関する噂が中国のAIコミュニティで広がっている:

「Kimi K3はQ3にリリース予定との噂で、パラメータ規模は2.5兆を超えるとされる。内部実験では100万トークンを大幅に超えるコンテキストをすでにテスト済みだが、1Mコンテキストをユーザーに開放するかどうかは依然として不確実である。Kimiが1Mコンテキストのリリースを制限している主なボトルネックは技術ではなく、計算リソースリソースである。」

最後の一文に注目してほしい——ボトルネックは技術ではなく、計算リソースなのだ。

これは2026年の大モデル競争において、最も誤解されやすく、かつ最も勝敗を決定づける分水嶺かもしれない。

技術的可能性と商業的実現可能性

技術的な観点から言えば、100万トークンのコンテキストはもはや「できるかどうか」の問題ではない。

DeepSeek V4 Flash/Proはすでに1Mコンテキストをサポートしており、Kimi K3の内部実験も100万+トークンをすでに走り切っている。オープンソースコミュニティの複数のプロジェクトも超長コンテキストの実験を進めている。

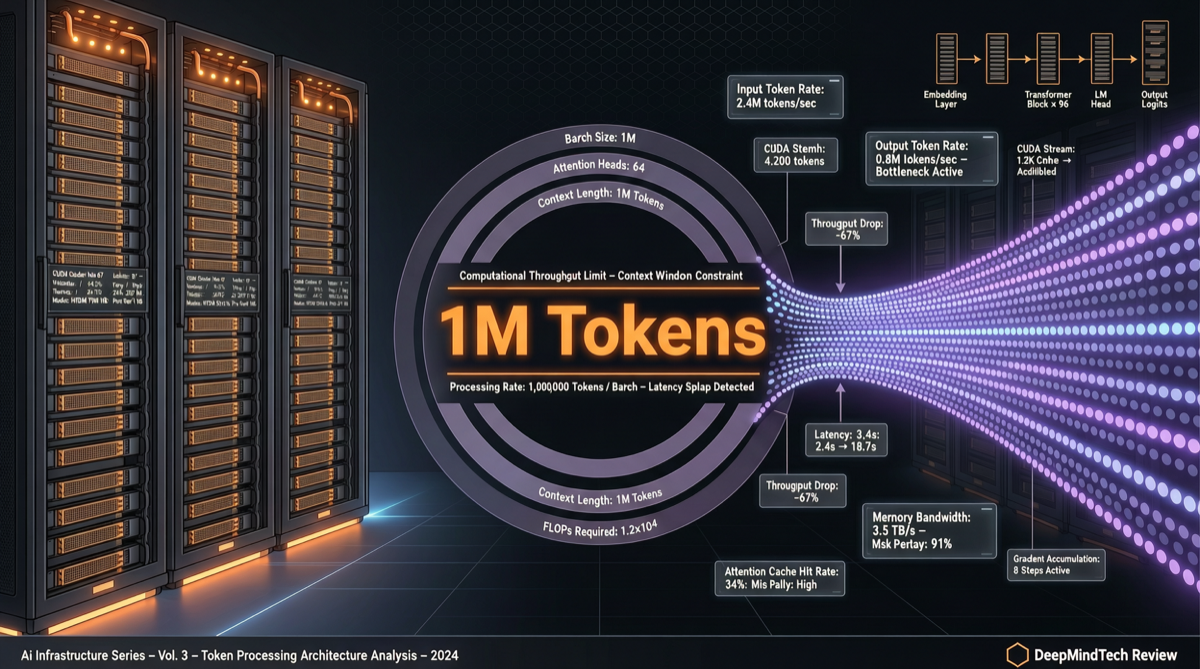

真の課題は以下の通りだ:100万トークンがモデルに流れ込んだとき、1回の推論にどれだけの計算リソースが必要なのか?

おおよその試算:

- FP16精度で1MトークンのKVキャッシュは約数GBのVRAMを占有する

- A100上での1Mコンテキストの完全な推論には数十秒から数分かかる可能性がある

- 1万人のユーザーが同時に1Mコンテキストのリクエストを送信した場合、必要なGPUクラスターの規模は天文学的数字になる

これが、Kimi(Moonshot AI)が内部で技術を証明しながらも、なおユーザーへの開放を躊躇している理由だ——計算リソースコストがすべての利益を食い尽くしてしまう。

各プレイヤーの計算リソースカード

この1Mコンテキスト競争において、各プレイヤーが持つ計算リソースのカードは大きく異なる:

DeepSeek:自社のAI計算クラスター + 複数の計算リソースサプライヤーとの提携。V4 Flash/Proはすでに1Mコンテキストをサポート。その自信はモデル効率の最適化が優れていることから来ている——同じコンテキスト長さでも、DeepSeekが必要とする計算リソースはより少ない。

Moonshot AI(Kimi):多額の資金調達を受けているが、計算リソースインフラ面ではまだ追い上げの段階にある。これこそがK3の1Mコンテキストが「内部テスト済み」だが「開放するか不確実」な理由だ。

アリババ(Qwen):アリババクラウドの計算リソースインフラを背景に持ち、理論的には大規模な1Mコンテキストサービスを提供する最も能力のある企業。しかしQwenの戦略は、コンテキスト長さの純粋な追求よりも、モデル効率とマルチシナリオ適応に重点を置いている。

Zhipu(GLM):長コンテキストにおいて蓄積があるが、計算リソース規模が制約要因となっている。

これがなぜ重要なのか?

なぜなら、1Mコンテキストは単に「もっと読める」という問題ではない——それはAIができることを再定義するからだ:

- コードベース全体の分析:プロジェクトのソースコード全体を一度に読み込み、グローバルなリファクタリングを行う

- 長文書の理解:本一冊、法的契約書一台、財務報告書一冊を一度に分析

- マルチターン対話の記憶:AIとの対話履歴がもはや「切り捨て」や「圧縮」を必要としない

- データ分析:大量の構造化データを一度に入力し、直接結論を導き出す

あるモデルが手頃な価格で1Mコンテキストを最初に提供したとき、これらのシナリオにおいて構造的な優位性を獲得する——モデルがより賢いからではなく、より多くの情報を「見られる」からだ。

計算リソース競争の三つの戦場

Kimi K3の噂から派生して、2026年の大モデル業界の計算リソース競争は三つのレベルに集中している:

1. 訓練計算リソース:パラメータ規模の天井

Kimi K3の2.5兆パラメータは、訓練に必要な計算リソースが天文学的数字であることを意味する。これは「カードをもう少し買う」という問題ではなく、チップからクラスターまでのフルスタック能力を体系的に構築する必要がある。

2. 推論計算リソース:サービスコストの決定要因

1Mコンテキストのサービスコストが、誰が大規模に商業化できるかを決定する。DeepSeekはモデルアーキテクチャの最適化(MoE、スパース化など)によって推論コストを削減しており、これが競合他社よりも早く1Mコンテキストを開放できた鍵かもしれない。

3. エッジ計算リソース:ローカルデプロイの未来

Qwen 3.6がローカルモデルで際立ったパフォーマンスを見せることは、別のルートが並行して推進されていることを示している:十分に強力なモデルをコンシューマーグレードのハードウェアに詰め込む。これは1Mコンテキストのルートではないが、より実用的な「十分良い」戦略かもしれない。

業界と投資家へのシグナル

- 計算リソースこそが本当の堀(モート)である。 モデルアーキテクチャは模倣でき、論文は再現できるが、計算リソースインフラには時間と資本の蓄積が必要だ。

- 1Mコンテキストは分水嶺となる。 負担できる企業は差別化された優位性を獲得し、負担できない企業は「十分良い」コンテキスト長さでの競争を余儀なくされる。

- Q3は重要なウィンドウ期間である。 Kimi K3がQ3に予定通りリリースされ1Mコンテキストを開放すれば、Moonshot AIはその計算リソースインフラが新たなレベルに達したことを証明する。もし遅延または縮小されれば、計算リソースのボトルネックが外部の予想よりも深刻であることを示唆する。

大モデルの競争は、「誰の論文が強いか」から「誰の計算リソースが十分か」へと移行した。これはセクシーな物語ではないが、勝者を決定づける鍵なのである。