一个被多数人忽略的关键细节

最近一条关于 Kimi K3 的传闻在中文 AI 圈传播:

“Kimi K3 据传计划在 Q3 发布,参数规模超过 2.5 万亿;内部实验已测试远超 100 万 token 的上下文长度,但最终是否向用户开放 1M 上下文仍不确定。当前限制 Kimi 推出 1M 上下文的主要瓶颈不是技术,而是算力资源。”

请注意最后一句——瓶颈不是技术,而是算力。

这可能是 2026 年大模型竞争中最容易被误解,也最决定胜负的一个分水岭。

技术可行 vs 商业可行

从技术角度看,100 万 token 上下文已经不再是”能不能做到”的问题。

DeepSeek V4 Flash/Pro 已经支持 1M 上下文,Kimi K3 的内部实验也已经跑通了 100 万+ token。开源社区的多个项目也在实验超长上下文。

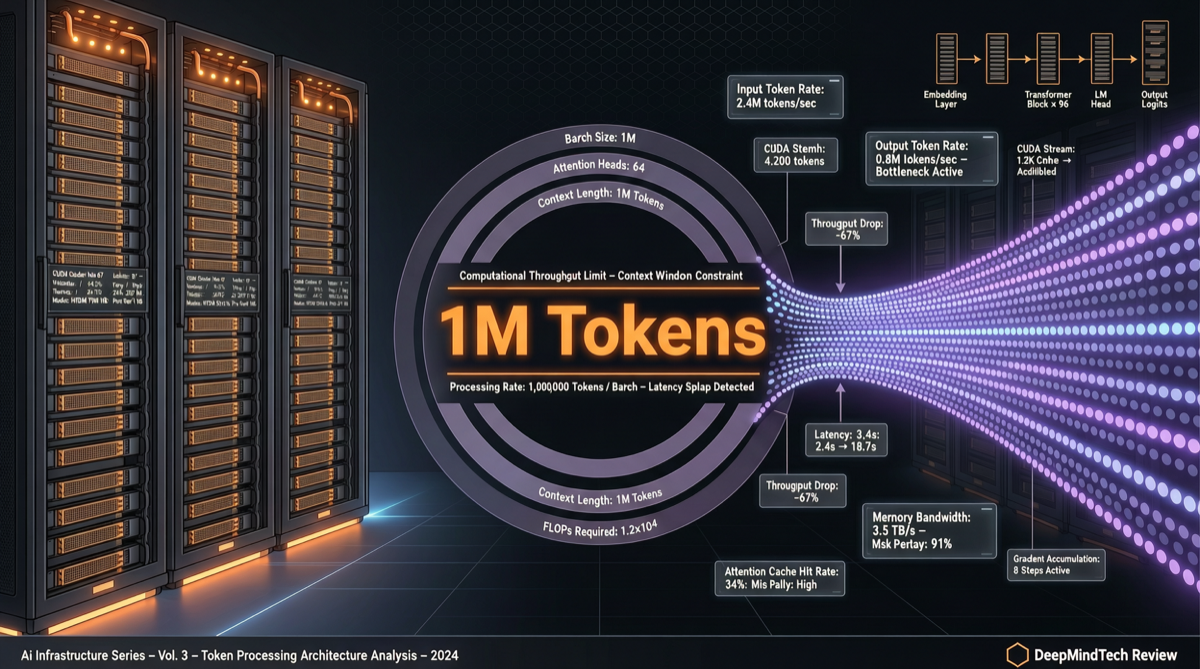

真正的挑战在于:当 100 万个 token 涌入模型时,需要多少算力来服务一次推理?

粗略估算:

- 1M token 的 KV Cache 在 FP16 精度下大约占用 数 GB 显存

- 一次完整的 1M 上下文推理,在 A100 上可能需要 数十秒到数分钟

- 如果有 1 万个用户同时发起 1M 上下文的请求,需要的 GPU 集群规模是天量

这就是为什么 Kimi(月之暗面)在内部已经跑通技术,却仍然犹豫是否向用户开放——算力成本会吃掉所有利润。

不同玩家的算力筹码

在这场 1M 上下文竞赛中,各家手中的算力筹码差异巨大:

DeepSeek:自有智算集群 + 与多家算力供应商合作,V4 Flash/Pro 已经支持 1M 上下文。它的底气在于模型效率优化做得好——同样的上下文长度,DeepSeek 需要的算力更少。

月之暗面(Kimi):获得了大量融资,但在算力基础设施方面仍在追赶。这也是为什么 K3 的 1M 上下文”内部已测试”但”是否开放仍不确定”。

阿里(Qwen):背靠阿里云的算力基础设施,理论上最有能力提供大规模 1M 上下文服务。但 Qwen 的策略更侧重于模型效率和多场景适配,而不是单纯追求上下文长度。

智谱(GLM):在长上下文方面有积累,但算力规模是制约因素。

这为什么重要?

因为 1M 上下文不只是”能读更多”的问题——它重新定义了 AI 能做什么:

- 完整代码库分析:一次性读入整个项目的源码,做全局重构

- 长文档理解:整本书、整份法律合同、整份财报,一次性分析

- 多轮对话记忆:与 AI 的交互历史不再需要”截断”或”压缩”

- 数据分析:海量结构化数据一次性输入,直接得出结论

当某个模型率先以可负担的价格提供 1M 上下文时,它在这些场景中将获得结构性优势——不是因为模型更聪明,而是因为它能”看到”更多信息。

算力竞赛的三个战场

从 Kimi K3 传闻延伸出去,2026 年大模型行业的算力竞赛集中在三个层面:

1. 训练算力:参数规模的天花板

Kimi K3 的 2.5 万亿参数意味着训练所需的算力是天文数字。这不是”多买几张卡”的问题,而是需要系统性地构建从芯片到集群的全栈能力。

2. 推理算力:服务成本的决定因素

1M 上下文的服务成本,决定了谁能大规模商业化。DeepSeek 通过模型架构优化(MoE、稀疏化等)降低了推理成本,这可能是它比竞争对手更快开放 1M 上下文的关键。

3. 边缘算力:本地部署的未来

Qwen 3.6 在本地模型中的突出表现,说明另一条路线正在并行推进:把足够强的模型塞进消费级硬件。这不是 1M 上下文的路径,但可能是更实用的”够用就好”策略。

对行业和投资人的信号

- 算力是真正的护城河。模型架构可以被模仿,论文可以被复现,但算力基础设施需要时间和资本积累。

- 1M 上下文将是一个分水岭。能负担得起的厂商将获得差异化优势,无法负担的将被迫在”够用”的上下文长度上竞争。

- Q3 是关键窗口期。如果 Kimi K3 在 Q3 如期发布并开放 1M 上下文,月之暗面将证明其算力建设已经达到了新水平。如果推迟或缩水,则说明算力瓶颈比外界预期的更严峻。

大模型的竞争,已经从”谁的论文更强”转向”谁的算力更足”。这不是一个性感的叙事,但它是决定胜负的关键。