Computer Use Agent(CUA)はこの2年間、爆発的な人気を博している。AnthropicはClaudeにいち早くcomputer use機能を搭載し、マウスの移動、ボタンのクリック、キーボードの入力など、人間と同じようにPCを操作できるようにした。しかしすぐに、研究者たちはある厄介な問題に直面した。CUAがあまりにも「正直すぎる」のだ。

クリックもタイプもできるが、「この50ページのPDFをWordに変換して顧客に送信して」といったタスクを任せると、変換APIを1回呼び出して一発で済ますのではなく、ページごとに地道にコピペを続けてしまう。

これこそがハイブリッドアクション空間(hybrid action space)の核心的なジレンマである。エージェントはアトミックなGUI操作(クリック、タイピング)も、高度なツール(API、スクリプト)の呼び出しも可能だが、どちらのパスを選ぶべきかの判断ができないのだ。

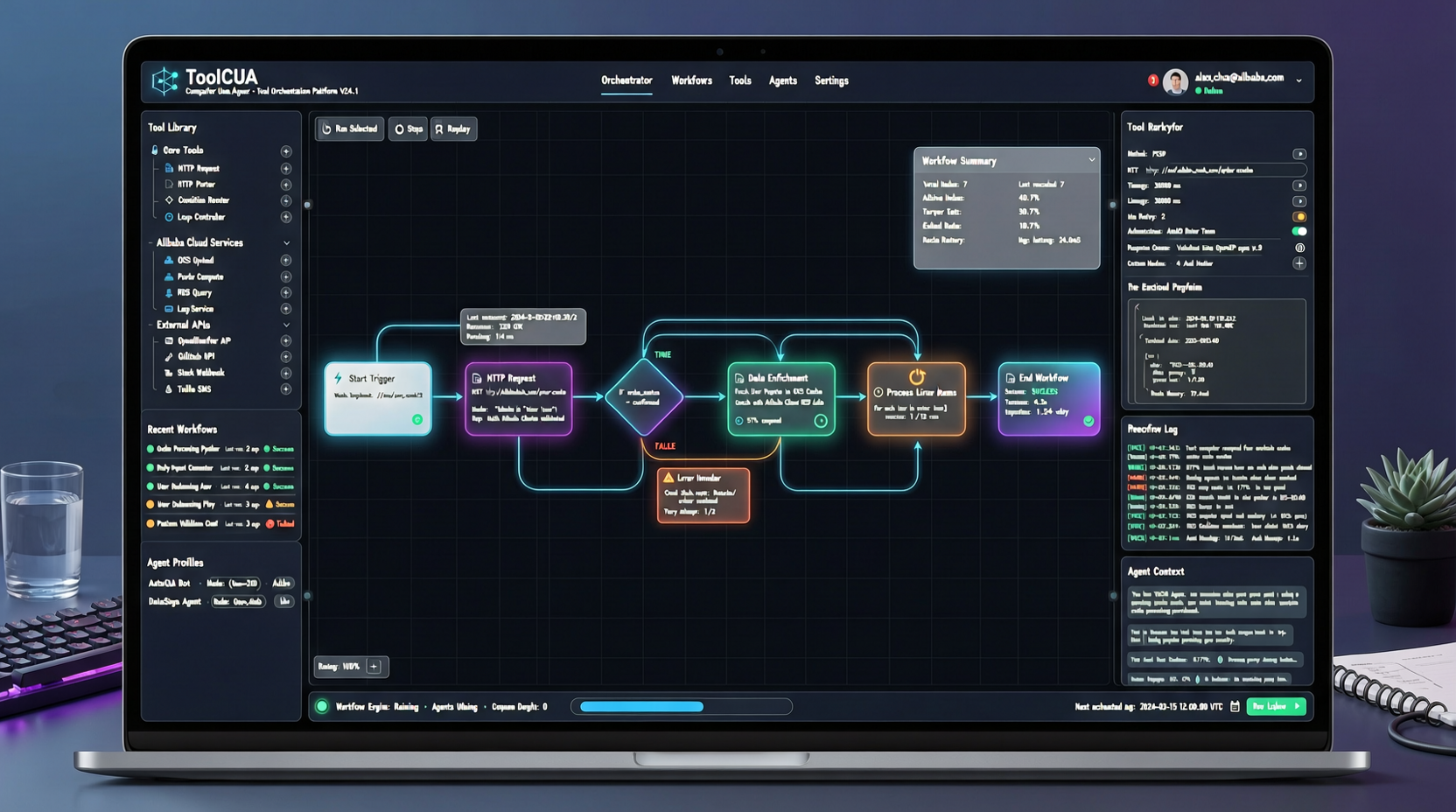

アリババ通義ラボのToolCUA論文は、まさにこの課題を狙撃している。

データが足りないなら、合成で補う

CUAを訓練する際の最大の障壁は何か?データである。

高品質な「GUI操作+ツール呼び出し」が交互に現れる軌跡(トレース)は極めて希少だ。純粋なGUI操作のデータ(画面録画、自動化スクリプト)は収集可能だが、実際のツール呼び出しを含む軌跡は収集コストが高く、かつ脆い。ツールごとに独自のインターフェース、エラーモード、認証フローが存在するためだ。

ToolCUAのアプローチは非常に賢い:大量の静的なGUI軌跡を再利用し、グラウンデッドなツールライブラリを合成するのだ。

具体的には、「交差型GUI-Tool軌跡拡張パイプライン」を設計した。既存のGUI軌跡(OpenWebVoyagerなどのデータセットなど)を取得し、ツールで代替可能な操作セグメントを自動的に識別して、対応するツール呼び出しに置き換える。これにより、手動アノテーションや実際のツール実行を必要とせずに、大量の交差型GUI-Tool軌跡を生成できる。

これは単純なデータ拡張ではなく、構造化された軌跡の再構築と言える。元のタスクセマンティクスは保持しつつ、実行パスを変更しているのだ。

3段階のトレーニング:模倣から自律的探索へ

ToolCUAのトレーニングは3つのステップに分かれており、各ステップは前段階よりも難易度が高く、実際のシナリオに近づいていく。

第1段階:SFT(Supervised Fine-Tuning)によるウォーミングアップ。 合成軌跡を用いて教師あり微調整を行い、モデルに「いつ何を使うべきか」を初步的に学習させる。これは基礎固めであり、エージェントに基本的な直感を植え付ける段階だ。

第2段階:Tool-Bootstrapped GUI RFT(強化学習による微調整)。 ここが最重要ポイントだ。モデルは重要なGUI-Tool切り替えポイントにおいて、シングルターンRL最適化を行う。長い軌跡全体に対してクレジットアサインメント(credit assignment)を行う(それは難しすぎる)のではなく、「切り替え判断」という局所に焦点を当てる。簡単に言えば、「クリックを続けるべきか、APIを呼ぶべきか」という分岐点で、より正確な判断をモデルに学ばせるのだ。

第3段階:Online Agentic RL。 モデルを高精度なGUI-Toolサンドボックス環境に配置し、自律的な探索を行わせる。ここでの報酬関数は入念に設計された「Tool-Efficient Path Reward」だ。タスクの完了可否だけでなく、パスの効率性も評価する。ツールを使ってステップを省略できれば加点し、使っても省略できなければ減点する。

この設計の妙は、「ツールを使う」という行為自体を直接報酬化するのではなく、「ツールを使うことによる効率向上」を報酬化している点にある。これにより、モデルがツールに過度に依存することも、まったく使わなくなることも防ぐ。

結果:相対66%の向上

OSWorld-MCPベンチマークにおいて、ToolCUAは46.85%の精度を達成し、ベースラインモデルから約66%向上した。さらに特筆すべきは、純粋なGUI環境と比較して3.9%向上している点だ。これは、GUI-Toolのオーケストレーションが単なる「選択肢の追加」ではなく、実際に補完的なゲインをもたらしていることを示している。

同規模のモデルにおいて、これは新たなSOTAとなる。

なぜこのアプローチが正しいと言えるのか

ToolCUAの意義はベンチマーク上位を競うことではなく、一つのパラダイムを実証した点にある。ハイブリッドアクション空間のトレーニングは可能であり、明確な方法論が存在するのだ。

従来、CUAの研究はGUI操作(視覚的グラウンディング、クリック座標予測)に特化するか、ツール呼び出し(API選択、パラメータ埋め込み)に特化するかのいずれかだった。ToolCUAはこれらを統合し、単に組み合わせるだけでなく、段階的なトレーニングを通じて「パス選択」というより高次の能力をモデルに真に習得させた。

論文はすでにオープンソース化されており、コードはGitHub、モデル重みはHugging Face(mPLUG/ToolCUA-8B)で公開されている。8Bパラメータでこの成果を出せるのは、コストパフォーマンスに非常に優れている。

エージェント開発者にとって、ToolCUAのトレーニングパラダイム(合成軌跡拡張 → 局所切り替えポイントのRL → グローバルな自律的探索)は十分に検討する価値がある。

論文URL:arXiv:2605.12481 プロジェクトページ:https://x-plug.github.io/ToolCUA/ コード:https://github.com/X-PLUG/ToolCUA モデル:https://huggingface.co/mPLUG/ToolCUA-8B