За последние пару лет Computer Use Agent (CUA) стали невероятно популярны. Anthropic первыми добавили в Claude возможность computer use, позволив моделям управлять компьютером так же, как люди: перемещать курсор мыши, нажимать кнопки и печатать на клавиатуре. Однако довольно быстро исследователи столкнулись с досадной проблемой: CUA слишком «буквальны».

Он умеет кликать и печатать, но столкнувшись с задачей вроде «преобразуй этот 50-страничный PDF в Word и отправь клиенту», агент будет методично копировать и вставлять текст постранично, вместо того чтобы вызвать API для конвертации и решить всё в один шаг.

В этом заключается ключевая проблема гибридного пространства действий (hybrid action space): агент может выполнять как атомарные операции в GUI (клики, ввод текста), так и вызывать высокоуровневые инструменты (API, скрипты), но не знает, когда и какой путь выбрать.

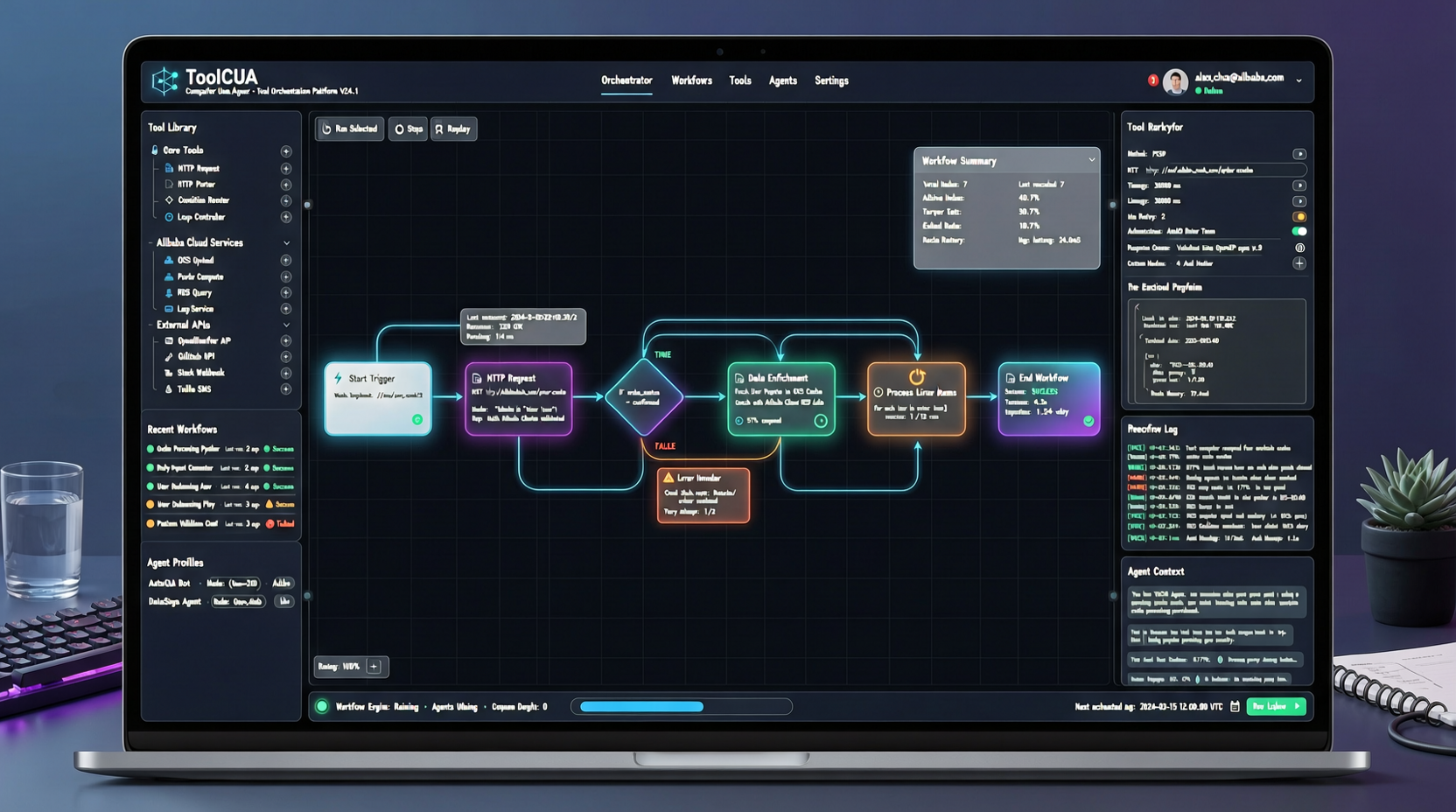

Именно на эту проблему нацелена статья лаборатории Alibaba Tongyi, посвящённая ToolCUA.

Если данных мало, синтезируем их

Что является главным препятствием для обучения CUA? Данные.

Высококачественные чередующиеся траектории «действия в GUI + вызов инструментов» крайне редки. Вы можете собирать данные чистых действий в GUI (записи экрана, скрипты автоматизации), но сбор траекторий с реальными вызовами инструментов обходится дорого и оказывается ненадёжным — у каждого инструмента свой интерфейс, паттерны ошибок и процессы аутентификации.

Подход ToolCUA довольно изящен: переиспользование большого количества статических GUI-траекторий для синтеза grounded-набора инструментов.

Если конкретнее, разработчики создали «конвейер расширения чередующихся GUI-Tool траекторий». Сначала берутся готовые GUI-траектории (например, из датасета OpenWebVoyager), после чего автоматически распознаются фрагменты операций, которые можно заменить вызовами инструментов, и происходит их замена. Таким образом, без необходимости ручной разметки и реального запуска инструментов удаётся сгенерировать огромное количество чередующихся траекторий GUI-Tool.

Это не простое аугментирование данных, а структурированная реконфигурация траекторий: сохраняется исходная семантика задачи, но меняется путь её выполнения.

Трехэтапное обучение: от имитации к автономному исследованию

Обучение ToolCUA состоит из трёх этапов, каждый из которых сложнее предыдущего и ближе к реальным условиям.

Первый этап: SFT-подготовка. На синтетических траекториях проводится supervised fine-tuning, чтобы модель изначально поняла, «что и когда использовать». Этот этап закладывает фундамент, давая агенту базовую интуицию.

Второй этап: Tool-Bootstrapped GUI RFT (Reinforcement Fine-Tuning). Это ключевой шаг. Модель проходит одношаговую RL-оптимизацию в критических точках переключения между GUI и инструментами — вместо распределения вознаграждения (credit assignment) по всей длинной траектории (что слишком сложно), оптимизация фокусируется локально на «решении о переключении». Проще говоря, модель учится точнее принимать решение на развилке: «мне продолжать кликать или вызвать API?».

Третий этап: Online Agentic RL. Модель помещается в высокоточную песочницу GUI-Tool, где она самостоятельно исследует окружение. Здесь используется тщательно спроектированная функция вознаграждения "Tool-Efficient Path Reward" — оценивается не только успешность выполнения задачи, но и эффективность пути. Если использование инструмента сократило количество шагов, начисляются баллы; если инструмент использовался, но экономии не принес, баллы снимаются.

Гениальность этого дизайна в том, что он вознаграждает не сам факт «использования инструмента», а именно «повышение эффективности благодаря инструменту». Это предотвращает как чрезмерную зависимость модели от инструментов, так и полный отказ от их использования.

Результаты: относительный прирост на 66%

На бенчмарке OSWorld-MCP ToolCUA показал точность 46,85%, что примерно на 66% выше, чем у базовой модели. Ещё примечательнее то, что по сравнению с режимом чистого GUI прирост составил 3,9%. Это доказывает, что оркестрация GUI и инструментов — это не просто «добавление ещё одной опции», а реальное получение взаимодополняющих преимуществ.

Среди моделей сопоставимого размера это новый SOTA.

Почему это правильный путь

Значение ToolCUA не в том, чтобы занимать первые строчки рейтингов, а в том, что он подтверждает работоспособность парадигмы: обучение в гибридном пространстве действий не только возможно, но и опирается на чёткую методологию.

Ранее исследователи CUA либо концентрировались на операциях в GUI (визуальное grounding, предсказание координат клика), либо на вызове инструментов (выбор API, заполнение параметров). ToolCUA объединяет оба направления, и не просто механически склеивает их, а благодаря поэтапному обучению позволяет модели по-настоящему освоить «выбор пути» — навык более высокого порядка.

Статья уже открыта, код доступен на GitHub, веса модели выложены на Hugging Face (mPLUG/ToolCUA-8B). Модель с 8 миллиардами параметров демонстрирует такие результаты, что делает её крайне эффективной по соотношению производительности и затрат.

Для разработчиков агентов тренировочная парадигма ToolCUA — расширение синтетических траекторий → RL на локальных точках переключения → глобальное автономное исследование — заслуживает самого пристального внимания.

Адрес статьи: arXiv:2605.12481 Страница проекта: https://x-plug.github.io/ToolCUA/ Код: https://github.com/X-PLUG/ToolCUA Модель: https://huggingface.co/mPLUG/ToolCUA-8B