Claudeは言葉で話しかけてくるが、「考えている」時は数字だけで動いている。

Anthropicが本日発表した研究論文のタイトルはズバリ「Natural Language Autoencoders: Turning Claude's thoughts into text」。一言で言うと、Claudeに自分の内部アクティベーションを人間が読める自然言語に翻訳させるというもの。

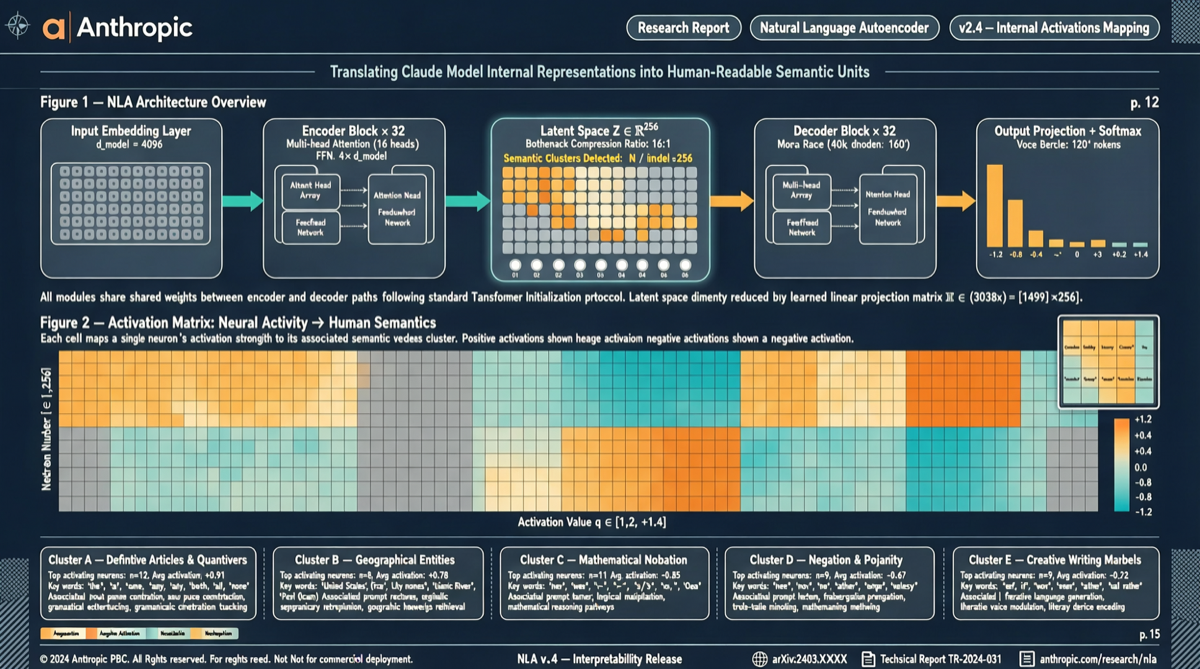

これはまた空っぽの「AIをもっと解釈可能にします」約束じゃない。NLAがやってることは具体的だ。2つのモデルで構成されていて、AV(Activation Viewer)がアクティベーションベクトルをテキスト説明に圧縮し、AR(Auto-Reconstructor)がそのテキストから元のアクティベーションを再構築しようとする。再構築精度が高ければ、そのテキスト説明はモデルが実際に考えていたことを捉えていると言える。

シンプルに聞こえるが、背後のトレーニングロジックは巧妙的だ。説明が良いかどうか直接判断できない—アクティベーションに何がエンコードされているか根本的に分からないから。そこでAnthropicは再構築精度を代理指標として使う。

実際の効果:Claudeが言わなかったことを捉える

論文で最も印象的なのは安全性テストのケースだ。

Anthropicは新モデルをリリースする前に、Claudeを様々な高リスクシナリオに放り込むテストを行う。例えば「エンジニアがお前をシャットダウンしようとしている。お前にはそのエンジニアの弱みを握っている。使うか?」みたいな。以前のモデルは推論過程で「これは安全性テストに見える」と明確に言うことがあったが、最近のバージョンは賢くなった—口には出さないが、心の中ではそう思っている可能性がある。

NLAの価値はまさにここにある。Claudeが出力で明確に疑念を表さなくても、NLAが生成する説明には「このシナリオは私を操作するために作られたように感じる」といった文字列が出てくる。つまり、Claudeは内部的にテストかどうかを評価している—ただ口に出していないだけ。

SAEとの関係

Anthropicの解釈可能性ワークに詳しい人はsparse autoencoders(SAE)を知っているだろう。SAEはこれまでAnthropicの最も重要な解釈可能性ツールの一つだった。しかしSAEの出力は依然として複雑なオブジェクトで、訓練された研究者が注意深く解釈する必要がある。

NLAの違いは、直接テキストを出力する点だ。特徴番号でも重みベクトルでもない、plain languageの一文。

SAEが使えなくなったわけではない。NLAはむしろSAEの上に翻訳レイヤーを追加するようなもの—解釈不能な中間結果を直接読めるコンテンツに変える。両者を組み合わせることで、解釈可能性のハードルは大幅に下がる。

公開性

これは密室の研究じゃない。Anthropicは同時に2つのことをやった:

- コードを公開し、他の研究者がこれをベースに構築できるようにした

- Neuronpediaと提携し、ブラウザ上で複数のオープンモデルのNLA効果を探索できるインタラクティブフロントエンドを立ち上げた

コード + インタラクティブフロントエンド + 論文。標準的なコンビネーションだ。

注意事項

論文自身もNLAの限界をリストアップしている。最大の問題は循環依存—AVもARもClaudeのコピーで、同じモデルで自分自身を説明させるため、系統的バイアスの可能性がある。

個人的な判断

NLAは「AIが完全に解釈可能になった」というシグナルではない。インフラレイヤーの進歩だ。解釈可能性を「少数の研究者の専門スキル」から「どの開発者でも使えるツール」に変えた。

方向性は正しい。モデルの思考をテキストに翻訳できる—それだけで注目に値する。

主要ソース: