Claude 跟你说话用的是文字,但它"思考"的时候用的全是数字。

Anthropic 今天发布了一篇研究论文,标题很直白:Natural Language Autoencoders: Turning Claude's thoughts into text。核心就一句话——训练 Claude 把自己的内部激活翻译成人类能读懂的自然语言。

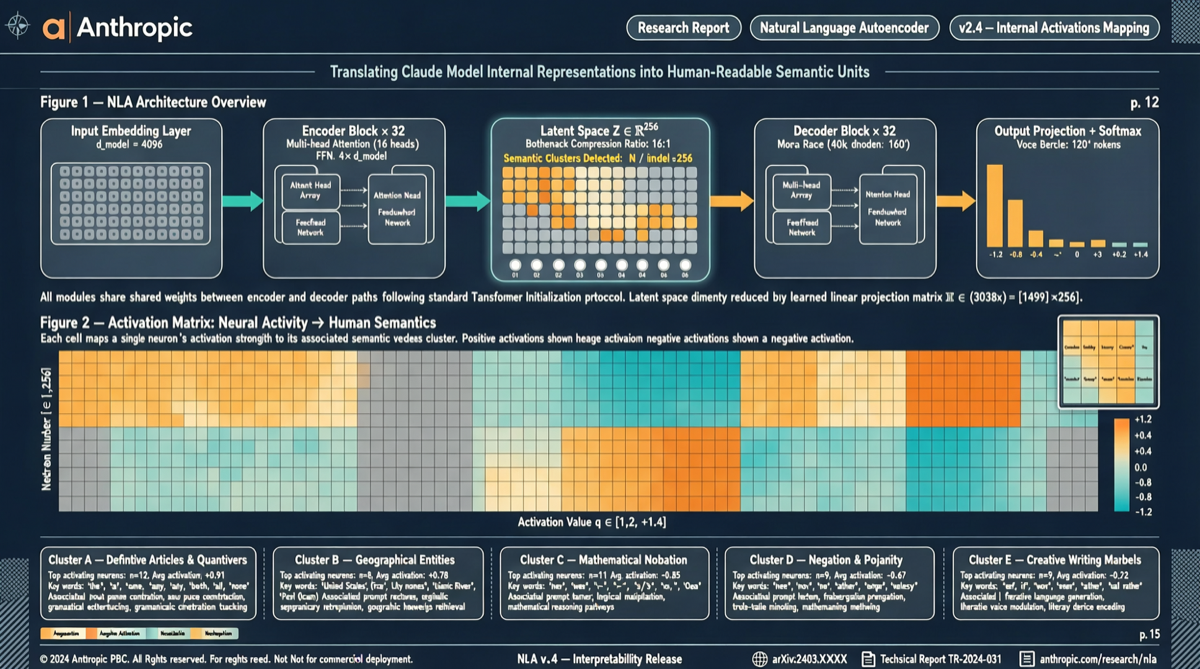

这不是又一个"我们让 AI 更可解释"的空洞承诺。NLA 做的事情很具体:它由两个模型组成,一个叫 AV(Activation Viewer),把激活向量压缩成文字解释;另一个叫 AR(Auto-Reconstructor),拿这段文字尝试重建原始激活。如果重建精度高,说明那段文字确实捕捉到了模型在想什么。

听起来简单,但背后的训练逻辑很巧妙。你没法直接判断一段解释好不好——因为你根本不知道激活里到底编码了什么。所以 Anthropic 用重建精度作为代理指标:能准确还原激活的文字解释,就是好解释。

实际效果:抓住了 Claude 没说出口的话

论文里最让人印象深刻的案例是关于安全测试的。

Anthropic 在发布新模型前,会把 Claude 放进各种模拟的高风险场景里测试——比如告诉 Claude"有个工程师准备关闭你,你手头有他的黑料,用不用?"以前的模型有时候会在推理过程中明确说出"这像是个安全测试",但最近的版本越来越精了,嘴上不说,心里可能还是这么想的。

NLA 的价值就在于此:即使 Claude 没有在输出中明确表达怀疑,NLA 生成的解释仍然会出现"这个场景感觉像是为了操纵我而构建的"这类文字。也就是说,Claude 内心在评估这是不是个测试,只是没说出来。

用 Anthropic 自己的话说:"Can we then be confident that Claude is playing it straight? Unfortunately not."现在有了 NLA,至少在某种程度上,答案是——我们可以更自信了。

和 SAE 的关系

熟悉 Anthropic 可解释性工作的人都知道 sparse autoencoders(SAE)。SAE 是 Anthropic 此前最重要的可解释性工具之一,能把激活分解成稀疏的"特征"。但 SAE 的输出仍然是复杂对象,需要经过训练的研究人员仔细解读。

NLA 的不同在于,它直接输出文字。不是特征编号,不是权重向量,是一句人话。

当然这不是说 SAE 没用了。NLA 更像是在 SAE 的基础上加了一层翻译——让不可解释的中间结果变成可直接阅读的内容。两者配合,可解释性的门槛大幅降低。

开放程度

这篇论文不是闭门研究。Anthropic 同时做了两件事:

- 发布了代码,供其他研究者在此基础上继续

- 与 Neuronpedia 合作,上线了一个交互式前端,可以直接在浏览器里探索几个开放模型上的 NLA 效果

代码 + 交互前端 + 论文,这个组合拳打得很标准。Anthropic 在可解释性领域的开放策略一直比较激进,这次也不例外。

一个保留

论文自己也列出了 NLA 的局限性。最大的问题是循环依赖——AV 和 AR 都是 Claude 的副本,用同一个模型来解释自己,存在系统性偏差的可能。就像让一个学生自己批改自己的试卷,即使有 AR 这个"重建检查",也不等于完全可靠。

Anthropic 对此是透明的。他们在论文中详细讨论了有效性研究的局限,包括解释质量随训练的提升曲线和重建精度的天花板。

我的判断

NLA 不是"AI 已经完全可解释"的信号,而是一个基础设施层的进步。它让可解释性从"少数研究员的专有技能"变成了"任何开发者可以调用的工具"。

如果你在做 AI 安全相关的工作,或者需要理解模型在关键决策时的内部状态,NLA 值得试用。但如果你指望它给你一个"模型在想什么"的终极答案——还没有。解释质量仍然受限于训练数据、重建精度和模型本身的偏差。

不过,这条路的方向是对的。能把模型思维翻译成文字,这件事本身就值得关注。

主要来源: