結論

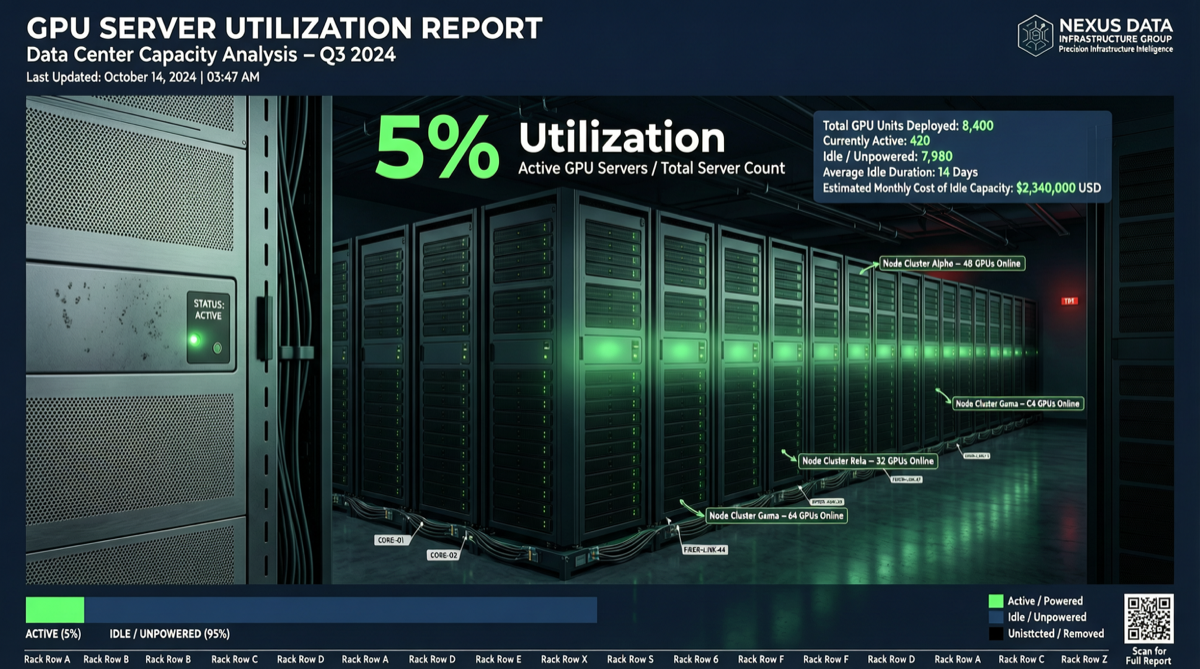

Cast AIによる約23,000のKubernetesクラスターの分析は衝撃的な事実を明らかにした。**企業のGPU平均利用率はわずか5%**である。つまり、95%のGPU算力がアイドル状態にある。同時に、CPU利用率は8%、メモリ利用率は20%である。

これは小さなサンプルの異常ではない。業界全体のシステマティックな浪费である。

データ全景

リソース利用率比較

| リソースタイプ | 平均利用率 | アイドル比率 | 浪费レベル |

|---|---|---|---|

| GPU | 5% | 95% | 極度 |

| CPU | 8% | 92% | 極度 |

| メモリ | 20% | 80% | 深刻 |

なぜ这种现象が起きるのか?

恐怖に基づくプロビジョニング:企業はGPU割り当ての欠落を恐れ、パフォーマンスのボトルネックを恐れ、ビジネスチームからの苦情を恐れて、大規模に過剰プロビジョニングを行う。このメンタリティは、パンデミック中のトイレットペーパーの買い占めに似ている。必要なからではなく、「なくなるのが怖い」からだ。

主要な発見の分解

1. GPU利用率5%は何を意味するか

企業が100枚のH100 GPUを購入し、1時間あたりのコストが約30〜40ドルだと仮定する。5%の利用率で計算すると:

- 有効な算力:5枚のH100がフルスピードで動作するのに相当

- 浪费された算力:95枚のH100がアイドル状態

- 年間の浪费コスト:約250万〜320万ドル

これには付随するCPU、メモリ、ネットワーク、冷却などのインフラコストは含まれていない。

2. CPUとGPUの新たな不均衡

もう一つの見過ごされがちなトレンド:GPUパフォーマンスの向上速度がCPUを大幅に上回っている。这意味着、AI算力単位あたりに必要なCPU付随リソースが遅れをとっている。研究所はハイパースケールクラウドプロバイダーと直接x86 CPU容量を競争しており、全体コストをさらに押し上げている。

3. 複数のリソースが同時にアイドル

GPU、CPU、メモリが同時に低利用率状態にあるということは、問題は単一リソースの設定ミスではなく、全体リソース計画方法論のシステマティックな失敗である。

なぜ重要なのか

企業への直接的影響

- コストのブラックホール:数億ドルのGPU予算の95%が纯粋な浪费

- 競争力の低下:同じ予算で、効率的な企業は非効率的な企業の20倍の実際の算力を得られる

- 環境への影響:アイドル状態のGPUも電力を消費し、カーボンフットプリントを生成する

業界レベルのシグナル

| シグナル | 意味 |

|---|---|

| GPU供給不足は幻想 | 真の需要は表面的な需要をはるかに下回る |

| クラウドプロバイダーのGPU定价权が弱まる可能性 | 企業が浪费に気づくと、调达戦略が変わる |

| リソース最適化ツール市場の爆発 | 自動スケーリング、混在ワークロードスケジューリング、GPU時分割共有が必須になる |

行動提案

企業のCTO/技術責任者

- GPU利用率の即時監査:Prometheus + NVIDIA DCGMを使用して実際のGPU使用率をモニタリング

- GPU時分割共有(MIG)の実装:単一GPUを複数のインスタンスに分割し、並行利用率を向上

- 自動スケーリング戦略の導入:実際の負荷に基づいてGPU割り当てを動的に調整

- コスト責任制度の確立:GPU利用率をチームのKPIに含める

AIエンジニア

- リアルタイム推論よりバッチ推論:複数の推論リクエストをマージしてGPUスループットを向上

- モデル量子化と蒸留:より小さなモデルでビジネスニーズを満たし、GPU依存を低減

- 推論最適化フレームワークの使用:vLLM、TensorRT-LLMなどのフレームワークはGPU利用率を大幅に向上できる

投資家/アナリスト

- リソース最適化セクターに注目:Cast AI、Run:ai、Volcon AIなどのGPU最適化プラットフォームの価値が凸显

- 算力ナラティブのバブルに注意:GPU購入量はAI能力と等しくない。利用率が重要指標

- 「20倍効率差」企業を探す:同じ予算で20倍の算力効率を達成できる企業は巨大な競争優位性を得る

格局判断

算力浪费の転換点が近づいているかもしれない。

最初の企業が最適化を通じて「同じAIタスクを1/20のコストで完了」できるとき、業界はこの問題に直面せざるを得なくなる。これは技術アップグレードの問題ではない。管理方法論の根本的な転換である。

同時に、これはAIスタートアップにとっても巨大な機会を提供している:顧客のGPU利用率を5%から50%に引き上げられる企業が、兆ドル規模の算力市場の入り口を掌握する。