核心的な結論

DeepClaudeがGitHubで急速に注目を集めている(HN 124ポイント、57件の議論)。その核心アイデアはシンプルながら効果的だ:エージェントループを計画層と実行層に分割し、安価なDeepSeek V4 Proで計画と推論を行い、Claude Codeはコード実行に専念させる。その結果、全体コストは純Claude Codeソリューションの1/17にまで低下した。

これは単なる節約ではない——OpenAI共同創業者Brockmanの「計算リソースの希少性」に関する主張に直接応えるものだ:二者択一ではなく、賢いモデルが核心的な判断を下し、安価なモデルが重労働をこなすのである。

価格比較:3層ベンチマーク

| アプローチ | 計画モデル | 実行モデル | エージェントループ1回あたり | 相対コスト |

|---|---|---|---|---|

| 純Claude Code | Opus 4.6 | Opus 4.6 | 約$17.00 | 17倍 |

| DeepClaude | V4 Pro | Claude Code | 約$1.00 | 1倍 |

| 純DeepSeek V4 Pro | V4 Pro | V4 Pro | 約$3.48 | 3.5倍 |

主要データポイント:

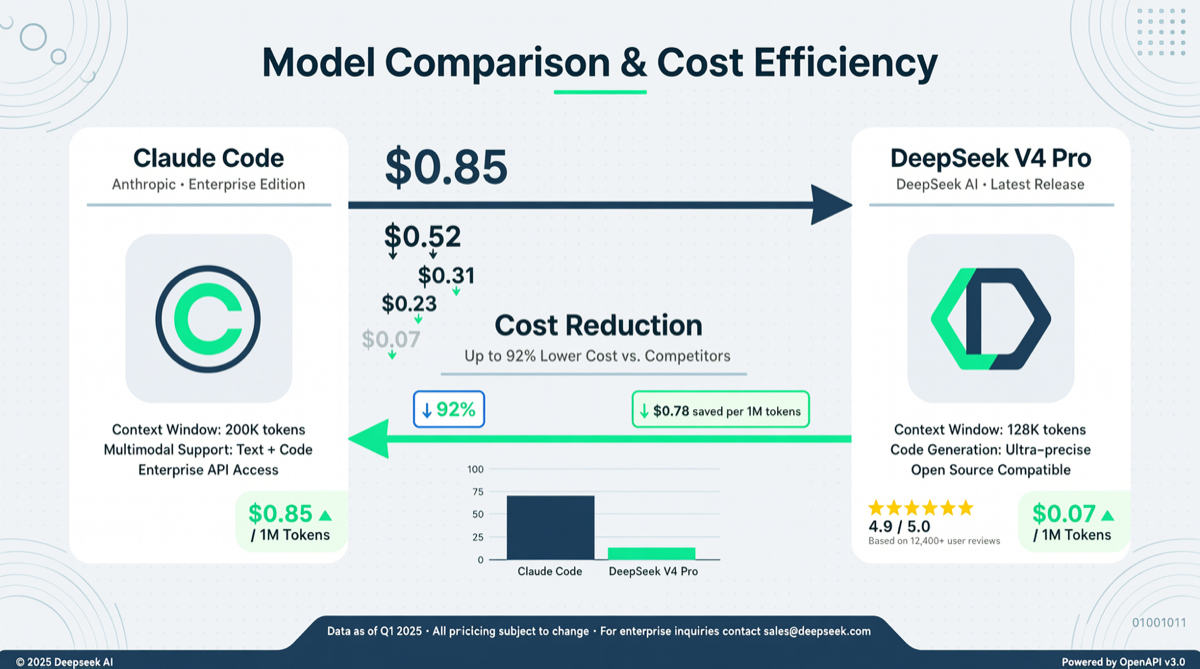

- DeepSeek V4 Pro割引価格:入力キャッシュヒット $0.04/1Mトークン、出力 $0.83/1Mトークン(75%OFFは5月31日まで延長)

- Claude Opus 4.6:$15/1M入力、$75/1M出力

- DeepClaudeの分割戦略により、トークン消費の90%がDeepSeek側に集中し、重要なコード実行のみがClaudeを経由する

アーキテクチャ分解

DeepClaudeは単なるモデル切り替え器ではない——以下の3つのことを行う:

- タスク分解層:DeepSeek V4 Proがユーザーリクエストを受け取り、実行可能なサブタスクシーケンスに分解

- スケジューリング層:サブタスクのタイプに応じてモデルを動的に選択——論理推論/コード生成はClaude Codeへ、情報検索/ドキュメント要約はDeepSeekへ

- 結果集約層:複数モデルの出力を統一されたワークフロー結果に統合

この階層型アーキテクチャが示す示唆は:2026年に稼げる個人開発者は、高いか安いかを選ぶのではなく、いつどのモデルを使うかを知っているということだ。

実際の性能

コミュニティテストのフィードバック:

- 学術ポスター生成:DeepSeek V4 + OpenClawでエンドツーエンド出力、描画はGPT Image 2を使用、総コスト$2未満

- 日常コーディングタスク:基本的な作業はこなせるが、デバッグシーンでは依然としてClaude Codeへの切り替えを推奨

- エージェントループシナリオ(多輪ツール呼び出し):コスト優位性が最も顕著——ここで17倍の差が開く

市場ポジショニング

DeepClaudeの台頭は、AIツールチェーンがコンポーザブルアーキテクチャ時代に突入したことを示している:

- モデル間の格差は縮小しつつある(DeepSeek V4 ProはすでにOpus 4.6非思考モードに接近)

- 真の防御壁はデータ、ワークフロー、流通である

- 「フロントエンド大規模モデル + バックエンド小規模モデル」のハイブリッドアーキテクチャが標準になる

アクション推奨

| シナリオ | 推奨アプローチ | 理由 |

|---|---|---|

| 単純なQ&A / 検索 | 純DeepSeek V4 Pro | 最低コスト、十分な品質 |

| 複雑なコーディング / リファクタリング | DeepClaude | 安価な計画、正確な実行 |

| 完全なエージェントループ | DeepClaude | 17倍のコスト差 |

| 極限デバッグ | 純Claude Code | 実行品質最優先 |

始め方:Claude Codeのモデルをdeepseek-v4-proに設定すれば1Mコンテキストを解禁可能(OpenCode v1.14.24+またはOpenClaw v2026.4.24+が必要)。割引価格は5月31日到期——安い間にワークフローをテストしよう。