プロ用のモーションキャプチャ装置は一式で数万ドルかかる。FreeMoCapの発想はシンプルだ——そんな金を使うな、机の上のUSBカメラで十分だ。

このプロジェクトは今日293スターを追加し、GitHub Trending Pythonトップ10にランクインした。

何ができるか

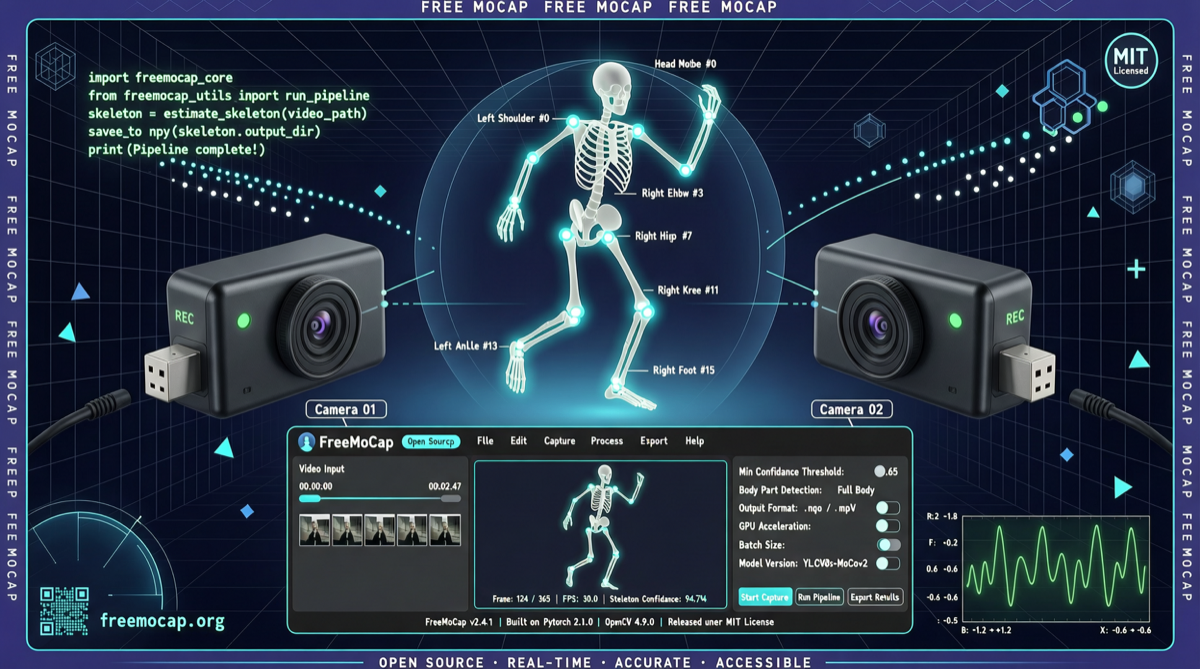

FreeMoCapはオープンソースの3Dモーションキャプチャシステム。必要なのはこれだけ:

- USBカメラ2台以上(多いほど正確)

- ChArUcoキャリブレーションボード(印刷するだけ)

- NVIDIA GPU搭載のPC

ワークフローは単純:カメラ設置 → キャリブレーションボード配置 → 動画撮影 → アルゴリズム実行 → 3Dボーンデータ取得。

技術スタック

コア依存はMediaPipeの2Dポーズ検出。複数視点の2Dキーポイントを三角測量で3D空間座標に再構築し、ボーン最適化パイプラインでクリーンな出力を得る。

データ処理パイプラインの主要ステップ:

- 動画同期とタイムスタンプ合わせ

- 2Dキーポイント検出(MediaPipe Pose/Hands/Face)

- 3D空間再構築(マルチビュー三角測量)

- ボーンデータ最適化とフィルタリング

最新バージョンv1.8.2は2週間前にリリース、累計1,142コミット、705フォーク。

誰が使うか

ターゲットユーザーは明確:インディーゲーム開発者、アニメーション学生、研究チーム、インディー映画制作者。

従来のモキャプソリューションは这些人を価格で締め出していた。FreeMoCapはその障壁を完全に取り払う——ハードウェアコストはカメラ数台と印刷用紙だけ。

精度面でViconやOptiTrackのような赤外光学システムには obviously 及ばない。だがハリウッド級の精度が不要な場面——インディーゲームのアニメーションプロトタイプ、ダンス指導分析、生体力学の予備研究——FreeMoCapで十分。

データエクスポート

Blender、Unityなどの主流ツールへのエクスポートに対応。ボーンデータ取得後、複雑な中間変換なしで直接3Dキャラクターを駆動できる。

現実的な判断

FreeMoCapはプロのモキャプを代替しようとしているわけではない。モキャプを「大企業しか買えない」ものから「カメラがある人なら誰でも試せる」ものに変えているだけ。

個人のクリエイターにとって、これは半日で動かせるものだ。精度が足りないときでも、少なくともアイデアを素早く検証できる。予算承認を3ヶ月待つよりずっと早い。

主な情報源: