专业动作捕捉设备动辄几万美元一套。FreeMoCap 的思路是:别花那个钱了,用你桌上的 USB 摄像头就行。

这个项目今天 293 个新增 star,冲进了 GitHub Trending Python 前十。

它做什么

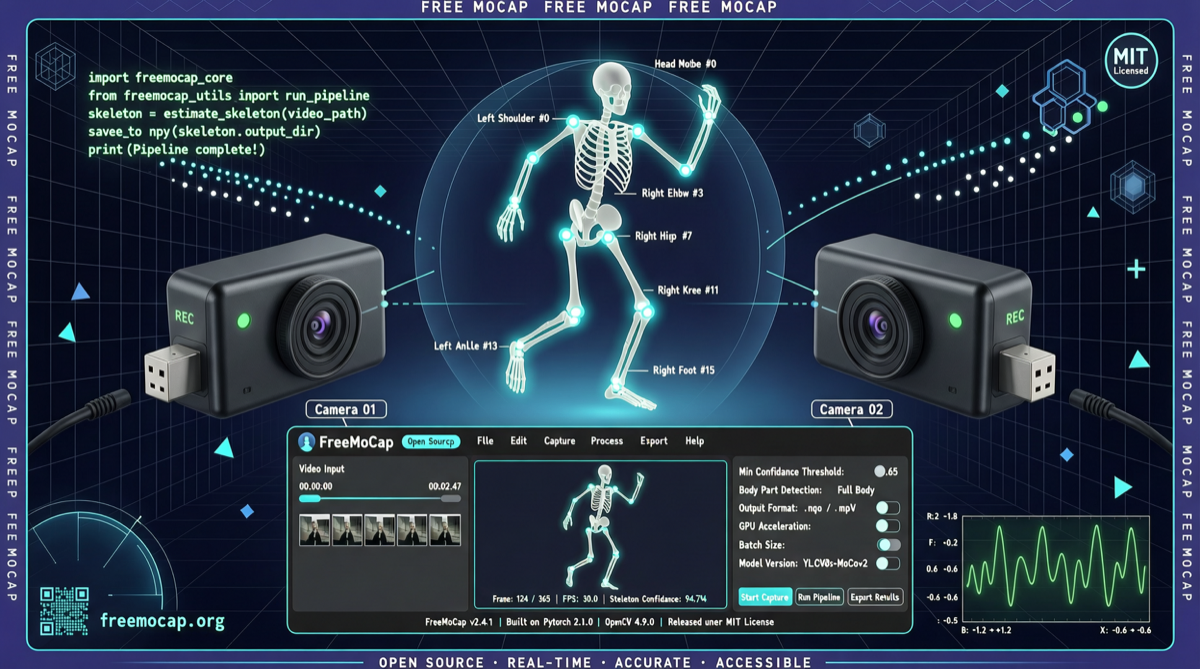

FreeMoCap 是一个开源的 3D 动作捕捉系统。你只需要:

- 两台以上普通 USB 摄像头(越多越准)

- 一块 ChArUco 校准板(打印一张就行)

- 一台带 NVIDIA GPU 的电脑

工作流程很简单:架好摄像头 → 放校准板标定空间 → 录视频 → 跑算法 → 拿到 3D 骨骼数据。

技术栈

核心依赖是 MediaPipe 的 2D 姿态检测。多视角 2D 特征点通过三角测量重建为 3D 空间坐标,再经过骨骼优化管线输出干净的骨骼动画。

整个数据处理流水线的关键节点:

- 视频同步和时间戳对齐

- 2D 特征点检测(MediaPipe Pose/Hands/Face)

- 三维空间重建(多视角三角测量)

- 骨骼数据优化和滤波

最新版本 v1.8.2 两周前发布,累计 1,142 次提交,705 个 fork。

谁在用

目标用户很明确:独立游戏开发者、动画学生、科研团队、独立电影人。

传统动捕方案的成本门槛把这些人挡在外面了。FreeMoCap 把这个门槛直接砍掉——唯一的硬件成本是几个摄像头和一张打印纸。

精度方面,它当然比不上 Vicon 或者 OptiTrack 那种红外光学系统。但对不需要好莱坞级精度的场景,比如独立游戏动画原型、舞蹈教学分析、生物力学初步研究,FreeMoCap 够用。

数据导出

支持导出到 Blender、Unity 等主流工具。这意味着拿到骨骼数据后,你可以直接驱动 3D 角色,不用经过复杂的中间转换。

一个现实的判断

FreeMoCap 不是要替代专业动捕。它做的是把动捕从"只有大公司买得起"变成"任何有摄像头的人都能试试"。

对于个人创作者来说,这是一个你花一个下午就能跑通的东西。精度不够的时候,它至少能让你快速验证想法。这比花三个月等预算审批快多了。

主要来源: