RAGの最後のピース——Googleがこれを埋めた。

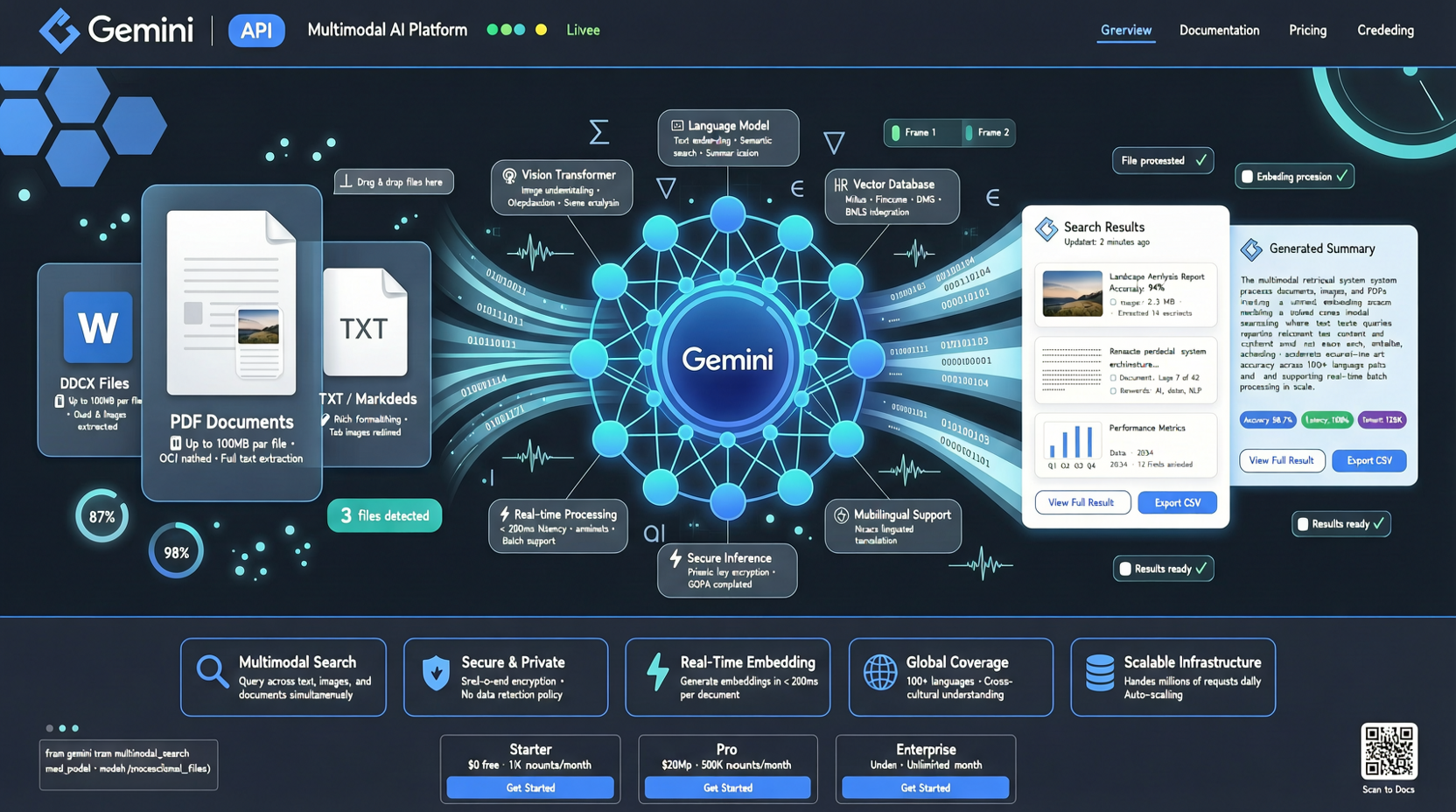

GoogleはGemini APIのFile Search機能がマルチモーダルに対応したと発表した。画像、画像付きPDF、スキャン文書を直接検索パイプラインに投入でき、Geminiはテキストだけでなく視覚コンテンツも理解できる。

実際には何を意味するのか

File SearchはGoogleが昨年Gemini API向けにリリースした機能。ドキュメントをアップロードするとGoogleがインデックスを作成し、会話中に関連コンテンツを自動で検索する。本質的にmanaged RAGサービスだ。

以前のバージョンはプレーンテキストのみ対応。製品マニュアル、請求書スクリーンショット、チャート付きレポート——視覚コンテンツを含むファイルに対し、File Searchは基本的に盲目だった。

これからは違う。マルチモーダルFile Searchは以下を理解できる:

- 画像内のテキストと視覚情報

- PDF内のチャートやスクリーンショット

- スキャン文書(OCR + 視覚理解の組み合わせ)

開発者に何が省けるか

以前、RAGで画像を処理するには自分でパイプラインを構築する必要があった。OCR + ビジョンモデル + ベクトルDBへの統合。

現在Googleはこれらすべてを単一のAPI呼び出しにパッケージ化した。

競合状況

OpenAIのGPT-4oは以前からマルチモーダル入力をサポートしているが、managed RAGサービスでは進行度にばらつきがある。

Googleの優位性はドキュメント処理の伝統にある——Google DocsとDriveを基盤としたエコシステムは短期間で複製できない。

実用上の制限

アナウンスではいくつかの重要な詳細が省略されている:

- 価格——マルチモーダル検索はテキスト検索より大幅に高くなるか?

- レイテンシ——画像理解はテキストマッチングより遥かに遅い

- サポートファイル形式——PDFと画像以外に、PPT、Excelは?

マルチモーダルRAGという赛道は、2026年になってようやく競争が始まったばかりだ。

主要ソース:Google Developers Blog, "Gemini API File Search is now multimodal"