Последний элемент пазла для RAG — Google только что его поставил.

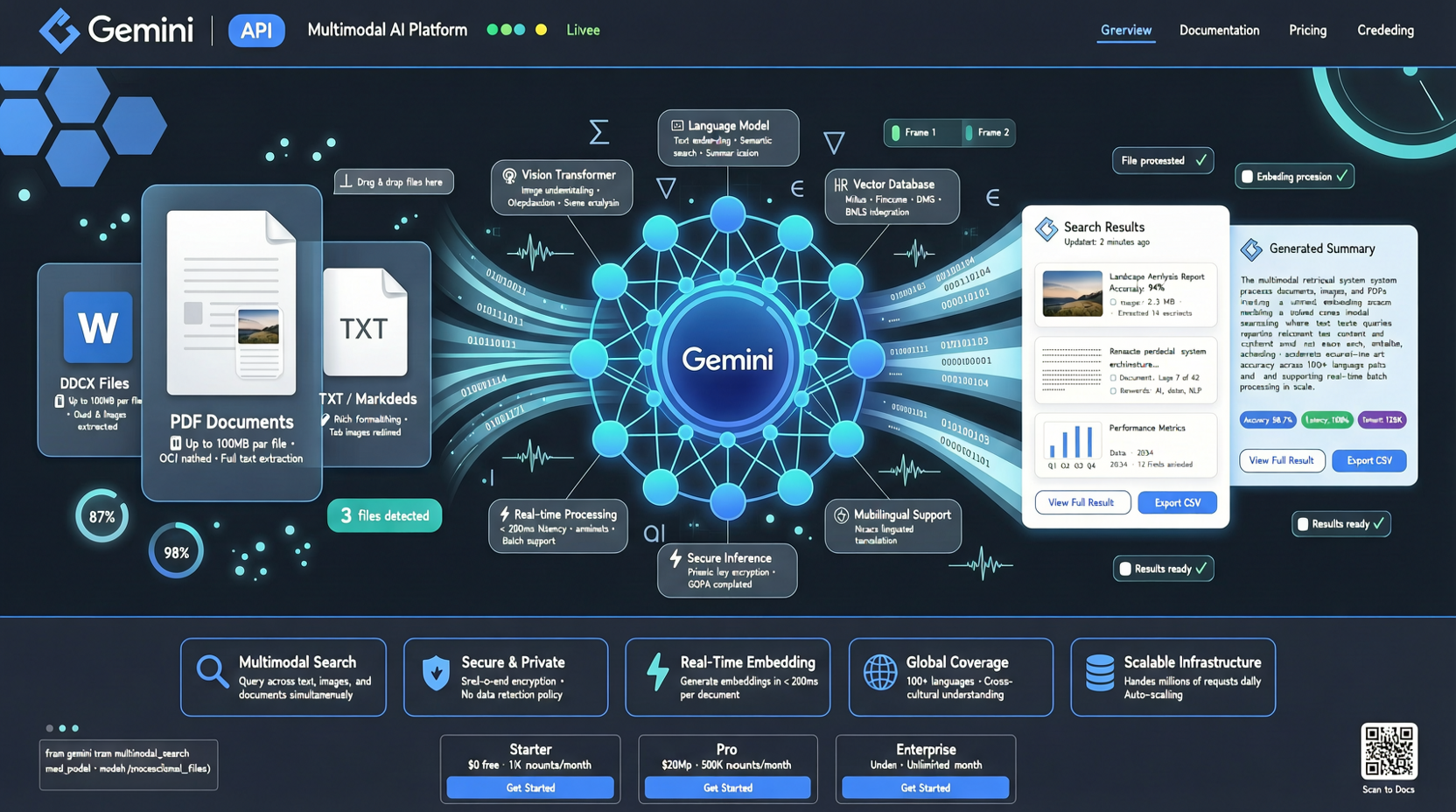

Google объявил, что функция File Search в Gemini API теперь поддерживает мультимодальный ввод. Можно загружать изображения, PDF с изображениями и сканированные документы прямо в пайплайн поиска, и Gemini может искать не только текст, но и понимать визуальный контент.

Что это на самом деле означает

File Search — это функция, запущенная Google для Gemini API в прошлом году: вы загружаете документы, Google их индексирует и автоматически извлекает релевантный контент во время разговора. По сути — managed RAG-сервис.

Но предыдущие версии работали только с обычным текстом. Если у вас были руководства по продуктам, скриншоты счетов, отчёты с графиками — всё, что содержит визуальный контент, — File Search был слеп.

Теперь мультимодальный File Search может понимать:

- Текст и визуальную информацию в изображениях

- Графики и скриншоты в PDF

- Сканированные документы (OCR + визуальное понимание)

Что это экономит разработчикам

Ранее обработка изображений в RAG означала собственный пайплайн: OCR + модель компьютерного зрения + интеграция в векторную базу данных. Каждый шаг требует выбора инструментов и настройки параметров.

Теперь Google упаковывает всё это в один API-вызов.

Конкурентный ландшафт

GPT-4o от OpenAI давно поддерживает мультимодальный ввод, но в managed RAG-сервисах прогресс различается:

- Google теперь интегрирует мультимодальность с File Search

- Assistants API от OpenAI имеет аналогичную обработку файлов

- Claude от Anthropic обладает сильными мультимодальными возможностями, но нет нативного managed RAG

Преимущество Google — наследие обработки документов. Экосистема Google Docs и Drive не копируется быстро.

Практические ограничения

В анонсе упущены несколько ключевых деталей:

- Цены — будет ли мультимодальный поиск значительно дороже текстового?

- Задержка — понимание изображений намного медленнее текстового сопоставления

- Поддерживаемые форматы — помимо PDF и изображений, что насчёт PPT и Excel?

Мультимодальный RAG только начинает становиться конкурентным в 2026 году.

Основной источник: Google Developers Blog, "Gemini API File Search is now multimodal"