何が起きたのか

LangChain チームが最近、AI エージェントコミュニティに衝撃を与えた一組のベンチマークデータを公開しました:

同一モデル GPT-5.2-Codex、パラメータ変更ゼロ、Agent Harness レイヤーのみを入れ替え — Terminal-Bench スコアが 52.8% から 66.5% にジャンプ、13.7 ポイントの純増。ランキングは Top 30 圏外から直接 Top 5 に急上昇。

さらに重要なのは、LangChain がもう一つの観察データを発表したことです:

「モデルとハーネスは共進化します。モデルは特定のツールパターンとフィードバックループに向上し、ハーネスはモデルの能力を最大限に引き出すことに向上します。」

つまり:モデルとスキャフォールディングは共進化しているのです。 モデルは特定のツール呼び出しパターンとフィードバックループにますます上手になり、ハーネスはモデルの能力を絞り出すことにますます上手になっています。

なぜ13.7ポイントがモデルアップグレードより重要なのか

過去18ヶ月、業界の物語は「誰がより大きなモデルをリリースしたか」に支配されていました。LangChain のデータは反物語爆弾を投げ込みました:

| 次元 | 従来のアプローチ | LangChain が明らかにしたこと |

|---|---|---|

| パフォーマンス源 | モデルパラメータとトレーニングデータ | ハーネス設計が同等の重みを持つ |

| 最適化パス | モデルのアップデートを待つ | 自分のスキャフォールディングを変更する |

| 競争の堀 | 計算量/データ | エンジニアリングアーキテクチャ |

| コスト構造 | より強いモデルにお金を払う | より良い設計にお金を払う |

Terminal-Bench とは

Terminal-Bench は、AI コーディングエージェントが実際のターミナル環境でタスクを完了する能力を測定するベンチマークです。SWE-bench(コード修正)とは異なり、Terminal-Bench はコマンドライン環境でのエージェントのフルプロセス能力を評価します:環境設定、依存関係インストール、デバッグ、ファイル操作——実際の開発者の日常作業により近いものです。

52.8% から 66.5% への飛躍は、エージェントが「途中でよく止まる」状態から「ほとんどのターミナルタスクを独立して完了できる」状態になったことを意味します。

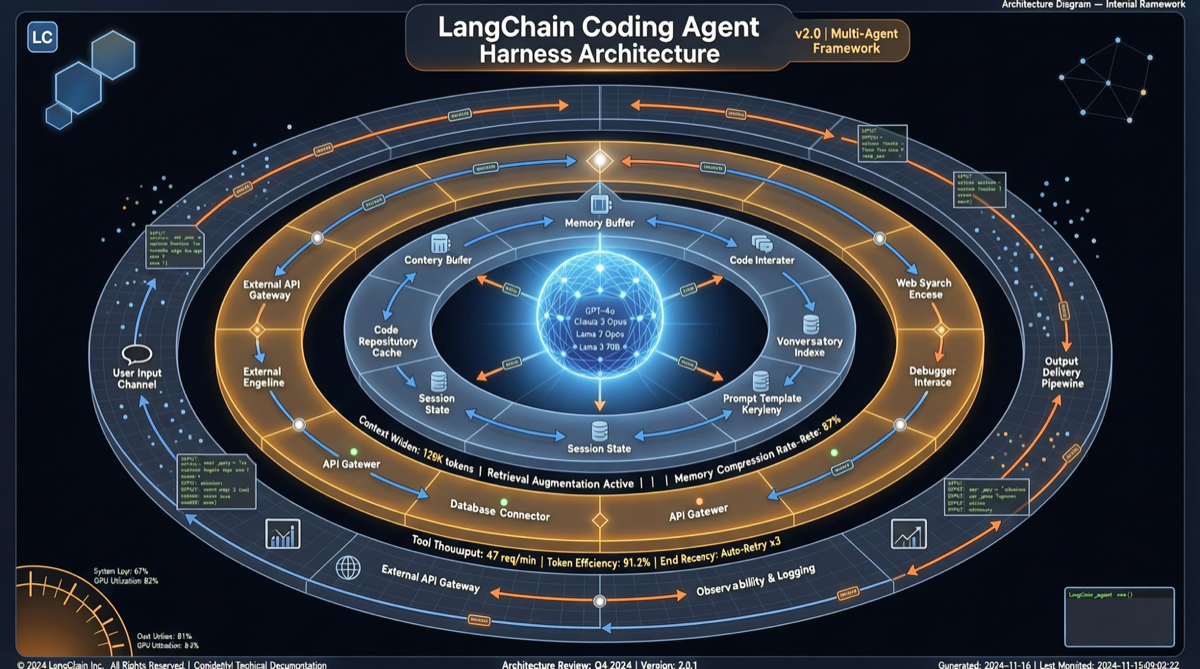

ハーネスで実際は何が変わったのか

LangChain の公開ヒントと業界分析に基づき、コアな改善は3つのレイヤーに集中しています:

1. コンテキスト管理戦略

- 動的圧縮:単純な切り捨てではなく、重要なコンテキストをインテリジェントに保持

- ツール呼び出し履歴の階層化:直近は詳細、過去は要約

- ファイルシステム認識:どのファイル状態を永続化する必要があるかを自動識別

2. ツール呼び出しオーケストレーション

- 並列ツール呼び出し:複数の独立した操作を同時に実行

- 失敗リトライロジック:異なるエラータイプに対する差異化された回復戦略

- ツールチェーン構成:原子操作を複合ツールに编排

3. フィードバックループ設計

- 自己修正メカニズム:エージェントが出力前に自己チェック

- 増分検証:各ステップ完了後に即時チェック、最終一括検証ではなく

- エラー学習:失敗事例を次回実行の制約条件に変換

業界への影響:ハーネスこそが競争力

このデータはAIエージェント業界の競争ロジックを再構築しています:

モデルベンダーにとって

同じモデルが異なるハーネスで13ポイント以上異なるパフォーマンスを出すなら、単に「ベンチマークスコア1位」を宣伝する意味は低下しています。モデルはコモディティ化しており、ハーネスこそが差別化の所在です。

エージェントフレームワークにとって

LangChain、CrewAI、Dify、OpenClaw、Hermes Agent などのフレームワークの競争焦点が移行しています。誰のハーネス設計が優れているかが、「同じモデル」でトップクラスの成績を出せるかを決定します。

開発者にとって

エージェントの能力を向上させるために次のモデルリリースを待つ必要はありません——ハーネス設計の最適化がより大きなパフォーマンスジャンプをもたらす可能性があります。 これは2026年で最もアクション可能な洞察です。

ハーネスエンジニアリングのコア原則

LangChain のデータと業界実践に基づき、検証済みのハーネス設計原則は以下の通りです:

| 原則 | 説明 | 効果 |

|---|---|---|

| コンテキスト認識圧縮 | 時間ではなく重要度でコンテキストを保持 | 重要情報の損失を削減 |

| ツールパターン整合 | ハーネス構造をモデルトレーニング環境に整合 | プレトレーニング能力を解放 |

| 階層化メモリ | 短期詳細 + 中期要約 + 長期インデックス | コンテキストウィンドウ制限を突破 |

| 失敗をデータとして | エラー出力を次回の制約に変換 | 継続的な自己改善 |

| 最小限の介入 | 必要な場合にのみモデルの判断に介入 | モデルの推論能力を保持 |

勢力図の判断

LangChain の13.7ポイント実験は孤立した結果ではなく、トレンドの縮図です:

2026年後半のAIエージェント競争は、モデルパラメータの軍備競争から、ハーネスアーキテクチャのエンジニアリング競争へ移行します。

これは中小チームに機会を開きます——大規模モデルをトレーニングする必要はありません。より良いハーネスを設計するだけでいいのです。LangChain が示したように、良いハーネスは「トップクラスではない」モデルにトップクラスのパフォーマンスを出させることができます。

アクション推奨事項

- エージェントのパフォーマンスが期待どおりでない場合、まずモデルを替えないでください——ハーネス設計を監査し、コンテキスト管理、ツールオーケストレーション、フィードバックループを一つずつ最適化

- モデル-ハーネスの適合性に注目——異なるモデルには異なるツール呼び出しの好みがあり、ハーネスは目的に合わせた設計が必要です。

- ハーネス評価体系を構築——モデルをテストするように体系的にハーネスをテストし、同一モデル下で異なる設計のパフォーマンス差を比較

- オープンソースハーネスソリューションを検討——LangChain のアプローチは、ハーネスパターンが新しいオープンソース競争領域になる可能性を示唆

ハーネス時代が到来しました。モデルは能力の上限を提供し、ハーネスはどこまで到達できるかを決定します。