去年のこの時期、「ローカルで深度研究を走る」と言えば空想のように聞こえた。クラウド大モデル、有料API、応答遅延とプライバシー漏洩の懸念を受け入れる必要があった。

今、RTX 3090 1枚、27Bパラメータのオープンソースモデル1つで、SimpleQAで約95%に到達する。

local-deep-researchプロジェクトはGitHubで静かに7,098 starまで成長、今週2,483増加。6,415コミット、440ブランチ、155タグ——これはトイプロジェクトではなく、真剣にメンテナンスされているツールだ。

何ができるか

一言:質問を与えれば、研究員のように働く。

- 複数の検索エンジンを検索(arXiv、PubMedを含む10以上のソース)

- 情報を読み、フィルタリングし、相互検証

- 引用付きの研究レポートに統合

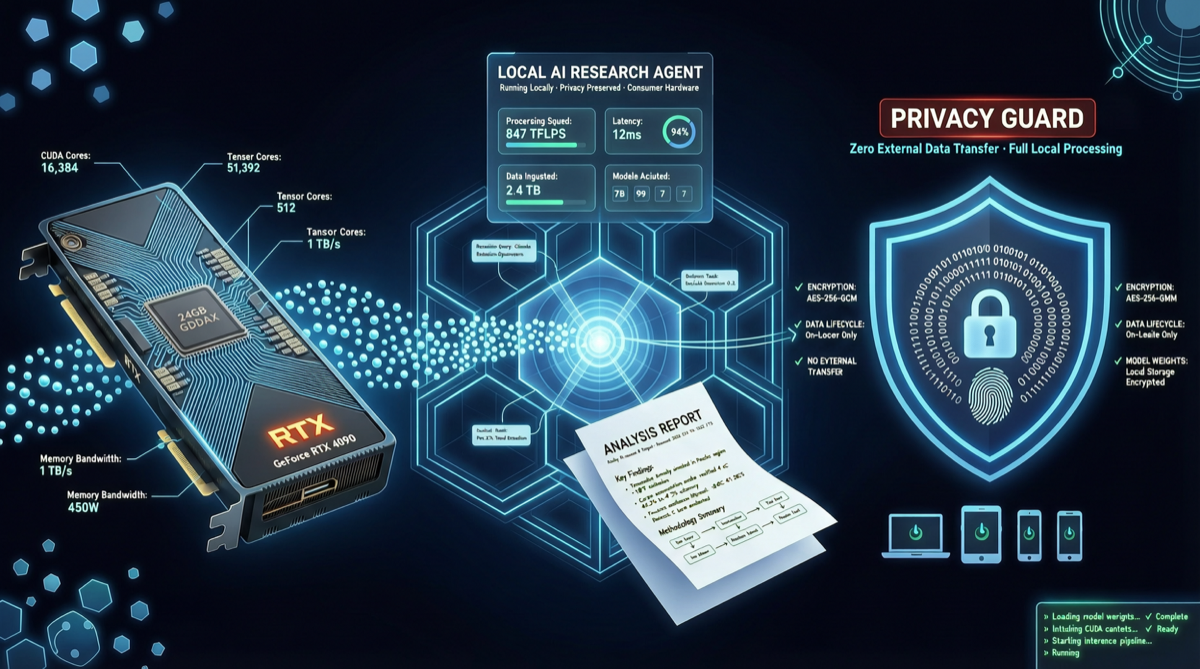

- すべてローカルで完了、データは暗号化保存

クラウドベースの深度研究製品との核心的な違いは1つ:データがあなたのマシンを出ないこと。

Qwen3.6-27Bが3090で走る、この事実自体に意味がある

27Bパラメータのモデル、4-bit量子化で約15GB VRAM。RTX 3090は24GB——ちょうど収まるが、余裕はある。これは何を意味するか?

2年前、このレベルの推論にはA100が必要だった。1年前、4090が必要だった。今、中古の3090でいい。

これは線形的な進歩ではない。コストカーブ上の跳水だ。

95% SimpleQAという数字をどう理解するか

SimpleQAはOpenAIのQAベンチマークで、「モデルが簡潔で正確な事実回答を出せるか」をテストする。95%は高いが、いくつか注意点がある:

- これはコミュニティ報告の数値で、公式ベンチマーク結果ではない。READMEは「

95%」と書いている——この「」が重要 - SimpleQAは事実QAをテストするもので、推論でも執筆でもコードでもない

- 高スコア ≠ すべての研究シナリオで使える

それでも、SimpleQA 95%は意味する:大部分の事実確認タスクにおいて、ローカルモデルは既に十分だ。

適用シナリオ

- 学術論文リサーチ:arXiv、PubMed統合、論文を直接検索、サマリー生成

- 技術選定リサーチ:複数の方案を比較、分析レポート作成

- プライバシーセンシティブな研究:医療データ、内部ドキュメント、企業秘密——データはローカルから出ない

適さないシナリオ

- 超大规模知識検索が必要な場合(クラウドモデルのパラメータ数は依然としてローカルを圧倒)

- 推論チェーンの深度に高い要求がある場合(27Bの推論能力は400B+に差がある)

- 最新イベントのリアルタイムウェブ検索が必要な場合(ローカルモデルのトレーニングデータにはカットオフ日がある)

ローカルAI研究の転換点

local-deep-researchは唯一のローカル研究ツールではないが、現時点で最も成熟している可能性がある。6,415コミット、186オープンPR、79オープンissue——これらの数字はコミュニティが真剣に貢献していることを示している。

コンシューマーGPU 1枚でクラウドモデルに迫る深度研究能力が実現するとき、「クラウドを使わなければならない」理由はまた1つ消える。

主な情報源: