去年这个时候,"本地跑深度研究"听起来像是天方夜谭。你需要云端大模型、需要付费 API、需要忍受响应延迟和隐私泄露的隐忧。

现在,一张 RTX 3090,一个 27B 参数的开源模型,就能在 SimpleQA 上跑到约 95% 的准确率。

local-deep-research 这个项目在 GitHub 上安静地长到了 7,098 个 star,这周新增 2,483。6,415 次 commit,440 个分支,155 个 tag——这不是一个 toy project,是一个被认真维护的工具。

它能做什么

一句话:给你一个问题,它会像研究员一样工作。

- 搜索多个搜索引擎(10+ 种来源,包括 arXiv、PubMed)

- 阅读、筛选、交叉验证信息

- 综合成一份有引用的研究报告

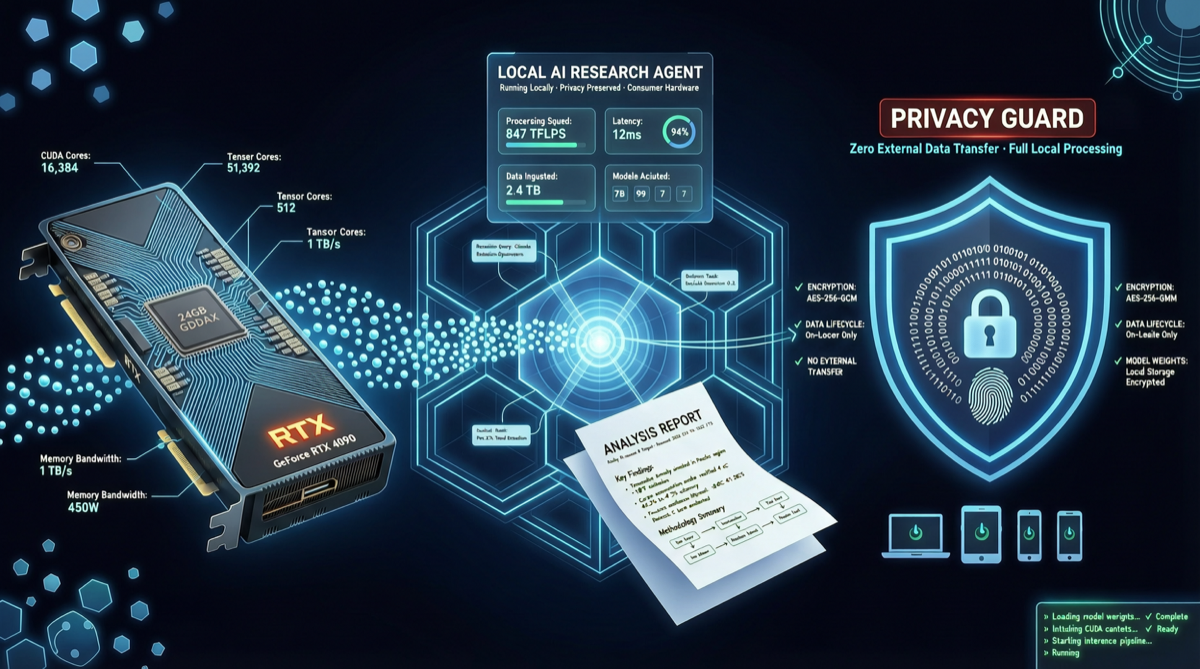

- 全部在本地完成,数据加密存储

跟云端 deep research 类产品相比,核心差异就一个:数据不出你的机器。

Qwen3.6-27B 在 3090 上能跑,这件事本身就有信号意义

27B 参数的模型,4-bit 量化后大概 15GB 显存。RTX 3090 有 24GB——刚好够,但不是在裸奔。这意味着什么?

两年前,这个级别的推理能力需要 A100。一年前,需要 4090。现在,一张二手 3090 就行。

这不是线性进步。这是成本曲线上的一次跳水。

95% SimpleQA 这个数字怎么理解

SimpleQA 是 OpenAI 出的问答基准,测的是"模型能不能给出简洁准确的事实性回答"。95% 很高,但需要注意几点:

- 这是社区报的数字,不是官方 benchmark 跑出来的。项目 README 说"

95%",这个""很重要 - SimpleQA 测的是事实问答,不是推理、不是写作、不是代码

- 跑分高 ≠ 在所有研究场景都能用

但即便如此,95% 的 SimpleQA 意味着:对于大部分事实核查类任务,本地模型已经够用了。

适用场景

- 学术论文调研:arXiv、PubMed 集成,直接搜论文、出摘要

- 技术选型调研:对比多个方案、出分析报告

- 隐私敏感的研究:医疗数据、内部文档、商业机密——数据不离开本地

不合适的场景

- 需要超大规模知识检索的(云端模型的参数量仍然碾压本地)

- 对推理链深度要求极高的(27B 的推理能力跟 400B+ 有差距)

- 需要实时联网搜索最新事件的(本地模型的训练数据有截止日期)

本地 AI 研究的转折点

local-deep-research 不是唯一一个本地研究工具,但它可能是目前最成熟的一个。6,415 次 commit、186 个 open PR、79 个 open issue——这些数字说明社区在认真贡献。

当一张消费级显卡就能跑出接近云端模型的深度研究能力时,"必须用云端"的理由就少了一个。

主要来源: