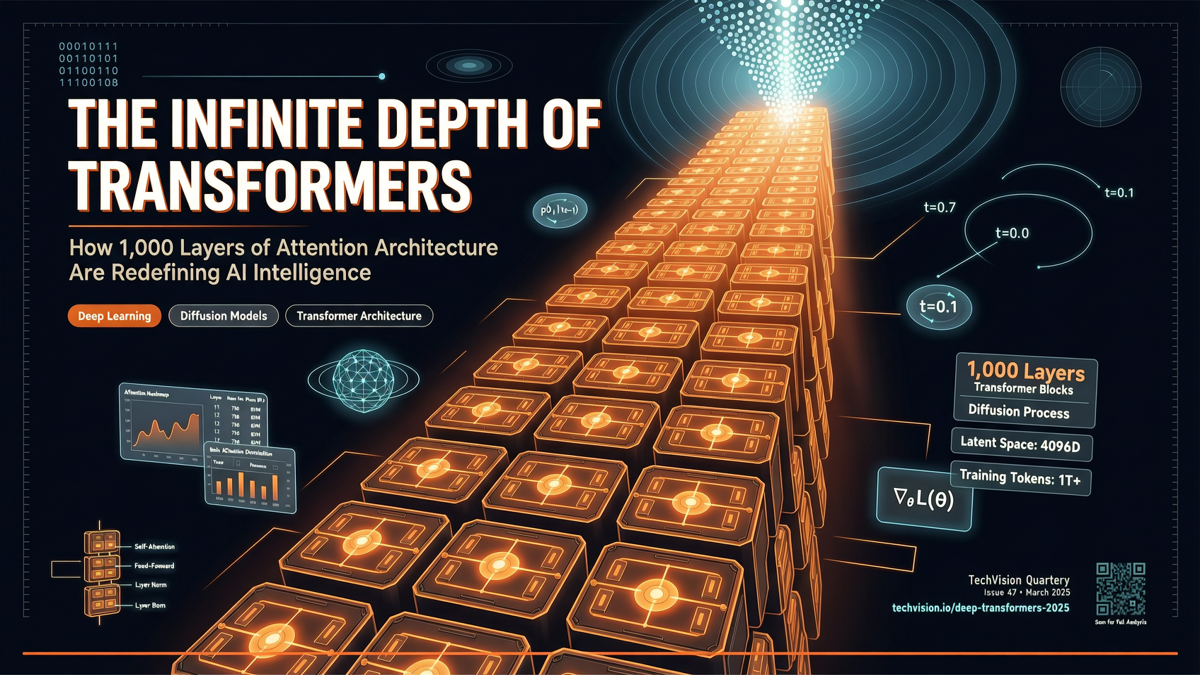

論文のタイトルは『Mean Mode Screaming: Mean--Variance Split Residuals for 1000-Layer Diffusion Transformers』である。

101件の高評価を獲得し、当日のHugging Face Daily Papersで第1位となった。

一見無関係に思えるこのタイトル——「Mean Mode Screaming」(平均モード・スクリーム)——は、実は極めて真剣な技術的課題への取り組みを表している:従来28~64層にとどまっていたDiffusion Transformerの层数を、1000層まで拡張しつつ、学習の発散を防ぐにはどうすればよいか?

なぜDiffusion Transformerは深くできないのか?

トランスフォーマーアーキテクチャは大規模言語モデル(LLM)において100層以上に達することが日常的である。一方、拡散モデル(Diffusion Model)では、通常28~64層程度に留まっている。

その理由は主に二つある:

第一に、勾配消失/爆発問題。 拡散モデルの学習プロセスは、LLMよりももともと不安定である。複数の時刻ステップにわたって損失を計算する必要があり、勾配はノイズ除去全体の経路を通じて伝播しなければならない。層数が増えるほど、勾配伝播のパスは長くなり、問題はさらに深刻化する。

第二に、従来の残差接続では不十分であること。 標準的なトランスフォーマーでは、深いネットワークにおける学習困難を緩和するために残差接続を用いるが、拡散モデルの文脈では、この手法の効果は限定的である。

こうした事情により、一種の皮肉な状況が生じている:LLMのトランスフォーマーは自由に層を重ねられるが、DiT(Diffusion Transformer)の层数は長年にわたり頭打ちの状態が続いてきた。

Mean-Variance Split Residualsとは何か?

本論文の核心的革新は、新たな残差接続方式——平均–分散分割型残差接続(Mean-Variance Split Residuals)——の提案である。

従来の残差接続は y = x + F(x) という形であり、入力 x を変換後の出力 F(x) に直接加算する。

一方、平均–分散分割型では、特徴マップのチャンネルを二つのグループに明確に分割し、一方は「平均モード(mean mode)」、他方は「分散モード(variance mode)」としてそれぞれ独立して学習を行う。各モードごとに個別に残差接続を適用した後、最終的に統合する。

この設計の直感的根拠は次の通りである:深層ネットワーク内では、平均信号と分散信号の伝播特性は本質的に異なる。 平均信号は深層部で容易に減衰(勾配消失)し、分散信号は逆に過剰に蓄積(勾配爆発)しやすい。両者を分離して処理することで、それぞれに最適化された伝播パスを構築できる。

1000層という数字が意味するもの

64層から1000層へ——これは単なる「層数の増加」ではない。

層数が15倍以上増加することは、理論的にはモデルの表現能力を指数関数的に高めることを意味する。ただし、肝心なのは:そのような深さを実際に安定して学習可能か?

論文タイトルに用いられた「Screaming(スクリーム)」という語は、おそらくこうした極限状態を暗示している:層数を限界まで押し上げたとき、モデルの挙動は極端になる——すなわち、驚異的な性能を示すか、あるいは完全に崩壊するかのどちらかである。「平均–分散分割型残差接続」の役割は、モデルを「沈黙(silence)」ではなく「叫び(scream)」の状態に保つこと、つまり深層部においても信号の活性を維持することにある。

LLMとの深度比較

興味深い対比が存在する:

- LLM(GPT-4など):通常約100層

- DiT(Stable Diffusion 3など):通常28~64層

- 本論文:1000層のDiT

もし1000層DiTが安定して学習可能であり、かつ浅層モデルを上回る生成品質を実現できたならば、拡散モデルのスケーリング則(Scaling Law)には、まだ未開拓の大きな余地が残されている可能性がある。

ただし、一つ重要な相違点に注意が必要である:LLMの「深さ」とDiTの「深さ」は、概念的に等価ではない。 LLMの各層はシーケンス上の自己注意を処理するのに対し、DiTの各層は空間パッチ上の注意機構を処理する。両者の計算複雑度や情報密度は本質的に異なる。

実際の疑問点

101件の高評価は、コミュニティがこの方向性に強い関心を寄せていることを示すが、以下の点については検証が必要である:

生成品質は、本当に深度とともに単調に向上するのか? 多くのアーキテクチャ革新は論文上で優れた結果を示すものの、実際のベンチマーク(FID、ISなどの指標)ではわずかな改善にとどまる場合が多い。

推論コストはどの程度増加するのか? 1000層の推論遅延は、64層と比べて桁違いに大きくなる。たとえ学習が成功しても、実運用におけるコスト負担は許容可能なのか?

平均–分散分割型残差接続が、本当に決定的要因なのか? 1000層の安定学習を実現した主な要因は、むしろ他の技術(例えば、より洗練された初期化戦略や学習率スケジューリングなど)にある可能性もある。その点を確認するためのアブレーション実験が不可欠である。

総括

これは、極めて大胆なアーキテクチャ探求である。DiTを1000層まで拡張する試みは、最終的に主流となるかどうかにかかわらず、拡散モデルのスケーリング限界を理解するうえで貴重な知見を提供するだろう。

仮に平均–分散分割型残差接続のアイデアが有効であると証明されれば、それはDiTにとどまらず、極めて深いネットワークを必要とする他のタスクにも応用可能な汎用的原理となり得る。

今後の展開を注視する価値は十分にある。

主要情報源:

- Hugging Face Daily Papers - 2026年5月11日号

- 「Mean Mode Screaming: Mean--Variance Split Residuals for 1000-Layer Diffusion Transformers」