すでに起こっている変化

2026年5月、ソーシャルメディア上で广泛な議論を巻き起こした投稿があった:

「2026年のAIモデル選定はもう変わった。『最強のものを選ぶ』のではなく『各タスクに最適なモデルを選ぶ』のだ: コーディング/バグ修正 → Claude Opus 4.7 多段階推論/Agent → GPT-5.5 長文ドキュメント分析 → DeepSeek V4-Pro(100万トークン) 大量処理/コスト削減 → DeepSeek V4-Flash マルチモデルルーティングの時代では、调配できることが使うことより重要になる。」

この投稿の核心的洞察はこうだ:モデル市場の競争は「単一チャンピオン」から「シーン別分業」に移行した。

なぜこの変化が起こるのか?

1. 能力差の縮小、価格差の拡大

Kimi K2.6とDeepSeek V4 ProのIntelligence IndexスコアがGPT-5.5に接近し(差6〜8ポイント)、価格が1/10しかないとき、「最も高いものを使う」のはもはや合理的な選択ではない。

| シーン | 推奨モデル | 月額コスト(重度使用) |

|---|---|---|

| コード生成/レビュー | Claude Opus 4.7 | $150-300 |

| 複雑な推論チェーン | GPT-5.5 | $200-500 |

| 長文ドキュメント要約 | DeepSeek V4 Pro | $20-40 |

| バッチAgentタスク | DeepSeek V4 Flash | $5-15 |

| 中国語長文コンテキスト | Kimi K2.6 | $15-30 |

コードレビュー、ドキュメント分析、バッチ処理を含む統合ワークフローを単一のGPT-5.5で完了する場合、コストは月$500以上になる可能性があるが、マルチモデルルーティングなら$100以内に抑えられる。

2. 国産モデルの差異化の成熟

2025年の国産モデル競争はまだ「誰のベンチマークスコアが高いか」の段階にあった。しかし2026年になると、各社が明確な差異化ポジショニングを形成し始めている:

- 智譜 GLM-5.1:請求書処理、構造化データ抽出などの垂直シーンで安定した表現、サブスクリプション$80/月で呼び出し回数無制限

- 月之暗面 Kimi K2.6:100万トークンコンテキスト + Agent Swarmアーキテクチャ、300サブAgent並列処理、大規模Agent協調に最適

- 深度求索 DeepSeek V4 Pro:1.6T MoE + 百万級コンテキスト、推論コストパフォーマンス最高、華為昇騰チップにも适配済み

- MiniMax M2.7:自己進化メカニズム、Agentワークフローで独特の優位性を発揮

- 面壁智能 MiMo V2.5 Pro:1T MoE + MITオープンソースライセンス、商用利用のハードルゼロ

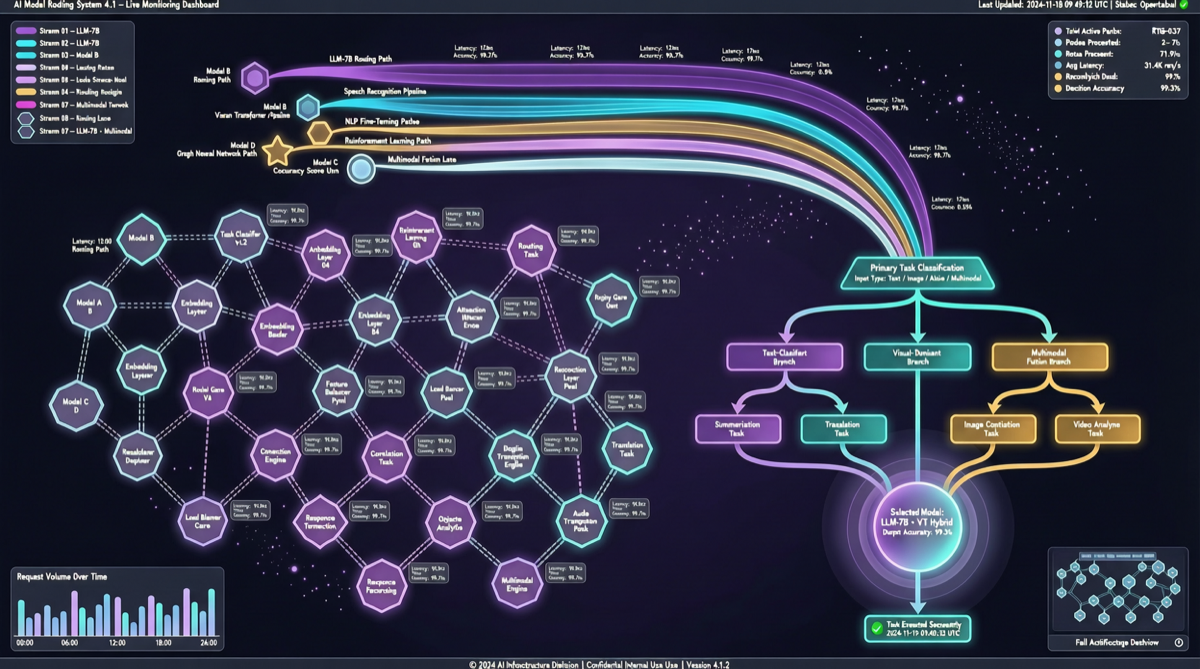

3. Agentフレームワークがマルチモデル编排を簡素化

OpenClawやHermes Agentなどのオープンソースフレームワークの成熟により、マルチモデルルーティングはもはやエンジニアリングの難題ではなくなった。開発者は設定ファイルで異なるタスクに対応するモデルを指定するだけで、フレームワークがルーティング、フォールバック、コスト最適化を自動的に処理する。

実践:典型開発者の日常ルーティング

午前9:00 — コードレビュー

├── タスク:15個のPRのコード品質をレビュー

├── モデル:Claude Opus 4.7

├── 理由:コード理解の深さが最高、誤検知率が最低

└── コスト:~$8

午前11:00 — 要件分析

├── タスク:200ページの製品要件ドキュメントを分析、主要な制約を抽出

├── モデル:DeepSeek V4 Pro(100万トークンコンテキスト)

├── 理由:長文処理能力 + 低コスト

└── コスト:~$3

午後2:00 — バッチAgentタスク

├── タスク:50個のリポジトリに自動テストを生成

├── モデル:DeepSeek V4 Flash

├── 理由:高スループット + 無料枠でカバー

└── コスト:~$0

午後4:00 — 複雑な推論

├── タスク:システムアーキテクチャ案を設計、多段階推論が必要

├── モデル:GPT-5.5

├── 理由:多段階推論チェーンの一貫性が最高

└── コスト:~$12

午後8:00 — 中国語コンテンツ生成

├── タスク:製品ドキュメントの中国語版を生成

├── モデル:Kimi K2.6

├── 理由:中国語コンテキスト理解 + 長いコンテキスト

└── コスト:~$2

当日合計:~$25

単一モデル(GPT-5.5)で同等タスクを完了:~$120以上

節約:約80%自分のマルチモデルルーティングをどう構築するか?

ステップ1:タスクタイプの洗い出し

| タスクタイプ | 主要な要件 | 適したモデル |

|---|---|---|

| コード生成/レビュー | コード理解の深さ | Claude Opus 4.7, DeepSeek V4 Pro |

| 多段階推論 | 推論チェーンの一貫性 | GPT-5.5 |

| 長文ドキュメント処理 | 大きなコンテキストウィンドウ | DeepSeek V4 Pro, Kimi K2.6 |

| バッチAgent | コスト + スループット | DeepSeek V4 Flash, Kimi K2.6 |

| 中国語コンテンツ | 中国語コンテキスト | Kimi K2.6, GLM-5.1 |

| 日常会話 | 応答速度 | DeepSeek V4 Flash, GLM-5.1 |

ステップ2:ルーティングツールの選択

- OpenClaw:マルチモデルの自動切り替えをサポート、フォールバック戦略の設定が可能

- Hermes Agent:デスクトップレベルのAgentプラットフォーム、マルチモデルルーティングをネイティブサポート

- LiteLLM:オープンソースのプロキシレイヤー、統一APIインターフェース、最適なモデルへの自動ルーティング

- 自制ルーティング:シンプルなif-elseまたはルールエンジンでタスクタイプごとに配信

ステップ3:モニタリングと最適化

マルチモデルルーティングは一度限りの設定ではない。毎週以下の確認を推奨:

- 各モデルの実際のトークン消費 vs バudget

- タスク完了率(「安い」モデルを選んだ結果、繰り返しリトライにつながっていないか)

- ユーザー満足度フィードバック(一部のシーンでは、能力差は感知可能である)

構造判断

マルチモデルルーティングは「節約テクニック」ではなく、パラダイムシフトである。

モデル市場が「一人のチャンピオンが総取り」から「複数のベンダーが分業で協力」に変わるとき、最大の勝者は特定のモデルベンダーではなく、モデルを调配できる開発者だ。

2026年のAI競争力は、あなたがどのモデルを使っているかではなく、正しいタイミングで、正しいタスクのために、正しいモデルを選べるかどうかにかかっている。

アクションアドバイス

- 個人開発者:DeepSeek V4 Flashの無料枠から始めて、重要なシーンにClaudeやGPTを徐々に追加しよう——月間コストは$20以内に抑えられる

- 企業チーム:モデルルーティング戦略ドキュメントを作成し、各シーンのデフォルトモデル、フォールバックモデル、コスト上限を明確にしよう

- ツール選定:マルチモデルルーティングをサポートするAgentフレームワーク(OpenClaw、Hermes Agent)を優先し、単一ベンダーへのロックインを避けよう