一个正在发生的转变

2026 年 5 月,社交媒体上出现了一条引发广泛讨论的帖子:

“2026年AI模型选型已经变了。不是选’最强的那个’,是选’最适合当前任务的那个’: 写代码/修bug → Claude Opus 4.7 多步推理/Agent → GPT-5.5 长文档分析 → DeepSeek V4-Pro(100万token) 跑量/省钱 → DeepSeek V4-Flash 多模型路由时代,会调配比会使用更重要。”

这条帖子的核心洞察是:模型市场的竞争已经从”单一冠军”转向”场景分工”。

为什么会发生这个转变?

1. 能力差距缩小,价格差距扩大

当 Kimi K2.6 和 DeepSeek V4 Pro 的 Intelligence Index 分数逼近 GPT-5.5(差距仅 6-8 分),但价格只有后者的 1/10 时,“用最贵的”就不再是理性选择。

| 场景 | 推荐模型 | 月度成本(重度使用) |

|---|---|---|

| 代码生成/审查 | Claude Opus 4.7 | $150-300 |

| 复杂推理链 | GPT-5.5 | $200-500 |

| 长文档摘要 | DeepSeek V4 Pro | $20-40 |

| 批量 Agent 任务 | DeepSeek V4 Flash | $5-15 |

| 中文长上下文 | Kimi K2.6 | $15-30 |

同样是完成一个包含代码审查、文档分析、批量处理的综合工作流,用单一 GPT-5.5 的成本可能达到 $500+/月,而多模型路由可以控制在 $100 以内。

2. 国产模型的差异化成熟

2025 年的国产模型竞争还停留在”谁跑分更高”的阶段。但到了 2026 年,各家开始形成明确的差异化定位:

- 智谱 GLM-5.1:在发票处理、结构化数据提取等垂直场景中表现稳定,订阅制 $80/月不限调用

- 月之暗面 Kimi K2.6:100 万 token 上下文 + Agent Swarm 架构,300 子 Agent 并行,适合大规模 Agent 协作

- 深度求索 DeepSeek V4 Pro:1.6T MoE + 百万级上下文,推理性价比最高,已适配华为昇腾芯片

- MiniMax M2.7:自我进化机制,在 Agent 工作流中展现独特优势

- 面壁智能 MiMo V2.5 Pro:1T MoE + MIT 开源许可,商业使用零门槛

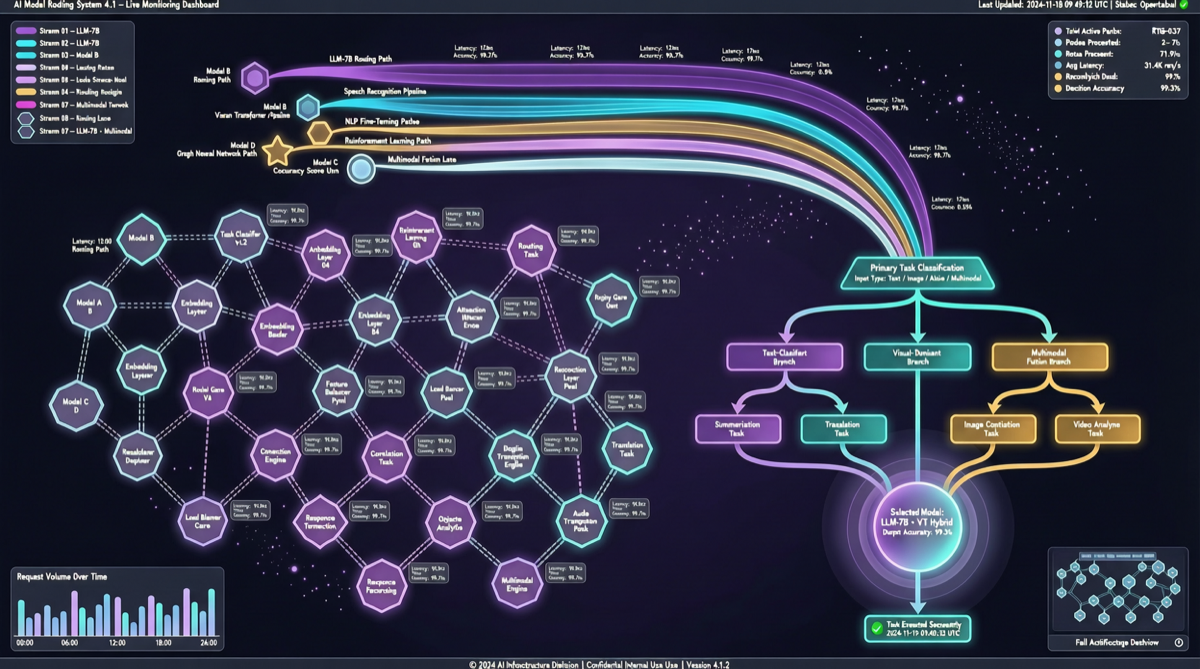

3. Agent 框架让多模型编排变得简单

OpenClaw、Hermes Agent 等开源框架的成熟,让多模型路由不再是工程难题。开发者只需在配置文件中指定不同任务对应的模型,框架自动处理路由、fallback 和成本优化。

实战:一个典型开发者的日常路由

早 9:00 — 代码审查

├── 任务:审查 15 个 PR 的代码质量

├── 模型:Claude Opus 4.7

├── 理由:代码理解深度最佳,误报率最低

└── 成本:~$8

上午 11:00 — 需求分析

├── 任务:分析 200 页产品需求文档,提取关键约束

├── 模型:DeepSeek V4 Pro(100 万 token 上下文)

├── 理由:长文档处理能力 + 成本低

└── 成本:~$3

下午 2:00 — Agent 批量任务

├── 任务:为 50 个仓库生成自动化测试

├── 模型:DeepSeek V4 Flash

├── 理由:高吞吐 + 免费额度覆盖

└── 成本:~$0

下午 4:00 — 复杂推理

├── 任务:设计系统架构方案,需要多步推理

├── 模型:GPT-5.5

├── 理由:多步推理链的连贯性最佳

└── 成本:~$12

晚间 8:00 — 中文内容生成

├── 任务:生成产品文档的中文版本

├── 模型:Kimi K2.6

├── 理由:中文语境理解 + 长上下文

└── 成本:~$2

当日总成本:~$25

单一模型(GPT-5.5)完成同等任务:~$120+

节省:约 80%如何搭建自己的多模型路由?

第一步:盘点你的任务类型

| 任务类型 | 关键需求 | 适合模型 |

|---|---|---|

| 代码生成/审查 | 代码理解深度 | Claude Opus 4.7, DeepSeek V4 Pro |

| 多步推理 | 推理链连贯性 | GPT-5.5 |

| 长文档处理 | 大上下文窗口 | DeepSeek V4 Pro, Kimi K2.6 |

| 批量 Agent | 成本 + 吞吐 | DeepSeek V4 Flash, Kimi K2.6 |

| 中文内容 | 中文语境 | Kimi K2.6, GLM-5.1 |

| 日常对话 | 响应速度 | DeepSeek V4 Flash, GLM-5.1 |

第二步:选择路由工具

- OpenClaw:支持多模型自动切换,可配置 fallback 策略

- Hermes Agent:桌面级 Agent 平台,天然支持多模型路由

- LiteLLM:开源代理层,统一 API 接口,自动路由到最优模型

- 自建路由:通过简单的 if-else 或规则引擎,按任务类型分发

第三步:监控和优化

多模型路由不是一次性配置。建议每周检查:

- 各模型的实际 token 消耗 vs 预算

- 任务完成率(是否因为选了”便宜”的模型导致反复重试)

- 用户满意度反馈(某些场景下,能力差距是可以感知的)

格局判断

多模型路由不是一个”省钱技巧”,而是一个范式转移。

当模型市场从”一个冠军通吃”变成”多家分工协作”时,最大的赢家不是某个模型厂商,而是会调配模型的开发者。

2026 年的 AI 竞争力,不再是你用的是什么模型,而是你能否在正确的时间、为正确的任务、选择正确的模型。

行动建议

- 个人开发者:从 DeepSeek V4 Flash 的免费额度开始,逐步叠加 Claude 或 GPT 用于关键场景,月度成本可以控制在 $20 以内

- 企业团队:建立模型路由策略文档,明确各场景的默认模型、fallback 模型和成本上限

- 工具选型:优先考虑支持多模型路由的 Agent 框架(OpenClaw、Hermes Agent),避免被单一厂商锁定