なぜ注目に値するのか

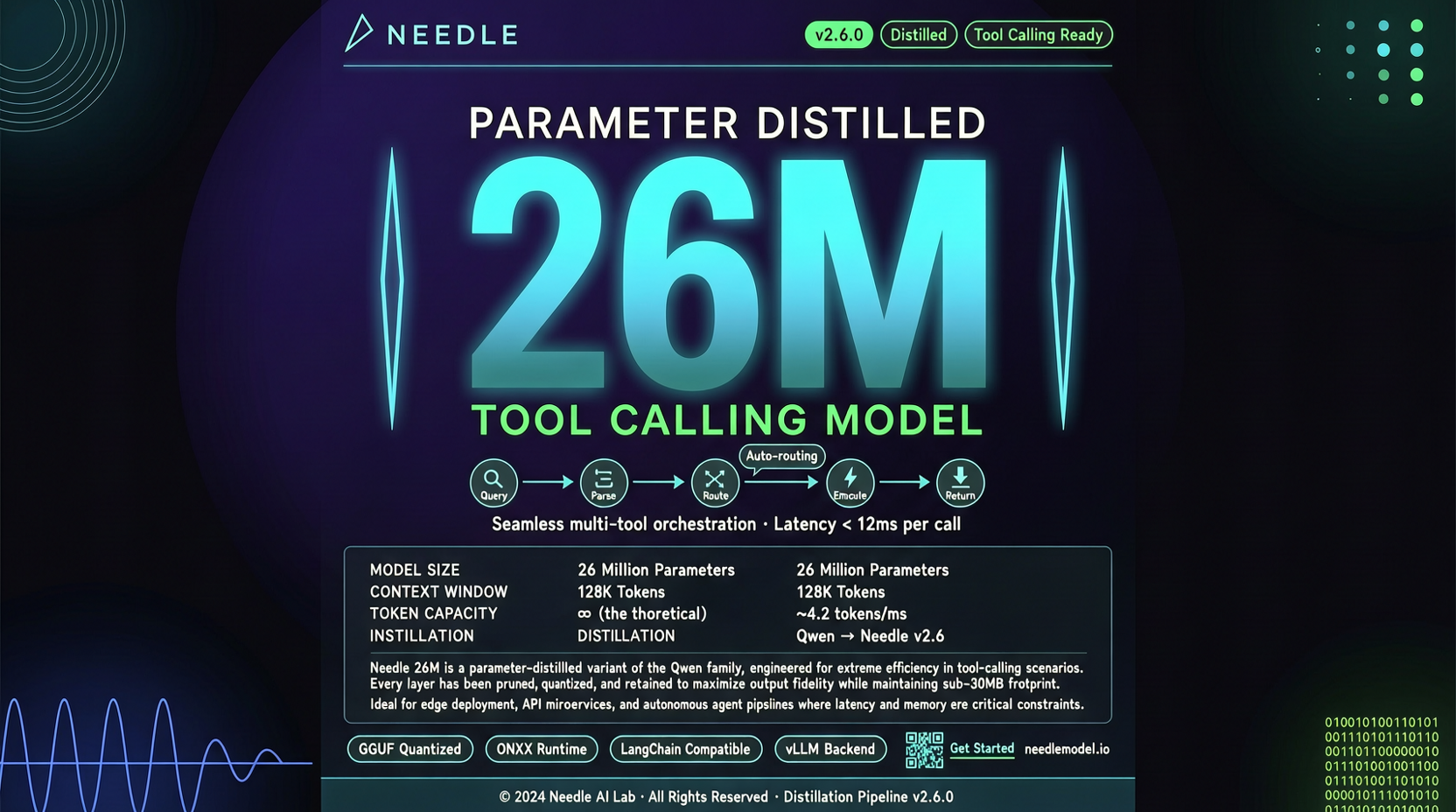

現在、業界全体がより大規模なモデル——数千億、あるいは数兆パラメータ規模のモデル——の開発に注力しています。しかしCactus Computeはその逆の道を選び、たった2600万パラメータという極小規模ながら、関数呼び出し(Function Calling/Tool Calling) という1つのタスクに特化したモデルを開発しました。

2600万パラメータとは、およそスマートフォンに保存される高精細画像1枚分のデータサイズに相当します。Raspberry Piやスマートフォン、さらには一部のマイクロコントローラ上でも実行可能です。

技術アプローチ

Needleの核となる手法は知識蒸留(Knowledge Distillation) です:

- 教師モデル(teacher)としてGemini(大規模言語モデル)を用い、大量のツール呼び出し用トレーニングデータを生成

- 学習者モデル(student)として2600万パラメータの小型モデルを用い、教師モデルのツール呼び出し挙動を学習

- 重要な洞察:ツール呼び出しは本質的に「構造化出力タスク」であり、ユーザーの意図に基づいて適切な関数名と引数を出力することを目的としている。このタスクの「情報密度」はそれほど高くなく、小型モデルでも十分に習得可能である

この考え方は直感的にも妥当です。熟練した職人(Gemini)が徒弟(Needle)を指導する様子に例えることができます。職人は複雑多様な状況下でどのツールを用いるべきかを熟知していますが、徒弟はその背景知識すべてを理解する必要はなく、「どのような状況でどのツールを呼び出すか」というマッピング関係のみを習得すればよいのです。

実用的な価値

1.エッジデバイス上でのAIエージェント実現

スマートフォンやIoTデバイス上でツール呼び出し機能を備えたAIエージェントを動作させたい場合、もはや完全なLLMを組み込む必要はありません。Needleはローカルで実行可能であり、推論が必要な場合のみクラウド上の大型モデルを呼び出します。これは典型的な「エンド・クラウド協調」アーキテクチャです。

2.APIコストの大幅削減

複雑なAIエージェントのワークフローにおいて、ツール呼び出しは最も頻繁に実行される操作の一つです。例えば、GPT-4を毎回呼び出して「どの関数を呼び出すべきか」を判断していた場合、トークン単価によるコスト負担は非常に大きくなります。これに対し、2600万パラメータのローカルモデルでこの意思決定を行うなら、実質ゼロコストで実現できます。

3.レイテンシ最適化

ローカル実行の2600万パラメータモデルによる推論遅延はミリ秒単位ですが、クラウドAPI呼び出しでは最低でも数百ミリ秒かかります。音声アシスタントやリアルタイム制御など、応答性が極めて重要なシーンでは、この数十倍ものレイテンシ差は決定的な意味を持ちます。

留意すべき点

スター数212 vs コミット数228

本プロジェクトはまだ非常に新しく(直近11時間前にリファクタリングが実施)、コミュニティによる検証も不十分です。オープンな課題(issue)が1件、オープンなプルリクエスト(PR)が8件あることから、初期の急速開発フェーズにあることが明確です。

機能の単一性

Needleはツール呼び出しにのみ特化しており、会話能力・推論能力・コード生成能力などは一切備えていません。ご要件が純粋にツール呼び出しのみであれば最適な選択となりますが、汎用的な能力が必要な場合は、依然として完全なLLMの活用が不可欠です。

蒸留品質は教師モデルに依存

Gemini自体のツール呼び出し能力も継続的に進化中です。もし教師モデルに体系的な誤りが存在する場合、学生モデル(Needle)はそれをそのまま継承してしまいます。すなわち、蒸留モデルの性能上限は、教師モデルの品質そのものに規定されます。

他社ソリューションとの比較

現在、ツール呼び出し機能の小型化には主に以下の3つのアプローチがあります:

- 蒸留アプローチ(Needle):大規模モデルの振る舞いを学習。パラメータ数が最小だが、教師モデルへの依存度が高い

- ファインチューニングアプローチ:オープンソースモデルをベースにツール呼び出し能力をファインチューニング。パラメータ数は中程度(7B–14B)で、柔軟性に優れる

- 専用アーキテクチャアプローチ:ツール呼び出しに特化した小型モデルをゼロから設計。最も革新的だが、技術的不確実性も最大

Needleは、まず蒸留によって小規模パラメータでの実現可能性を実証し、その後にアーキテクチャ最適化へと段階的に進むという、極めて実務的な戦略を選択しています。

一言でまとめると

2600万パラメータでツール呼び出しを実現することは、興味深いシグナルです。それは、AIエージェントの基盤技術が「1つの万能大規模モデル」から、「複数の専門化された小型モデル」が協調するハイブリッドアーキテクチャへと移行しつつあることを示唆しています。この方向性が確立されれば、エッジ環境におけるAIエージェントの導入障壁は飛躍的に低下することでしょう。

主要情報源: