Почему это интересно

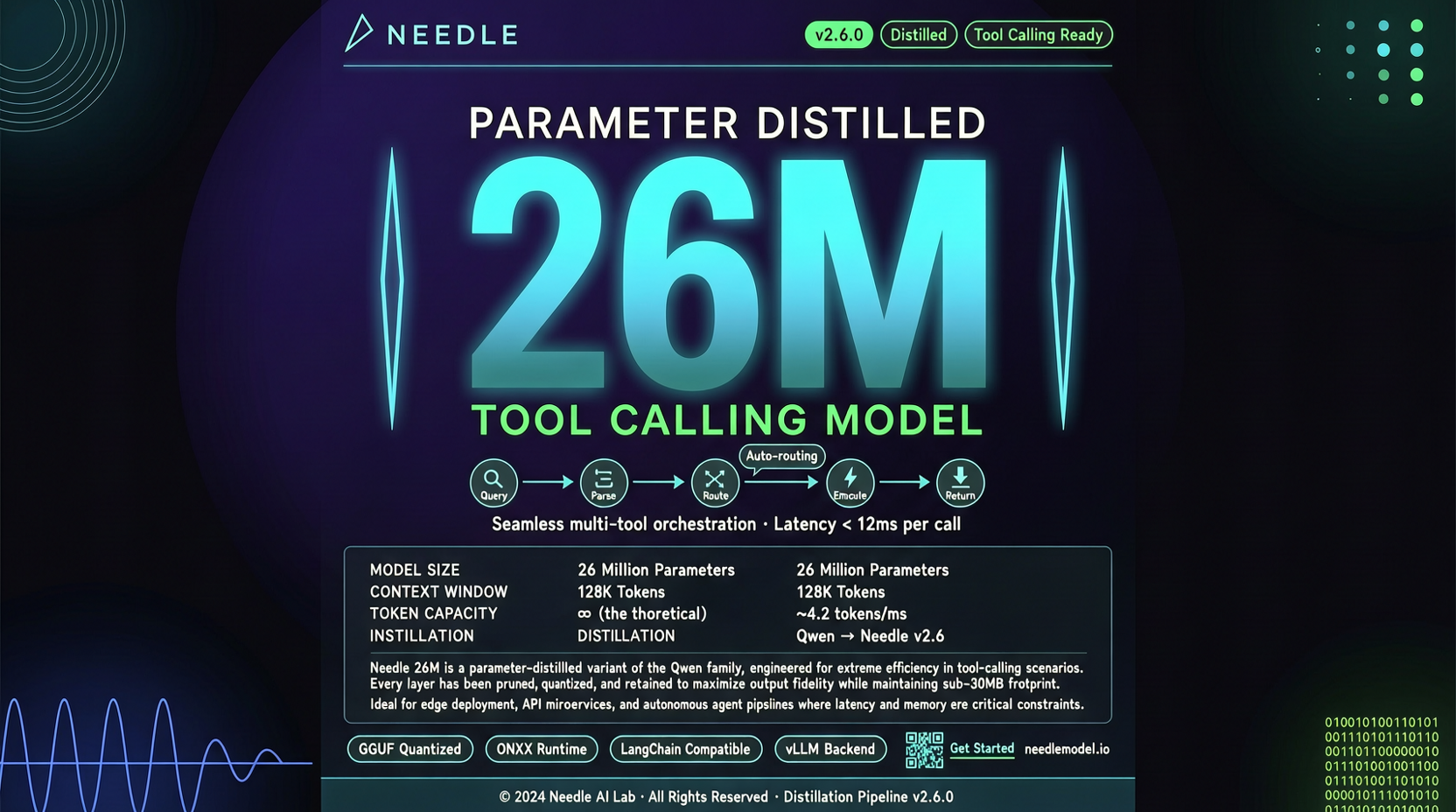

Сейчас все стремятся к созданию всё более крупных моделей — с миллиардами и даже триллионами параметров. Однако Cactus Compute пошла противоположным путём и разработала модель всего с 26 млн параметров, ориентированную исключительно на одну задачу: вызов функций (Function Calling / Tool Calling).

Что означает объём в 26 млн параметров? Примерно столько же занимает одна фотография высокого разрешения на вашем смартфоне. Такая модель может выполняться на Raspberry Pi, мобильных устройствах и даже на некоторых микроконтроллерах.

Технический подход

Ключевым методом, лежащим в основе Needle, является дистилляция знаний (Knowledge Distillation):

- Использование Gemini (крупной модели) в качестве «учителя» для генерации большого объёма обучающих данных по вызову инструментов;

- Обучение небольшой модели с 26 млн параметров («ученика») на воспроизведение поведения учителя при вызове инструментов;

- Ключевое понимание: вызов инструментов по своей сути представляет собой задачу структурированного вывода — по заданному намерению пользователя требуется выдать корректное имя функции и её аргументы. Информационная насыщенность этой задачи сравнительно невелика, поэтому она вполне под силу компактной модели.

Интуитивно такой подход выглядит обоснованным. Представьте опытного мастера, передающего навыки ученику: мастер (Gemini) знает, как выбрать нужный инструмент в самых сложных ситуациях, тогда как ученику (Needle) не требуется осваивать весь контекст и глубокие основания — достаточно усвоить отображение «в какой ситуации какой инструмент применять».

Практическая ценность

1. ИИ-агенты на пограничных устройствах

Если вы хотите запустить агента, способного выполнять вызовы инструментов, на смартфоне или IoT-устройстве, вам больше не нужно внедрять полноразмерную языковую модель. Needle работает локально и обращается к облачной большой модели только тогда, когда требуется выполнить фактическое рассуждение. Это типичная архитектура «совместной работы устройств и облака».

2. Снижение стоимости API-вызовов

В сложном рабочем процессе ИИ-агента операции вызова инструментов могут быть самыми частыми. Если каждый раз использовать GPT-4 для принятия решения о том, какую функцию вызвать, затраты на токены окажутся значительными. Принятие такого решения локальной моделью на 26 млн параметров практически не требует расходов.

3. Оптимизация задержки

Задержка вывода локальной модели на 26 млн параметров может составлять доли миллисекунды, тогда как вызов облачного API занимает как минимум несколько сотен миллисекунд. Для сценариев с жёсткими требованиями к времени отклика — например, голосовые помощники или системы управления в реальном времени — разница в десятки раз имеет принципиальное значение.

На что стоит обратить внимание

212 звёзд vs 228 коммитов

Проект ещё очень молод (переструктуризация произошла всего 11 часов назад), и его надёжность пока недостаточно проверена сообществом. Наличие одного открытого issue и восьми открытых pull request указывает на раннюю стадию активной разработки.

Узкая специализация

Needle предназначена исключительно для вызова инструментов. Она не умеет вести диалог, не способна к сложным рассуждениям и не генерирует код. Если ваш сценарий требует только вызова инструментов — Needle подходит идеально; если же нужны универсальные возможности, потребуется полноценная языковая модель.

Качество дистилляции зависит от качества «учителя»

Способность Gemini к вызову инструментов сама по себе находится в стадии развития. Если «учитель» систематически допускает ошибки, «ученик» унаследует их. Максимальное качество дистиллированной модели ограничено качеством исходной модели.

Сравнение с аналогичными решениями

На сегодняшний день основные пути миниатюризации возможностей вызова инструментов можно разделить на три:

- Дистилляция (Needle): обучение поведению большой модели; минимальный объём параметров, но зависимость от качества «учителя»;

- Тонкая настройка (fine-tuning): адаптация открытых моделей под задачу вызова инструментов; средний размер параметров (7–14 млрд), высокая гибкость;

- Специализированные архитектуры: проектирование с нуля новых компактных архитектур, оптимизированных именно для вызова инструментов; наиболее радикальный, но и наиболее рискованный путь.

Needle выбрала самый прагматичный подход: сначала доказать жизнеспособность малопараметрической реализации с помощью дистилляции, а затем — при необходимости — перейти к оптимизации архитектуры.

Одним предложением

Тот факт, что вызов инструментов можно реализовать с помощью модели всего на 26 млн параметров, — важный сигнал: инфраструктура ИИ-агентов постепенно смещается от парадигмы «одна универсальная большая модель» к гибридной архитектуре, основанной на нескольких специализированных компактных моделях. Успех этого пути значительно снизит порог входа для разработки ИИ-агентов на пограничных устройствах.

Основные источники: