RAGが三年走ってきて、誰もが前提を受け入れた:文書をスライス、embedding、ベクトルDBに保存、然后類似度マッチング。

PageIndexは言う:不要だと。

キャッチフレーズ:「Document Index for Vectorless, Reasoning-based RAG」。30.6k star、一週間で4300増加。

この成長速度は一つのことを示している:既存のRAG方案への不満が臨界点に達した。

ベクトルDBの何が問題か

ベクトルDBが悪いわけではない。ドキュメント構造が複雑で、テキスト類似度ではなく意味関係を理解する必要があるシナリオで不便だ。

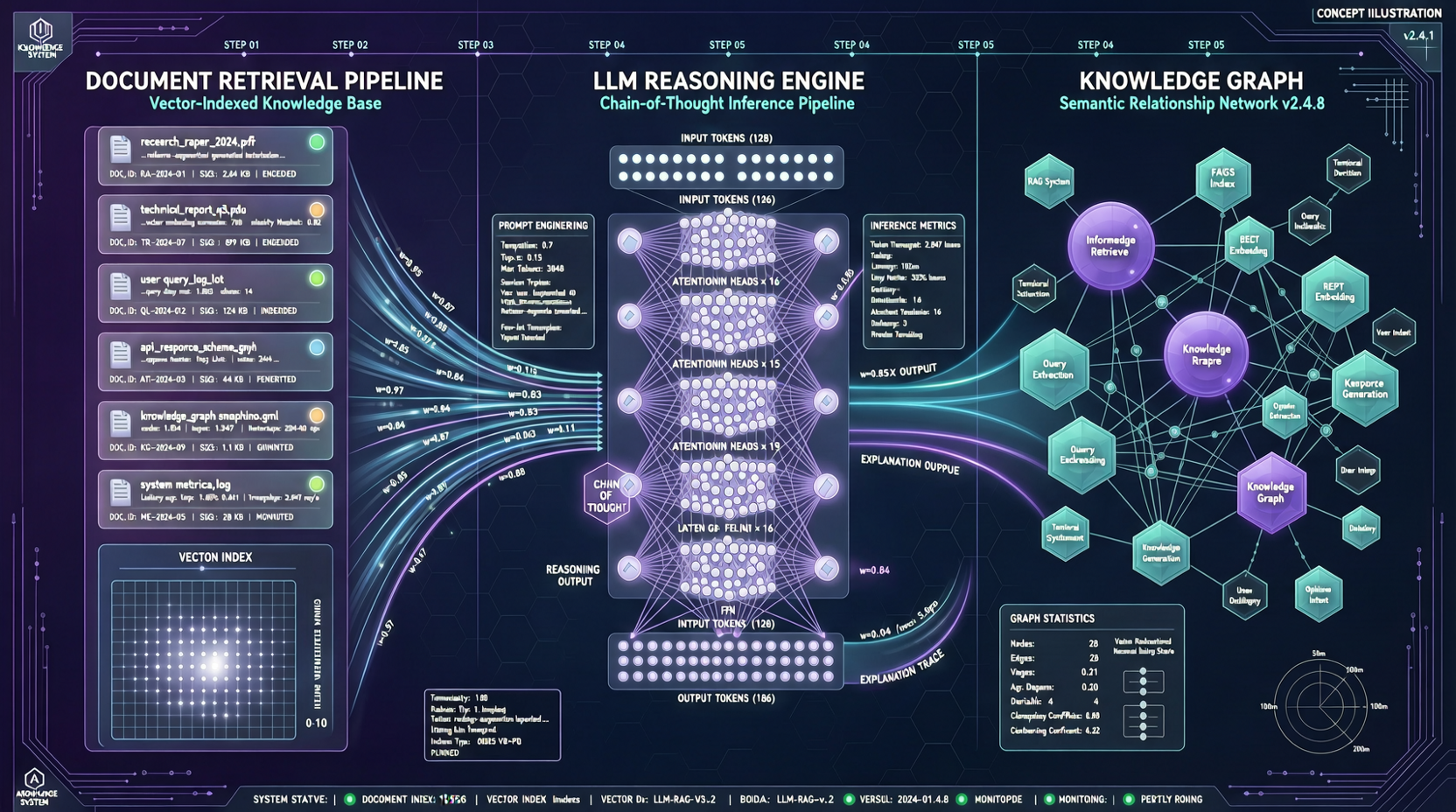

PageIndexの思路:embeddingによる類似度マッチングを使わず、LLMに直接「推論」させる。

どうやっているか

エージェントベースの検索ストラテジー——一つのエージェントがクエリを理解し、もう一つが文書索引で関連コンテンツを特定する。

性能はどうか

vectorless RAGの代价:毎回LLMを呼び出して推論する。

- レイテンシが高い:ベクトル検索はミリ秒級、LLM推論は秒級

- コストが高い:毎回LLMのtokenを消費

- 並発能力が低い

判断

vectorless RAGは面白い方向性だ。高価値・低並発のシナリオではすでに実用価値がある。

主要ソース: